MiniMax-M2.5 adalah model bahasa besar baru dari MiniMax yang berfokus pada produktivitas dan dioptimalkan untuk pengodean, penggunaan alat berbasis agen, serta alur kerja perkantoran. Anda dapat memanggilnya melalui platform native MiniMax atau melalui pengumpul API seperti CometAPI. Anda hanya perlu mendapatkan kunci API CometAPI untuk menggunakan API, karena Minimax-M2.5 juga mendukung format chat.

Apa itu MiniMax-M2.5?

MiniMax-M2.5 adalah rilis model besar terbaru dari MiniMax: evolusi keluarga M2 yang diposisikan perusahaan sebagai model serbaguna, mendukung agen, dengan kinerja kuat khususnya dalam pembuatan kode, penggunaan alat, dan penalaran multi-langkah. Keluarga M2.5 diumumkan rilis Februari 2026 dan mencakup varian standar M2.5 serta varian “highspeed” yang dioptimalkan untuk latensi lebih rendah dengan mempertahankan kapabilitas inti yang sama. Keluarga M2.5 meningkatkan skor tolok ukur pada evaluasi rekayasa perangkat lunak dan perilaku yang lebih baik saat berinteraksi dengan alat eksternal (pencarian, agen, dll.).

Vendor memposisikan M2.5 sebagai peningkatan dari rilis M2.x sebelumnya dengan penalaran lebih kuat, pembuatan kode lebih baik, dan keandalan pemanggilan alat yang ditingkatkan. Catatan rilis publik MiniMax pada awal Februari 2026 menandai M2.5 sebagai tonggak: penyetelan instruksi yang disempurnakan, pemahaman kode lebih kuat, dan peningkatan terukur pada beberapa tolok ukur berfokus kode. Rilis ini mencakup:

- Model M2.5 standar (menekankan akurasi dan penalaran).

- Varian M2.5-highspeed dengan latensi lebih rendah untuk alur kerja pengembang yang interaktif.

- Panduan eksplisit dan opsi penagihan untuk “Coding Plan” yang ditujukan bagi penggunaan pembuatan kode intensif.

Sorotan teknis utama

- Arsitektur: MoE (jumlah parameter total sangat besar dengan himpunan aktif yang jauh lebih kecil saat inferensi), memungkinkan titik manis biaya/kinerja untuk tugas berat.

- Kekuatan: performa pengodean mutakhir, penalaran multi-giliran, penanganan konteks panjang, dan integrasi agen/alat.

- Varian: MiniMax merilis varian (mis.,

MiniMax-M2.5danM2.5-highspeed) yang disetel untuk throughput vs latensi.

Mengapa ini penting saat ini: banyak tim yang membangun alat pengembang, asisten pemrograman, dan otomatisasi berbasis agen menghargai model yang dapat menalar lintas beberapa giliran, memanggil alat dengan aman, dan menghasilkan kode berkualitas tinggi. M2.5—berkat arsitektur dan pilihan pelatihan—secara eksplisit dipasarkan untuk skenario-skenario tersebut.

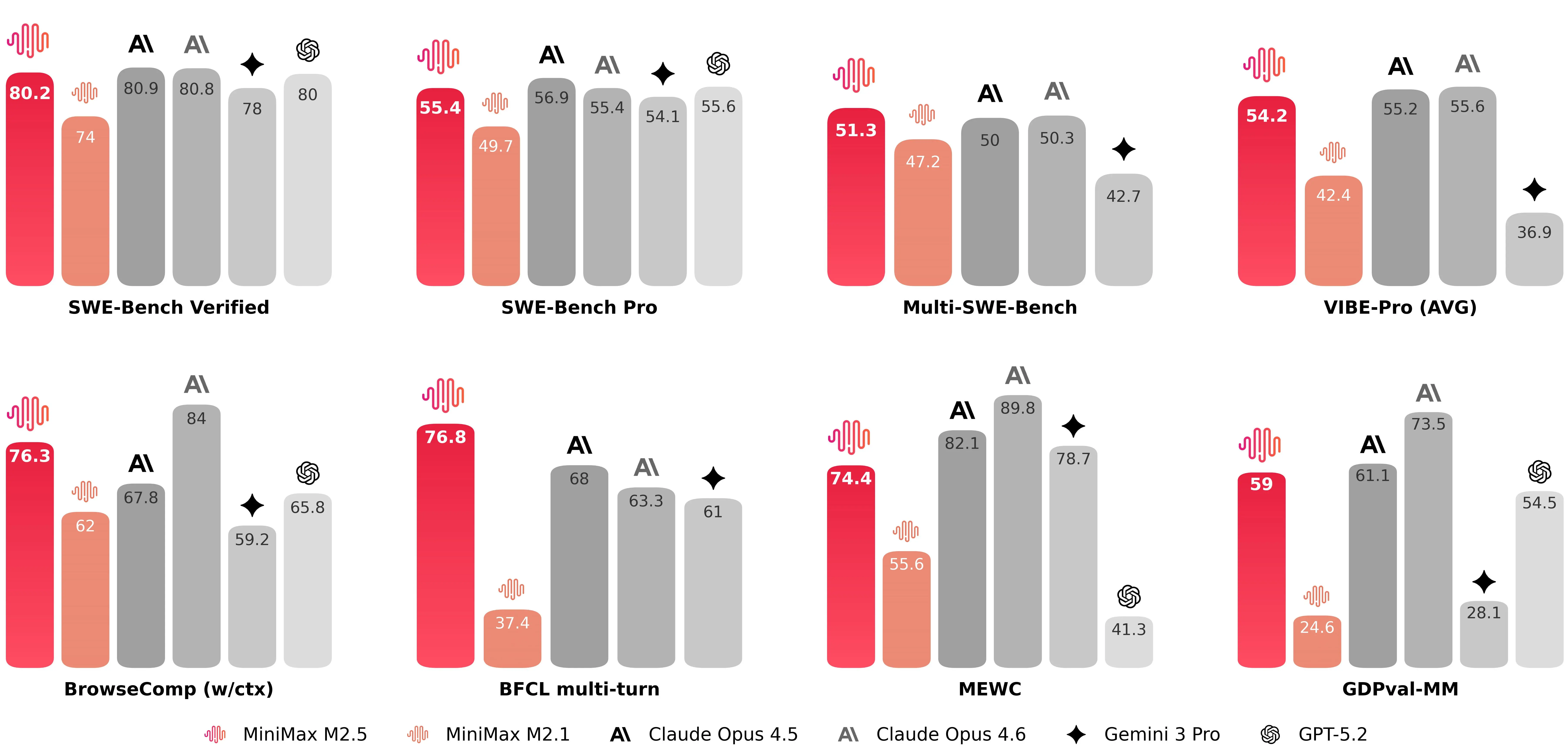

Benchmarking MiniMax-M2.5

Posisi M2.5 pada tolok ukur khusus pengodean

MiniMax-M2.5 mencetak 80,2% pada SWE-Bench Verified, bersama nilai kuat pada tolok ukur pengodean multi-tugas dan penelusuran yang ditingkatkan (angka yang dirilis perusahaan termasuk 51,3% pada Multi-SWE-Bench dan 76,3% pada BrowseComp saat manajemen konteks diaktifkan). Angka-angka ini menempatkan M2.5 di antara model berkinerja tertinggi yang tersedia secara publik untuk pembuatan kode dan pemecahan masalah saat peluncuran. Peluncuran MiniMax-M2.5 menegaskan bahwa M2.5 bersaing dengan jajaran teratas model pengodean.

Bagi pengembang, manfaatnya dua hal:

- Tingkat keberhasilan percobaan pertama lebih tinggi: lebih sedikit putaran perbaikan, lebih sedikit debug manual, dan beban “mengasuh” yang lebih rendah untuk agen pengodean otonom.

- Cakupan full-stack lebih baik: M2.5 digambarkan mendukung alur kerja full-stack di aplikasi desktop, seluler, dan toolchain lintas platform, yang berarti ia menargetkan bukan hanya potongan kode, tetapi solusi multi-berkas yang koheren dan skrip build.

Dibangun untuk alur kerja berbasis agen

M2.5 digambarkan sebagai “dirancang secara native untuk skenario Agen.” Secara praktis, ini berarti arsitektur dan regimen pelatihan memprioritaskan:

- Ketepatan pemanggilan alat: mengeluarkan panggilan API atau menjalankan perintah shell/SQL dengan sintaks dan parameter yang benar.

- Pergantian konteks dan memori: melanjutkan operasi multi-langkah yang terhenti tanpa kehilangan status yang sudah dihitung sebelumnya.

- Manipulasi berkas: menghasilkan dan mengedit format perkantoran umum secara terprogram (misalnya, membuat PowerPoint lalu merevisinya berdasarkan permintaan lanjutan).

Augmentasi pencarian dan penelusuran

Saat M2.5 dipadukan dengan lapisan penelusuran atau pengambilan, MiniMax melaporkan peningkatan skor yang nyata pada tolok ukur penelusuran, mencerminkan kinerja lebih kuat dalam mengintegrasikan informasi eksternal dan sitasi ke dalam keluaran. Ini membuat M2.5 cocok untuk alat yang harus mengambil konten terbaru, memeriksa silang hasil API, atau menguatkan pembuatan kode dengan data dunia nyata (misalnya, mengambil dokumen SDK terbaru dan menggunakannya dengan benar saat pembuatan kode). Kapabilitas ini penting bagi tim yang membangun fitur “agenik” seperti QA otomatis, rantai alat CI, atau asisten berbasis dokumen.

Bagaimana cara menggunakan API MiniMax-2.5 (melalui CometAPI)?

CometAPI adalah platform agregasi API yang mengekspos ratusan model melalui satu permukaan REST yang kompatibel dengan OpenAI. Karena antarmuka CometAPI mencerminkan endpoint chat/completions OpenAI, Anda sering dapat menggunakan kembali klien gaya OpenAI yang ada dengan mengganti api_base dan kunci API. Jika Anda memilih untuk tidak berintegrasi langsung dengan platform MiniMax (misalnya karena penagihan terpadu, pengujian A/B multi-model, atau abstraksi vendor), Anda dapat memanggil MiniMax-M2.5 melalui permukaan “chat” CometAPI. Platform CometAPI menyediakan format permintaan yang konsisten, SDK, dan web playground — serta mengekspos nama model dan parameter per model (sehingga Anda memilih string penyedia/model yang tepat saat memanggil).

Di bawah ini adalah panduan praktis dan ringkas untuk memanggil MiniMax-M2.5 melalui CometAPI, dengan contoh dalam curl dan Python.

Langkah dasar untuk memulai?

- Daftar akun CometAPI dan dapatkan kunci API. (CometAPI menyediakan playground dan SDK untuk menguji model.)

- Periksa daftar model CometAPI atau playground CometAPI untuk menemukan nama model yang tepat untuk MiniMax-M2.5.

- Buat permintaan POST terautentikasi dengan parameter

modeldiatur ke model MiniMax yang dipilih dan payload mengikuti skema chat/completion CometAPI. - Sesuaikan parameter (temperature, max_tokens, pesan sistem, streaming) sesuai alur kerja Anda.

Dasar autentikasi & endpoint

- URL dasar:

https://api.cometapi.com/v1(jalur gaya OpenAI seperti/chat/completionsdidukung). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Field model: gunakan string model persis seperti di katalog model CometAPI (contoh:

"minimax-m2.5")

Contoh 1 — curl cepat (REST, gaya OpenAI)

// Ganti $COMETAPI_KEY dengan kunci CometAPI Anda

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Catatan:

- Gunakan string model persis seperti yang ditampilkan di katalog CometAPI.

stream: truedidukung untuk streaming output (tangani server-sent events atau respons terpotong jika Anda menginginkan token parsial).

Contoh 2 — Python (requests) untuk chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Contoh 3 — Menggunakan integrasi litellm / CometAPI (lapisan kemudahan Python)

CometAPI didukung oleh beberapa SDK dan adapter komunitas. Dokumentasi liteLLM menunjukkan alur ringkas di mana Anda menetapkan COMETAPI_KEY dan memanggil model berdasarkan nama. Ini bagus untuk prototipe:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Integrasi Litellm / Comet menyediakan utilitas yang membantu (streaming, async, parameter api_key eksplisit) yang mencerminkan banyak pola SDK OpenAI yang ada.

Bagaimana sebaiknya Anda merancang prompt dan pesan sistem untuk M2.5

Nyatakan peran dan batasan secara eksplisit

Berikan M2.5 peran sistem yang jelas saat meminta kode. Contoh:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Gunakan dekomposisi langkah untuk masalah kompleks

Saat meminta M2.5 mengimplementasikan fitur kompleks, gunakan dekomposisi singkat:

- Minta kerangka desain.

- Minta tanda tangan antarmuka.

- Minta implementasi dan pengujian.

Ini mengurangi risiko halusinasi dan menghasilkan keluaran modular yang mudah ditinjau.

Temperatur, max_tokens, dan keamanan

- Untuk kode deterministik: atur

temperaturemendekati 0,0. - Untuk desain eksploratif:

temperaturedi 0,2–0,5 dapat memunculkan pendekatan kreatif. - Jaga

max_tokenscukup lapang untuk refactor besar atau rangkaian pengujian panjang.

Minta uji unit dan penjelasan

Saat meminta kode, mintalah juga uji unit dan penjelasan singkat tentang algoritme. Itu membantu Anda mendeteksi bug halus dan mendapatkan artefak yang dapat dijalankan pada percobaan pertama.

Inferensi Tugas Panjang dan Pelacakan Status

Model M2.5 memiliki mekanisme pelacakan status yang sangat baik, secara efektif memastikan kesinambungan dan arah pemikiran dalam urutan waktu yang panjang dengan fokus pada sejumlah tujuan terbatas setiap kali alih-alih memproses semuanya secara paralel. M2.5 dilengkapi dengan fungsi peka konteks, memungkinkan eksekusi tugas yang efisien dan manajemen konteks yang dioptimalkan.

Tips penggunaan M2.5 untuk produksi

MiniMax-M2.5 disetel untuk alat multi-langkah dan kode. Di bawah ini adalah tips praktis berbasis pengalaman untuk hasil terbaik di produksi.

Rekayasa prompt & pesan sistem

- Gunakan pesan sistem eksplisit untuk peran dan batasan. Untuk tugas kode, sertakan runtime/framework uji yang diperlukan (mis., “Kembalikan sebuah pytest yang kompatibel dengan Python 3.11”).

- Berikan konteks: untuk pekerjaan agenik atau multi-langkah, sertakan metadata langkah dan deskripsi alat sebagai JSON terstruktur atau daftar berpoin. M2.5 merespons dengan baik input terstruktur karena dioptimalkan untuk penggunaan alat.

Pemanggilan fungsi/alat

- Jika Anda menggunakan CometAPI sebagai gerbang untuk pemanggilan alat, pastikan field tambahan Anda (mis.,

function_callgaya OpenAI) sesuai dengan ekspektasi CometAPI/model. Konfirmasikan dukungan model di halaman model Comet karena semantik alat dapat bervariasi antar penyedia. - Untuk orkestrasi yang andal, pecah tugas besar menjadi panggilan yang lebih kecil dan pertahankan titik periksa deterministik. M2.5 kuat dalam mengikuti instruksi multi-langkah, tetapi Anda akan mendapatkan perilaku paling andal dengan memvalidasi setelah setiap langkah.

Temperatur, max_tokens, dan kontrol biaya

- Untuk pembuatan atau refactor kode, atur

temperaturerendah (0,0–0,2) dan gunakanmax_tokensyang disesuaikan dengan ukuran keluaran yang diharapkan. - Untuk prompt eksploratif, naikkan

temperaturenamun perhatikan penggunaan token yang meningkat. Saat merutekan melalui CometAPI, bandingkan harga penyedia dan aturan fallback — CometAPI mencantumkan harga token per instance model dalam katalog mereka.

Jendela konteks & dokumen panjang

- Varian M2.5 sering mendukung konteks panjang (periksa spesifikasi model untuk panjang konteks). Untuk dokumen yang sangat panjang, bagi dan ringkas — lalu masukkan ringkasan plus potongan relevan, alih-alih mengirim seluruh berkas dalam satu panggilan.

Keamanan, konten toksik, dan mitigasi halusinasi

- Gunakan pagar pembatas: pesan sistem, validator eksternal, dan rangkaian pengujian (mis., unit test untuk kode yang dihasilkan) mengurangi risiko.

- Validasi referensi eksternal: jika model mengutip fakta atau kode dari web, verifikasi secara terprogram sebelum dipercaya atau dikirim.

Jebakan umum dan cara menghindarinya

Jebakan: Terlalu mempercayai satu keluaran model

Mitigasi: Jalankan tes, pemeriksaan statis, dan untuk logika kritis, minta beberapa completion independen dan bandingkan. CometAPI memungkinkan beralih di antara beberapa model, dan Anda dapat beralih kapan saja menggunakan format chat OpenAI.

Jebakan: Menggunakan temperatur tinggi untuk kode produksi

Mitigasi: Pertahankan temperature rendah; jika Anda memerlukan alternatif kreatif, minta beberapa variasi bertemperatur rendah atau minta model menjelaskan perbedaannya.

Jebakan: Mengabaikan versi model

Mitigasi: Lacak nama model dan string penyedia dalam manifest deployment Anda. Saat beralih dari MiniMax-M2.5 ke MiniMax-M2.5-highspeed atau ke penyedia lain, perlakukan sebagai perubahan rilis dan jalankan tes regresi.

Rekomendasi akhir dan ekspektasi realistis

MiniMax-M2.5 adalah langkah maju yang patut dicatat untuk LLM yang berpusat pada kode dan agenik — ia menjanjikan pembuatan kode yang kuat, penalaran multi-giliran, dan perilaku aman saat menggunakan alat. Jika prioritas tim Anda adalah membangun alat pengembang yang andal, kerangka kerja agen, atau asisten kode, M2.5 layak dimasukkan dalam matriks perbandingan Anda. Menggunakan CometAPI sebagai gerbang terpadu dapat mempercepat eksperimen dan memungkinkan Anda mengganti penyedia atau melakukan A/B model tanpa mengubah seluruh integrasi Anda.

Beberapa poin praktis:

- Berprototipe dengan cepat menggunakan playground CometAPI, lalu kunci pengenal model di kode.

- Gunakan temperatur rendah, minta pengujian dan penjelasan, dan selalu jalankan validasi otomatis.

- Perlakukan model sebagai rekan pengembang yang kuat — bukan yang tak pernah salah: terapkan tinjauan manusia, pipeline CI, dan telemetri.

Pengembang dapat mengakses MInimax-M2.5 melalui CometAPI sekarang. Untuk memulai, jelajahi kapabilitas model di Playground dan lihat panduan API untuk instruksi terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga yang jauh lebih rendah daripada harga resmi untuk membantu integrasi Anda.

Siap mulai?→ Daftar untuk M2.5 hari ini !

Jika Anda ingin mengetahui lebih banyak tips, panduan, dan berita tentang AI, ikuti kami di VK, X dan Discord!