Apa itu API GPT-5.2

API GPT-5.2 sama dengan GPT-5.2 Thinking di ChatGPT. GPT-5.2 Thinking adalah varian tingkat menengah dari keluarga GPT-5.2 milik OpenAI yang dirancang untuk pekerjaan yang lebih mendalam: penalaran multi-langkah, peringkasan dokumen panjang, pembuatan kode berkualitas, dan pekerjaan pengetahuan profesional di mana akurasi dan struktur yang dapat digunakan lebih penting daripada throughput mentah. Di API, model ini diekspos sebagai gpt-5.2 (Responses API / Chat Completions), dan posisinya berada di antara varian Instant berlatensi rendah dan varian Pro yang berkualitas lebih tinggi namun lebih mahal.

Fitur utama

- Konteks sangat panjang & pemadatan: jendela efektif 400K dan alat pemadatan untuk mengelola relevansi di sepanjang percakapan dan dokumen yang panjang.

- Upaya penalaran yang dapat dikonfigurasikan:

none | medium | high | xhigh(xhigh mengaktifkan komputasi internal maksimum untuk penalaran yang sulit).xhightersedia pada varian Thinking/Pro. - Dukungan alat dan fungsi yang lebih kuat: pemanggilan alat kelas satu, tata bahasa (CFG/Lark) untuk membatasi keluaran terstruktur, dan perilaku agen yang ditingkatkan yang menyederhanakan otomatisasi multi-langkah yang kompleks.

- Pemahaman multimodal: pemahaman gambar + teks yang lebih kaya dan integrasi ke dalam tugas multi-langkah.

- Keamanan / penanganan konten sensitif yang ditingkatkan: intervensi terarah untuk mengurangi respons yang tidak diinginkan di area seperti melukai diri sendiri dan konteks sensitif lainnya.

Kapabilitas teknis & spesifikasi (perspektif pengembang)

- Endpoint API & ID model:

gpt-5.2untuk Thinking (Responses API),gpt-5.2-chat-latestuntuk alur kerja chat/instant, dangpt-5.2-prountuk tingkat Pro; tersedia melalui Responses API dan Chat Completions sebagaimana ditunjukkan. - Token penalaran & manajemen upaya: API mendukung parameter eksplisit untuk mengalokasikan komputasi (upaya penalaran) per permintaan; upaya yang lebih tinggi meningkatkan latensi dan biaya tetapi meningkatkan kualitas keluaran untuk tugas yang kompleks.

- Alat keluaran terstruktur: dukungan tata bahasa (Lark / CFG) untuk membatasi keluaran model ke DSL atau sintaks yang tepat (berguna untuk SQL, JSON, pembuatan DSL).

- Pemanggilan alat paralel & koordinasi agen: paralelisme yang ditingkatkan dan orkestrasi alat yang lebih rapi mengurangi kebutuhan akan prompt sistem yang rumit dan kerangka multi-agen.

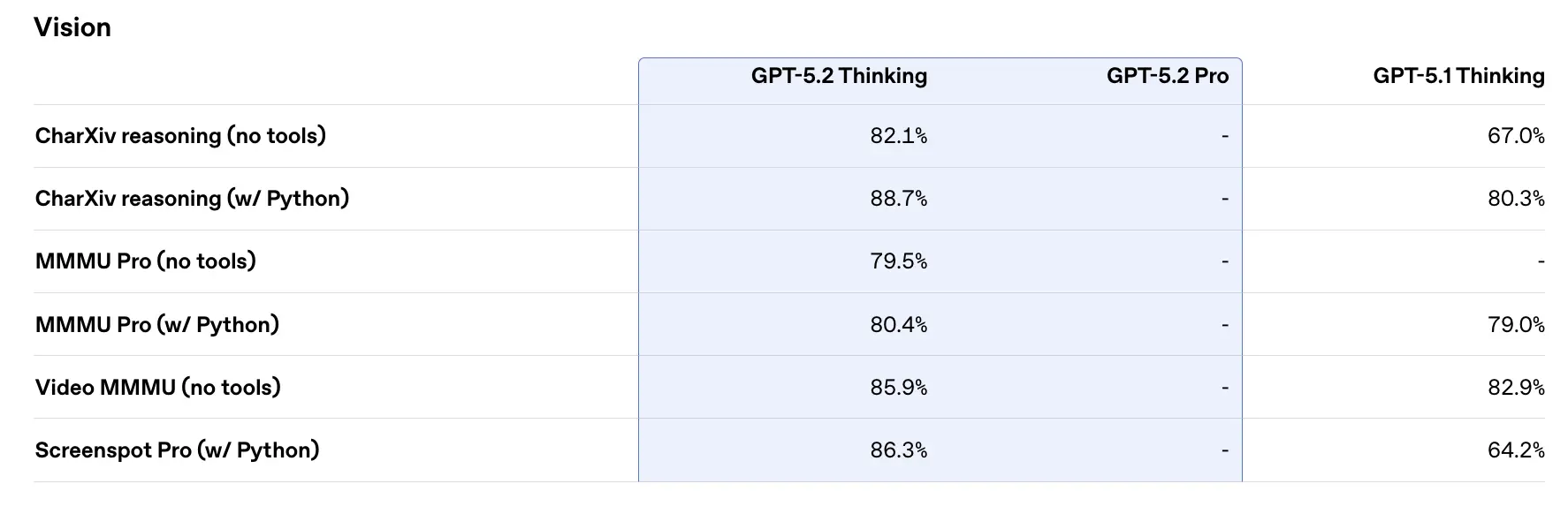

Kinerja benchmark & data pendukung

OpenAI memublikasikan berbagai hasil benchmark internal dan eksternal untuk GPT-5.2. Sorotan terpilih (angka yang dilaporkan oleh OpenAI):

- GDPval (44 profesi, pekerjaan berbasis pengetahuan) — GPT-5.2 Thinking “mengalahkan atau menyamai profesional industri papan atas pada 70.9% perbandingan”; OpenAI melaporkan keluaran dihasilkan pada >11× kecepatan dan <1% biaya dibandingkan profesional ahli pada tugas GDPval mereka (perkiraan kecepatan dan biaya berbasis historis). Tugas-tugas ini mencakup model spreadsheet, presentasi, dan video pendek.

- SWE-Bench Pro (coding) — GPT-5.2 Thinking mencapai ≈55.6% pada SWE-Bench Pro dan ~80% pada SWE-Bench Verified (hanya Python) menurut OpenAI, menetapkan state of the art baru untuk evaluasi pembuatan kode/rekayasa dalam pengujian mereka. Ini berarti debugging dan perbaikan end-to-end yang lebih andal dalam praktik, menurut contoh OpenAI.

- GPQA Diamond (tanya jawab sains tingkat pascasarjana) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% pada GPQA Diamond (tanpa alat, penalaran maksimum).

- Seri ARC-AGI — Pada ARC-AGI-2 (benchmark penalaran fluida yang lebih sulit), GPT-5.2 Thinking meraih 52.9% dan GPT-5.2 Pro 54.2% (OpenAI mengatakan ini adalah pencapaian state-of-the-art baru untuk model bergaya chain-of-thought).

- Konteks panjang (OpenAI MRCRv2) — GPT-5.2 Thinking menunjukkan akurasi mendekati 100% pada varian MRCR 4-needle hingga 256k token dan skor yang meningkat secara substansial dibanding GPT-5.1 di berbagai pengaturan konteks panjang. (OpenAI memublikasikan bagan dan tabel MRCRv2.)

Perbandingan dengan kontemporer

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro dipublikasikan dengan jendela konteks ~1,048,576 (≈1M) token dan masukan multimodal yang luas (teks, gambar, audio, video, PDF) serta integrasi agen yang kuat melalui Vertex AI / AI Studio. Di atas kertas, jendela konteks Gemini 3 yang lebih besar menjadi pembeda untuk beban kerja sesi tunggal yang sangat besar; komprominya mencakup cakupan tooling dan kecocokan ekosistem.

- vs Anthropic Claude Opus 4.5: Opus 4.5 dari Anthropic menekankan alur kerja coding/agen tingkat enterprise dan melaporkan hasil SWE-bench yang kuat serta ketangguhan untuk sesi agen yang panjang; Anthropic memosisikan Opus untuk otomasi dan pembuatan kode dengan jendela konteks 200k dan integrasi agen/Excel khusus. Opus 4.5 adalah pesaing kuat dalam otomasi enterprise dan tugas kode.

Inti praktis: GPT-5.2 menargetkan serangkaian peningkatan yang seimbang (konteks 400k, keluaran token tinggi, peningkatan penalaran/pembuatan kode). Gemini 3 menargetkan konteks sesi tunggal yang paling besar (≈1M), sementara Claude Opus berfokus pada rekayasa tingkat enterprise dan ketangguhan agen. Pilih dengan mencocokkan ukuran konteks, kebutuhan modalitas, kecocokan fitur/tooling, serta kompromi biaya/latensi.

Cara mengakses dan menggunakan API GPT-5.2

Langkah 1: Daftar untuk Kunci API

Masuk ke cometapi.com. Jika Anda belum menjadi pengguna kami, silakan daftar terlebih dahulu. Masuk ke konsol CometAPI. Dapatkan kunci API kredensial akses untuk antarmuka. Klik “Add Token” pada token API di pusat pribadi, dapatkan kunci token: sk-xxxxx dan kirimkan.

Langkah 2: Kirim permintaan ke API GPT-5.2

Pilih endpoint “gpt-5.2” untuk mengirim permintaan API dan atur request body. Metode permintaan dan request body diperoleh dari dokumen API di situs web kami. Situs kami juga menyediakan uji Apifox untuk kenyamanan Anda. Ganti <YOUR_API_KEY> dengan kunci CometAPI Anda yang sebenarnya dari akun Anda. Pengembang memanggil ini melalui Responses API / Chat endpoints.

Masukkan pertanyaan atau permintaan Anda ke dalam bidang content—ini yang akan direspons oleh model . Proses respons API untuk mendapatkan jawaban yang dihasilkan.

Langkah 3: Ambil dan verifikasi hasil

Proses respons API untuk mendapatkan jawaban yang dihasilkan. Setelah diproses, API merespons dengan status tugas dan data keluaran.

Lihat juga Gemini 3 Pro Preview API