Di dunia kecerdasan buatan yang berkembang pesat, peluncuran setiap model bahasa besar (LLM) baru lebih dari sekadar peningkatan versi numerik — ini menandakan kemajuan dalam penalaran, kemampuan pengkodean, dan kolaborasi manusia-mesin. Pada akhir September 2025, Zhipu AI (Z.ai) meluncurkan GLM-4.6, anggota terbaru dari keluarga Model Bahasa Umum. Berdasarkan arsitektur yang kuat dan fondasi penalaran yang kuat dari GLM-4.5, pembaruan ini menyempurnakan kemampuan model dalam penalaran agen, kecerdasan pengkodean, dan pemahaman konteks panjang, sambil tetap terbuka dan dapat diakses oleh pengembang dan perusahaan.

Apa itu GLM-4.6?

GLM-4.6 adalah rilis utama dalam seri GLM (General Language Model) yang dirancang untuk menyeimbangkan penalaran berkapasitas tinggi dengan alur kerja pengembang yang praktis. Secara garis besar, rilis ini menargetkan tiga kasus penggunaan yang saling terkait erat: (1) pembuatan kode tingkat lanjut dan penalaran tentang kode, (2) tugas konteks luas yang memerlukan pemahaman model di seluruh input yang sangat panjang, dan (3) alur kerja agen di mana model harus merencanakan, memanggil alat, dan mengorkestrasi proses multi-langkah. Model ini hadir dalam varian yang ditujukan untuk API cloud dan hub model komunitas, yang memungkinkan pola penerapan yang dihosting maupun yang dihosting sendiri.

Secara praktis, GLM-4.6 diposisikan sebagai perangkat lunak unggulan yang "mengutamakan pengembang": penyempurnaannya tidak hanya berfokus pada angka tolok ukur mentah, tetapi juga pada kemampuan yang secara signifikan mengubah cara pengembang membangun asisten, kopilot kode, dan agen berbasis dokumen atau pengetahuan. Nantikan rilis yang menekankan penyetelan instruksi untuk penggunaan alat, penyempurnaan yang lebih detail untuk kualitas dan penelusuran kesalahan kode, serta pilihan infrastruktur yang memungkinkan konteks yang sangat panjang tanpa penurunan kinerja linear.

Apa yang ingin dipecahkan oleh GLM-4.6?

- Kurangi hambatan dalam bekerja dengan basis kode yang panjang dan dokumen yang besar dengan mendukung jendela konteks efektif yang lebih panjang.

- Meningkatkan keandalan pembuatan dan penelusuran kesalahan kode, menghasilkan keluaran yang lebih idiomatis dan dapat diuji.

- Tingkatkan ketahanan perilaku agen — perencanaan, penggunaan alat, dan pelaksanaan tugas multi-langkah — melalui instruksi yang ditargetkan dan penyetelan gaya penguatan.

Dari GLM-4.5 ke GLM-4.6, apa yang berubah dalam praktik?

- Skala konteks: 128K lompat ke 200 ribu token Ini adalah perubahan UX/arsitektur terbesar bagi pengguna: dokumen panjang, seluruh basis kode, atau transkrip agen yang diperluas kini dapat diproses sebagai satu jendela konteks. Hal ini mengurangi kebutuhan akan chunking ad hoc atau loop pengambilan yang mahal untuk banyak alur kerja.

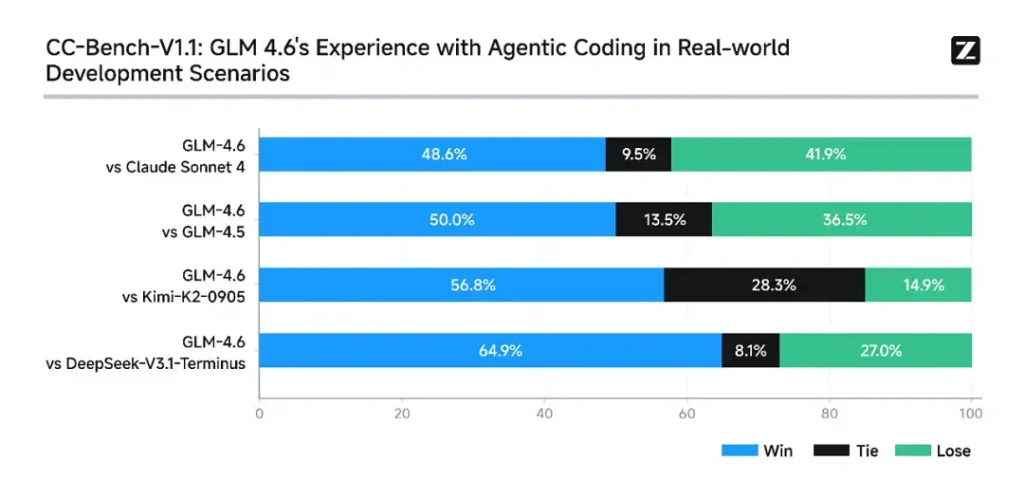

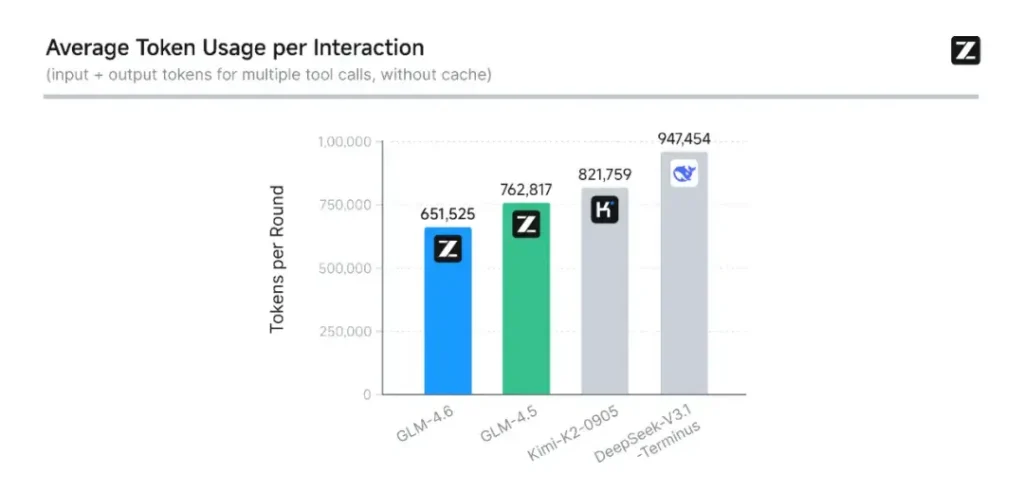

- Pengkodean dan evaluasi dunia nyata: Z.ai memperluas CC-Bench (benchmark pengkodean & penyelesaian mereka) dengan lintasan tugas yang lebih sulit dan nyata dan melaporkan bahwa GLM-4.6 menyelesaikan tugas dengan ~15% lebih sedikit token dibandingkan GLM-4.5 sekaligus meningkatkan tingkat keberhasilan dalam tugas rekayasa multi-turn yang kompleks. Hal ini menandakan efisiensi token yang lebih baik serta peningkatan kapabilitas secara nyata dalam skenario pengkodean terapan. Z.ai

- Integrasi agen dan alat: GLM-4.6 mencakup pola dukungan yang lebih baik untuk pemanggilan alat dan agen pencarian—penting untuk produk yang mengandalkan model tersebut untuk mengatur pencarian web, eksekusi kode, atau layanan mikro lainnya.

Apa saja fitur utama GLM-4.6?

1. Jendela Konteks Diperluas hingga 200K Token

Salah satu fitur GLM-4.6 yang paling menarik perhatian adalah jendela konteks yang diperluas secara besar-besaran. Berkembang dari 128K pada generasi sebelumnya menjadi 200 ribu tokenGLM-4.6 dapat memproses seluruh buku, kumpulan data multi-dokumen yang kompleks, atau berjam-jam dialog dalam satu sesi. Perluasan ini tidak hanya meningkatkan pemahaman tetapi juga memungkinkan penalaran yang konsisten atas masukan yang panjang — sebuah lompatan besar untuk peringkasan dokumen, analisis hukum, dan alur kerja rekayasa perangkat lunak.

2. Peningkatan Kecerdasan Pengkodean

Internal Zhipu AI CC-Bangku benchmark, serangkaian tugas pemrograman dunia nyata, menunjukkan bahwa GLM-4.6 mencapai peningkatan yang signifikan dalam akurasi dan efisiensi pengkodeanModel ini dapat menghasilkan kode yang benar secara sintaksis dan logis saat menggunakan sekitar 15% lebih sedikit token daripada GLM-4.5 untuk tugas yang setara. Efisiensi token ini berarti penyelesaian yang lebih cepat dan lebih murah tanpa mengorbankan kualitas — faktor penting untuk penerapan di perusahaan.

3. Penalaran Lanjutan dan Integrasi Alat

Selain pembuatan teks mentah, GLM-4.6 bersinar dalam penalaran yang ditingkatkan dengan alat. Telah dilatih dan diselaraskan untuk perencanaan multi-langkah dan untuk mengorkestrasi sistem eksternal — mulai dari basis data hingga alat pencarian hingga lingkungan eksekusi. Dalam praktiknya, ini berarti GLM-4.6 dapat bertindak sebagai "otak" dari sebuah agen AI otonom, memutuskan kapan memanggil API eksternal, cara menafsirkan hasil, dan cara menjaga kesinambungan tugas di seluruh sesi.

4. Penyelarasan Bahasa Alami yang Ditingkatkan

Melalui pembelajaran penguatan berkelanjutan dan pengoptimalan preferensi, GLM-4.6 memberikan alur percakapan yang lebih lancar, pencocokan gaya yang lebih baik, dan penyelarasan keamanan yang lebih kuatModel ini menyesuaikan nada dan strukturnya agar sesuai dengan konteks — baik itu dokumentasi formal, bimbingan belajar, maupun penulisan kreatif — sehingga meningkatkan kepercayaan dan keterbacaan pengguna.

Arsitektur apa yang mendukung GLM-4.6?

Apakah GLM-4.6 merupakan model Campuran Pakar?

Kontinuitas metode inferensi: Tim GLM menunjukkan bahwa GLM-4.5 dan GLM-4.6 memiliki alur inferensi fundamental yang sama, sehingga pengaturan penerapan yang ada dapat ditingkatkan dengan hambatan minimal. Hal ini mengurangi risiko operasional bagi tim yang sudah menggunakan GLM-4.x.—parameter penskalaan dan pilihan desain model yang menekankan spesialisasi untuk penalaran agensi, pengodean, dan inferensi yang efisien. Laporan GLM-4.5 memberikan deskripsi publik yang paling jelas tentang strategi MoE dan rejimen pelatihan keluarga (pra-pelatihan multi-tahap, iterasi model pakar, pembelajaran penguatan untuk penyelarasan); GLM-4.6 menerapkan pembelajaran tersebut sambil menyesuaikan panjang konteks dan kapabilitas spesifik tugas.

Catatan arsitektur praktis untuk insinyur

- Jejak parameter vs. komputasi yang diaktifkan: Total parameter yang besar (ratusan miliar) tidak secara langsung diterjemahkan menjadi biaya aktivasi yang setara pada setiap permintaan—MoE berarti hanya sebagian kecil pakar yang melakukan aktivasi per urutan token, sehingga memberikan keseimbangan biaya/throughput yang lebih menguntungkan untuk banyak beban kerja.

- Presisi dan format token: Bobot publik didistribusikan dalam format BF16 dan F32, dan kuantisasi komunitas (GGUF, 4-/8-/bit) muncul dengan cepat; ini memungkinkan tim untuk menjalankan GLM-4.6 pada berbagai profil perangkat keras.

- Kompatibilitas tumpukan inferensi: Z.ai mendokumentasikan vLLM dan runtime LLM modern lainnya sebagai backend inferensi yang kompatibel, yang membuat GLM-4.6 layak untuk penerapan cloud dan lokal.

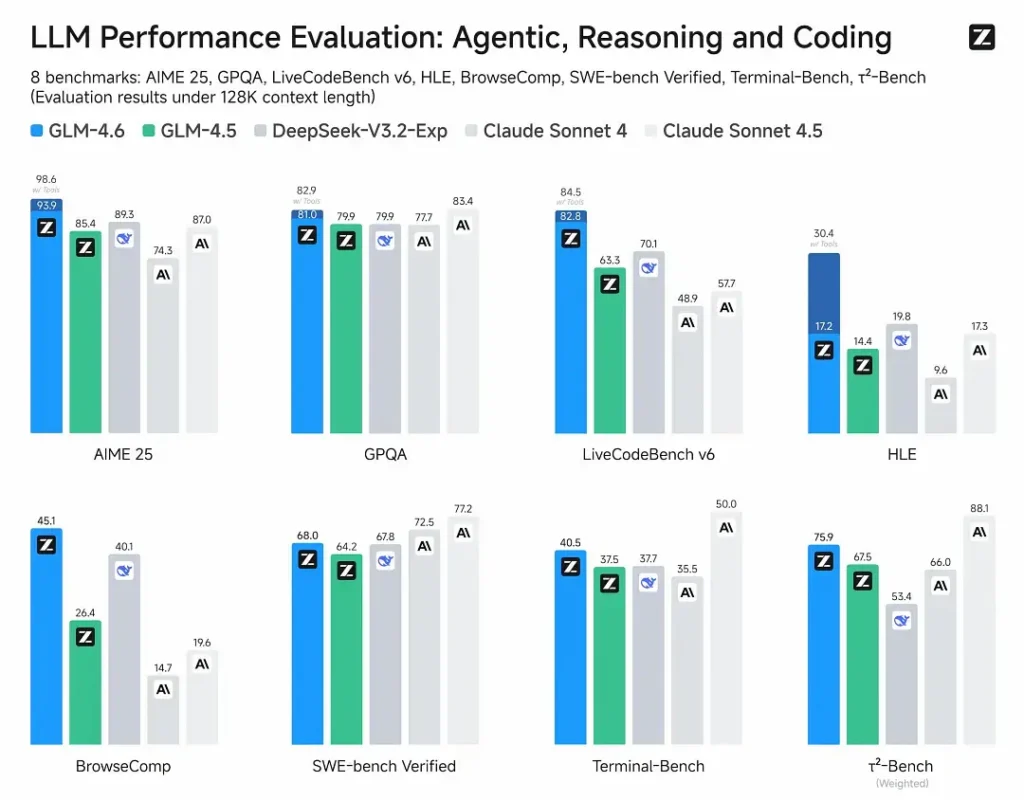

Kinerja acuan: bagaimana kinerja GLM-4.6?

Tolok ukur apa yang dilaporkan?

Z.ai mengevaluasi GLM-4.6 di seluruh rangkaian delapan tolok ukur publik mencakup tugas-tugas agensi, penalaran, dan pengodean. Mereka juga memperluas CC-Bench (benchmark pengodean tugas nyata yang dievaluasi manusia dan dijalankan di lingkungan yang terisolasi Docker) untuk mensimulasikan tugas-tugas rekayasa produksi (pengembangan front-end, pengujian, pemecahan masalah algoritmik) dengan lebih baik. Pada tugas-tugas ini, GLM-4.6 menunjukkan peningkatan yang konsisten dibandingkan GLM-4.5.

Kinerja pengkodean

- Tugas nyata menang: Dalam evaluasi manusia CC-Bench, GLM-4.6 mencapai mendekati paritas dengan Claude Sonnet 4 dari Anthropic dalam tugas multi-giliran yang saling berhadapan—Z.ai melaporkan 48.6% tingkat menang dalam evaluasi mereka yang terisolasi Docker dan dinilai manusia (interpretasi: hampir 50/50 dengan Claude Sonnet 4 pada set kurasi mereka). Pada saat yang sama, GLM-4.6 mengungguli sejumlah model terbuka domestik (misalnya, varian DeepSeek) dalam tugas mereka.

- Efisiensi token: Laporan Z.ai ~15% lebih sedikit token digunakan untuk menyelesaikan tugas dibandingkan dengan GLM-4.5 dalam lintasan CC-Bench—ini penting untuk latensi dan biaya.

Penalaran dan matematika

GLM-4.6 mengklaim kemampuan penalaran yang lebih baik dan kinerja penggunaan alat yang lebih baik dibandingkan GLM-4.5. Jika GLM-4.5 menekankan mode "berpikir" hibrida dan respons langsung, GLM-4.6 meningkatkan ketahanan untuk penalaran multi-langkah—terutama ketika diintegrasikan dengan alat pencarian atau eksekusi.

Pesan publik Z.ai memposisikan GLM-4.6 sebagai kompetitif dengan model-model internasional dan domestik terkemuka pada tolok ukur pilihan mereka—khususnya, kompetitif dengan Claude Sonnet 4 dan mengungguli beberapa alternatif domestik seperti varian DeepSeek dalam tugas kode/agen. Namun, dalam beberapa subtotal khusus pengkodean,** GLM-4.6 masih tertinggal dari Claude Sonnet 4.5 (rilis Antropik yang lebih baru), menjadikan lanskap persaingan yang ketat, alih-alih dominasi penuh.

Cara Mengakses GLM-4.6

- 1. Melalui Platform Z.ai: Pengembang dapat mengakses GLM-4.6 secara langsung melalui API Z.ai or **antarmuka obrolan (chat.z.ai)**Layanan yang dihosting ini memungkinkan eksperimen dan integrasi yang cepat tanpa penerapan lokal. API mendukung mode pelengkapan teks standar dan pemanggilan alat terstruktur — penting untuk alur kerja agen.

- 2. Bobot Terbuka pada Wajah Pelukan dan ModelScope: Bagi mereka yang lebih suka kontrol lokal, Zhipu AI telah merilis file model GLM-4.6 di Wajah Memeluk dan Lingkup Model, termasuk versi safetensor di BF16 dan F32 Presisi. Pengembang komunitas telah menghasilkan versi GGUF terkuantisasi, yang memungkinkan inferensi pada GPU kelas konsumen.

- 3. Kerangka Integrasi: GLM-4.6 terintegrasi dengan lancar dengan mesin inferensi utama seperti vLLM, SGLang, dan Penerapan LMD, sehingga mudah beradaptasi dengan tumpukan penyajian modern. Fleksibilitas ini memungkinkan perusahaan untuk memilih antara awan, tepi, dan penerapan di tempat tergantung pada persyaratan kepatuhan atau latensi.

CometAPI adalah platform API terpadu yang menggabungkan lebih dari 500 model AI dari penyedia terkemuka—seperti seri GPT OpenAI, Gemini Google, Claude Anthropic, Midjourney, Suno, dan lainnya—menjadi satu antarmuka yang ramah bagi pengembang. Dengan menawarkan autentikasi yang konsisten, pemformatan permintaan, dan penanganan respons, CometAPI secara drastis menyederhanakan integrasi kapabilitas AI ke dalam aplikasi Anda. Baik Anda sedang membangun chatbot, generator gambar, komposer musik, atau alur kerja analitik berbasis data, CometAPI memungkinkan Anda melakukan iterasi lebih cepat, mengendalikan biaya, dan tetap tidak bergantung pada vendor—semuanya sambil memanfaatkan terobosan terbaru di seluruh ekosistem AI.

Integrasi terbaru GLM-4.6 akan segera muncul di CometAPI, jadi nantikan terus! Sementara kami menyelesaikan unggahan Model GLM 4.6, jelajahi model kami yang lain di halaman Model atau cobalah di AI Playground.

Pengembang dapat mengakses API GLM‑4.5 melalui CometAPI, versi model terbaru selalu diperbarui dengan situs web resmi. Untuk memulai, jelajahi kemampuan model di tempat bermain dan konsultasikan Panduan API untuk petunjuk terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. API Komet menawarkan harga yang jauh lebih rendah dari harga resmi untuk membantu Anda berintegrasi.

Siap untuk berangkat?→ Daftar ke CometAPI hari ini !

Kesimpulan — Mengapa GLM-4.6 penting saat ini

GLM-4.6 merupakan tonggak penting dalam lini GLM karena menggabungkan peningkatan praktis bagi pengembang—jendela konteks yang lebih panjang, pengodean tertarget dan optimasi agen, serta peningkatan tolok ukur yang nyata—dengan keterbukaan dan fleksibilitas ekosistem yang diinginkan banyak organisasi. Bagi tim yang membangun asisten kode, agen dokumen format panjang, atau otomatisasi berbasis alat, GLM-4.6 layak dievaluasi sebagai kandidat terbaik.