GPT-5 di OpenAI è stato lanciato all'inizio di agosto 2025 ed è diventato rapidamente disponibile attraverso diversi canali di distribuzione. Uno dei modi più rapidi per i team di sperimentare GPT-5 senza dover cambiare SDK del fornitore è CometAPI, un gateway multi-modello che espone GPT-5 insieme a centinaia di altri modelli. Questo articolo fornisce una documentazione pratica per spiegare che cosa CometAPI offre, come per chiamare GPT-5 attraverso di esso, i compromessi da valutare e la governance pratica e i controlli dei costi da mettere in atto prima di spostare i flussi di lavoro critici su GPT-5.

Cos'è GPT-5 e cosa lo differenzia dai modelli precedenti?

GPT-5 è la prossima famiglia di modelli linguistici di punta di OpenAI, rilasciata all'inizio di agosto 2025. Si presenta come un sistema di ragionamento unificato e multimodale che combina componenti non di ragionamento veloci, una variante di "ragionamento" più approfondita (spesso definita "pensiero GPT-5") e un router che decide quale sottomodello utilizzare in base alla complessità e agli strumenti richiesti. L'effetto netto dichiarato da OpenAI: un ragionamento migliore, finestre di contesto più ampie e un supporto migliorato per attività di codifica e agentiche.

Architettura e capacità chiave

- Sistema multicomponente: GPT-5 è descritto come un sistema che indirizza le richieste a diversi sottomodelli interni (ragionamento rapido vs. ragionamento approfondito) a seconda delle esigenze; gli sviluppatori possono richiedere il modello di ragionamento tramite l'API per ottenere le massime prestazioni.

- Contesto ampio: La famiglia di modelli supporta contesti estremamente ampi (centinaia di migliaia di token), consentendo la gestione in un'unica passata di documenti lunghi, basi di codice o conversazioni multi-file.

- Famiglia multi-dimensione: OpenAI ha rilasciato GPT-5 in più dimensioni (normale

gpt-5,gpt-5-mini,gpt-5-nano) in modo che i team possano trovare un compromesso tra latenza, costi e capacità di ragionamento.

Cos'è CometAPI e offre effettivamente GPT-5?

Una definizione rapida

CometaAPI è una piattaforma di aggregazione API che pubblicizza l'accesso unificato a centinaia di modelli di intelligenza artificiale (famiglie GPT di OpenAI, Anthropic Claude, xAI Grok, modelli di immagine e altro ancora) tramite un'unica interfaccia REST compatibile con OpenAI. Ciò significa che gli sviluppatori possono cambiare fornitore di modelli modificando una stringa del nome del modello anziché riscrivere il codice di rete. Nelle sue pagine di prodotto, CometAPI elenca esplicitamente GPT-5 e varianti correlate (ad esempio, gpt-5, gpt-5-chat-latest, gpt-5-mini) come endpoint disponibili.

Perché i team utilizzano gateway come CometAPI

I servizi gateway come CometAPI sono interessanti perché consentono di:

- Modelli di scambio rapidamente senza modificare grandi quantità di codice di integrazione.

- Compara i prezzi e indirizzare determinate richieste verso varianti di modello più economiche o più veloci.

- Fatturazione e registrazione aggregate su più modelli e fornitori.

La documentazione di CometAPI fornisce un semplice percorso di migrazione e un client in stile OpenAI (quindi il tuo codice OpenAI o "compatibile con OpenAI" esistente spesso necessita solo di piccole modifiche).

In che modo CometAPI espone GPT-5 a livello di programmazione?

CometAPI presenta un API REST compatibile con OpenAI superficie: un URL di base, Authorization: Bearer <YOUR_KEY>e richiedere corpi simili agli endpoint di chat/completamento di OpenAI. Per GPT-5 la piattaforma documenta i nomi dei modelli come gpt-5, gpt-5-minie gpt-5-nano e gli endpoint menzionati includono POST https://api.cometapi.com/v1/chat/completions per chiamate in stile chat e /v1/responses per alcune varianti non chat. I dettagli di configurazione di esempio (URL di base, formato dell'intestazione e parametro del modello) sono pubblicati in Documentazione CometAPI e al guide di avvio rapido.

Tipico endpoint e modello di autenticazione

- URL di base:

https://api.cometapi.com/v1(o il documentato/v1/chat/completionsper chattare e/v1/responsesper alcune varianti non chat.). - Intestazione di autorizzazione:

Authorization: Bearer sk-xxxxxxxxxxxx(Problemi con CometAPIsk-token di stile nella dashboard). - Tipo di contenuto:

application/json. - Parametro del modello: set

modelagpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-minio altri, fare riferimento a pagina del modello.

Come posso iniziare a utilizzare CometAPI e richiedere GPT-5? (procedura dettagliata)

Di seguito è riportato un flusso di onboarding conciso e affidabile che puoi seguire fin da subito.

Passaggio 1: registrati e ottieni una chiave CometAPI

- Vai su cometapi.com e creare un account.

- Dalla tua dashboard vai a Token API or Centro personale → Aggiungi token. CometAPI emette un token in

sk-...formato. Conservalo in modo sicuro (non incorporare le chiavi nei repository pubblici).

Passaggio 2: scegliere la stringa modello

- Seleziona il nome del modello che corrisponde alle tue esigenze (ad esempio,

gpt-5,gpt-5-nano-2025-08-07). CometAPI pubblica spesso più alias per ogni modello, in modo da poter scegliere tra compromessi tra accuratezza e costi.

Fase 3: Fai la tua prima richiesta (curl)

Un minimo curl esempio che segue il modello compatibile con OpenAI:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Questa rispecchia la struttura dell'API di chat di OpenAI, ma punta all'URL di base di CometAPI e utilizza il tuo token Comet.

Passaggio 4: esempio Python (richieste)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

sostituire model con gpt-5-nano o l'alias esatto dei documenti CometAPI per varianti più piccole ed economiche.

Prezzo in CometAPI

Quali sono le migliori pratiche e le mitigazioni per l'uso in produzione?

Di seguito sono riportati modelli concreti per ridurre i rischi e migliorare l'affidabilità quando si utilizza un intermediario come CometAPI.

Inizia con un piccolo pilota ed esegui test affiancati

Esegui richieste identiche a OpenAI (se hai accesso diretto) e CometAPI per confrontare output, latenza e costi. In questo modo, vengono rilevate eventuali trasformazioni implicite, filtri di contenuto o mancate corrispondenze di alias del modello.

Strumento per l'osservabilità e il controllo qualità

Registrare prompt, token restituiti (offuscati per informazioni personali), latenze e codici di errore. Implementare test automatizzati per la velocità di deriva dei prompt e di allucinazione. Monitorare l'utilizzo degli alias dei modelli in modo che le migrazioni siano verificabili.

Conservare le chiavi e ruotarle regolarmente

Tratta i token CometAPI come qualsiasi segreto API: archiviali nei gestori dei segreti, ruotali periodicamente e definisci l'ambito dei token in base agli ambienti (dev/stage/prod).

Implementare la sicurezza a strati

Utilizza una combinazione di:

- Ingegneria rapida per ridurre le allucinazioni (vincoli espliciti, output strutturato).

- Controlli di post-elaborazione (verifica dei fatti, liste di blocco, controlli regex per PII).

- Umano nel ciclo per risultati ad alto rischio.

Si tratta di standard per le distribuzioni GPT-5 che gestiscono contenuti critici o legali.

Quali sono gli errori più comuni e come risolvere i problemi di accesso?

Insidia: "modello inesistente / nessun accesso". Alcuni sviluppatori segnalano che l'accesso al modello può essere limitato da passaggi di verifica del provider o dell'organizzazione quando si utilizzano API dirette del provider; restrizioni simili possono verificarsi quando gli aggregatori utilizzano modelli di provider proxy. Se visualizzi un messaggio di errore "modello inesistente" o di autorizzazione, controlla: (a) se la tua chiave CometAPI è valida e non scaduta, (b) se il nome del modello richiesto corrisponde esattamente all'elenco supportato da CometAPI e (c) se il provider sottostante richiede ulteriori passaggi di verifica o fatturazione. In caso di errori di accesso correlati alla verifica e anomalie di timeout/autorizzazione, preparati a fornire i dettagli al personale di contatto per la risoluzione (e-mail: support@cometapi.com).

Insidia: latenza o costi imprevisti. Le modalità di ragionamento elevato e i contesti di grandi dimensioni causano latenza e spesa di token. Utilizzo max_tokens, Ridurre temperature ove opportuno, e preferire mini varianti per carichi di lavoro ad alta produttività. Monitoraggio con registrazione e avvisi.

Nota di chiusura

CometAPI offre ai team un percorso rapido per sperimentare varianti GPT-5 centralizzando al contempo l'accesso al modello, ma l'utilizzo in produzione richiede la stessa disciplina che applicheresti a qualsiasi modello potente: chiavi sicure, un'attenta progettazione rapida, monitoraggio delle allucinazioni e revisione legale/delle policy per i carichi di lavoro sensibili. Inizia con un piccolo progetto pilota, utilizza le dashboard di CometAPI per misurare la spesa e la latenza dei token e passa a varianti con ragionamento più avanzato solo dopo aver convalidato l'accuratezza e la sicurezza per il tuo dominio.

Gli sviluppatori possono accedere GPT-5 , GPT-5 Nano e GPT-5 Mini tramite CometAPI (CometAPI consiglia /v1/responses), le ultime versioni dei modelli elencate sono quelle aggiornate alla data di pubblicazione dell'articolo. Per iniziare, esplora le capacità del modello in Parco giochi e consulta la guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.

Vedere anche Come utilizzare i nuovi parametri e strumenti di GPT-5

Domande frequenti

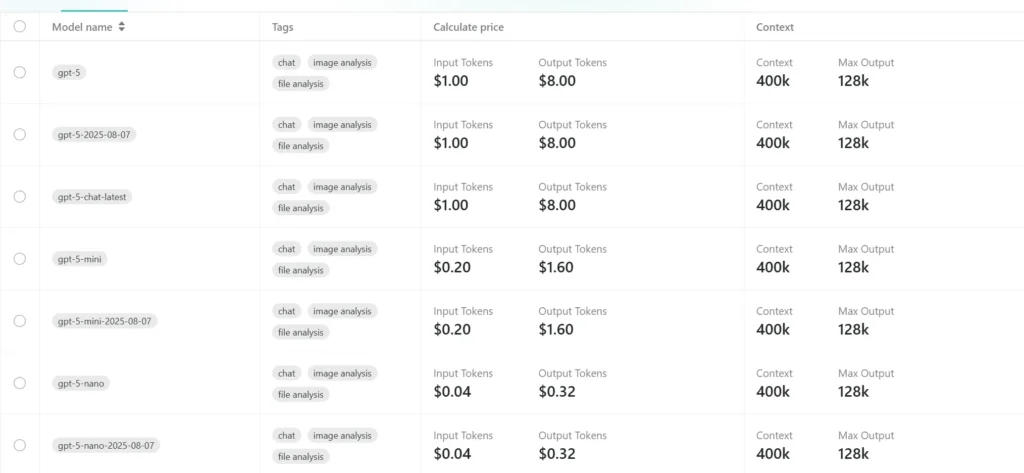

1. Quale variante del modello GPT-5 dovresti scegliere e quali sono i token/prezzi?

CometAPI elenca più varianti GPT-5 (predefinite gpt-5, istantanee di chat come gpt-5-chat-lateste versioni più piccole come gpt-5-mini/gpt-5-nano). Scegli in base alle tue esigenze:

gpt-5/gpt-5-chat-latest— piena capacità di chat di uso generale, ottima per qualità e ragionamento.gpt-5-mini/gpt-5-nano— costi e latenza inferiori per attività ad alto volume o a bassa criticità.

2. Come dovresti progettare le chiamate per contesti ampi e ragionamenti di alta qualità?

Contesto esteso: GPT-5 supporta finestre di contesto molto ampie. Quando si inviano documenti di grandi dimensioni, suddividere deliberatamente l'input in blocchi, utilizzare l'aumento del recupero (database vettoriale + windowing del contesto) e mantenere il numero massimo di token per gli output limitato per controllare i costi.

3. Quali misure di sicurezza, privacy e conformità dovresti applicare?

Igiene delle chiavi API. Conserva le chiavi nelle variabili d'ambiente, ruotale regolarmente e definisci l'ambito di applicazione quando possibile. Non inviare le chiavi ai repository. (Le migliori pratiche sono riportate nelle guide per gli sviluppatori.)

Residenza dei dati e privacy. Leggere l'informativa sulla privacy e i termini di CometAPI (e la politica di OpenAI) prima di inviare dati personali, sanitari o soggetti a regolamentazione tramite qualsiasi aggregatore di terze parti. Alcune aziende richiederanno contratti con fornitori diretti o istanze private.

Limiti di velocità e protezioni delle quote. Implementa interruttori automatici, backoff esponenziali e controlli delle quote in produzione per prevenire costi incontrollati e guasti a cascata. Le dashboard di CometAPI mostrano dati di utilizzo e quote: usale per imporre limiti programmatici.