Il braccio di ricerca di ByteDance Seme ha lanciato Seed3D 1.0, un modello di base 3D ad alta fedeltà a immagine singola che produce mesh pronte per la simulazione, materiali PBR e texture allineate, risorse progettate per essere integrate direttamente nei motori fisici e nei simulatori di robotica. La release mira a colmare un divario significativo: la generazione di contenuti scalabili (contenuti visivi diversificati) e la fedeltà fisica richiesta dall'intelligenza artificiale incorporata e dall'addestramento tramite simulatore.

Che cos'è ByteDance Seed3D 1.0?

Seed3D 1.0 è un modello di fondazione 3D creato per convertire una singola immagine RGB di un oggetto o di un ambiente in un pronto per la simulazione Bundle di asset 3D: in genere una mesh esplicita e impermeabile, mappe di texture mappate UV associate e parametri dei materiali di rendering basati sulla fisica (PBR). Il modello è progettato non solo per produrre geometrie e texture visivamente fedeli, ma anche per generare asset che richiedono una post-elaborazione minima prima di essere utilizzati in simulatori come Isaac Sim, Unity o Unreal Engine per la robotica, la formazione o la generazione di mondi virtuali.

Obiettivi chiave di progettazione di alto livello:

- Input di immagine singola: elimina la necessità di hardware di acquisizione o scansione multi-vista.

- Prontezza alla simulazione: assicurarsi che la topologia, la scala e i materiali PBR siano adatti alla simulazione fisica.

- Scalabilità della scena: consente di assemblare automaticamente gli oggetti generati in scene coerenti.

- Integrazione:: adattamento minimo ai comuni motori fisici e pipeline di runtime.

Quali funzionalità offre Seed3D 1.0?

Geometria ad alta fedeltà (maglie stagne)

Seed3D produce geometria chiusa e molteplice Progettato per una gestione accurata delle collisioni e una fisica dei contatti affidabile. Il componente geometrico utilizza un ibrido VAE + trasformatore di diffusione per produrre mesh che preservano il livello di dettaglio e mantengono dettagli strutturali fini come sporgenze sottili, fori e testo. La pipeline di estrazione della mesh utilizza una strategia a doppio cubo di marching/isosuperficie gerarchica per estrarre superfici di alta qualità in modo efficiente. ()

Texture fotorealistiche e materiali PBR

La pipeline delle texture produce mappe di albedo coerenti multi-vista e texture PBR complete (albedo, metallizzate, rugosità) e può produrre output di texture con risoluzione fino a 4K. Queste mappe sono progettate in modo che l'illuminazione si comporti in modo fisicamente plausibile nei motori di rendering. Un modulo di inpainting UV completa le regioni occluse e garantisce la coerenza spaziale nell'atlante UV.

Simulazione e preparazione della pipeline

Gli output sono esportabili nei formati comuni (OBJ/GLB). Le risorse generate sono intenzionalmente pronto per la simulazione: si integrano nei simulatori fisici in cui le mesh di collisione e i parametri di attrito/rigidità possono essere derivati o regolati automaticamente, consentendone l'uso immediato in robotica o motori di gioco. Seed3D illustra flussi di lavoro che inseriscono le risorse generate in Isaac Sim per esperimenti di manipolazione.

Generazione di scene e assemblaggio fattorizzato

Oltre ai singoli oggetti, Seed3D utilizza un approccio di generazione di scene fattorizzate in cui i modelli di linguaggio visivo deducono mappe di layout (posizioni, scale, orientamenti) e Seed3D sintetizza e posiziona gli oggetti di conseguenza, consentendo una composizione coerente della scena per interni e layout urbani.

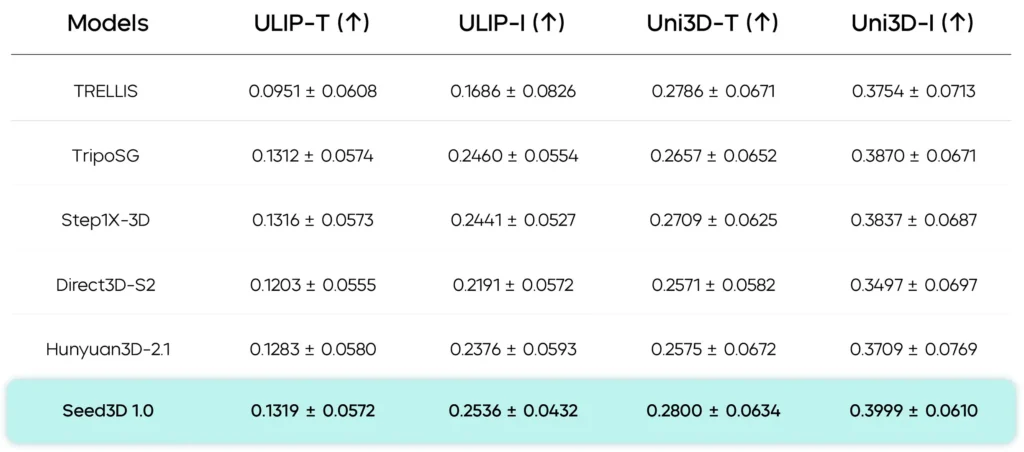

Risultato della valutazione delle prestazioni

Generazione della geometria

Nei benchmark geometrici, il modello geometrico da 1.5 miliardi di parametri di Seed3D 1.0 (Seed3D-DiT + VAE) raggiunge una migliore accuratezza strutturale e dettagli più fini rispetto a diverse basi di dati (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 e modelli di grandi dimensioni come Hunyuan3D-2.1). L'architettura di Seed3D, basata sulla diffusione nello spazio latente combinata con un'attenta decodifica SDF e l'estrazione gerarchica della mesh, produce mesh con meno artefatti e una migliore conservazione della geometria ad alta frequenza (testo, piccole sporgenze).

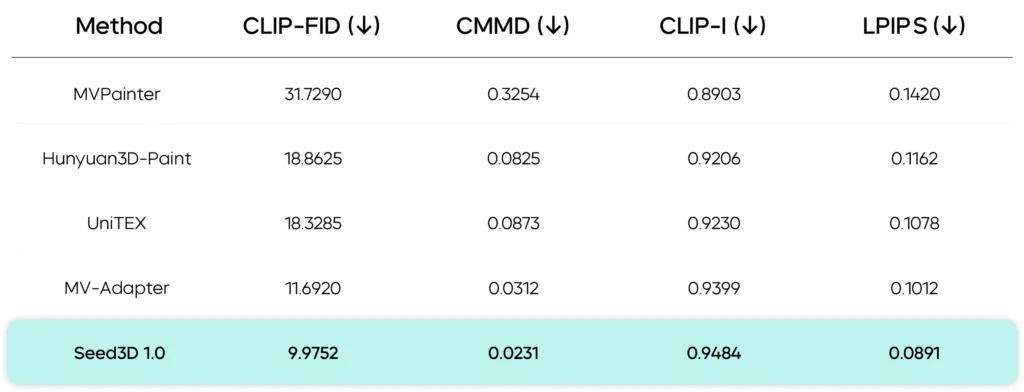

Generazione di texture

Per quanto riguarda le stime di texture e materiali, Seed3D segnala miglioramenti sostanziali nell'allineamento con le immagini di riferimento e nel realismo dei materiali. La decomposizione Seed3D-PBR e l'inpainting Seed3D-UV producono insieme atlanti UV che preservano i dettagli delle texture ad alta frequenza e forniscono mappe PBR coerenti (albedo, metallizzazione, rugosità) adatte al rendering fisico.

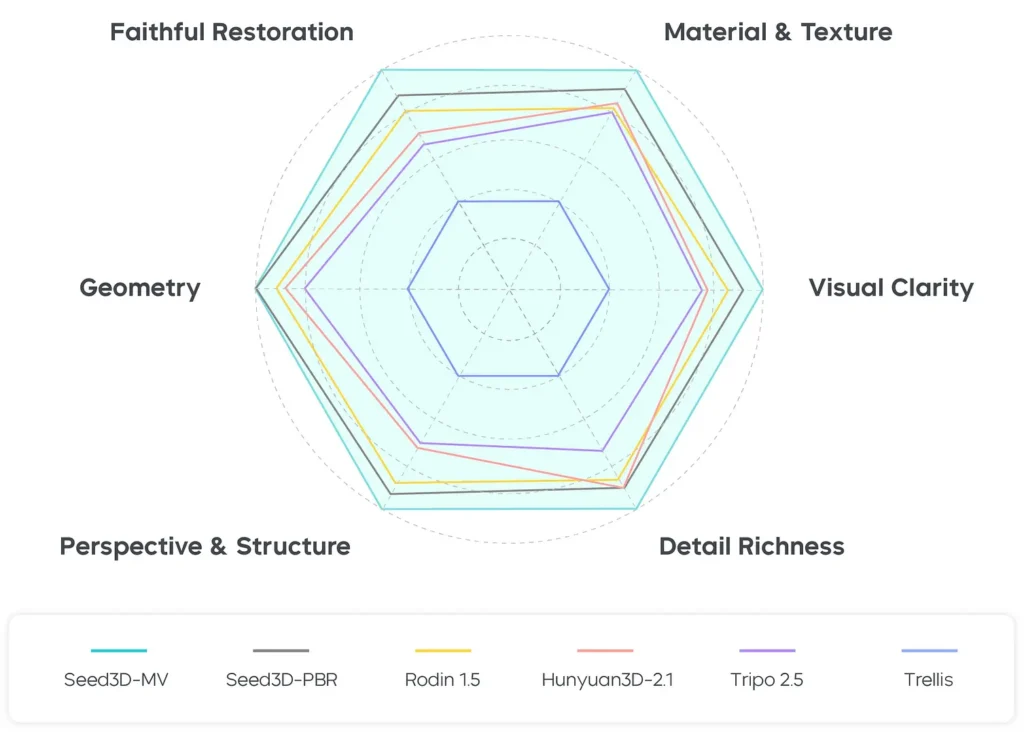

Valutazione umana (studio dell'utente)

L'articolo riporta uno studio condotto da 14 valutatori umani su un set di test di 43 immagini. I valutatori hanno confrontato diversi metodi su diverse dimensioni, tra cui chiarezza visiva, fedeltà al restauro, accuratezza geometrica, prospettiva e struttura, realismo di materiali e texture e ricchezza di dettagli. Seed3D 1.0 ha ricevuto valutazioni soggettive costantemente più elevate in queste categorie, con i vantaggi più evidenti nella geometria e nella qualità dei materiali. Lo studio umano corrobora i parametri quantitativi, dimostrando che il realismo percepito e l'idoneità della simulazione sono migliorati rispetto ai valori di riferimento.

Come funziona Seed3D 1.0 (architettura e pipeline)?

Seed3D 1.0 è concepito come un sistema multicomponente che combina rappresentazioni geometriche latenti apprese, denoising basato su trasformatori nello spazio latente e moduli di completamento multi-vista e texture. Il design è volutamente modulare, in modo che ogni componente possa essere ottimizzato e aggiornato in modo indipendente.

Componenti principali

Seed3D-VAE (codificatore/decodificatore di geometria latente): Apprende una rappresentazione latente compatta per la geometria 3D (ad esempio, latente TSDF/mesh). Il VAE è addestrato a ricostruire una geometria ad alta risoluzione e impermeabile a partire da codici latenti compressi. Ciò fornisce un efficiente collo di bottiglia per la fase di generazione.

Seed3D-DiT (trasformatore di diffusione per la geometria): Un trasformatore di flusso rettificato/denoising (simile a DiT) che opera nello spazio latente della geometria appresa. Condizionato su un'immagine di riferimento incorporata, denoise iterativamente i token latenti in una latente geometrica che il VAE decodifica in una mesh esplicita.

Seed3D-MV (sintesi multi-vista) e Seed3D-UV (completamento della texture): Dopo aver prodotto la geometria iniziale, il sistema sintetizza più viste per ridurre l'ambiguità dell'occlusione e quindi completa le mappe UV tramite un modulo di inpainting/miglioramento UV per produrre texture complete e coerenti.

Seed3D-PBR (decomposizione del materiale): Scompone le texture generate in mappe PBR (metallosità, rugosità, mappe normali, ecc.) in modo che le risposte di contatto e di ombreggiatura fisicamente plausibili vengano preservate nella simulazione.

Modello di linguaggio visivo per la fattorizzazione della scena: Per la generazione delle scene, la pipeline utilizza VLM per rilevare oggetti, prevedere relazioni spaziali e produrre mappe di layout (posizione, scala, orientamento). I singoli oggetti vengono generati e poi assemblati in una scena in base alla mappa di layout. ()

Flusso di inferenza di alto livello

- Input: singola immagine RGB → il codificatore dell'immagine estrae l'incorporamento visivo.

- Generazione della geometria: Seed3D-DiT condizionato sull'incorporamento denoises geometria latente → Seed3D-VAE decodifica la mesh (watertight).

- Sintesi multi-vista: genera viste sintetiche dalla mesh + pipeline di rendering per il completamento della texture.

- UV e texture: Seed3D-UV dipinge le occlusioni e produce mappe UV complete → Seed3D-PBR scompone le texture in mappe di materiali.

- Esportazione: produce file .obj/.gltf con texture e mappe dei materiali, pronti per i motori fisici (mesh di collisione, stima della scala tramite VLM).

Generazione di scene

Seed3D non genera solo singoli oggetti, ma genera automaticamente anche scene complete.

Processo di generazione:

- Input: un'immagine contenente più oggetti;

- Il modello VLM identifica gli oggetti e le relazioni spaziali nell'immagine;

- Seed3D genera la geometria e la texture per ogni oggetto;

- Infine, la disposizione spaziale viene combinata per formare una scena 3D completa.

Quali sono i limiti e le sfide aperte?

Seed3D 1.0 rappresenta un passo importante, ma permangono diverse limitazioni, sia intrinseche alla generazione di singole immagini, sia specifiche dei contesti di simulazione:

- Ambiguità a visione singola: dedurre la geometria occlusa e la topologia esatta da una vista è fondamentalmente mal posta; le statistiche a priori e apprese aiutano, ma permangono errori nelle regioni fortemente occluse.

- Correttezza fisica su larga scala: sebbene le risorse siano "pronte per la simulazione" secondo molti parametri pratici, la stima di massa/inerzia a grana fine e la dinamica dei giunti per sistemi articolati complessi richiedono ancora una messa a punto specifica del dominio.

- Materiali rari e microstruttura: i materiali altamente speculari, traslucidi o anisotropi (ad esempio metalli spazzolati, tessuti con dispersione subsuperficiale) sono più difficili da riprodurre accuratamente da una singola immagine.

- Distorsioni dei dati: le fonti dei dati di addestramento influenzano ciò che il modello cattura bene: oggetti non comuni o artefatti culturalmente specifici potrebbero essere riprodotti male.

- Proprietà intellettuale ed etica: come con tutti i sistemi generativi, i creatori e le organizzazioni devono considerare la proprietà intellettuale e la provenienza quando convertono immagini protette da copyright in risorse 3D.

Scenario applicativo

Seed3D è posizionato esplicitamente per intelligenza artificiale incarnata e simulazione casi d'uso, ma le implicazioni abbracciano più settori:

- Formazione robotica e RL: generazione rapida di contenuti per benchmark di manipolazione, programmi di formazione e set di dati randomizzati per dominio per il trasferimento dalla simulazione alla realtà. La compatibilità fisica delle risorse riduce l'attrito di pre-elaborazione.

- Sviluppo di giochi e XR: creazione accelerata di risorse per prototipi, oggetti di scena o scene intere; i flussi di lavoro PBR e le texture 4K sono particolarmente utili per esperienze ad alta fedeltà.

- Produzione e visualizzazione virtuale: generazione rapida di oggetti di scena ed elementi ambientali per la concettualizzazione o la previsualizzazione.

- Pipeline di creazione di contenuti: i progettisti possono passare da riferimenti 2D (foto, opere d'arte) a prototipi 3D molto più velocemente, consentendo flussi di lavoro ibridi uomo+intelligenza artificiale in cui gli artisti perfezionano i risultati. ()

- Ricerca: generazione su larga scala di dati di addestramento 3D eterogenei per modelli di visione-linguaggio-azione e altre ricerche multimodali. L'articolo inquadra esplicitamente Seed3D come uno strumento per far progredire la ricerca su scala mondiale e sull'intelligenza incarnata.

Seed3D è in grado di convertire una singola foto in un oggetto 3D dettagliato, adatto alla simulazione e all'uso interattivo, ampliando l'accesso alla creazione di contenuti 3D di alta qualità.

Conclusione

Seed3D 1.0 di ByteDance rappresenta un passo significativo verso generazione 3D scalabile di livello di simulazione a partire da semplici input 2D. Combinando una pipeline geometrica mirata (VAE + DiT), una solida stima di texture/PBR e il completamento UV, il sistema produce risorse fotorealistiche e immediatamente utili nei simulatori fisici, una combinazione che risolve un persistente collo di bottiglia per la ricerca sull'intelligenza artificiale incorporata e per molte pipeline applicate. Le prestazioni SOTA (geometria e texture) dichiarate dal modello e i risultati positivi della valutazione umana lo rendono un valido candidato nel panorama generativo 3D in rapida evoluzione.

Iniziamo

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di intelligenza artificiale (IA) di provider leader, come la serie GPT di OpenAI, Gemini di Google, Claude di Anthropic, Midjourney, Suno e altri, in un'unica interfaccia intuitiva per gli sviluppatori. Offrendo autenticazione, formattazione delle richieste e gestione delle risposte coerenti, CometAPI semplifica notevolmente l'integrazione delle funzionalità di IA nelle tue applicazioni. Che tu stia sviluppando chatbot, generatori di immagini, compositori musicali o pipeline di analisi basate sui dati, CometAPI ti consente di iterare più velocemente, controllare i costi e rimanere indipendente dal fornitore, il tutto sfruttando le più recenti innovazioni nell'ecosistema dell'IA.

Gli sviluppatori possono accedere al modello 3D e ad altri modelli di ByteDance come API Seedream 4.0 tramite CometAPI, l'ultima versione del modello è sempre aggiornato con il sito ufficiale. Per iniziare, esplora le capacità del modello nel Parco giochi e consultare il Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.

Pronti a partire? → Iscriviti oggi a CometAPI !

Se vuoi conoscere altri suggerimenti, guide e novità sull'IA seguici su VK, X e al Discordia!