Alla fine di agosto 2025 Google (DeepMind) ha rilasciato Immagine Flash Gemini 2.5 — ampiamente soprannominato “nano-banana” — un modello di generazione e modifica di immagini a bassa latenza e alta qualità, integrato nell'app Gemini, in Google AI Studio, nell'API Gemini e in CometAPI. È progettato per produrre immagini fotorealistiche, preservare la coerenza dei caratteri durante le modifiche, fondere più immagini di input ed eseguire modifiche localizzate e precise tramite prompt in linguaggio naturale. Il modello è disponibile in anteprima/prima GA e si trova già in cima alle classifiche delle immagini (LMArena), pur essendo dotato di meccanismi di sicurezza (filigrana SynthID e filtri a livello di prodotto).

Cos'è Gemini 2.5 Flash Image (noto anche come "Nano Banana")?

Gemini 2.5 Flash Image — soprannominato scherzosamente Banana nano — è l'ultimo modello di generazione e modifica delle immagini di Google DeepMind nella famiglia Gemini. Annunciato a fine agosto 2025, il modello si presenta come una versione di anteprima che offre modifiche ad alta fedeltà, fusione di più immagini, migliore coerenza dei caratteri (mantenendo la stessa persona/animale/oggetto riconoscibile in più modifiche) e generazione di immagini a bassa latenza nel set di strumenti multimodali di Gemini. È disponibile tramite l'API Gemini, Google AI Studio, le app mobile/web Gemini e Vertex AI per i clienti aziendali.

Origine e denominazione

Il soprannome "nano banana" è diventato virale sui feed social e nelle classifiche della community dopo che i primi tester e i partecipanti alla LMArena hanno utilizzato un'etichetta a tema frutta; Google ha confermato la connessione e ha adottato pubblicamente il nome giocoso nei suoi post per sviluppatori e prodotti. Il nome ufficiale del prodotto è Immagine Flash Gemini 2.5 e in genere vedrai l'identificatore del modello utilizzato nel codice e nelle chiamate API (per l'utilizzo in anteprima appare come ad esempio gemini-2.5-flash-image-preview).

Quali sono le caratteristiche principali di Gemini 2.5 Flash Image?

Cosa significa realmente “coerenza del carattere”?

Una delle capacità principali è coerenza del carattere: è possibile chiedere al modello di riutilizzare lo stesso soggetto (una persona, un animale domestico, una mascotte o un prodotto) in più modifiche o nuove scene, preservandone le caratteristiche visive identificative (volto/forma, tavolozza dei colori, segni distintivi). Questo risolve una debolezza comune nei modelli di immagini precedenti, in cui modifiche successive producevano persone/oggetti visivamente plausibili ma notevolmente diversi. Gli sviluppatori possono quindi creare flussi di lavoro per cataloghi di prodotti, narrazioni episodiche o generazione di risorse di marca con meno correzioni manuali.

Quali altri controlli di modifica sono inclusi?

Gemini 2.5 Flash Image supporta:

- Modifiche locali mirate tramite prompt in linguaggio semplice (rimuovi un oggetto, cambia vestito, ritocca la pelle, rimuovi un elemento di sfondo).

- Fusione multi-immagine: combina fino a tre immagini di input in un'unica composizione coerente (ad esempio, inserisci un prodotto dall'immagine A nella scena B preservando l'illuminazione).

- Controlli di stile e formato: istruzioni fotorealistiche, attributi della fotocamera e dell'obiettivo, proporzioni e output stilizzati (illustrazione, adesivo, ecc.).

- Conoscenza del mondo nativo: il modello sfrutta la conoscenza più ampia della famiglia Gemini per apportare modifiche semanticamente consapevoli (ad esempio, comprendere cosa implicano "illuminazione rinascimentale" o "attraversamento pedonale di Tokyo").

E per quanto riguarda velocità, costi e disponibilità?

Gemini 2.5 Flash Image fa parte del livello Flash di Gemini 2.5, ottimizzato per bassa latenza e costi contenuti, mantenendo al contempo un'elevata qualità. Google ha presentato in anteprima i prezzi per i token di output delle immagini e ne ha fornito la disponibilità tramite API e AI Studio; i clienti aziendali possono accedervi tramite Vertex AI. Al momento dell'annuncio, il prezzo pubblicato per il livello Gemini 2.5 Flash Image era $30 per 1 milione di token in uscita, con un esempio di costo per immagine riportato come 1290 token di output ≈ $0.039 per immagine.

Come funziona Gemini 2.5 Flash Image?

Architettura e approccio formativo

Gemini 2.5 Flash Image eredita l'architettura della famiglia Gemini 2.5: un backbone in stile "mixed-of-experts" (MoE) con addestramento multimodale che combina testo, immagini, audio e altri dati. Google ha addestrato Flash Image su corpora multimodali filtrati molto ampi e ha perfezionato il modello per le attività relative alle immagini (generazione, modifica, fusione) e per il comportamento di sicurezza. L'addestramento è stato eseguito sul fabric TPU di Google e valutato con metriche di valutazione sia automatiche che umane.

Editing basato sulla conversazione

Ad alto livello, il modello utilizza il condizionamento contestuale: quando si fornisce un'immagine (o più immagini) insieme a prompt di testo, il modello codifica l'identità visiva del soggetto nella sua rappresentazione interna. Durante le modifiche successive o l'inserimento di nuove scene, condiziona la generazione su quella rappresentazione in modo che gli attributi visivi desiderati (geometria del viso, identificatori chiave di abbigliamento o prodotto, palette di colori) vengano preservati. In pratica, questo viene implementato come parte della pipeline di contenuti multimodale esposta dall'API Gemini: si inviano le immagini di riferimento insieme alle istruzioni di modifica e il modello restituisce output di immagini modificate (o più immagini candidate) in un'unica risposta.

Filigrana e provenienza

Google integra filtri di sicurezza e di policy sui contenuti in Gemini 2.5 Flash Image. La release enfatizza la valutazione e il red-teaming, le fasi di filtraggio automatizzate, la messa a punto supervisionata e l'apprendimento per rinforzo per il follow-up delle istruzioni, riducendo al minimo gli output dannosi. Gli output includono una filigrana invisibile SynthID, in modo che le immagini prodotte o modificate dal modello possano essere successivamente identificate come generate dall'intelligenza artificiale.

Quanto è efficace? (dati di riferimento)

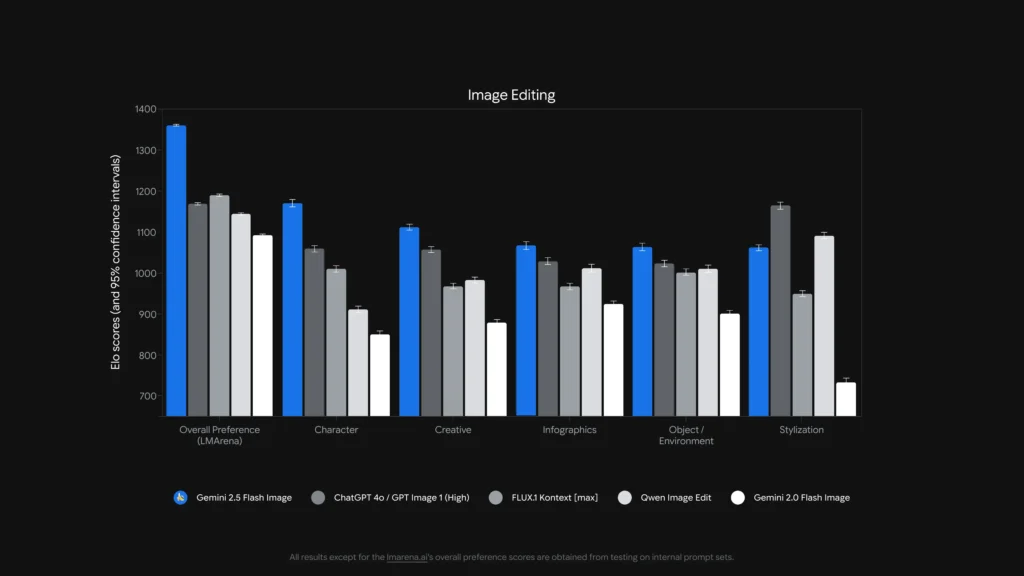

Gemini 2.5 Flash Image (commercializzato come “nano-banana” in alcuni contesti di benchmarking) ha raggiunto #1 nelle classifiche di LMArena per la modifica delle immagini e la conversione da testo a immagine A fine agosto 2025, con ampi vantaggi in termini di Elo/preferenza rispetto ai concorrenti nei confronti riportati. Faccio riferimento ai risultati delle valutazioni umane di LMArena e GenAI-Bench che mostrano punteggi di preferenza elevati sia per le attività di conversione da testo a immagine che per quelle di editing di immagini.

Confronto testo-immagine

| Benchmark di capacità | Immagine Gemini Flash 2.5 | Immagine 4 Ultra 06-06 | ChatGPT 4o / Immagine GPT 1 (Alta) | FLUX.1 Kontext | Immagine Gemini Flash 2.0 |

|---|---|---|---|---|---|

| Preferenza complessiva (LMArena) | 1147 | 1135 | 1129 | 1075 | 988 |

| Qualità visiva (GenAI-Bench) | 1103 | 1094 | 1013 | 864 | 926 |

| Allineamento testo-immagine (GenAI-Bench) | 1042 | 1053 | 1046 | 937 | 922 |

Modifica immagini

| Benchmark di capacità | Immagine Gemini Flash 2.5 | ChatGPT 4o / Immagine GPT 1 (Alta) | FLUX.1 Kontext | Modifica immagine Qwen | Immagine Gemini Flash 2.0 |

|---|---|---|---|---|---|

| Preferenza complessiva (LMArena) | 1362 | 1170 | 1191 | 1145 | 1093 |

| Carattere | 1170 | 1059 | 1010 | 911 | 850 |

| Creatività | 1112 | 1057 | 968 | 983 | 879 |

| Infografica | 1067 | 1029 | 967 | 1012 | 925 |

| Oggetto / Ambiente | 1064 | 1023 | 1002 | 1010 | 901 |

| Ricontestualizzazione del prodotto | 1128 | 1032 | 943 | 1009 | 888 |

| Stilizzazione | 1062 | 1165 | 949 | 1091 | 733 |

Cosa significano in pratica questi parametri di riferimento?

I benchmark ci dicono due cose: (1) il modello è competitivo nella generazione fotorealistica e (2) si distingue in montaggio Compiti in cui la coerenza dei caratteri e l'aderenza alle istruzioni sono importanti. Le classifiche delle preferenze umane indicano che gli utenti che visualizzano gli output hanno valutato positivamente gli output di Gemini per il realismo e l'allineamento con le istruzioni in molti prompt valutati. Tuttavia, sono esplicite le limitazioni note (rischio di allucinazioni su dettagli fattuali fini, rendering di testo lungo all'interno delle immagini, casi limite di trasferimento di stile), quindi i benchmark sono una guida, non una garanzia.

Cosa puoi fare con Gemini 2.5 Flash Image (casi d'uso)?

Gemini 2.5 Flash Image è specificamente progettato per scenari creativi, di produttività e di imaging applicato. I casi d'uso tipici ed emergenti includono:

Mockup rapidi di prodotti ed e-commerce

Trascina le foto dei prodotti nelle scene, genera immagini di catalogo coerenti in tutti gli ambienti o scambia colori/tessuti in una linea di prodotti, il tutto preservando l'identità del prodotto. Le funzionalità di fusione multi-immagine e la coerenza tra carattere e prodotto lo rendono interessante per i flussi di lavoro dei cataloghi.

Ritocco fotografico e modifiche mirate

Rimuovi oggetti, correggi imperfezioni, cambia abiti/accessori o modifica l'illuminazione con istruzioni in linguaggio naturale. La funzionalità di modifica localizzata consente anche ai non esperti di eseguire ritocchi in stile professionale utilizzando comandi interattivi.

Storyboard e narrazione visiva

Posiziona lo stesso personaggio in scene diverse e mantienine l'aspetto coerente (utile per fumetti, storyboard o pitch deck). Le modifiche iterative consentono ai creatori di perfezionare l'atmosfera, l'inquadratura e la continuità narrativa senza dover ricostruire le risorse da zero.

Formazione, diagrammi e prototipazione del design

Grazie alla sua capacità di combinare testo e immagini e alla sua "conoscenza del mondo", il modello può aiutare a generare diagrammi annotati, elementi visivi didattici o bozzetti rapidi per presentazioni. Google evidenzia persino i modelli in AI Studio per casi d'uso come bozzetti immobiliari e progettazione di prodotti.

Come si usa l'API Nano Banana?

Di seguito sono riportati alcuni frammenti pratici adattati da Documentazione API CometAPI e la documentazione API di Google. Illustrano i flussi comuni: da testo a immagine e al immagine + testo in immagine (modifica) utilizzando l'SDK GenAI ufficiale o l'endpoint REST.

Nota: nella documentazione di CometAPI il nome del modello di anteprima appare come

gemini-2.5-flash-image-previewGli esempi seguenti riprendono gli esempi ufficiali dell'SDK (Python e JavaScript) e un esempio REST curl; adatta le chiavi e i percorsi dei file al tuo ambiente.

Esempio di REST curl da CometAPI

Usa l'ufficiale di Gemini generateContent endpoint per la generazione di testo in immagine. Posizionare il prompt di testo in contents.parts[].text.Esempio (shell di Windows, utilizzando ^ per la continuazione della riga):

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ "contents": [{

"parts": [

{"text": "A photorealistic macro shot of a nano-banana on a silver fork, shallow depth of field"}

]

}]

}'}"

| grep -o '"data": "*"' \

| cut -d'"' -f4 \

| base64 --decode > gemini-generated.png

La risposta contiene byte di immagine base64; la pipeline sopra estrae il "data" stringa e la decodifica in gemini-generated.png.

Questo endpoint supporta la generazione "immagine-immagine": carica un'immagine di input (come Base64) e ricevi una nuova immagine modificata (anch'essa in formato Base64).Esempio:

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ \"contents\": } ], \"generationConfig\": { \"responseModalities\": }}"

**Descrizione:**Per prima cosa, converti il file immagine sorgente in una stringa Base64 e inseriscilo in inline_data.dataNon includere prefissi come data:image/jpeg;base64,L'uscita si trova anche in candidates.content.parts e include: Una parte di testo facoltativa (descrizione o prompt). La parte dell'immagine come inline_data (dove data è il Base64 dell'immagine di output). Per più immagini, è possibile aggiungerle direttamente, ad esempio:

{

"inline_data": {

"mime_type": "image/jpeg",

"data": "iVBORw0KGgo...",

"data": "iVBORw0KGgo..."

}

}

Di seguito sono riportati alcuni esempi per sviluppatori, adattati dalla documentazione ufficiale e dal blog di Google. Sostituisci credenziali e percorsi dei file con i tuoi.

Python (stile SDK ufficiale)

from google import genai

from PIL import Image

from io import BytesIO

client = genai.Client()

prompt = "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme"

# Text-to-Image

response = client.models.generate_content(

model="gemini-2.5-flash-image-preview",

contents=,

)

for part in response.candidates.content.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = Image.open(BytesIO(part.inline_data.data))

image.save("generated_image.png")

Questo è lo snippet Python canonico dalla documentazione di Google (ID del modello di anteprima mostrato). Lo stesso modello di chiamata SDK supporta la modifica di immagini + prompt (passare un'immagine come una delle contents).Per maggiori dettagli fare riferimento a dottore gemelli.

Conclusione

Se il tuo prodotto necessita di una generazione di immagini robusta e a bassa latenza e, soprattutto, editing affidabile con coerenza del soggettoGemini 2.5 Flash Image è ora un'opzione di livello produttivo che vale la pena valutare: combina una qualità delle immagini all'avanguardia con API progettate per l'integrazione con gli sviluppatori (AI Studio, Gemini API e Vertex AI). Valutate attentamente le attuali limitazioni del modello (testo fine nelle immagini, alcuni casi limite di stilizzazione) e implementate misure di sicurezza per un utilizzo responsabile.

Iniziamo

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di intelligenza artificiale (IA) di provider leader, come la serie GPT di OpenAI, Gemini di Google, Claude di Anthropic, Midjourney, Suno e altri, in un'unica interfaccia intuitiva per gli sviluppatori. Offrendo autenticazione, formattazione delle richieste e gestione delle risposte coerenti, CometAPI semplifica notevolmente l'integrazione delle funzionalità di IA nelle tue applicazioni. Che tu stia sviluppando chatbot, generatori di immagini, compositori musicali o pipeline di analisi basate sui dati, CometAPI ti consente di iterare più velocemente, controllare i costi e rimanere indipendente dal fornitore, il tutto sfruttando le più recenti innovazioni nell'ecosistema dell'IA.

Gli sviluppatori possono accedere Immagine Flash Gemini 2.5(Elenco Nano Banana CometAPI gemini-2.5-flash-image-preview/gemini-2.5-flash-image voci di stile nel loro catalogo.) tramite CometAPI, le ultime versioni dei modelli elencate sono quelle aggiornate alla data di pubblicazione dell'articolo. Per iniziare, esplora le capacità del modello in Parco giochi e consultare il Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.