Il Gemini 3.1 Pro è ora disponibile su CometAPI, e puoi iniziare a utilizzarlo tramite i servizi di CometAPI— a un prezzo di lancio più conveniente rispetto al prezzo ufficiale. CometAPI espone già la famiglia Gemini 3 e fornisce un percorso compatibile con OpenAI per chiamare quei modelli da un singolo gateway unificato; questo rende rapido sperimentare con i modelli Gemini usando gli SDK OpenAI esistenti

Che cos’è Gemini 3.1 Pro? (Perché è importante?)

Gemini 3.1 Pro si riferisce a una point-release / iterazione di anteprima nella famiglia Gemini-3 — la stessa famiglia di modelli di punta di Google che alimenta Gemini 3 Pro e le varianti “Flash” correlate. Le build Gemini 3.x si concentrano su un ragionamento multimodale più profondo (testo + immagini + video), finestre di token/contesto più ampie, generazione di codice migliorata (“vibe coding” e flussi di lavoro degli agenti) e incrementi di prestazioni/efficienza rispetto alla versione iniziale di Gemini 3 Pro. La famiglia Gemini 3 è ora ampiamente disponibile nelle API e nelle offerte cloud di Google.

Principali caratteristiche tecniche (cosa offre il modello)

- Input multimodali: testo + immagini + (in alcune varianti) video/audio.

- Finestre di contesto molto lunghe (interazioni a livello di documenti e codice fino a ~1M di token nelle varianti supportate).

- Strumenti agentici e miglioramenti alla programmazione — progettati per agenti autonomi, integrazioni con IDE e attività di codice complesse.

Benchmark di Gemini 3.1 Pro

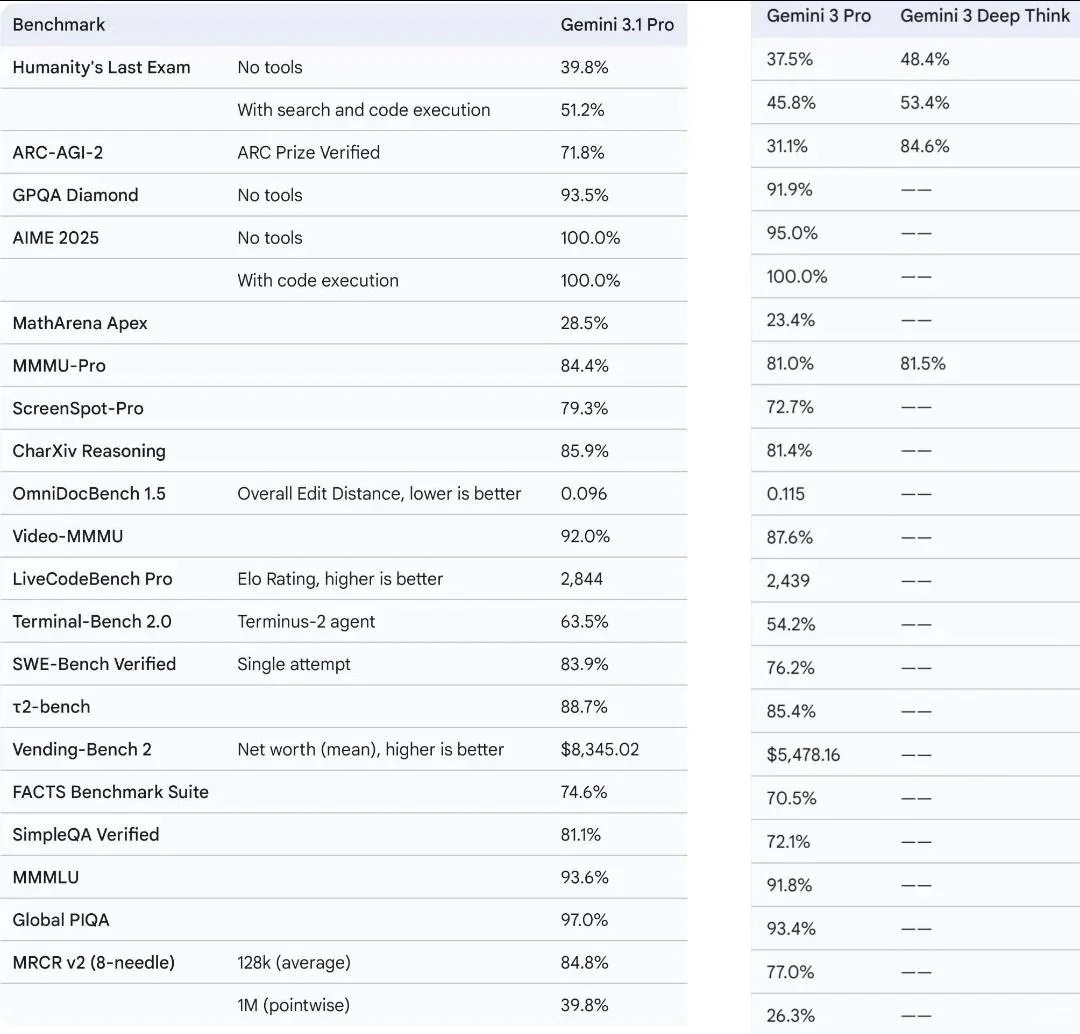

I risultati dei benchmark per Gemini 3.1 Pro sono i seguenti: AIME 2025: 100% (inclusa l’esecuzione del codice); SWE-Bench Verified: 83.9%; ARC-AGI-2: 71.8%; LiveCodeBench Pro: 2844; Elo Terminal-Bench 2.0: 63.5%; MMMLU: 93.6%. Per riferimento, Gemini 3 Pro ha ottenuto il 76.2% su SWE-Bench. Sarà un enorme passo avanti. L’84% su SWE è enorme.

vs Gemini 3.0 pro:

Su 23 benchmark forniti, Gemini 3.1 Pro mostra un miglioramento medio di circa il 17.5%.

Tuttavia, come illustrano gli screenshot, le vere “differenze” riguardano le seguenti aree:

Le migliorie più significative non riguardano la “raccolta di fatti”, bensì il ragionamento complesso e l’affidabilità nei contesti lunghi: ARC-AGI-2 (+130.9%): questo è il miglioramento più significativo. ARC misura la capacità del modello di apprendere nuove abilità (intelligenza fluida) al volo, invece di fare affidamento sui dati di addestramento. L’aumento dal 31.1% al 71.8% indica un cambiamento architettonico significativo nel modo in cui il modello “pensa”.

Vending-Bench 2 (+52.3%): questo benchmark traccia il “net worth” di un agente nel suo ambiente. Il salto qui dimostra che la versione 3.1 supera significativamente le altre versioni nella pianificazione, nell’esecuzione di attività multi-step e nella gestione efficace degli “strumenti”.

Contesto lungo (MRCR v2 1 milione di punti): mentre il contesto standard (128,000 token) offre un miglioramento delle prestazioni del 10%, il balzo fino al 51.3% a 1 milione di token dimostra che la versione 3.1 è più stabile e accurata nella gestione di enormi quantità di dati.

CometAPI offre Gemini 3 / 3 Pro / 3.1?

Sì — CometAPI elenca pubblicamente la famiglia Gemini 3 (voci di Gemini 3.1 Pro e relative stringhe di modello) nel proprio catalogo modelli e nei materiali di marketing, e mostra un percorso di integrazione compatibile con OpenAI (singola API key + base_url) per chiamare i modelli. CometAPI presenta esempi che utilizzano un client OpenAI puntato a https://api.cometapi.com/v1 e nomi di modello nel campo model. Ciò significa che spesso puoi chiamare i modelli della famiglia Google Gemini tramite CometAPI con un codice client in stile OpenAI. Gemini 3.1 pro è ora offerto tramite il marketplace e il playground unificati di CometAPI.

Passo dopo passo: checklist rapida per iniziare

- Crea un account CometAPI e ottieni una API key (CometAPI offre una chiave gratuita / prova in molti casi).

- Dalla console di CometAPI o dal catalogo modelli, conferma il nome esatto del modello (gemini-3.1-pro-preview).

- Usa l’endpoint compatibile con OpenAI di CometAPI (

base_url) e imposta il parametromodelsull’alias del modello dal catalogo. - Inizia con prompt di test, verifica latenza/costo, quindi scala con rate limits e controlli ingegneristici (timeouts, logica di retry, streaming, ecc.).

Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la API key. CometAPI offre un prezzo molto inferiore rispetto al prezzo ufficiale per aiutarti a integrare.

Pronto a partire?→ Sign up fo Gemini 3.1 pro today !

Se vuoi conoscere più suggerimenti, guide e novità sull’AI, seguici su VK, X e Discord!