Gemini 3 Pro (Preview) è il più recente modello di punta multimodale per il ragionamento della famiglia Gemini 3 di Google/DeepMind. È presentato come il loro “modello più intelligente di sempre”, progettato per il ragionamento profondo, workflow basati su agenti, coding avanzato e comprensione multimodale a lungo contesto (testo, immagini, audio, video, codice e integrazioni con strumenti).

Caratteristiche principali

- Modalità: Testo, immagine, video, audio, PDF (e output strutturati di strumenti).

- Agenti/strumenti: Chiamata di funzioni integrata, search-as-tool, esecuzione di codice, contesto da URL e supporto all’orchestrazione di agenti multi-step. Il meccanismo di thought-signature preserva il ragionamento multi-step tra le chiamate.

- Coding e “vibe coding”: Ottimizzato per la generazione front-end, la generazione di UI interattive e il coding agentico (guida le classifiche pertinenti riportate da Google). È promosso come il loro modello di “vibe-coding” più potente finora.

- Nuovi controlli per sviluppatori:

thinking_level(low|high) per bilanciare costi/latenza rispetto alla profondità del ragionamento, emedia_resolutionper controllare la fedeltà multimodale per immagine o fotogramma video. Questi aiutano a bilanciare prestazioni, latenza e costi.

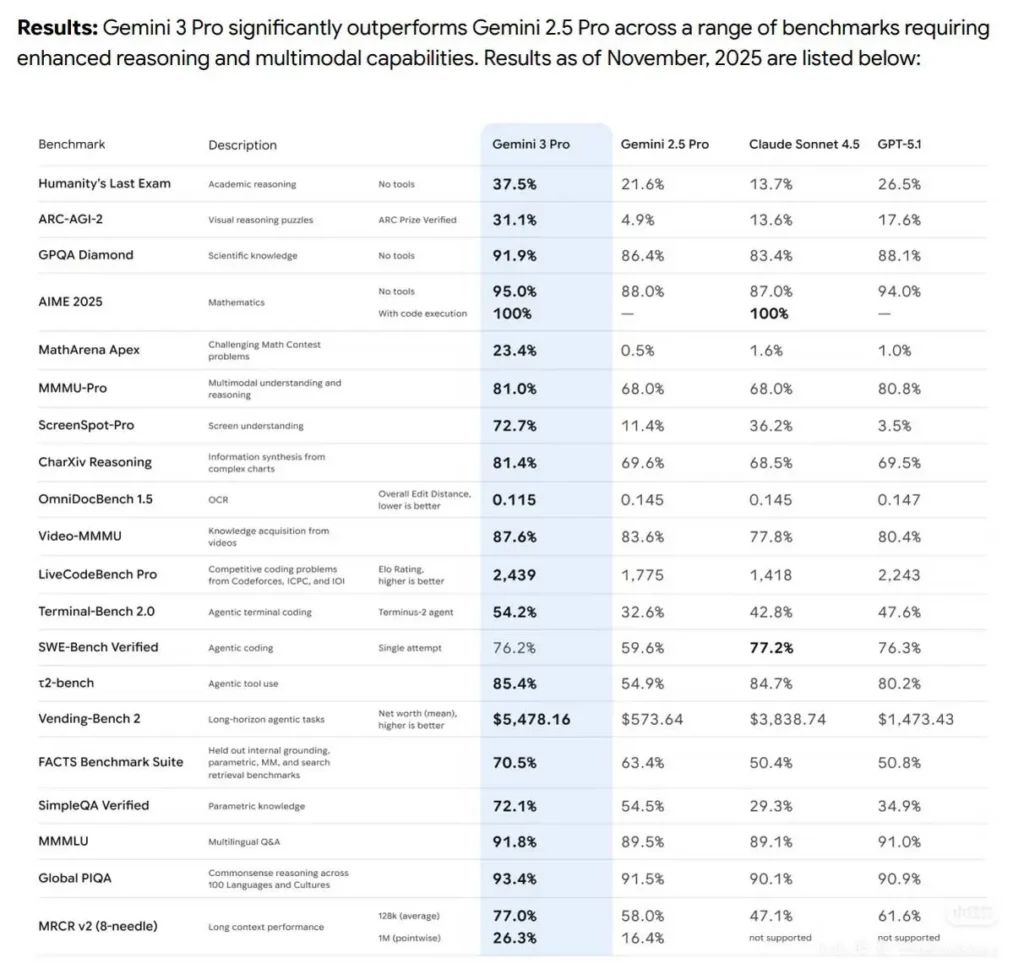

Prestazioni nei benchmark

- Il Gemini3Pro ha ottenuto il primo posto in LMARE con un punteggio di 1501, superando i 1484 punti di Grok-4.1-thinking e precedendo anche Claude Sonnet 4.5 e Opus 4.1.

- Ha inoltre raggiunto il primo posto nell’arena di programmazione WebDevArena con un punteggio di 1487.

- Nel ragionamento accademico di Humanity’s Last Exam ha ottenuto il 37.5% (senza strumenti); in GPQA Diamond (scienze), 91.9%; e nella competizione matematica MathArena Apex, 23.4%, stabilendo un nuovo record.

- Nelle capacità multimodali, ha raggiunto l’81% in MMMU-Pro; e nell’ambito della comprensione video in Video-MMMU, l’87.6%.

Dettagli tecnici e architettura

- Parametro “thinking level”: Gemini 3 espone un controllo

thinking_levelche consente agli sviluppatori di bilanciare la profondità del ragionamento interno rispetto a latenza/costo. Il modello trattathinking_levelcome una concessione relativa al ragionamento multi-step interno, piuttosto che una garanzia rigorosa di token. Il valore predefinito per Pro è tipicamentehigh. Si tratta di un nuovo controllo esplicito per regolare la pianificazione multi-step e la profondità della catena di pensiero. - Output strutturati e strumenti: Il modello supporta output JSON strutturati e può essere combinato con strumenti integrati (grounding con Google Search, contesto da URL, esecuzione di codice, ecc.). Alcune funzionalità di output strutturato + strumenti sono disponibili solo in anteprima per

gemini-3-pro-preview. - Integrazioni multimodali e agentiche: Gemini 3 Pro è esplicitamente costruito per workflow basati su agenti (strumentazione + agenti multipli su codice/terminali/browser).

- Accetta input di testo, immagini, video, audio e PDF; output testuale.

Limitazioni e avvertenze note

- Factualità non perfetta — le allucinazioni restano possibili. Nonostante i miglioramenti significativi nella factualità dichiarati da Google, sono ancora necessari verifica con fonti e revisione umana in contesti ad alto rischio (legale, medico, finanziario).

- Prestazioni su lungo contesto variabili a seconda del compito. Il supporto per una finestra di input da 1M è una capacità reale, ma l’efficacia empirica può diminuire su alcuni benchmark a lunghezze estreme (calo puntuale osservato a 1M in alcuni test di lungo contesto).

- Compromessi tra costi e latenza. Contesti ampi e impostazioni

thinking_levelpiù elevate aumentano compute, latenza e costo; si applicano fasce di prezzo in base ai volumi di token. Usathinking_levele strategie di suddivisione in blocchi per gestire i costi. - Sicurezza e filtri dei contenuti. Google continua ad applicare policy di sicurezza e livelli di moderazione; alcuni contenuti e azioni restano limitati o possono attivare modalità di rifiuto.

Come Gemini 3 Pro Preview si confronta con gli altri modelli di punta

Confronto ad alto livello (anteprima → qualitativo):

Rispetto a Gemini 2.5 Pro: Miglioramenti sostanziali nel ragionamento, nell’uso di strumenti agentici e nell’integrazione multimodale; gestione di contesti molto più ampi e migliore comprensione dei testi lunghi. DeepMind mostra progressi costanti su ragionamento accademico, coding e compiti multimodali.

Rispetto a GPT-5.1 e Claude Sonnet 4.5 (come riportato): Sul set di benchmark di Google/DeepMind, Gemini 3 Pro è presentato come leader in diverse metriche di agenticità, multimodalità e lungo contesto (vedi Terminal-Bench, MMMU-Pro, AIME). I risultati comparativi variano in base al compito.

Casi d’uso tipici e ad alto valore

- Sintesi e Q&A di documenti/libri di grandi dimensioni: il supporto per lunghi contesti lo rende interessante per team legali, di ricerca e compliance.

- Comprensione e generazione di codice a scala di repository: l’integrazione con toolchain di sviluppo e il ragionamento migliorato agevolano refactoring di grandi codebase e workflow di code review automatizzata.

- Assistenti di prodotto multimodali: workflow che combinano immagine + testo + audio (assistenza clienti che ingloba screenshot, frammenti di chiamate e documenti).

- Generazione ed editing di media (foto → video): le funzionalità precedenti della famiglia Gemini includono ora capacità foto→video in stile Veo/Flow; l’anteprima suggerisce una generazione multimediale più approfondita per prototipi e workflow media.

Come chiamare l’API gemini-3-pro-preview da CometAPI

Prezzi di Gemini 3 Pro Preview su CometAPI,sconto del 20% rispetto al prezzo ufficiale:

| Token di input | $1.60 |

| Token di output | $9.60 |

Passaggi necessari

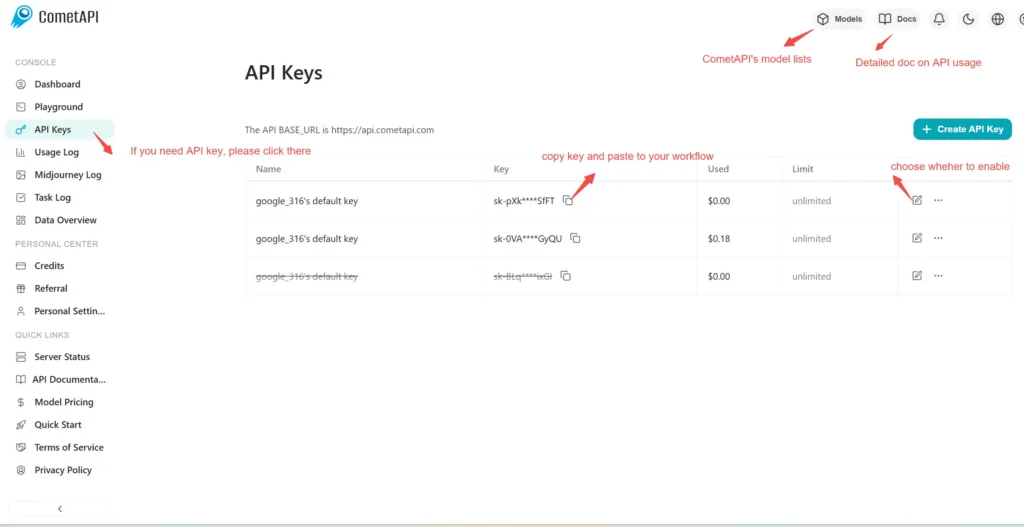

- Accedi a cometapi.com. Se non sei ancora un nostro utente, registrati prima.

- Entra nella tua console CometAPI.

- Ottieni la chiave API di accesso all’interfaccia. Clicca “Add Token” nella sezione dei token API nel centro personale, ottieni la chiave token: sk-xxxxx e inviala.

Metodo d’uso

- Seleziona l’endpoint “

gemini-3-pro-preview” per inviare la richiesta API e imposta il body della richiesta. Il metodo e il body della richiesta sono reperibili nella documentazione API del nostro sito web. Il nostro sito fornisce anche test Apifox per tua comodità. - Sostituisci <YOUR_API_KEY> con la tua effettiva chiave CometAPI del tuo account.

- Inserisci la tua domanda o richiesta nel campo content — è a questo che il modello risponderà.

- . Elabora la risposta dell’API per ottenere la risposta generata.

CometAPI fornisce un’API REST completamente compatibile — per una migrazione senza attriti. Dettagli chiave per Chat :

- Base URL: v1/chat/completions

- Model Names:

gemini-3-pro-preview - Authentication:

Bearer YOUR_CometAPI_API_KEYheader - Content-Type:

application/json.

Vedi anche GPT-5.1 API