Google DeepMind ha rilasciato ufficialmente Gemma 4 il 2 aprile 2026, segnando una tappa fondamentale nell'IA open source. Questa famiglia di modelli offre un'intelligenza di livello frontiera per parametro, basata sulla stessa ricerca e tecnologia che alimentano Gemini 3. A differenza delle versioni precedenti di Gemma con licenze personalizzate, Gemma 4 viene distribuita con una licenza Apache 2.0 completamente permissiva, consentendo uso commerciale senza restrizioni, modifica e ridistribuzione.

Gemma 4 si distingue per le sue capacità multimodali (input di testo + immagine su tutte le dimensioni, oltre all'audio sui modelli edge), il supporto nativo per il ragionamento avanzato e i workflow agentici, finestre di contesto lunghe fino a 256K token e l'ottimizzazione per tutto, dagli smartphone e Raspberry Pi alle GPU di fascia alta. Supporta oltre 140 lingue e punta sull’efficienza, rendendo un’IA potente accessibile su hardware consumer ed edge senza dipendenza dal cloud.

CometAPI fornisce eccellenti API per modelli open source e closed source.

Che cos'è Gemma 4?

Gemma 4 è l’ultima famiglia di grandi modelli linguistici multimodali (LLM) aperti di Google DeepMind, progettata per il ragionamento avanzato, i workflow di IA agentica e l’implementazione efficiente on-device. Massimizza l’“intelligenza per parametro” sfruttando le intuizioni della ricerca proprietaria su Gemini 3, pur rimanendo completamente open-weight e open source.

I principali progressi rispetto ai precedenti modelli Gemma includono:

- Multimodalità nativa: comprensione testo + immagine (tutti i modelli), con supporto audio sulle varianti edge più piccole.

- Modalità di pensiero configurabile: ragionamento passo-passo con output strutturato <|think|>.

- Chiamate di funzione e uso degli strumenti nativi: ideale per agenti autonomi.

- Contesto esteso: fino a 256K token sui modelli più grandi.

- Architettura di attenzione ibrida: combina attenzione locale a finestra scorrevole e attenzione globale per efficienza e performance su contesti lunghi.

- Embedding per livello (PLE) nei modelli più piccoli e cache KV condivisa per risparmio di memoria.

- Ampio supporto multilingue: pre-addestrati su dati che coprono oltre 140 lingue con consapevolezza delle sfumature culturali.

Rilasciato sotto Apache 2.0, Gemma 4 rimuove le precedenti restrizioni di licenza che limitavano l’adozione in ambito enterprise. Gli sviluppatori possono ora effettuare fine-tuning, distribuire e commercializzare senza attriti—posizionandolo come concorrente diretto di ecosistemi pienamente aperti come Llama e Qwen.

Gemma 4 mira a un hardware eterogeneo: dispositivi edge (telefoni, IoT, Raspberry Pi, Jetson Nano) per un’IA offline a bassa latenza, e workstation/GPU per server locali ad alte prestazioni. Questo design “local-first” dà priorità alla privacy, al risparmio sui costi e alla latenza zero in inferenza.

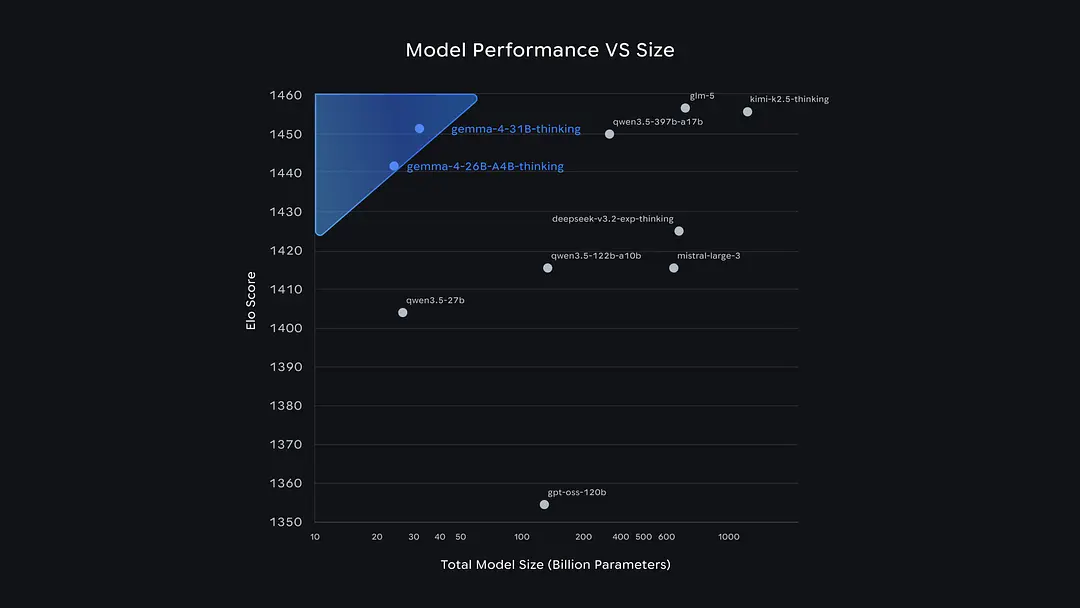

I modelli open source che la precedono nella classifica Arena provengono principalmente da team cinesi. Gemma 4 non è molto diversa da Qwen 3.5 e GLM-5, ma è significativamente diversa da GPT-OSS-120B di OpenAI.

Gli sviluppatori possono ora trovare GLM-5, Qwen 3.5, ecc. su CometAPI.

Le quattro versioni di Gemma 4

Google ha rilasciato Gemma 4 in quattro dimensioni accuratamente ottimizzate, ciascuna in equilibrio tra prestazioni, efficienza e scenari di distribuzione. Due utilizzano architetture dense con innovative Embedding per livello (PLE) per l’efficienza edge; una è una Mixture-of-Experts (MoE) per alte prestazioni a basso costo di parametri attivi; e una è un modello denso di punta.

| Modello | Architettura | Parametri totali | Parametri attivi (MoE) | Parametri effettivi | Lunghezza contesto | Modalità | Hardware target |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Densa + PLE | ~5.1B (incluse le embedding) | N/D | 2.3B | 128K | Testo, Immagine, Audio | Smartphone, Raspberry Pi, IoT edge |

| Gemma 4 E4B | Densa + PLE | ~8B (incluse le embedding) | N/D | 4.5B | 128K | Testo, Immagine, Audio | Dispositivi mobili, GPU leggere, Jetson |

| Gemma 4 26B A4B | MoE (8 attivi / 128 totali + 1 condiviso) | 25.2B | 3.8B–4B | N/D | 256K | Testo, Immagine | Workstation, GPU consumer, server locali |

| Gemma 4 31B | Densa | 30.7B | N/D | N/D | 256K | Testo, Immagine | GPU di fascia alta (sta su una singola H100/A100 in FP16) |

Gemma 4 E2B ed E4B (ottimizzati per edge): utilizzano PLE per aggiungere specializzazione per livello con overhead minimo di parametri. Ideali per dispositivi a batteria o con memoria limitata. Il codificatore audio (Conformer in stile USM, ~300M parametri) abilita speech-to-text e traduzione.

Gemma 4 26B A4B (MoE): attiva solo ~4B parametri durante l’inferenza nonostante una dimensione totale di oltre 25B. Offre prestazioni vicine al 31B con un costo di calcolo drasticamente inferiore—perfetto per uno scaling conveniente.

Gemma 4 31B (Denso): il modello di punta per la massima capacità. Sta su una singola GPU da 80GB a piena precisione e si colloca tra i migliori modelli open nelle classifiche.

Tutti i modelli includono varianti instruction-tuned (“-it”) ottimizzate per chat, ragionamento e uso di strumenti, oltre a versioni base pre-addestrate per il fine-tuning. I due modelli grandi adottano approcci diversi: il 31B Denso punta alla qualità assoluta e rappresenta la migliore base per il fine-tuning; il 26B MoE privilegia la velocità, attivando solo 3.8 miliardi di parametri durante l’inferenza, con una generazione di parole molto più rapida ma una qualità complessiva leggermente inferiore.

I due modelli più piccoli, E2B ed E4B, sono progettati specificamente per telefoni cellulari e dispositivi IoT: possono funzionare completamente offline, risparmiando memoria ed energia. Inoltre, questi modelli più piccoli possiedono una capacità che ai modelli più grandi manca: input audio nativo, che consente il riconoscimento vocale diretto.

Capacità principali di Gemma 4

Gemma 4 eccelle negli ambiti che contano di più per le applicazioni di IA nel mondo reale:

1. Ragionamento avanzato e modalità di pensiero

Ragionamento passo-passo configurabile tramite system prompt o enable_thinking=True. Produce tag strutturati <|think|> seguiti dalle risposte finali. Migliora drasticamente le prestazioni su compiti complessi senza ulteriore fine-tuning.

2. Comprensione multimodale

- Visione: rilevamento oggetti (riquadri di delimitazione JSON), OCR (multilingue), parsing di documenti/PDF, comprensione di grafici, comprensione di UI, riconoscimento della scrittura a mano e gestione di immagini a risoluzione variabile (budget di token: 70–1120 token).

- Video: fino a 60 secondi (elaborazione dei frame a 1 fps).

- Audio (solo E2B/E4B): riconoscimento automatico del parlato (ASR) e traduzione speech-to-text (max 30s).

- Input intercalati: mescola testo, immagini e audio in qualsiasi ordine.

3. Workflow agentici e chiamata di funzioni

Il supporto nativo all’uso di strumenti abilita agenti autonomi per pianificazione multi-step, chiamate API, navigazione nelle app e completamento dei task. Forte su τ2-bench (uso di strumenti agentici).

4. Programmazione e strumenti per sviluppatori

Eccellente generazione di codice, completamento, debugging e comprensione a livello di repository. Supporta output strutturati in JSON per un’integrazione senza soluzione di continuità. Ottiene l’80.0% (31B) su LiveCodeBench v6, posizionandosi come assistente alla programmazione local-first adatto a scenari di sviluppo offline.

5. Contesto lungo e multilingue

Gestisce in modo affidabile 128K–256K token (testato su MRCR needle-in-haystack). Pre-addestrato su dati eterogenei fino al cutoff di gennaio 2025, con solide prestazioni cross-lingua. Non si tratta solo di traduzione multilingue; è addestrato nativamente e copre oltre 140 lingue.

Dati di benchmark: analisi delle prestazioni di Gemma 4

Gemma 4 stabilisce nuovi standard per i modelli open. Le varianti 31B e 26B offrono punteggi un tempo riservati a sistemi proprietari molto più grandi, mentre i modelli edge superano il più grande predecessore Gemma 3.

Risultati completi dei benchmark (modelli instruction-tuned)

| Benchmark | Categoria | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (senza think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Ragionamento e conoscenza | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (senza strumenti) | Matematica | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Scienze a livello post-laurea | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (media) | Uso di strumenti agentici | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Programmazione | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Programmazione competitiva | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Ragionamento multimodale | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematica + visione | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Contesto lungo | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Osservazioni chiave:

- Balzo enorme da Gemma 3: il modello 31B migliora AIME (matematica) da 20.8% a 89.2% e LiveCodeBench da 29.1% a 80.0%.

- Efficienza MoE: il 26B A4B si avvicina molto al 31B pur usando molta meno computazione in inferenza.

- Dominio sull’edge: E4B ed E2B superano Gemma 3 27B in molte metriche nonostante siano 6–10 volte più piccoli.

- Classifiche: 31B ottiene ~1452 su Arena AI (testo); 26B A4B ~1441. La variante 26B supera, secondo quanto riportato, modelli molto più grandi come Qwen 3.5 397B nella preferenza degli utenti e nella programmazione.

I benchmark di visione e audio confermano solide prestazioni multimodali out-of-the-box senza fine-tuning specializzato.

Ecosistema e supporto strumenti

Gemma 4 gode di un’ampia integrazione nell’ecosistema sin dal primo giorno:

- Hugging Face: supporto dal primo giorno con

transformers,pipeline("any-to-any"), GGUF, ONNX e processori multimodali. - Runtime locali: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon con TurboQuant), Mistral.rs (Rust), Transformers.js (inferenza nel browser WebGPU).

- Fine-tuning: TRL, Unsloth, PEFT, Vertex AI e supporto completo a dataset multimodali.

- Ottimizzazione hardware: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge tools e distribuzione on-device su Android/iOS.

- Framework per agenti: OpenClaw, Hermes, Pi e test di simulazione CARLA.

- Cloud/Studio: Google AI Studio per test rapidi; Kaggle Models per il download.

Questo ecosistema rende Gemma 4 distribuibile in pochi minuti su laptop, server o dispositivi edge.

Limitazioni e sicurezza:

- Cutoff dei dati di addestramento: gennaio 2025 (nessuna conoscenza in tempo reale senza strumenti).

- Audio limitato al parlato (non musica); video limitati a 60s.

- Il rischio di allucinazioni rimane—usare la modalità di pensiero e la verifica.

- Sicurezza: filtraggio e valutazioni rigorose secondo i Google AI Principles; gli sviluppatori dovrebbero aggiungere controlli specifici all’applicazione.

Perché Gemma 4 è importante nel 2026

Gemma 4 democratizza l’IA di frontiera. Combinando intelligenza multimodale, capacità agentiche e libertà Apache 2.0 con un’efficienza indipendente dall’hardware, consente a sviluppatori e imprese di costruire soluzioni di IA sicure, private ed economiche su larga scala. La svolta sull’“intelligenza per parametro”—evidente soprattutto nei modelli edge che superano i modelli open di punta di ieri—segnala un passaggio verso un’IA davvero ubiqua.

Che si tratti di eseguire un modello da 2B su un telefono o un 31B potente in locale, Gemma 4 dimostra che l’IA open source ha raggiunto (e in molti casi superato) le alternative closed in termini di utilità pratica.