OpenAI ha annunciato GPT Image 1.5, il nuovo modello di punta dell’azienda per la generazione e l’editing di immagini, e ha rilasciato un’esperienza “ChatGPT Images” rinnovata su ChatGPT e tramite API. OpenAI presenta questa versione come un passo verso una creazione di immagini di livello produzione: aderenza più rigorosa alle istruzioni, modifiche più precise che preservano i dettagli importanti (volti, illuminazione, loghi), output fino a 4× più veloce e costi di input/output immagine inferiori nell’API. La buona notizia è che CometAPI ha integrato GPT-image 1.5 (gpt-image-1.5) e offre un prezzo inferiore rispetto a OpenAI.

Che cos’è GPT Image 1.5?

GPT Image 1.5 è il modello di immagini di ultima generazione di OpenAI, rilasciato come motore alla base della rinnovata esperienza ChatGPT Images e disponibile tramite l’API OpenAI come gpt-image-1.5. OpenAI lo presenta non solo come uno strumento artistico di novità, ma come uno studio creativo pronto per la produzione: mira a realizzare modifiche precise e ripetibili e a supportare flussi di lavoro come cataloghi e‑commerce, generazione di varianti di asset di brand, pipeline di asset creativi e prototipazione rapida. Vengono evidenziati esplicitamente i progressi nel preservare i dettagli importanti delle immagini — volti, loghi, illuminazione — e nel seguire istruzioni di editing passo‑passo.

Due dettagli operativi da ricordare: GPT Image 1.5 renderizza le immagini fino a quattro volte più velocemente del suo predecessore e gli input/output immagine sono ~20% più economici nell’API rispetto a GPT Image 1.0 — entrambi aspetti importanti per i team che iterano molto. La nuova interfaccia di ChatGPT Images aggiunge anche un’area di lavoro laterale dedicata, filtri preimpostati e prompt di tendenza, e un caricamento una tantum della “somiglianza” per personalizzazioni ripetute.

In che modo GPT Image 1.5 si è evoluto rispetto ai precedenti modelli di immagini di OpenAI?

La linea di modelli di immagini di OpenAI è passata da DALL·E → molteplici esperimenti interni di immagini → GPT Image 1 (e varianti più piccole). Rispetto ai precedenti modelli di immagini di OpenAI (ad es., GPT-image-1 e gli stack di immagini ChatGPT precedenti), la versione 1.5 è esplicitamente ottimizzata per:

- Aderenza più rigorosa alle istruzioni — il modello segue più da vicino le direttive testuali.

- Fedelità di editing dell’immagine migliorata — preserva composizione, tratti del viso, illuminazione e loghi tra le modifiche, così le modifiche ripetute restano coerenti.

- Inferenza più veloce ed economica — OpenAI dichiara fino a 4× miglioramenti di velocità rispetto al modello di immagini precedente e costi inferiori per token/immagine su input e output.

In breve: invece di trattare la generazione di immagini come un “giocattolo artistico” una tantum, OpenAI sta spingendo i modelli di immagini verso strumenti prevedibili e ripetibili per team creativi e flussi di lavoro enterprise.

Caratteristiche principali di GPT Image 1.5

Capacità di editing e preservazione dell’immagine

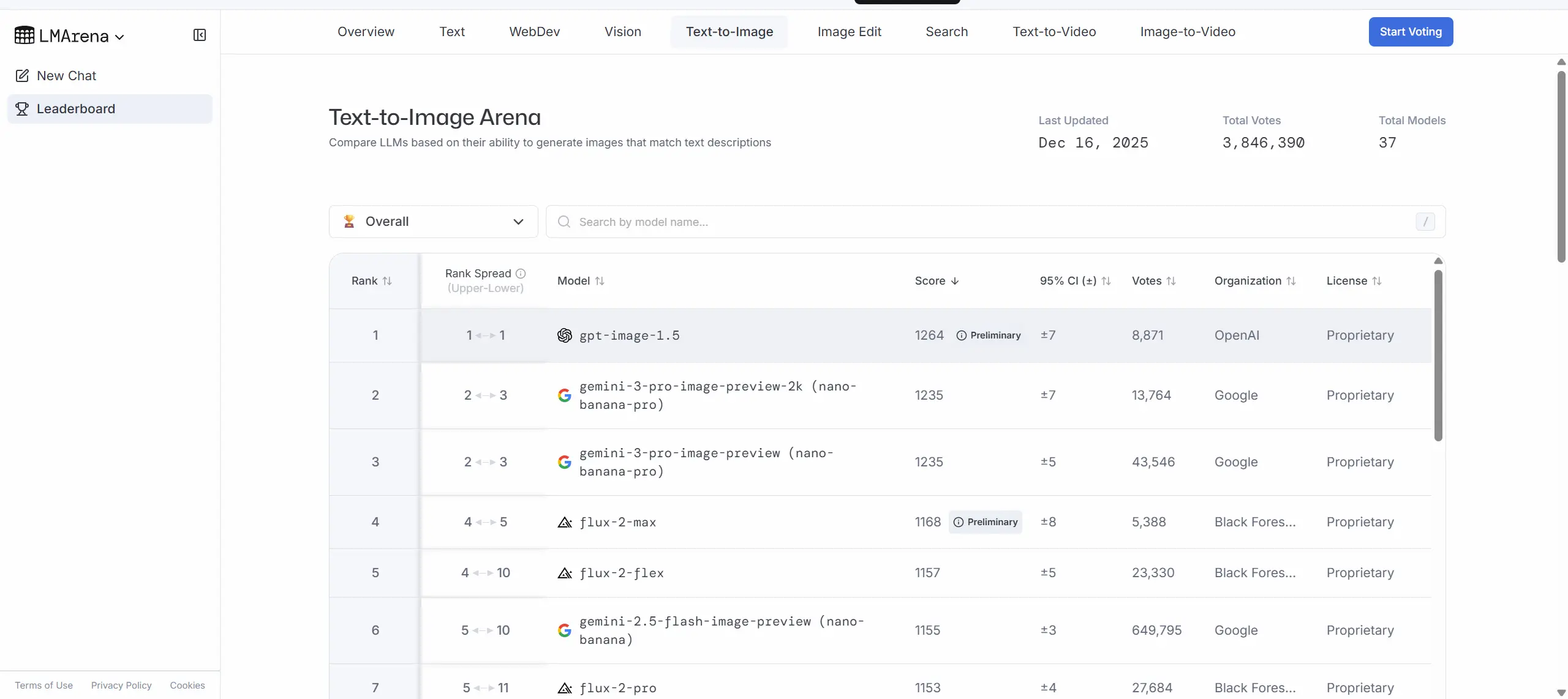

GPT Image 1.5 sta ottenendo risultati eccellenti in diverse classifiche di generazione ed editing di immagini pubblicate dal lancio. Il rapporto di LMArena riporta GPT Image 1.5 ai primi posti delle leaderboard di text-to-image e di editing d’immagini, talvolta di poco davanti a concorrenti come Nano Banana Pro di Google.

Una delle funzionalità di punta di GPT Image 1.5 è l’editing preciso che preserva “ciò che conta”: quando si chiede al modello di cambiare un determinato oggetto o attributo, mira a modificare solo quell’elemento mantenendo coerenti composizione, illuminazione e aspetto delle persone tra le diverse modifiche. Per i brand e i team e‑commerce ciò si traduce in meno ritocchi manuali dopo gli interventi automatizzati.

Quanto è veloce e cosa significa "4× più veloce"?

OpenAI riporta che la generazione di immagini in ChatGPT Images è fino a 4× più veloce di prima, con costi di I/O immagine ~20% più bassi nell’API rispetto a GPT Image 1. Si tratta di un’affermazione a livello di prodotto: tempi di rendering più rapidi significano poter iterare più immagini nella stessa sessione, avviare generazioni aggiuntive mentre altre sono ancora in elaborazione e ridurre l’attrito nei flussi esplorativi. Un’inferenza più veloce non solo riduce la latenza per gli utenti finali, ma abbassa anche l’energia per richiesta e i costi operativi dei deployment. Nota: “fino a” significa che i benefici reali dipenderanno dalla complessità del prompt, dalla dimensione dell’immagine e dal carico di sistema.

Miglioramenti nel seguito delle istruzioni e nella resa del testo

Aderenza alle istruzioni più solida rispetto a GPT Image 1.0: il modello interpreta meglio i prompt multi‑step e mantiene l’intento dell’utente attraverso modifiche concatenate. Vengono inoltre evidenziati miglioramenti nella resa del testo (testo leggibile incorporato nelle immagini) e una migliore resa dei volti di piccole dimensioni; segnala comunque limiti nella resa multilingue/in alcuni edge case, ma nel complesso il modello punta a colmare il divario di lunga data per cui le immagini generate producevano cartelli illeggibili o insensati.

GPT Image 1.5 vs Nano Banana Pro (Google) vs Qwen-Image (Alibaba)?

Che cos’è Nano Banana Pro di Google?

Nano Banana Pro (nominato nella famiglia Gemini di Google come Gemini 3 Pro Image / Nano Banana Pro) è il modello di immagini di livello studio di Google/DeepMind. Google enfatizza un’ottima resa del testo, la composizione multi‑immagine (fondere molte immagini in una) e l’integrazione con le più ampie capacità di Gemini (search grounding, traduzioni sensibili al locale e flussi enterprise in Vertex AI). Nano Banana Pro punta a essere pronto per la produzione per designer che richiedono alta fedeltà e layout testuale prevedibile all’interno delle immagini.

Che cos’è Qwen-Image?

Qwen-Image (della famiglia Qwen/Tongyi) è un modello di immagini rilasciato da Alibaba che è stato valutato su benchmark accademici e pubblici. Il report tecnico del team Qwen documenta solide prestazioni cross‑benchmark (GenEval, DPG, OneIG‑Bench) e mette in evidenza punti di forza specifici nella comprensione dei prompt, nella resa testuale multilingue (in particolare in cinese) e in un editing robusto. Qwen-Image è spesso citato come una delle principali opzioni open‑source/enterprise‑friendly al di fuori degli hyperscaler statunitensi.

Testa a testa: dove ciascuno eccelle

- GPT Image 1.5 (OpenAI) — Punti di forza: generazione veloce, forte aderenza alle istruzioni in flussi multi‑step, UX di ChatGPT ben integrata e ampia accessibilità via API. I primi benchmark lo collocano ai primi posti nelle metriche combinate di generazione ed editing; la presentazione di OpenAI lo descrive come uno “studio creativo” per la produttività pratica.

- Nano Banana Pro (Google) — Punti di forza: resa del testo eccezionale e integrazioni enterprise (Vertex AI, Google Workspace), forti funzionalità di localizzazione e composizione multi‑immagine, controlli di livello studio per angolo/illuminazione/aspect/output 2K. Google enfatizza l’utilità del modello per pipeline di marketing/localizzazione e per la generazione precisa di poster/mockup.

- Qwen-Image (Alibaba) — Punti di forza: prestazioni cross‑benchmark su dataset internazionali, reporting tecnico aperto e ottima resa testuale multilingue. Rappresenta una scelta convincente per sviluppatori e imprese focalizzati sui mercati asiatici e per team che cercano risultati di benchmark trasparenti.

Differenze pratiche che gli sviluppatori noteranno

- API e pattern di integrazione: OpenAI espone GPT Image 1.5 tramite la Image API e la Responses API; Google espone Nano Banana Pro via Gemini/Vertex; Alibaba pubblica documentazione del modello ed endpoint demo. Prezzi e rate limit differiscono tra provider e influenzeranno i costi di produzione e le decisioni sul throughput.

- Trade‑off tra controllo e velocità: Alcuni provider offrono modalità “fast/flash” vs “thinking/pro” — ad es., Nano Banana (fast) vs Nano Banana Pro (thinking). La comunicazione di OpenAI suggerisce che GPT Image 1.5 riduce la necessità pratica di scambiare qualità con velocità, ma l’ottimizzazione costo/prestazioni resterà importante per generazioni in bulk.

Come accedere e usare GPT Image 1.5

Ci sono due modi per accedere a GPT Image 1.5:

ChatGPT (UI) — GPT Image 1.5 alimenta la nuova esperienza ChatGPT Images (scheda Images). Usalo per generare da testo, caricare immagini ed effettuare modifiche, o iterare in modo interattivo.

API — Usa la Image API (/v1/images/generations e /v1/images/edits) per generare e modificare immagini con gpt-image-1.5. Le risposte sono immagini codificate in base64 per i modelli di immagini GPT.

La buona notizia è che CometAPI ha integrato GPT-image 1.5 (gpt-image-1.5) e offre un prezzo inferiore rispetto a OpenAI. Puoi usare CometAPI per utilizzare e confrontare simultaneamente Nano banana pro e Qwen image.

Quali sono i casi d’uso pratici e i workflow consigliati?

Casi d’uso che traggono maggior beneficio

- E‑commerce e catalogazione prodotto: creare molte foto prodotto coerenti da un singolo campione, cambiare sfondi e mantenere illuminazione/angolazioni coerenti tra le immagini. La stabilità delle modifiche di GPT Image 1.5 aiuta in questo.

- Creatività pubblicitaria e iterazione rapida: la generazione più veloce riduce i tempi ciclo per varianti creative A/B.

- Ritocco fotografico e localizzazione: sostituire oggetti di scena o outfit mantenendo l’identità del modello coerente per campagne localizzate a livello regionale.

- Prototipazione di design e concept art: il modello supporta output sia fotorealistici sia altamente stilizzati, utili per l’esplorazione dei concept nelle fasi iniziali.

Chi trae maggior beneficio da GPT Image 1.5?

- Creator di contenuti e team social media che necessitano di editing rapido e iterativo e trasformazioni creative.

- Designer e team di prodotto che prototipano asset UI/UX, hero image o mockup pubblicitari che richiedono bozze rapide.

- Team e‑commerce che realizzano mockup di prodotto (prove virtuali di abbigliamento, sostituzioni di sfondo, sovrapposizioni di testo).

- Sviluppatori che costruiscono esperienze conversazionali basate sulle immagini (ad es., editor fotografici basati su chat, automazione marketing).

Workflow suggerito per i creator

- Prototipare in ChatGPT Images per affinare le istruzioni (usa i preset per scoprire stili).

- Fissare uno snapshot nell’uso dell’API per la stabilità in produzione (

gpt-image-1.5-YYYY-MM-DD). - Eseguire test A/B controllati confrontando gli output del modello e i costi di post‑processing umano.

- Integrare controlli di moderazione e un human‑in‑the‑loop per attività sensibili al brand o alla sicurezza.

Considerazioni su costi e prestazioni

Una generazione più veloce può ridurre la latenza e (a seconda dei prezzi) il costo per immagine, ma nell’uso enterprise si dovrebbero misurare sia il throughput sia i costi di token/compute.

Sicurezza, bias e allucinazioni

GPT Image 1.5 riduce alcune modalità di errore (modifiche errate, volti incoerenti) ma non elimina output allucinati o con bias. Come altri modelli generativi, può riprodurre bias culturali o produrre rappresentazioni inaccurate se i prompt sono mal specificati. Implementare guardrail: filtri dei contenuti, revisione umana e suite di test che riflettano i casi limite attesi.

Conclusione — Dovresti provare GPT Image 1.5?

Se il tuo progetto necessita di generazione di immagini di alta qualità o di un editing robusto e iterativo all’interno di flussi conversazionali (per esempio: creatività per il marketing, mockup di prodotto, prove virtuali o un SaaS abilitato all’uso di immagini pro.

Per iniziare, esplora le funzionalità di GPT Image 1.5 nel Playground e consulta la guida all’API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo di gran lunga inferiore a quello ufficiale per aiutarti a integrare.

Pronto a partire?→ Prova gratuita dei modelli GPT image 1.5 !