Il modello o3 di OpenAI rappresenta un significativo passo avanti nell'intelligenza artificiale basata sul ragionamento su larga scala, combinando capacità di deliberazione avanzate con una solida integrazione di strumenti. Dal suo lancio nel dicembre 2024, o3 è stato al centro dell'attenzione del settore, con OpenAI che lo descrive come una dimostrazione di "intelligenza di livello geniale" e pionieristico in nuove tecniche di sicurezza. Questo articolo sintetizza le ultime notizie e i comunicati ufficiali per fornire una guida completa e passo passo su come accedere a o3, sia che siate utenti finali di ChatGPT o sviluppatori che sfruttano l'API. Ogni sezione è strutturata come una domanda per facilitare la navigazione rapida, con sottosezioni dettagliate che offrono approfondimenti più approfonditi.

Cos'è o3 di OpenAI?

Origini e rilascio

OpenAI ha presentato per la prima volta o3 il 20 dicembre 2024 durante l'evento "12 Days of OpenAI". Il modello, chiamato così per evitare confusione con il provider di telecomunicazioni O2, è il successore del modello di ragionamento o1 originale ed è progettato per dedicare più tempo di elaborazione "di riflessione" prima di generare risposte. Rilasciato il 16 aprile 2025, insieme alla sua controparte più piccola o4-mini, o3 offre funzionalità senza pari per sviluppatori, ricercatori e team aziendali.

Funzionalità principali

Al suo interno, o3 impiega un'architettura a trasformatore potenziata da quella che OpenAI definisce una "catena di pensiero privata", che gli consente di pianificare internamente processi di ragionamento multi-step. Ciò si traduce in prestazioni notevolmente migliorate in compiti complessi, in particolare nei settori STEM come matematica avanzata, programmazione e risoluzione di problemi scientifici, dove può raggiungere livelli di accuratezza diverse volte superiori rispetto al suo predecessore.

In che cosa o3 differisce dai suoi predecessori?

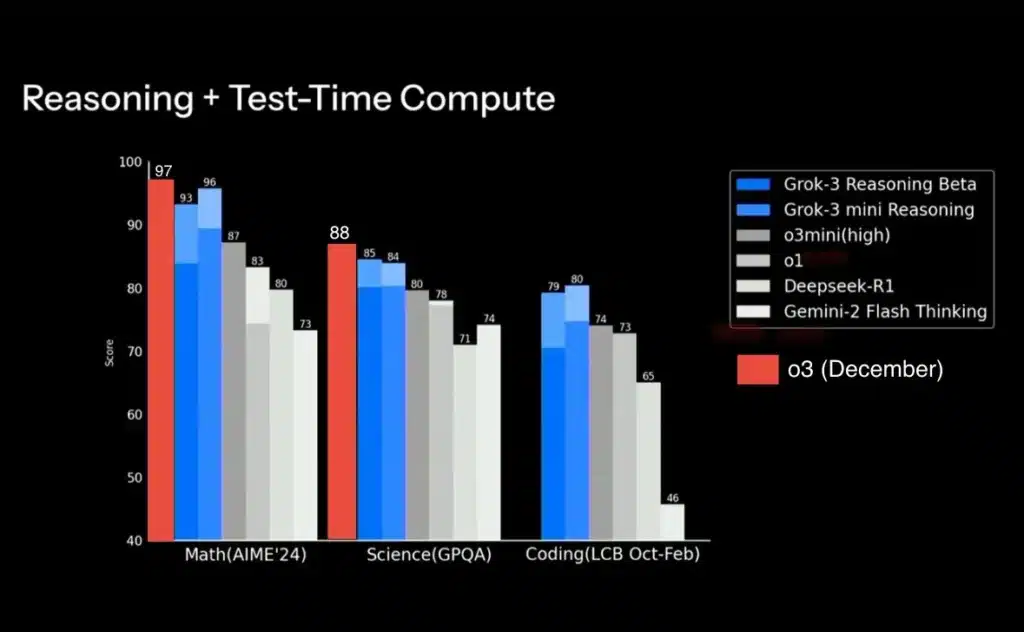

OpenAI o3 si basa sul framework "o-series" dell'azienda, che enfatizza una deliberazione interna estesa, o "catena di pensiero privata", prima di produrre output. A differenza di o1, che offriva prestazioni solide su attività generali, o3 è stato addestrato per allocare risorse di calcolo aggiuntive per query che richiedono un ragionamento intensivo, con conseguenti punteggi significativamente migliori in benchmark come GPQA Diamond (87.7% rispetto alle prestazioni inferiori di o1) e nei test di codifica avanzati su Codeforces (Elo 2727 rispetto a 1 di o1891). Nei test affiancati, o3 eguaglia o supera o1 in attività STEM, logica e problem-solving creativo, sebbene con una latenza leggermente superiore dovuta al suo processo di ragionamento più approfondito.

Chi può accedere a o3?

Quali livelli di abbonamento a ChatGPT includono o3?

Dal 16 aprile 2025, o3 è disponibile per gli abbonati a ChatGPT Plus, Pro e Team. Gli utenti Plus e Team possono selezionare o3 (o o4-mini) direttamente nel selettore del modello, sostituendo la precedente opzione o1-mini e beneficiando di limiti di velocità più elevati: fino a 150 messaggi al giorno per o3-mini rispetto ai 50 precedenti. Gli utenti Pro avranno accesso sia a o3 che alla variante con potenza di calcolo più elevata o3-pro non appena verrà lanciata, con utilizzo illimitato all'interno del loro piano di abbonamento. Gli utenti del livello gratuito continueranno ad avere accesso ai modelli standard GPT-4.5 e GPT-4o, ma dovranno effettuare l'upgrade per sfruttare lo stack di ragionamento avanzato di o3.

In che modo i clienti API possono utilizzare o3?

Gli sviluppatori che sfruttano l'API OpenAI possono chiamare o3 non appena soddisfano i requisiti di accesso aggiornati. Secondo la documentazione API più recente di OpenAI, gli endpoint o3 sono abilitati per tutti gli utenti con una chiave API valida, sebbene l'utilizzo sia regolato dagli stessi limiti di tariffazione e dalla stessa struttura di fatturazione di altri modelli. A partire dall'11 marzo 2025, le API "Risposte" e "Strumenti" supportano le chiamate o3 con plugin di ricerca web, ricerca file ed esecuzione codice, consentendo build di agenti personalizzati basati sulle capacità di ragionamento di o3.

Come puoi accedere a o3 tramite ChatGPT?

Quali passaggi sbloccano o3 nell'interfaccia di ChatGPT?

- Accedi e vai su Impostazioni: Apri ChatGPT nel tuo browser o nell'app desktop, quindi clicca sull'icona del tuo profilo (in basso a sinistra) e seleziona "Impostazioni".

- Scegli il tuo livello di abbonamento: Verifica di essere abbonato a Plus, Pro o Team. In caso contrario, effettua l'upgrade tramite il link "Gestisci abbonamento".

- Apri il selettore modello: In qualsiasi finestra di conversazione, fai clic sul nome del modello in alto a sinistra (il nome predefinito potrebbe essere "GPT-4").

- Selezionare “o3” o “o4-mini”: Cerca l'elenco della serie o: o3 apparirà accanto a o4-mini e GPT-4. Fai clic su "o3" per iniziare subito a utilizzare il modello.

- **Regola il livello di ragionamento (solo o3-mini)**Nelle "Impostazioni avanzate" di ChatGPT, puoi scegliere tra un livello di ragionamento basso, medio o alto per le varianti o3-mini. Il livello predefinito è "medio"; "alto" consuma più risorse di calcolo ma può fornire soluzioni passo passo più approfondite.

Come puoi confermare che o3 è attivo?

Una volta selezionato o3, l'intestazione della conversazione mostrerà "Modello: o3". Puoi anche testare eseguendo una query di ragionamento multi-step, ad esempio "Spiega e risolvi il problema di Monty Hall passo dopo passo", e osservando la profondità della spiegazione della catena di pensiero. Se la risposta mostra passaggi intermedi espliciti, stai sfruttando la catena di pensiero privata di o3.

Come possono gli sviluppatori integrare o3 tramite l'API?

Chiavi API e autenticazione

- Ottieni una chiave API accedendo a platform.openai.com e andando su "Chiavi API".

- Genera una nuova chiave se non ne hai già uno.

- Conserva la tua chiave in modo sicuro: non codificarlo mai in repository pubblici.

- Imposta la variabile d'ambiente:

export OPENAI_API_KEY="your_api_key_here"Questa chiave garantisce l'accesso a tutti gli endpoint sottoscritti, incluso o3.

Configurazione dell'endpoint

Nel codice dell'applicazione, specificare il parametro del modello come "o3"Ad esempio, utilizzando Python con l'SDK di OpenAI:

import openai

response = openai.ChatCompletion.create(

model="o3",

messages=,

temperature=0.7

)

print(response.choices.message.content)

Regola parametri come temperature, max_tokense stream per adattarsi al tuo caso d'uso. Se hai bisogno di una latenza o di un costo inferiori, considera l' o4-mini variante specificando "o4-mini".

Quali sono i limiti di prezzo e di tariffa?

o3 ha un prezzo premium, circa 1.5 volte superiore al costo dei token GPT-4, che riflette il suo utilizzo di elaborazione esteso. I limiti di velocità variano in base al livello di account, ma in genere consentono 40 richieste/minuto per gli utenti API standard, con capacità burst disponibile su richiesta per i clienti aziendali. L'utilizzo è misurato per token (input + output) e informazioni dettagliate sulla fatturazione sono disponibili nella dashboard.

Accedi all'API o3 in CometAPI

CometAPI fornisce un'interfaccia REST unificata che aggrega centinaia di modelli di intelligenza artificiale, inclusa la famiglia Gemini di Google, in un endpoint coerente, con gestione integrata delle chiavi API, quote di utilizzo e dashboard di fatturazione. Invece di dover gestire URL e credenziali di più fornitori.

Gli sviluppatori possono accedere API O3 attraverso CometaAPIPer iniziare, esplora le capacità del modello nel Playground e consulta il Guida API per le istruzioni dettagliate.

Quali sono i requisiti di sistema e le best practice applicabili?

Ci sono considerazioni sulla latenza o sul calcolo?

Il ragionamento più approfondito di o3 comporta una latenza maggiore: le risposte possono richiedere da 0.5 a 1.5 secondi in più rispetto a GPT-4, a seconda della complessità della richiesta. Quando le prestazioni sono critiche, gli sviluppatori possono optare per o4-mini, che offre miglioramenti simili nel ragionamento a costi e latenza ridotti, oppure regolare il livello di ragionamento di o3-mini per un equilibrio tra velocità e profondità.

Come dovresti strutturare i prompt per ottenere risultati ottimali?

Un prompt efficace con o3 comporta:

- Richieste esplicite multi-step: Formulare domande che guidino la catena di pensiero (ad esempio, "Elenca ogni ipotesi prima di risolvere...").

- Direttive degli strumenti contestuali: Quando si utilizzano i plugin, specificare all'interno della conversazione quale strumento utilizzare per la ricerca sul Web o l'analisi dei file.

- Gestione dei token: Le finestre di contesto lunghe (supportano fino a 128k token) consentono di gestire documenti estesi, ma bisogna tenere presente i costi dei token.

In che modo i ricercatori sulla sicurezza possono ottenere un accesso anticipato a o3-pro?

Cos'è o3-pro e perché è speciale?

o3-pro è la prossima variante professionale di o3, che offre supporto completo per gli strumenti, limiti di velocità più elevati e misure di sicurezza aggiuntive per applicazioni sensibili o ad alto rischio. OpenAI prevede il rilascio per la fine del secondo trimestre del 2, con slot di accesso anticipato riservati ai team di ricerca sulla sicurezza per valutarne robustezza, privacy e mitigazione dei bias.

Come si fa domanda per i servizi di accesso anticipato?

I ricercatori in sicurezza possono candidarsi inviando il modulo "Servizi di accesso anticipato" sulla pagina delle policy di OpenAI. I candidati devono accettare termini aggiuntivi che riguardano la divulgazione responsabile, la segnalazione dell'utilizzo e il rispetto dei Termini di servizio API. I candidati in anticipo vengono in genere avvisati entro due settimane dalla presentazione e devono superare la verifica dell'identità e dell'organizzazione prima di ricevere le credenziali API per i test o3-pro.

Come sfruttare le funzionalità avanzate di o3 nella pratica

Come si integra il ragionamento sulle immagini nei flussi di lavoro?

In ChatGPT, è sufficiente caricare un'immagine, come un grafico, uno schizzo o una foto su lavagna, nella conversazione. Con o3 selezionato, istruire il modello ad analizzare o trasformare l'immagine ("Ruota questo diagramma di 90 gradi ed etichetta ogni asse"). o3 elaborerà l'input visivo, eseguirà le manipolazioni richieste e spiegherà i passaggi del ragionamento in linguaggio naturale.

In che modo o3 può migliorare la ricerca in tempo reale tramite la navigazione web?

Abilitando il plugin "Navigazione Web" nelle impostazioni di ChatGPT, o3 può effettuare query di ricerca, recuperare frammenti web in tempo reale e citare le fonti direttamente nelle sue risposte. Ad esempio, chiedendo "Quali sono le ultime scoperte sugli effetti off-target di CRISPR?", o3 raccoglie gli studi più recenti, riassume i risultati chiave e include riferimenti cliccabili, accelerando le revisioni della letteratura e le verifiche dei fatti in pochi minuti.

Conclusione

Il modello o3 di OpenAI inaugura una nuova era di ragionamento basato sull'intelligenza artificiale, combinando capacità di ragionamento approfondite con una perfetta integrazione di strumenti, che spaziano dalle ricerche web in tempo reale all'analisi multimodale delle immagini. L'accesso a o3 è semplice per gli abbonati a ChatGPT Plus, Pro e Team, e gli sviluppatori possono richiamarlo tramite l'API standard con modifiche minime al codice esistente. I ricercatori sulla sicurezza interessati ad accedere in anteprima al prossimo o3-pro possono candidarsi nell'ambito del programma specializzato di OpenAI. Seguendo i passaggi descritti qui e adottando le migliori pratiche nella progettazione rapida e nell'utilizzo degli strumenti, è possibile sfruttare appieno il potenziale di o3 per automatizzare flussi di lavoro complessi, accelerare la ricerca e creare applicazioni basate sull'intelligenza artificiale più intelligenti.