Nel 2025–2026 il panorama degli strumenti di IA ha continuato a consolidarsi: le API gateway (come CometAPI) si sono ampliate per offrire accesso in stile OpenAI a centinaia di modelli, mentre le app LLM per utenti finali (come AnythingLLM) hanno continuato a migliorare il loro provider “Generic OpenAI” per consentire ad app desktop e local-first di chiamare qualsiasi endpoint compatibile con OpenAI. Questo rende semplice oggi instradare il traffico di AnythingLLM tramite CometAPI e ottenere i vantaggi di scelta del modello, routing dei costi e fatturazione unificata — continuando comunque a usare l’interfaccia locale e le funzioni RAG/agent di AnythingLLM.

Che cos’è AnythingLLM e perché vorresti collegarlo a CometAPI?

Che cos’è AnythingLLM?

AnythingLLM è un’applicazione IA open-source, all-in-one, e un client locale/cloud per creare assistenti chat, flussi RAG (retrieval-augmented generation) e agenti guidati da LLM. Offre un’interfaccia curata, un’API per sviluppatori, funzionalità di workspace/agent e supporto per LLM locali e cloud — progettata per essere privata per impostazione predefinita ed estendibile tramite plugin. AnythingLLM espone un provider Generic OpenAI che gli consente di dialogare con API LLM compatibili con OpenAI.

Che cos’è CometAPI?

CometAPI è una piattaforma commerciale di aggregazione di API che espone 500+ modelli di IA attraverso un’unica interfaccia REST in stile OpenAI e una fatturazione unificata. In pratica ti consente di chiamare modelli di più vendor (OpenAI, Anthropic, varianti Google/Gemini, modelli immagine/audio, ecc.) tramite gli stessi endpoint https://api.cometapi.com/v1 e una singola chiave API (formato sk-xxxxx). CometAPI supporta gli endpoint standard in stile OpenAI come /v1/chat/completions, /v1/embeddings, ecc., rendendo facile adattare gli strumenti che già supportano API compatibili con OpenAI.

Perché integrare AnythingLLM con CometAPI?

Tre motivi pratici:

- Scelta del modello e flessibilità del vendor: AnythingLLM può usare “qualsiasi LLM compatibile con OpenAI” tramite il suo wrapper Generic OpenAI. Puntare quel wrapper a CometAPI fornisce accesso immediato a centinaia di modelli senza cambiare l’interfaccia o i flussi di AnythingLLM.

- Ottimizzazione dei costi/operazioni: Usare CometAPI ti permette di cambiare modello (o passare a modelli più economici) in modo centralizzato per controllare i costi e mantenere una fatturazione unificata invece di gestire più chiavi di provider.

- Sperimentazione più rapida: Puoi fare A/B test tra diversi modelli (ad es.,

gpt-4o,gpt-4.5, varianti Claude o modelli multimodali open-source) tramite la stessa interfaccia di AnythingLLM — utile per agenti, risposte RAG, sintesi e attività multimodali.

Quali ambienti e condizioni preparare prima dell’integrazione

Requisiti di sistema e software (di alto livello)

- Desktop o server con AnythingLLM (Windows, macOS, Linux) — installazione desktop o istanza self-hosted. Verifica di avere una build recente che espone le impostazioni LLM Preferences / AI Providers.

- Account CometAPI e una chiave API (il segreto in stile

sk-xxxxx). Userai questo segreto nel provider Generic OpenAI di AnythingLLM. - Connettività di rete dalla tua macchina verso

https://api.cometapi.com(nessun firewall che blocchi l’HTTPS in uscita). - Opzionale ma consigliato: un ambiente Python o Node moderno per i test (Python 3.10+ o Node 18+), curl e un client HTTP (Postman / HTTPie) per verificare CometAPI prima di collegarlo a AnythingLLM.

Condizioni specifiche per AnythingLLM

Il provider Generic OpenAI è il percorso consigliato per endpoint che imitano la superficie dell’API di OpenAI. La documentazione di AnythingLLM avverte che questo provider è orientato agli sviluppatori e che dovresti comprendere gli input che fornisci. Se usi lo streaming o il tuo endpoint non supporta lo streaming, AnythingLLM include un’impostazione per disabilitare lo streaming per Generic OpenAI.

Checklist di sicurezza e operativa

- Tratta la chiave CometAPI come qualsiasi altro segreto — non effettuarne il commit nei repo; conservala in keychain del sistema operativo o variabili d’ambiente quando possibile.

- Se prevedi di usare documenti sensibili in RAG, assicurati che le garanzie di privacy dell’endpoint soddisfino le tue esigenze di compliance (controlla documentazione/termini di CometAPI).

- Decidi limiti di token massimi e della finestra di contesto per evitare costi incontrollati.

Come configurare AnythingLLM per usare CometAPI (passo dopo passo)

Di seguito una sequenza concreta di passaggi — seguita da variabili d’ambiente di esempio e snippet di codice per testare la connessione prima di salvare le impostazioni nell’interfaccia di AnythingLLM.

Passaggio 1 — Ottieni la tua chiave CometAPI

- Registrati o accedi a CometAPI.

- Vai su “API Keys” e genera una chiave — otterrai una stringa simile a

sk-xxxxx. Conservala segreta.

Passaggio 2 — Verifica che CometAPI funzioni con una richiesta rapida

Usa curl o Python per chiamare un semplice endpoint di chat completions e confermare la connettività.

Esempio curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Se ricevi un 200 e una risposta JSON con un array choices, la tua chiave e la rete funzionano. (La documentazione di CometAPI mostra la superficie e gli endpoint in stile OpenAI).

Esempio Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

Passaggio 3 — Configura AnythingLLM (UI)

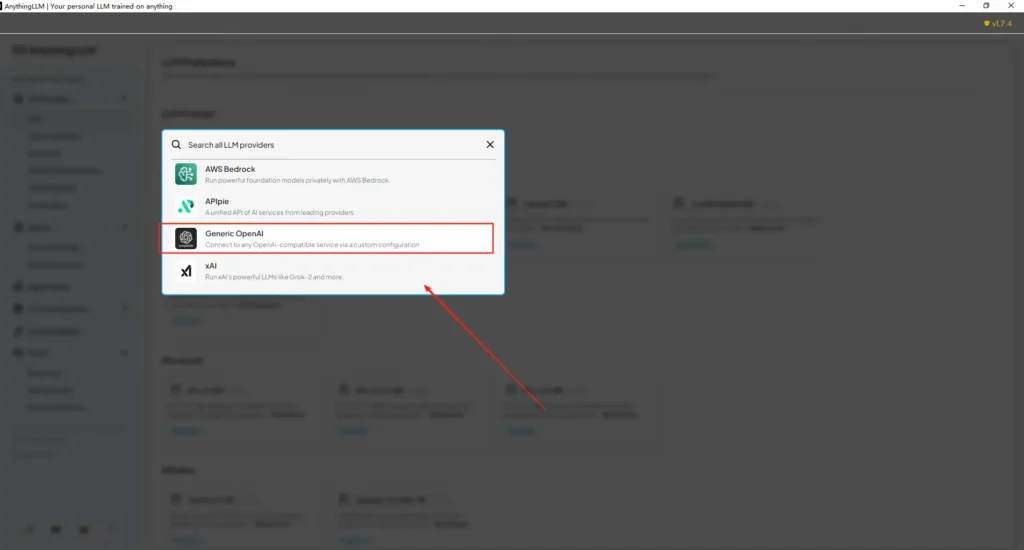

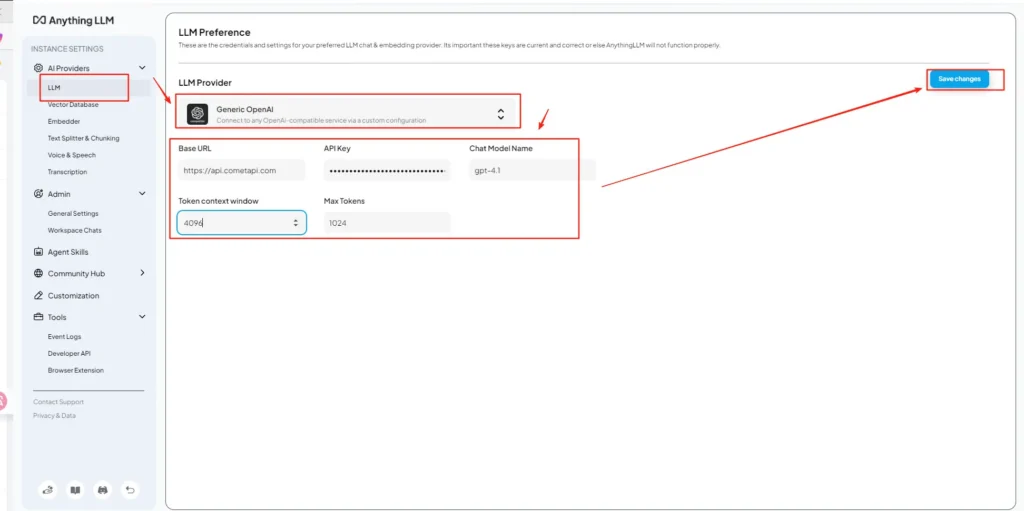

Apri AnythingLLM → Settings → AI Providers → LLM Preferences (o percorso simile nella tua versione). Usa il provider Generic OpenAI e compila i campi come segue:

API Configuration (example)

• Entra nel menu delle impostazioni di AnythingLLM, trova LLM Preferences sotto AI Providers.

• Seleziona Generic OpenAI come provider del modello, inseriscihttps://api.cometapi.com/v1nel campo URL.

• Incollask-xxxxxda CometAPI nella casella della chiave API. Compila finestra di contesto dei token e Max Tokens in base al modello effettivo. Puoi anche personalizzare i nomi dei modelli in questa pagina, ad esempio aggiungendo il modellogpt-4o.

Questo è in linea con le linee guida “Generic OpenAI” di AnythingLLM (wrapper per sviluppatori) e con l’approccio di CometAPI alla base URL compatibile con OpenAI.

Passaggio 4 — Imposta i nomi dei modelli e i limiti di token

Nella stessa schermata delle impostazioni, aggiungi o personalizza i nomi dei modelli esattamente come pubblicati da CometAPI (ad es., gpt-4o, minimax-m2, kimi-k2-thinking) così che l’interfaccia di AnythingLLM possa presentarli agli utenti. CometAPI pubblica le stringhe dei modelli per ciascun vendor.

Passaggio 5 — Test in AnythingLLM

Avvia una nuova chat o usa un workspace esistente, seleziona il provider Generic OpenAI (se ne hai più di uno), scegli uno dei nomi modello di CometAPI che hai aggiunto ed esegui un prompt semplice. Se ottieni completamenti coerenti, l’integrazione è riuscita.

Come AnythingLLM usa internamente queste impostazioni

Il wrapper Generic OpenAI di AnythingLLM costruisce richieste in stile OpenAI (/v1/chat/completions, /v1/embeddings), quindi una volta impostata la base URL e fornita la chiave CometAPI, AnythingLLM instraderà in modo trasparente chat, chiamate degli agenti e richieste di embedding tramite CometAPI. Se usi gli agenti di AnythingLLM (i flussi @agent), erediteranno lo stesso provider.

Quali sono le best practice e le possibili insidie?

Best practice

- Usa impostazioni di contesto appropriate al modello: Allinea la finestra di contesto dei token e i Max Tokens di AnythingLLM al modello scelto su CometAPI. Un disallineamento porta a troncamenti inattesi o chiamate fallite.

- Proteggi le tue chiavi API: Conserva le chiavi CometAPI in variabili d’ambiente e/o in sistemi di segreti (Kubernetes/secret manager); non inserirle in git. AnythingLLM memorizzerà le chiavi nelle impostazioni locali se le inserisci dall’interfaccia — considera l’host storage come sensibile.

- Inizia con modelli più economici/piccoli per i flussi di prova: Usa CometAPI per testare modelli a basso costo in sviluppo, riservando quelli premium per la produzione. CometAPI pubblicizza espressamente lo switching sui costi e la fatturazione unificata.

- Monitora l’uso e imposta avvisi: CometAPI fornisce dashboard di utilizzo — imposta budget/alert per evitare costi inattesi.

- Testa agenti e strumenti in isolamento: Gli agenti di AnythingLLM possono attivare azioni; testali con prompt sicuri e prima su istanze di staging.

Insidie comuni

- Conflitti tra UI e

.env: In self-hosting, le impostazioni dell’interfaccia possono sovrascrivere le modifiche a.env(e viceversa). Controlla il/app/server/.envgenerato se qualcosa torna allo stato precedente dopo un riavvio. La community riporta reset diLLM_PROVIDER. - Mancata corrispondenza nei nomi dei modelli: Usare un nome modello non disponibile su CometAPI causerà un 400/404 dal gateway. Conferma sempre i modelli disponibili nell’elenco modelli di CometAPI.

- Limiti di token e streaming: Se ti serve lo streaming delle risposte, verifica che il modello CometAPI lo supporti (e che la versione dell’interfaccia di AnythingLLM lo supporti). Alcuni provider differiscono per le modalità di streaming.

Quali casi d’uso reali abilita questa integrazione?

Retrieval-Augmented Generation (RAG)

Usa i loader di documenti + vector DB di AnythingLLM con gli LLM di CometAPI per generare risposte contestualizzate. Puoi sperimentare con embedding economici + modelli di chat più costosi, oppure mantenere tutto su CometAPI per una fatturazione unificata. I flussi RAG di AnythingLLM sono una funzionalità principale integrata.

Automazione con agenti

AnythingLLM supporta flussi @agent (navigare pagine, chiamare strumenti, eseguire automazioni). Instradare le chiamate LLM degli agenti tramite CometAPI ti offre scelta di modelli per passaggi di controllo/interpretazione senza modificare il codice dell’agente.

A/B test multi-modello e ottimizzazione dei costi

Cambia modello per workspace o funzionalità (ad es., gpt-4o per risposte in produzione, gpt-4o-mini per sviluppo). CometAPI rende banali gli switch di modello e centralizza i costi.

Pipeline multimodali

CometAPI fornisce modelli per immagini, audio e casi specializzati. Il supporto multimodale di AnythingLLM (tramite provider) più i modelli di CometAPI abilita didascalie di immagini, sintesi multimodale o trascrizione audio attraverso la stessa interfaccia.

Conclusione

CometAPI continua a posizionarsi come gateway multi-modello (500+ modelli, API in stile OpenAI) — rendendolo un partner naturale per app come AnythingLLM che già supportano un provider Generic OpenAI. Allo stesso modo, il provider Generic di AnythingLLM e le opzioni di configurazione recenti rendono semplice il collegamento a tali gateway. Questa convergenza semplifica la sperimentazione e la migrazione in produzione a fine 2025.

Come iniziare con Comet API

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di IA dai principali provider — come la serie GPT di OpenAI, Gemini di Google, Claude di Anthropic, Midjourney, Suno e altri — in un’unica interfaccia facile per gli sviluppatori. Offrendo autenticazione, formattazione delle richieste e gestione delle risposte coerenti, CometAPI semplifica enormemente l’integrazione di funzionalità IA nelle tue applicazioni. Che tu stia costruendo chatbot, generatori di immagini, compositori musicali o pipeline analitiche basate sui dati, CometAPI ti permette di iterare più rapidamente, controllare i costi e restare vendor-agnostic — attingendo al contempo alle ultime innovazioni dell’ecosistema IA.

Per iniziare, esplora le capacità dei modelli di CometAPI nel Playground e consulta la guida alle API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre prezzi molto inferiori rispetto a quelli ufficiali per aiutarti a integrare.

Pronto a partire?→ Registrati a CometAPI oggi stesso!

Se vuoi altri consigli, guide e notizie sull’IA, seguici su VK, X e Discord!