MiniMax-M2.5 è un nuovo modello linguistico di grandi dimensioni di MiniMax, orientato alla produttività e ottimizzato per il coding, l’uso agentico degli strumenti e i flussi di lavoro d’ufficio. Puoi richiamarlo tramite la piattaforma nativa di MiniMax oppure tramite aggregatori di API come CometAPI. Per usare l’API ti basta ottenere la chiave API di CometAPI, poiché MiniMax-M2.5 supporta anche il formato chat.

What is MiniMax-M2.5?

MiniMax-M2.5 è l’ultima major release di MiniMax: un’evoluzione della famiglia M2 che l’azienda posiziona come un modello general-purpose, agent-capable, con prestazioni particolarmente solide in generazione di codice, uso degli strumenti e ragionamento multi-step. La famiglia M2.5 è stata annunciata come release di febbraio 2026 e include sia la variante standard M2.5 sia varianti “highspeed” ottimizzate per bassa latenza mantenendo le stesse capacità di base. La famiglia M2.5 ha migliorato i punteggi di benchmark nelle valutazioni di ingegneria del software e un comportamento migliore quando interagisce con strumenti esterni (search, agenti, ecc.).

Il fornitore posiziona M2.5 come un passo avanti rispetto alle precedenti release M2.x con un ragionamento più forte, una migliore generazione di codice e una maggiore affidabilità nel tool-calling. Le note di rilascio pubbliche di MiniMax di inizio febbraio 2026 hanno evidenziato M2.5 come una pietra miliare: un tuning delle istruzioni più raffinato, una comprensione del codice più solida e guadagni misurabili su diversi benchmark focalizzati sul codice. La release include:

- Un modello M2.5 standard (con enfasi su accuratezza e ragionamento).

- Una variante M2.5-highspeed con latenza inferiore per workflow interattivi degli sviluppatori.

- Indicazioni esplicite e opzioni di billing per un “Coding Plan” pensato per un uso intensivo di generazione di codice.

Key technical highlights

- Architettura: MoE (ampio numero totale di parametri con un set attivo molto più piccolo durante l’inferenza), che abilita un buon compromesso costi/prestazioni per i carichi pesanti.

- Punti di forza: prestazioni all’avanguardia nel coding, ragionamento multi-turn, gestione di contesti lunghi e integrazioni con agenti/strumenti.

- Varianti: MiniMax pubblica varianti (ad es.

MiniMax-M2.5eM2.5-highspeed) ottimizzate rispettivamente per throughput e latenza.

Perché è importante oggi: molti team che costruiscono strumenti per sviluppatori, assistenti di programmazione e automazioni agentiche apprezzano un modello che sappia ragionare su più turni, chiamare strumenti in modo sicuro ed emettere codice di alta qualità. M2.5 — in virtù di scelte architetturali e di training — è esplicitamente commercializzato per questi scenari.

Benchmarking of MiniMax-M2.5

Where M2.5 lands on coding-specific benchmarks

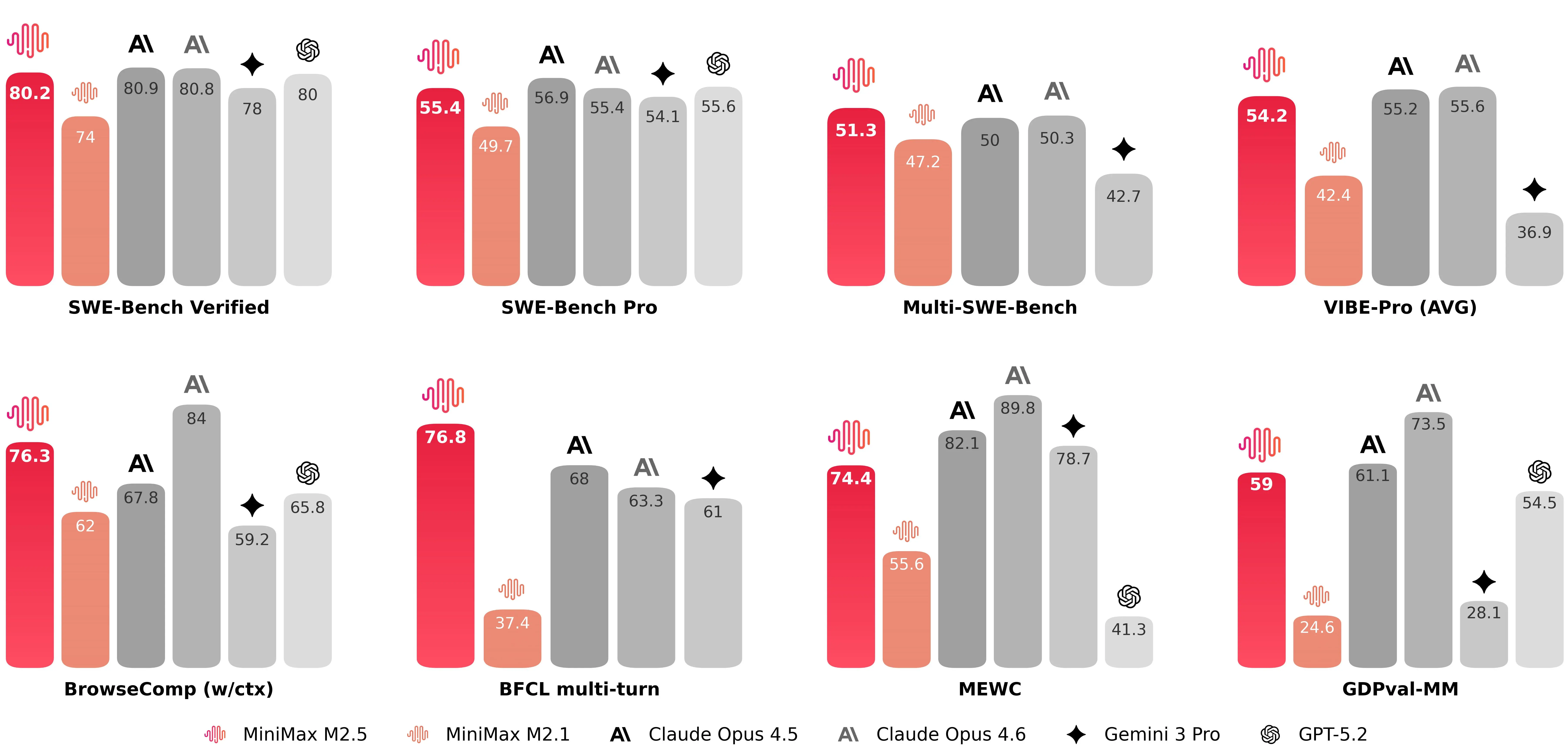

MiniMax-M2.5 ha ottenuto un punteggio del 80,2% su SWE-Bench Verified, insieme a risultati solidi su benchmark di coding multi-task e potenziati dalla navigazione (valori notevoli pubblicati dall’azienda includono 51,3% su Multi-SWE-Bench e 76,3% su BrowseComp quando la gestione del contesto è abilitata). Questi numeri collocano M2.5 tra i modelli pubblicamente disponibili con le migliori prestazioni per generazione di codice e problem solving al lancio. Il lancio di MiniMax-M2.5 conferma che M2.5 compete con la fascia alta dei modelli di coding.

Per gli sviluppatori, i vantaggi sono due:

- Maggiore successo al primo tentativo: meno cicli di correzioni, meno debugging manuale e minore “tutoring” per agenti di coding autonomi.

- Migliore copertura full‑stack: M2.5 è descritto come in grado di supportare workflow full‑stack per app desktop, mobile e toolchain cross‑platform, puntando a generare non solo snippet ma soluzioni coerenti multi‑file e script di build.

Built for agentic workflows

M2.5 è descritto come “nativamente progettato per scenari Agent”. In pratica, ciò significa che l’architettura e il regime di training danno priorità a:

- Fedeltà nell’invocazione degli strumenti: emissione di chiamate API o esecuzione di comandi shell/SQL con sintassi e parametri corretti.

- Cambio di contesto e memoria: prosecuzione di un’operazione multi-step interrotta senza perdere lo stato calcolato in precedenza.

- Manipolazione di file: produzione ed editing programmatico dei formati d’ufficio comuni (ad esempio, generare una presentazione PowerPoint e poi rivederla sulla base di una richiesta successiva).

Search and browsing augmentation

Quando M2.5 è abbinato a livelli di browsing o retrieval, MiniMax riporta miglioramenti marcati sui benchmark di navigazione, riflettendo prestazioni più forti nell’integrare informazioni esterne e citazioni negli output. Questo rende M2.5 adatto per strumenti che devono recuperare contenuti aggiornati, verificare i risultati delle API o potenziare la generazione di codice con dati reali (ad esempio, recuperare la documentazione SDK più recente e usarla correttamente durante la codegen). Queste capacità sono importanti per team che costruiscono funzionalità “agentiche” come QA automatizzato, pipeline CI o assistenti guidati da documenti.

How can I use MiniMax-2.5 API (via CometAPI)?

CometAPI è una piattaforma di aggregazione di API che espone centinaia di modelli tramite un’unica superficie REST compatibile con OpenAI. Poiché l’interfaccia di CometAPI rispecchia gli endpoint chat/completions di OpenAI, spesso puoi riutilizzare i client in stile OpenAI esistenti cambiando api_base e la chiave API. Se preferisci non integrare direttamente con la piattaforma di MiniMax (per motivi come billing unificato, A/B testing multi‑modello o astrazione del fornitore), puoi chiamare MiniMax-M2.5 tramite la superficie “chat” di CometAPI. La piattaforma CometAPI fornisce un formato di richiesta coerente, un SDK e un web playground — ed espone i nomi e i parametri per singolo modello (così puoi selezionare l’esatto provider/model string in chiamata).

Di seguito una guida concisa e pratica per chiamare MiniMax-M2.5 tramite CometAPI, con esempi in curl e Python.

What are the basic steps to get started?

- Iscriviti a un account CometAPI e ottieni una chiave API. (CometAPI fornisce un playground e SDK per testare i modelli.)

- Controlla l’elenco dei modelli di CometAPI o il playground di CometAPI per trovare il nome esatto del modello per MiniMax-M2.5.

- Effettua una richiesta POST autenticata con il parametro

modelimpostato sul modello MiniMax selezionato e un payload che segua lo schema chat/completion di CometAPI. - Regola i parametri (temperature, max_tokens, system messages, streaming) in base al tuo workflow.

Authentication & endpoint basics

- Base URL:

https://api.cometapi.com/v1(sono supportati i percorsi in stile OpenAI come/chat/completions). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Campo model: usa esattamente la stringa del modello dal catalogo di CometAPI (esempi:

"minimax-m2.5")

Example 1 — Quick curl (REST, OpenAI-style)

// Sostituisci $COMETAPI_KEY con la tua chiave CometAPI

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Note:

- Usa la stringa del modello esattamente come mostrato nel catalogo di CometAPI.

stream: trueè supportato per output in streaming (gestisci server‑sent events o risposte chunked se desideri token parziali).

Example 2 — Python (requests) for a chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Example 3 — Using litellm / CometAPI integration (Python convenience layer)

CometAPI è supportato da diversi SDK e adapter della community. La documentazione di liteLLM mostra un flusso compatto in cui imposti COMETAPI_KEY e chiami il modello per nome. È ottimo per prototipare:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Le integrazioni Litellm / Comet forniscono utilità utili (streaming, async, parametro esplicito api_key) che rispecchiano molti pattern degli SDK OpenAI esistenti.

How should you design prompts and system messages for M2.5

Be explicit about role and constraints

Dai a M2.5 un ruolo di sistema chiaro quando chiedi codice. Esempio:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Use step decomposition for complex problems

Quando chiedi a M2.5 di implementare funzionalità complesse, usa una breve decomposizione:

- Richiedi uno schema di progettazione.

- Richiedi le firme delle interfacce.

- Richiedi implementazione e test.

Questo riduce il rischio di allucinazioni e produce output modulari e revisionabili.

Temperature, max_tokens and safety

- Per codice deterministico: imposta

temperaturevicino a 0,0. - Per design esplorativi:

temperaturetra 0,2 e 0,5 può far emergere approcci creativi. - Mantieni

max_tokensgeneroso per grandi refactor o suite di test lunghe.

Ask for unit tests and reasoning

Quando richiedi codice, chiedi anche unit test e una breve spiegazione dell’algoritmo. Questo aiuta a rilevare bug sottili e a ottenere artefatti eseguibili al primo tentativo.

Long-Task Inference and State Tracking

Il modello M2.5 presenta un eccellente meccanismo di tracciamento dello stato, garantendo efficacemente la continuità e la direzionalità del pensiero su sequenze temporali lunghe concentrandosi ogni volta su un numero limitato di obiettivi invece di processare tutto in parallelo. M2.5 è dotato di funzionalità sensibili al contesto, che consentono un’esecuzione efficiente dei compiti e una gestione del contesto ottimizzata.

Practical M2.5 usage tips for production

MiniMax-M2.5 è ottimizzato per toolings multi‑step e codice. Di seguito alcuni suggerimenti pratici, basati sull’esperienza, per ottenere i migliori risultati in produzione.

Prompt engineering & system messages

- Usa messaggi di sistema espliciti per ruolo e vincoli. Per attività di coding, includi runtime/framework di test richiesti (ad es., “Restituisci un pytest compatibile con Python 3.11”).

- Fornisci contesto: per job agentici o multi‑step includi metadati dei passi e descrizioni degli strumenti come JSON strutturato o elenchi puntati. M2.5 risponde bene a input strutturati perché è ottimizzato per l’uso degli strumenti.

Function / tool calling

- Se usi CometAPI come gateway per il tool‑calling, assicurati che i campi extra (ad es.,

function_callin stile OpenAI) corrispondano alle aspettative di CometAPI/modello. Conferma il supporto del modello sulla pagina del modello Comet poiché le semantiche degli strumenti possono variare tra provider. - Per un’orchestrazione robusta, suddividi i compiti ampi in chiamate più piccole e mantieni checkpoint deterministici. M2.5 è forte nel seguire istruzioni multi‑step, ma otterrai il comportamento più affidabile validando dopo ogni passo.

Temperature, max_tokens, and cost control

- Per generazione o refactoring di codice, imposta

temperaturebassa (0,0–0,2) e usamax_tokensin linea con la dimensione attesa dell’output. - Per prompt esplorativi, aumenta

temperaturema monitora il maggior consumo di token. Quando instradi via CometAPI, confronta i prezzi del provider e le regole di fallback — CometAPI elenca il pricing per token per istanza modello nel suo catalogo.

Context window & long documents

- Le varianti M2.5 spesso supportano contesti lunghi (controlla la specifica del modello per la lunghezza del contesto). Per documenti molto lunghi, segmenta e riassumi — quindi fornisci i riassunti più i chunk rilevanti, invece di inviare interi file in una sola chiamata.

Safety, toxic content, and hallucination mitigation

- Usa guardrail: messaggi di sistema, validator esterni e suite di test (ad es., unit test per il codice generato) riducono il rischio.

- Valida i riferimenti esterni: se il modello cita fatti o codice dal web, verifica in modo programmatico prima di fidarti o distribuire i risultati.

What are common pitfalls and how to avoid them

Pitfall: Overtrusting a single model output

Mitigation: Esegui test, controlli statici e, per la logica critica, richiedi più completamenti indipendenti e confrontali. CometAPI consente di passare tra più modelli, e puoi passare da uno all’altro in qualsiasi momento usando il formato chat di OpenAI.

Pitfall: Using high temperature for production code

Mitigation: Mantieni temperature bassa; se ti servono alternative creative, richiedi più varianti a bassa temperature o chiedi al modello di spiegare le differenze.

Pitfall: Ignoring model versioning

Mitigation: Tieni traccia dei nomi dei modelli e delle stringhe del provider nei manifest di deployment. Quando passi da MiniMax-M2.5 a MiniMax-M2.5-highspeed o a un altro provider, trattalo come un cambio di release ed esegui test di regressione.

Final recommendations and realistic expectations

MiniMax-M2.5 è un passo avanti significativo per gli LLM orientati al codice e agli agenti — promette una forte generazione di codice, ragionamento multi‑turn e comportamento sicuro nel tool‑calling. Se le priorità del tuo team sono costruire strumenti per sviluppatori robusti, framework per agenti o assistenti di coding, M2.5 merita un posto nella tua matrice di confronto. Usare CometAPI come gateway unificato può accelerare la sperimentazione e consentirti di cambiare provider o fare A/B test tra modelli senza dover rifattorizzare l’intera integrazione.

Alcuni spunti pragmatici:

- Prototipa rapidamente usando il Playground di CometAPI, poi blocca gli identificatori di modello nel codice.

- Usa una

temperaturebassa, richiedi test e spiegazioni, ed esegui sempre una validazione automatizzata. - Considera il modello come un potente co‑developer — non infallibile: applica revisione umana, pipeline CI e telemetria.

Gli sviluppatori possono accedere a MiniMax-M2.5 tramite CometAPI fin da ora. Per iniziare, esplora le capacità del modello nel Playground e consulta la Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo molto inferiore a quello ufficiale per aiutarti nell’integrazione.

Pronto a iniziare?→ Registrati a M2.5 oggi !

Se vuoi conoscere altri suggerimenti, guide e notizie sull’IA, seguici su VK, X e Discord!