Nano Banana 2 — l’abbreviazione usata dalla community per il più recente modello di generazione di immagini di Google nella famiglia Gemini — ha rapidamente ridefinito le aspettative per una generazione e un editing di immagini rapidi e ad alta fedeltà. Lanciata a fine febbraio 2026, questa variante “Flash Image” (Gemini 3.1 Flash Image / Nano Banana 2) è pensata per sviluppatori e team di prodotto che necessitano di output di livello professionale con alto throughput e bassa latenza. In questo articolo combino gli ultimi report e la documentazione per spiegare cos’è Nano Banana 2, come si comporta nei benchmark, come accedervi e chiamarla (anche tramite gateway di terze parti come CometAPI) e modelli pratici di prompt e d’uso che puoi adottare in produzione.

CometAPI fornisce un’unica interfaccia in stile HTTP che espone molti modelli (inclusi i modelli di immagini) tramite endpoint coerenti. Questo può semplificare il passaggio tra vendor o la combinazione di output da più modelli. Nano Banana 2 (Gemini 3.1 Image) è disponibile su CometAPI.

Cos’è Nano Banana 2?

Nano Banana 2 (allineata internamente con Gemini 3.1 Flash Image) è un modello di generazione di immagini focalizzato e ad alta efficienza di Google che privilegia velocità, costo per immagine inferiore e maggiore aderenza alle istruzioni per attività creative ed editoriali. È progettato per affiancare varianti “Pro” di qualità superiore: Nano Banana 2 per alto throughput e Nano Banana Pro (Gemini 3 Pro Image) per output premium, di livello asset.

È pensata per offrire:

- Inferenza veloce (puntando a una latenza molto bassa così che generazione ed editing sembrino quasi istantanei).

- Alta qualità visiva che si avvicina alla famiglia “Pro” ma con minore compute/costo.

- Miglior rispetto delle istruzioni (resa più accurata dei soggetti richiesti, testo nell’immagine e scene con più personaggi).

- Ampio supporto di risoluzioni e formati di rapporto, dalle piccole anteprime rapide fino a pipeline native 2K/4K per asset finali.

Cosa rende Nano Banana 2 diversa dalla Nano Banana originale / Pro?

- Architettura / motore: Basata sullo stack di inferenza Flash di Gemini (Gemini 3.1 Flash Image), scambia alcune impostazioni di qualità massimale per notevoli miglioramenti in velocità e costi.

- Use case: Ideale per automazione su larga scala (asset marketing, thumbnail, UI), editing quasi in tempo reale e flussi in cui latenza e costo contano ma serve comunque una fedeltà del soggetto di livello Pro.

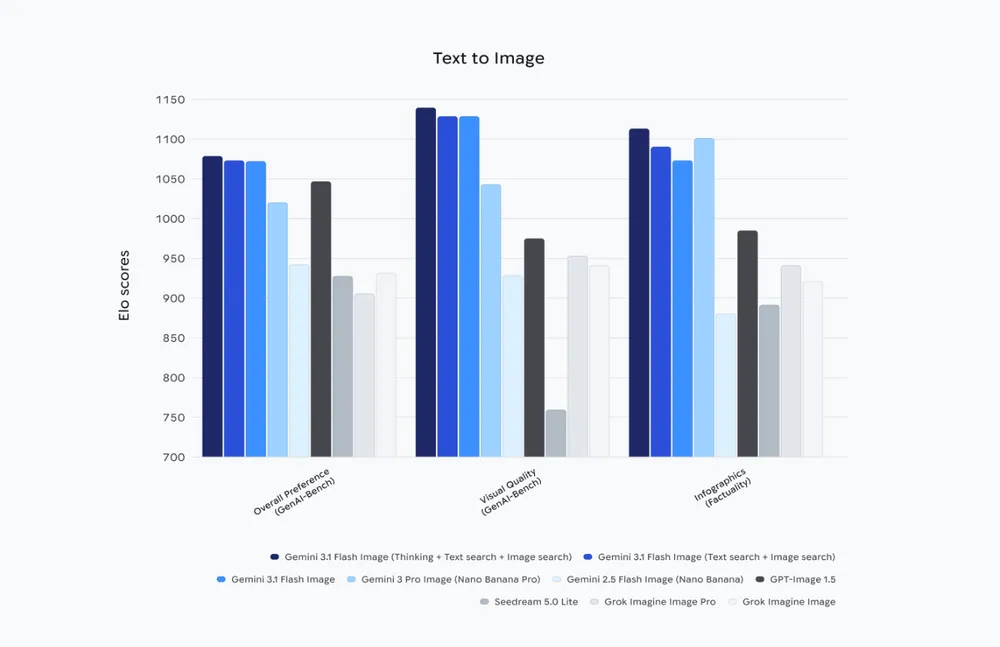

Prestazioni di benchmark di Nano Banana 2

Coerente tra le categorie

Gemini 3.1 Flash Image mostra miglioramenti misurabili in ogni categoria riportata rispetto a Gemini 2.5 Flash.

Miglioramenti più marcati

- Qualità visiva

- Editing composito con input multipli

- Robustezza generale nell’editing

Posizionamento competitivo

- Guida le preferenze complessive nel GenAI-Bench interno.

- Supera GPT-Image 1.5 nelle metriche complessive e visive.

- Miglioramenti incrementali limitati suggeriscono un affinamento architetturale piuttosto che un cambio radicale.

Come posso accedere a Nano Banana 2?

Dove è disponibile

Nano Banana 2 è accessibile tramite gli strumenti Gemini di Google (Gemini app), la Gemini API (documentata nelle guide per sviluppatori AI di Google) ed è resa disponibile attraverso prodotti cloud enterprise come Vertex AI per integrazioni in anteprima/enterprise. CometAPI ha inoltre annunciato supporto e wrapper per facilitare l’integrazione.

Come usare l’API di Nano Banana 2 (CometAPI): quali sono le opzioni?

La guida di CometAPI usa una forma

generateContentin stile Gemini e restituisce immagini come Base64 incandidates[0].content.parts[].inline_data.data. Devi decodificare quel Base64 per salvare un file lato client.,Devi solo sostituirehttps: //generativelanguage.googleapis.comconhttps://api.cometapi.com. L’immagine restituita viene solitamente fornita comeinline_datacodificata in Base64. Dovrai decodificarla lato client e salvarla come file. CometAPI offre sconti che ti aiutano a usare l’API di Nano Banana 2.

CometAPI fornisce un wrapper REST unificato e endpoint espliciti per i modelli Gemini — ideale se preferisci un’unica credenziale e desideri cambiare provider senza modificare il codice della tua applicazione. Per Nano Banana 2, la pagina CometAPI include uno snippet curl diretto per l’endpoint gemini-3.1-flash-image-preview:generateContent. Di seguito un esempio curl ripulito basato sulla documentazione CometAPI.

Prerequisiti per usare Nano Banana 2 tramite CometAPI

Account CometAPI & API Key: Crea un account su CometAPI e genera la tua chiave di accesso API (sk-…). Questa chiave verrà usata per autenticare tutte le richieste agli endpoint di CometAPI.

Linguaggi e runtime:

- Node.js 18+ (per JavaScript/TypeScript)

- Python 3.10+

- (O qualsiasi linguaggio in grado di effettuare richieste HTTP)

Strumenti HTTP o SDK:

- Per JavaScript:

fetch,axioso il client compatibile con OpenAI - Per Python:

requests,httpxo il client OpenAI - Questi strumenti ti aiutano a inviare chiamate API e gestire le risposte.

Panoramica rapida del pattern di richiesta

- Base URL:

https://api.cometapi.com(base CometAPI). - Nomi dei modelli:

gemini-3.1-flash-image-preview(Nano Banana 2 / gemini 3.1 Flash Image) ogemini-2.5-flash-imagea seconda della disponibilità. - Auth: header

Authorization: sk-xxxx— CometAPI usa tipicamente una chiave in stilesk-. - Risposta: le immagini sono restituite come Base64 sotto

response.candidates[0].content.parts[].inline_data.data. Decodifica e scrivi su disco.

Esempio di workflow (alto livello)

- Ottieni una API key da CometAPI.

- Scegli l’identificatore del modello (es.

gemini-3.1-flash-imageo simile, in base alla disponibilità). - Invia una POST all’endpoint di generazione del modello con il tuo prompt.

- Gestisci i dati immagine restituiti nella tua app (decodifica base64, servi come PNG, ecc.).

- Per editing di immagini, includi i dati dell’immagine esistente e le istruzioni di modifica nella richiesta.

Uso dell’API ufficiale di Gemini (testo → immagine)

Di seguito un breve esempio Node.js che mostra come chiamare l’endpoint generateContent di Gemini per gemini-3.1-flash-image-preview (rispecchia gli snippet ufficiali nella documentazione). Sostituisci YOUR_API_KEY con la tua credenziale e aggiungi gestione degli errori per la produzione.

# Get your CometAPI key from https://api.cometapi.com/console/token

# Export it as: export COMETAPI_KEY="your-key-here"

mkdir -p ./output

curl -s "https://api.cometapi.com/v1beta/models/gemini-3.1-flash-image-preview:generateContent" \

-H "Authorization: $COMETAPI_KEY" \

-H 'Content-Type: application/json' \

-X POST \

-d '{

"contents": [

{

"role": "user",

"parts": [

{

"text": "A woman leaning on a wooden railing of a traditional Chinese building. She is wearing a blue cheongsam with pink and red floral motifs and a headdress made of colorful flowers, including roses and lilacs. Realistic painting style, focusing on the textural details of the clothing patterns and wooden buildings."

}

]

}

],

"generationConfig": {

"responseModalities": ["IMAGE"],

"imageConfig": {

"aspectRatio": "9:16"

}

}

}' | python3 -c "

import sys, json, base64

data = json.load(sys.stdin)

parts = data['candidates'][0]['content']['parts']

for part in parts:

if 'text' in part:

print(part['text'])

elif 'inlineData' in part:

img = base64.b64decode(part['inlineData']['data'])

with open('./output/gemini-3.1-flash-image-preview.png', 'wb') as f:

f.write(img)

print('Image saved to ./output/gemini-3.1-flash-image-preview.png')

"

CometAPI fornisce SDK e wrapper compatibili con il client OpenAI, quindi alcuni team possono cambiare provider con modifiche minime al codice, consentendoti di richiedere output di immagini codificati in Base64 o URL ospitati a seconda della configurazione. Verifica sempre lo schema ufficiale di generateContent per i campi di payload esatti.

Flusso Immagine→Immagine (modifica)

Per modificare un’immagine esistente:

- Converti la tua immagine sorgente in Base64 (senza il prefisso

data:image/...;base64,). - Esegui una POST con un payload che includa

inline_data.datacontenente quella stringa Base64 e un prompt di editing (es. “cambia lo sfondo in cielo al crepuscolo, rimuovi watermark”). - La risposta includerà un nuovo output Base64 da decodificare e salvare.

curl

--location

--request POST 'https://api.cometapi.com/v1beta/models/gemini-3.1-flash-image-preview:generateContent' \

--header 'Authorization: ' \

--header 'Content-Type: application/json' \

--data-raw '{ "contents":

[ { "role": "user", "parts":

[ { "text": "Blend three images to output a high-resolution image" }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_first_image_base64_data_here>" } }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_second_image_base64_data_here>" } }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_third_image_base64_data_here>" } }

] }

], "generationConfig": { "responseModalities": [ "TEXT", "IMAGE"

] } }'

Parametri tipici da ottimizzare

model: scegligemini-3.1-flash-image-preview(Nano Banana 2) ogemini-3-pro-image-preview(Pro).imageConfig.aspect_ratioeimageConfig.image_size(512,1K,2K,4K) — influiscono su costo e latenza.responseModalities:["Image"]o["Text","Image"]per flussi multimodali.

Come dovrei creare prompt per Nano Banana 2?

Il prompt engineering per i modelli di immagini combina composizione, stile, suggerimenti di camera/illuminazione e dichiarazioni di vincoli. Nano Banana 2 è ottimizzata per seguire le istruzioni in modo affidabile, quindi bilancia brevità ed esplicità.

Struttura del prompt (raccomandata)

- Soggetto principale: chi/cosa è nell’immagine.

- Azione o stato: cosa fa il soggetto.

- Ambiente e mood: contesto, illuminazione, atmosfera.

- Direttive tecniche: lente, aspect ratio, risoluzione, composizione.

- Stile e riferimenti: stile artistico, riferimenti ad artisti (attenzione alle regole sul copyright), epoca.

- Vincoli: numero di personaggi/oggetti, evita certi colori, includi testo leggibile.

Prompt di esempio:

“Un’immagine fotorealistica di una piccola banana gialla a forma di razzo vintage, poggiata su un tavolo in mogano lucido in uno studio illuminato dal sole. Lente 50mm, profondità di campo ridotta, illuminazione calda dell’ora d’oro, alto dettaglio, nessun logo visibile, 2048×1152.”

Suggerimenti per prompt di editing (inpainting / replace)

- Fornisci chiaramente la maschera e specifica quali aree devono cambiare.

- Usa formulazioni “preserve” per le aree da mantenere (es. “preserva i tratti del volto del soggetto, sostituisci solo lo sfondo”).

- Per il testo nelle immagini, indica il testo esatto e specifica font/stile (es. “sans-serif leggibile, allineato al centro”). Nano Banana 2 enfatizza una migliore resa del testo, ma sii esplicito.

Checklist di debug del prompt

- Se l’output è fuori target, prova a semplificare: riduci prima le istruzioni di stile creativo, poi reintroduci i dettagli.

- Se il testo è illeggibile: specifica font, dimensione e contrasto nel prompt e aumenta la risoluzione.

- Se la composizione è errata: usa specifiche di angolo di camera e lente.

Quali sono gli errori comuni e come evitarli?

Errore: affidarsi troppo a prompt “one-shot”

Evita di aspettarti che un singolo prompt gestisca rifilatura, layout e modifiche multi-step. Suddividi il lavoro in: generazione base → modifica/sostituzione → rifinitura finale. Usa seed e maschere per la precisione.

Errore: ignorare provenienza e controlli di copyright

Non distribuire su larga scala senza SynthID/C2PA o altre soluzioni di provenienza. Molte aziende richiedono tracciabilità per contenuti generati dall’AI.

Errore: sorprese di budget

Monitora l’uso a livello di modello ed endpoint e imposta limiti rigidi tramite il provider o un proxy. I tier Flash costano meno ma possono comunque pesare se generi migliaia di immagini 4K involontariamente.

Best practice consigliate con Nano Banana 2

Portare in produzione la generazione di immagini richiede attenzione a costi, latenza, controllo qualità, provenienza e sicurezza. Di seguito pratiche operative basate su report di campo, documentazione Google e test della community.

Prompt engineering & output deterministici

- Templatizza i tuoi prompt: per output ripetibili (es. foto prodotto), usa prompt strutturati con segmenti fissi (soggetto, camera, illuminazione, texture, post-process). Riduce la deriva tra chiamate.

- Usa immagini di riferimento e istruzioni di maschera per le modifiche piuttosto che tentare edit locali complessi solo via testo — riduce errori semantici e artefatti.

Ottimizzazione di costi e performance

- Scegli la modalità Flash/“Nano Banana 2” per alti volumi: Se ti servono molte iterazioni rapide, usa modelli di fascia Flash e dimensioni più piccole (2K vs 4K) per ridurre costo e latenza.

- Batch delle richieste dove possibile: alcuni provider consentono batch multi-prompt — riduce la latenza totale per asset generato in pipeline ad alto throughput. (Verifica la documentazione del provider.)

Sicurezza, provenienza e aspetti legali

- Abilita SynthID e metadati C2PA sugli asset generati per supportare audit e conformità downstream (soprattutto per immagini usate in advertising/PR). Google e partner enfatizzano SynthID come meccanismo di provenienza.

- Revisione umana nel loop per contenuti sensibili: i livelli di policy automatizzati sono robusti ma imperfetti — usa controlli manuali per campagne pubbliche o contenuti che coinvolgono figure pubbliche.

Controllo qualità

- Automatizza i controlli QA: esegui un classifier post-generazione per artefatti inattesi (errori di testo, bassa fedeltà dei volti, creazione accidentale di loghi). Mantieni un sistema di scoring e un fallback sicuro al tier Pro se il controllo automatico fallisce.

- Conserva prompt e seed: per auditabilità e riproducibilità, salva il prompt esatto, timestamp, versione del modello e ogni seed o parametro deterministico usato.

UX sensibile alla latenza

- UX progressiva: restituisci prima una bozza low-res/rapida e sostituiscila con un render high-res/Pro quando pronto. Mantiene la tua app reattiva (molti provider offrono una variante “draft” o Flash).

Note finali e prossimi passi

Nano Banana 2 è pensata per cambiare l’economia dei workflow di produzione orientati alle immagini: latenza più bassa e costo per chiamata inferiore abilitano use case come generazione on-demand di asset pubblicitari, rapido A/B testing creativo e strumenti di design collaborativi in tempo reale. Il modello è già integrato nelle superfici consumer e cloud di Google; per gli sviluppatori che vogliono andare live rapidamente, CometAPI fornisce un wrapper di marketplace che supporta gli endpoint di immagini Gemini insieme ad altri modelli — una scelta pratica quando desideri sperimentare più motori senza cambiare il codice dell’app.

Gli sviluppatori possono accedere a Nano Banana 2 tramite CometAPI già da ora. Per iniziare, esplora le capacità del modello nel Playground e consulta la Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e ottenuto la API key. CometAPI offre un prezzo molto inferiore rispetto a quello ufficiale per aiutarti nell’integrazione.

Pronto a iniziare?→ Iscriviti a Nano Banana 2 oggi !

Se vuoi conoscere altri suggerimenti, guide e novità sull’AI seguici su VK, X e Discord!