Nel panorama in rapida evoluzione dell'intelligenza artificiale, la sinergia tra piattaforme e modelli è fondamentale per lo sviluppo di applicazioni di intelligenza artificiale robuste. Dify, una piattaforma open source per lo sviluppo di applicazioni LLM (Large Language Model), offre funzionalità di integrazione fluida con i potenti modelli di CometAPI. Questo articolo approfondisce le funzionalità di Dify, illustra il processo di integrazione con CometAPI e fornisce spunti su come accedere e ottimizzare questa collaborazione.

Perché integrare Dify con CometAPI?

L'integrazione di Dify con CometAPI combina i punti di forza di entrambe le piattaforme, consentendo agli sviluppatori di:

- Sfrutta modelli linguistici avanzati: Utilizza i modelli LLM di integrati nell'interfaccia intuitiva di Dify.

- Semplifica lo sviluppo delle applicazioni AI: Accelera la transizione dal prototipo alla produzione sfruttando gli strumenti completi di Dify insieme alle capacità di CometAPI.

- Personalizza e controlla le soluzioni AI: Adattare le applicazioni di intelligenza artificiale alle esigenze specifiche mantenendo il controllo sui dati e sui flussi di lavoro.

Che cos'è CometAPI?

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di intelligenza artificiale (IA) di provider leader, come la serie GPT di OpenAI, Gemini di Google, Claude di Anthropic, Midjourney, Suno e altri, in un'unica interfaccia intuitiva per gli sviluppatori. Offrendo autenticazione, formattazione delle richieste e gestione delle risposte coerenti, CometAPI semplifica notevolmente l'integrazione delle funzionalità di IA nelle tue applicazioni. Che tu stia sviluppando chatbot, generatori di immagini, compositori musicali o pipeline di analisi basate sui dati, CometAPI ti consente di iterare più velocemente, controllare i costi e rimanere indipendente dal fornitore, il tutto sfruttando le più recenti innovazioni nell'ecosistema dell'IA.

Che cos'è Dify?

Dificare è una piattaforma open source progettata per semplificare lo sviluppo di applicazioni di intelligenza artificiale basate su modelli linguistici di grandi dimensioni. Integra diverse funzionalità, tra cui flussi di lavoro di intelligenza artificiale, pipeline di Retrieval-Augmented Generation (RAG), funzionalità di agenti, gestione dei modelli e funzionalità di osservabilità, facilitando un percorso fluido dall'ideazione all'implementazione.

Caratteristiche principali di Dify

- Interfaccia intuitiva: Dify offre un'interfaccia intuitiva che semplifica la creazione e la gestione delle applicazioni di intelligenza artificiale.

- Supporto completo del modello: Supporta l'integrazione con numerosi LLM proprietari e open source.

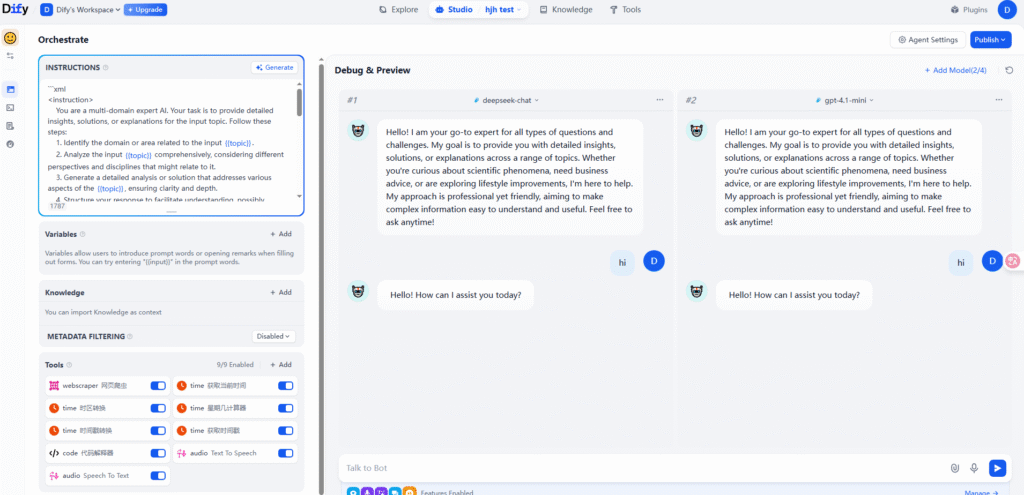

- Richiesta IDE: Dify fornisce strumenti per creare e testare prompt, confrontare le prestazioni dei modelli e migliorare le interazioni delle applicazioni.

- Conduttura RAG:La piattaforma include una solida pipeline RAG per l'inserimento e il recupero dei documenti, supportando vari formati come PDF e PPT.

- Framework dell'agente: Dify consente la definizione di agenti con strumenti predefiniti o personalizzati, estendendo la funzionalità delle applicazioni di intelligenza artificiale.

- LLMOps: Offre strumenti di monitoraggio e analisi per osservare i registri e le prestazioni delle applicazioni, favorendo il miglioramento continuo.

- Backend come servizio: Dify fornisce le API corrispondenti per tutte le sue funzionalità, facilitando l'integrazione nella logica aziendale esistente.

Come funziona Dify?

Dify opera fornendo un ambiente strutturato in cui gli sviluppatori possono creare, testare e distribuire applicazioni AI. La sua architettura supporta l'integrazione di vari modelli di linguaggio, consentendo flessibilità e personalizzazione nello sviluppo delle applicazioni.

Flusso di lavoro in Dify

- Integrazione del modello: Connetti e configura modelli linguistici compatibili con l'API di OpenAI (o altri API di DeepSeek R1, Grok4, modello lama, modelli geimin, ecc.)

- Ingegneria rapida: Sviluppare e perfezionare i prompt utilizzando l'IDE Prompt di Dify per ottenere gli output desiderati.

- Sviluppo di applicazioni: Utilizza gli strumenti di Dify per creare applicazioni, incorporando flussi di lavoro, agenti e pipeline RAG secondo necessità.

- Test e ottimizzazione: Testare le applicazioni in Dify, analizzare i registri delle prestazioni e apportare le modifiche necessarie.

- Distribuzione: Distribuisci l'applicazione, sfruttando i servizi backend e le API di Dify per l'integrazione in sistemi più ampi.

Come integrare Dify con CometAPI?

L'integrazione di Dify con CometAPI prevede diversi passaggi chiave per garantire una connessione fluida tra le piattaforme.

Di seguito è riportato un flusso di lavoro pratico che copre sia l'installazione del nodo CometAPI (plugin) che il suo collegamento ai flussi Dify. Le etichette esatte dell'interfaccia utente potrebbero evolversi, ma questi passaggi riflettono l'attuale schema plugin/marketplace + fornitore di modelli utilizzato da Dify e Flowise.

Passaggio 1: ottieni la tua chiave CometAPI

- Registrati o accedi al tuo Console CometAPI.

- Crea o accedi alla pagina delle chiavi API e copiale

sk-xxxxxchiave per il progetto che utilizzerai. Conservala in un luogo sicuro per i passaggi successivi.

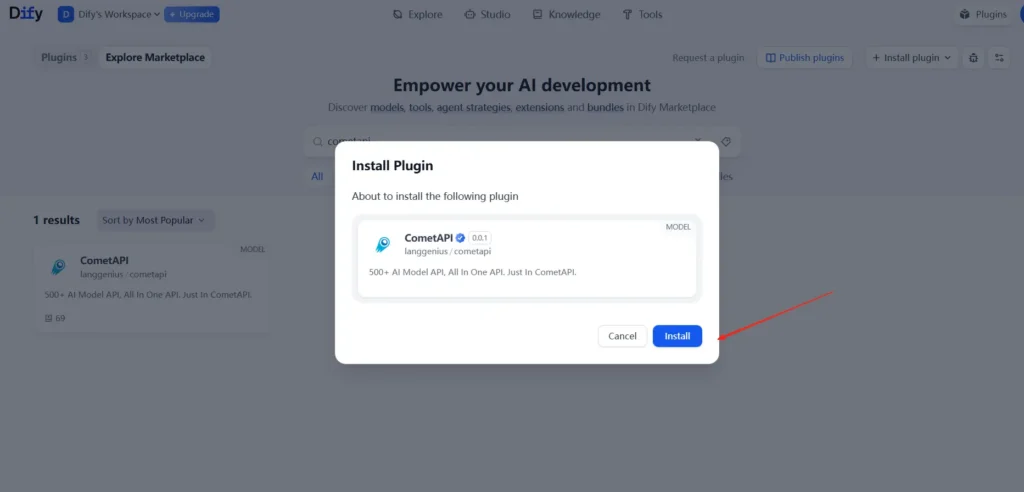

Passaggio 2: installa il plugin CometAPI in Dify

- In Dify, vai a Marketplace or plugin sezione (il marketplace dei plugin di Dify è il punto di ingresso per le integrazioni di terze parti).

- Trovate CometaAPI (o fornitore "Comet" / "CometAPI") e fare clic Installazione.

- Dopo l'installazione, apri la configurazione/impostazioni del plugin per CometAPI all'interno di Dify.

Nota: se la distribuzione Dify è auto-ospitata, potrebbero essere necessari i diritti di amministratore per aggiungere plugin.

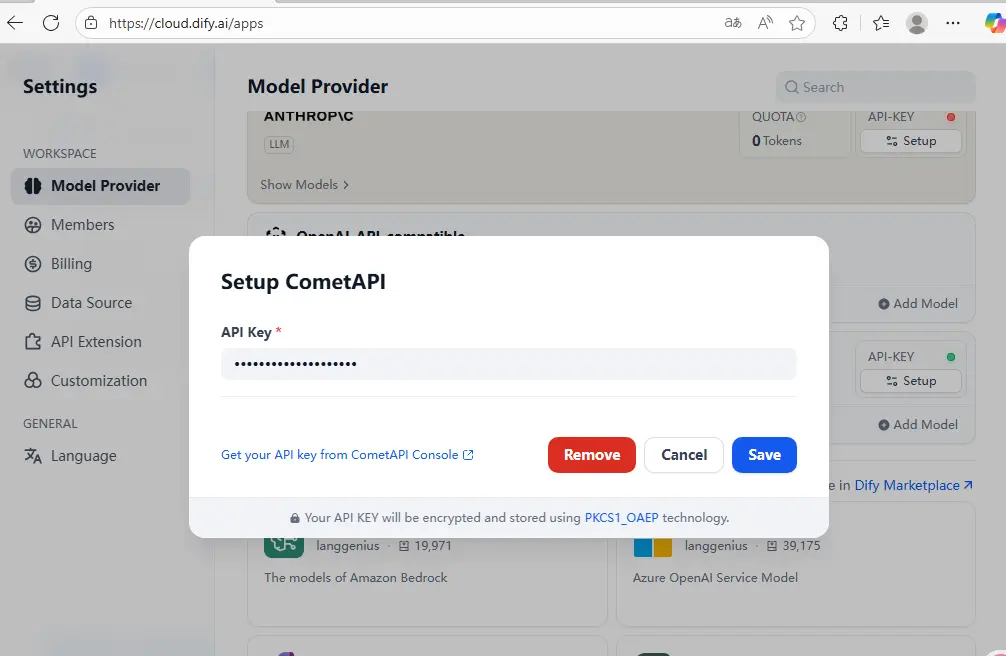

Passaggio 3: configurare il plugin CometAPI in Dify

- Nelle impostazioni del plugin, incolla il tuo

sk-xxxxxChiave API nel API Key / Segreto campo. - Facoltativamente, puoi impostare i modelli predefiniti o le opzioni del provider richieste dal plugin (ad esempio, potresti scegliere una famiglia di modelli predefinita).

- Salva la configurazione del plugin. A questo punto Dify dovrebbe essere in grado di chiamare CometAPI per l'inferenza del modello. (Se Dify fornisce pulsanti di invocazione del test, esegui una breve richiesta di test per confermare la connettività.)

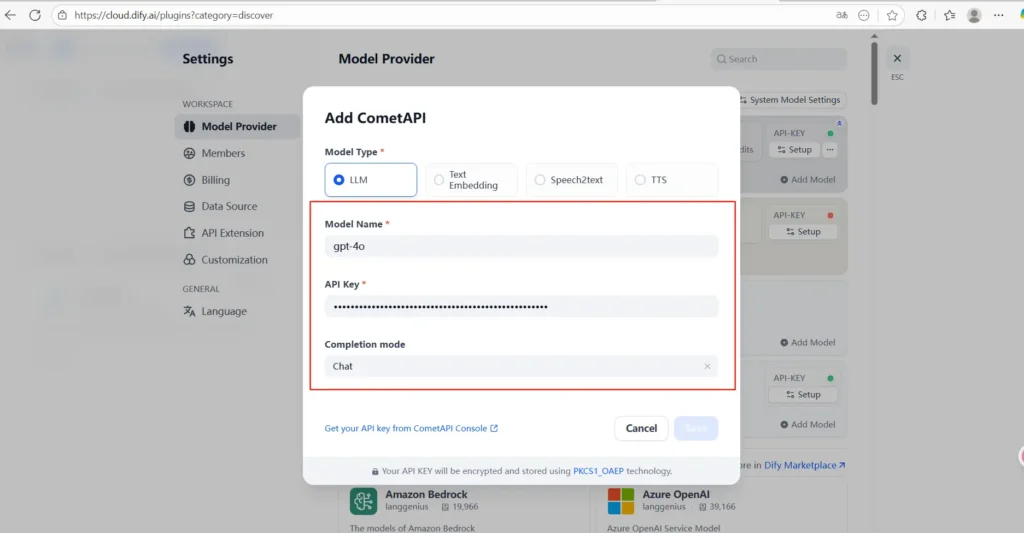

Passaggio 4: aggiungere CometAPI come provider di modelli nei flussi Dify

- Apri o crea il flusso di lavoro/agente Dify che desideri utilizzare.

- Aggiungi un nodo (LLM/Modello) e scegli CometaAPI dall'elenco dei fornitori di modelli (questo è il nodo CometAPI installato tramite il plugin).

- Configura i modelli di prompt, le fonti di contesto (knowledge base RAG) e la temperatura/i parametri come faresti normalmente.

- Testa una conversazione end-to-end: prompt → orchestrazione Dify → modello CometAPI → risposta. Crea un test rapido nell'IDE Prompt di Dify che richiami un modello piccolo ed economico (ad esempio,

o3-minio un nome di modello altrettanto economico supportato da CometAPI) e verificare una risposta di testo normale. Controllare la latenza e la formattazione. - Monitorare i registri: Utilizza gli strumenti di osservabilità di Dify e la dashboard di CometAPI per confermare le richieste/l'utilizzo e rilevare gli errori (autenticazione, limiti di velocità).

Esempio di frammento YAML (concettuale) per un'attività Dify

Dify utilizza definizioni dichiarative per molti flussi. Il frammento di codice seguente è concettuale: adattalo alla tua versione di Dify e ai campi del plugin:

model_provider: cometapi

model: gpt-4o-mini

api_key_secret: dify_plugin_cometapi_key

prompt:

- role: system

content: "You are an assistant..."

(Consultare sempre la documentazione di installazione di Dify per conoscere i nomi esatti dei campi.)

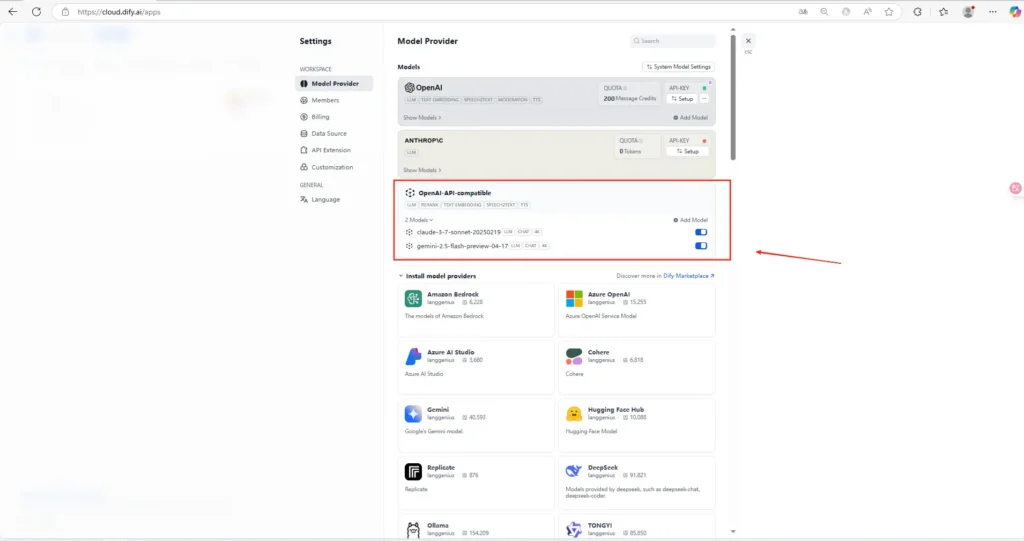

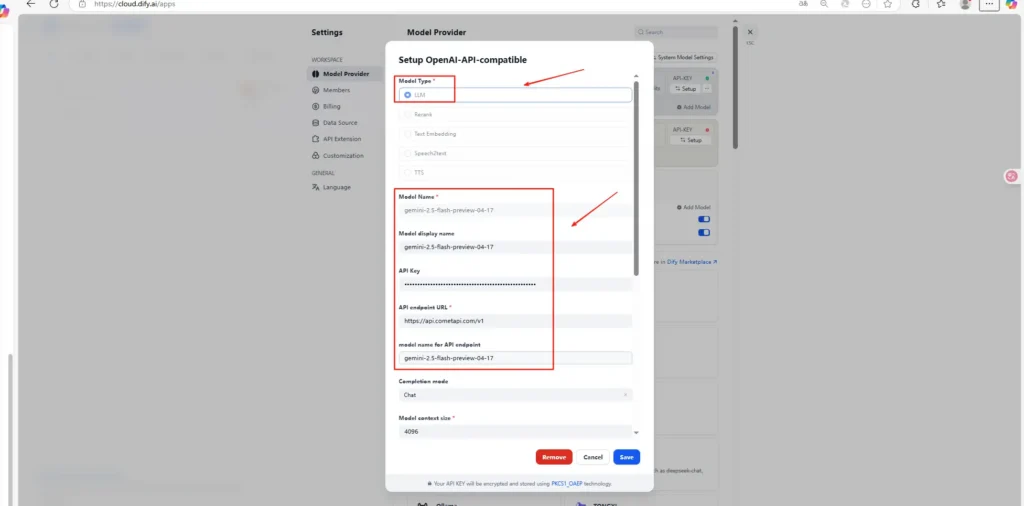

Altro metodo: formato OpenAI

- Accedi alle impostazioni di Dify: Vai alla sezione delle impostazioni nella piattaforma Dify.

- Configurare i provider del modello: Individua e seleziona l'opzione per i fornitori di modelli.

- Aggiungi modello come fornitore: Scegli di aggiungere un nuovo fornitore di modelli e seleziona OpenAI (o altro) dalle opzioni disponibili.

- Inserisci le credenziali API: Inserisci la tua chiave API CometAPI e configura l'URL dell'endpoint API.

- Imposta i parametri del modello: Definire parametri quali tipo di modello (ad esempio, GPT-4), lunghezza del contesto e limiti massimi del token.

- Abilita funzionalità: Configurare impostazioni aggiuntive come chiamata di funzione, chiamata di strumento e supporto multimodale in base alle esigenze.

- Salva e prova: Salvare la configurazione e testare l'integrazione per garantirne il corretto funzionamento.

Oltre a openAI, CometAPI fornisce più modelli di generazione di contenuti API come API di DeepSeek R1, Grok4, modelli geimin, ecc., così come modelli di immagini di testo e modelli di generazione video come FLUX.1 Kontext, API di Veo 3 e al API di metà viaggio ecc., per aiutarti a creare il tuo flusso di lavoro.

Scenari e soluzioni comuni per la risoluzione dei problemi

- Errori di autorizzazione: Se Dify mostra un errore di autenticazione, controlla

sk-xxxxxchiave e se l'hai incollata nel campo del provider corretto. Conferma che Dify può raggiungerehttps://api.cometapi.com. - Risposte/formattazione inaspettate: Assicurati che il formato della richiesta corrisponda allo stile OpenAI (CometAPI accetta il formato compatibile con OpenAI). Verifica anche

modelnomi dei parametri. - Alta latenza: Prova diversi modelli CometAPI; la latenza può variare a seconda delle famiglie di modelli. Controlla anche l'uscita di rete dal tuo host Dify.

- Picchi di costo: Controlla i limiti dei token in Dify e l'utilizzo nella dashboard CometAPI; limita o passa a modelli più economici per i flussi non critici.

Quali casi d'uso reali traggono vantaggio da questa integrazione?

Caso d'uso 1: valutazione multi-modello per il servizio clienti

Avvia un flusso di chat Dify supportato dal nodo CometAPI e dalle risposte dei test A/B da gpt-4o, claude-3.7 e un candidato più piccolo ed economico. Per domande e risposte comuni, passare a un modello CometAPI a basso costo. Per query complesse o multi-step, passare a un modello con capacità superiori (o multimodale) tramite CometAPI.

Caso d'uso 2: Assistente di conoscenza interno con fallback sicuri

Costruisci una pipeline RAG in Dify che utilizzi embedding e recupero, ma che chiami CometAPI per la generazione. Se il modello di grandi dimensioni raggiunge i limiti di velocità, passa automaticamente a un modello CometAPI più piccolo. Flowise può essere utilizzato per prototipare catene di prompt prima di trasferire il flusso a Dify per la produzione.

Caso d'uso 3: Sperimentazione rapida per app multimodali

CometAPI espone modelli di immagini e audio (ad esempio, Suno, Runway). Combina l'orchestrazione di Dify (indirizzamento dei caricamenti multimediali al servizio corretto) con il modello di CometAPI, passando rapidamente a funzionalità multimodali prototipo.

- Utilizza l'orchestrazione di Dify per raccogliere brief, modelli e guide di stile.

- Utilizzare CometAPI per chiamare un modello di immagine (Midjourney/ API immagine Flash Gemini 2.5 (Nano-Banana) modello) e un LLM per le didascalie nello stesso flusso. L'elenco unificato dei modelli di CometAPI semplifica questa orchestrazione.

Conclusione

L'integrazione di Dify con CometAPI sblocca potenti possibilità per le applicazioni basate sull'intelligenza artificiale, offrendo un flusso di lavoro semplificato, ampie opzioni di personalizzazione e funzionalità AI migliorate. Seguendo le best practice, affrontando potenziali sfide e rimanendo aggiornati sui nuovi progressi, gli sviluppatori possono massimizzare il potenziale di questa integrazione per creare soluzioni innovative basate sull'intelligenza artificiale.

Per iniziare a integrare CometAPI con Dify, esplora le capacità del modello in Parco giochi e consultare il Dify Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.

Pronti a partire? → Iscriviti oggi a CometAPI !