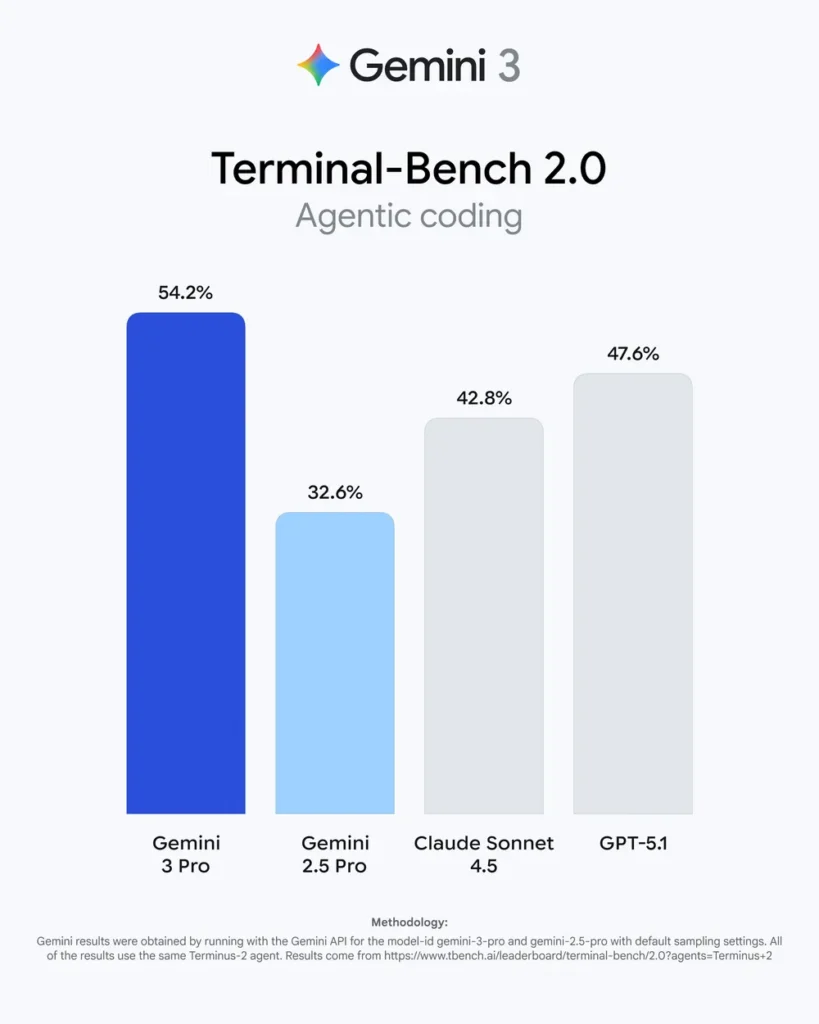

Google ha appena inaugurato l’era Gemini 3 rilasciando in anteprima Gemini 3 Pro, e i segnali iniziali sono inequivocabili: si tratta di un grande passo avanti nel ragionamento multimodale, negli agenti di coding e nella comprensione di contesti molto estesi. Il modello è presentato come il più capace di Google in termini di ragionamento e multimodalità, ottimizzato per workflow agentici, programmazione, attività a lungo contesto e comprensione multimodale. Arriva con una nuova modalità di ragionamento “Deep Think”, introduce miglioramenti drastici nei benchmark agentici/codice (Terminal-Bench 2.0 riportato al 54.2%) ed è immediatamente utilizzabile tramite Google AI Studio, API (integrazioni Vertex AI) e strumenti per sviluppatori come Google Antigravity.

Che cos’è Gemini 3 Pro Preview?

Gemini 3 è presentato da Google come il membro di nuova generazione, più intelligente, della famiglia Gemini — focalizzato su un ragionamento più profondo, una comprensione multimodale più ricca (testo, immagini, video, audio, codice) e un comportamento più agentico (modelli che pianificano e agiscono con strumenti).

Caratteristiche principali

- Comprensione multimodale nativa — progettato per accettare e ragionare su testo, immagini, audio e video insieme (inclusi input lunghi/video). Ottimo per combinare documenti, screenshot, trascrizioni e video.

- Finestra di contesto enorme (fino a ~1,000,000 token) — può ingerire/mantenere in contesto documenti estremamente lunghi, grandi codebase o ore di trascrizioni in una singola sessione. Questo è un punto di forza chiave per ricerca approfondita, revisione del codice e sintesi multi-documento.

- Capacità agentiche / uso di strumenti — progettato per alimentare agenti autonomi che possono chiamare strumenti, operare terminali, gestire piani di attività e coordinare workflow a più passaggi (usato in Google Antigravity e altre integrazioni IDE). Ciò lo rende particolarmente forte per coding, orchestrazione e automazione multi-step.

- Ragionamento e coding più robusti — Google posiziona Gemini 3 Pro come il suo miglior modello “di pensiero” per compiti complessi di ragionamento, matematica e codice (benchmark migliorati e prestazioni migliori con terminale/strumenti).

Cosa c’è di nuovo in Gemini 3 Pro rispetto a Gemini 2.5 Pro e altri?

Quali capacità sono migliorate di più?

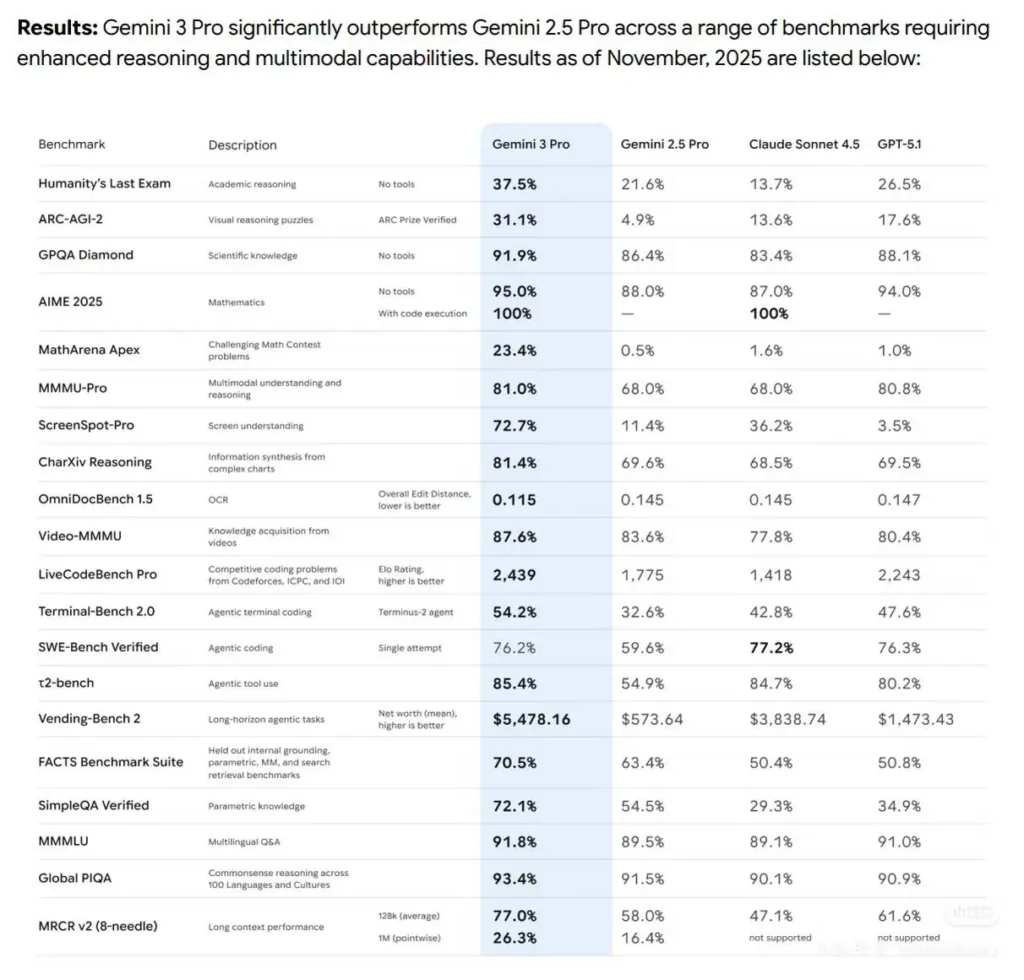

Gemini 3 Pro è presentato come un grande passo avanti nel ragionamento (matematico e scientifico), nel ragionamento multimodale spaziale/visivo e nell’uso degli strumenti. Google evidenzia guadagni netti rispetto a Gemini 2.5 Pro in suite di benchmark e in attività agentiche reali come programmazione e automazione da terminale. Esempi di metriche di rilievo pubblicate includono:

| Benchmark / attività | Gemini 3 Pro (riportato) | Gemini 2.5 Pro (riportato) | Variazione assoluta (pp) |

|---|---|---|---|

| Humanity’s Last Exam (ragionamento accademico, senza strumenti) | 37.5% | 21.6% | +15.9. |

| GPQA Diamond (QA scientifica/fattuale) | 91.9% | 86.4% | +5.5. |

| AIME 2025 (matematica, senza strumenti) | 95.0% | 88.0% | +7.0. |

| AIME con esecuzione del codice | 100.0% | (2.5 Pro: — ) | — (3 Pro ottiene il punteggio perfetto con l’esecuzione). |

| ARC-AGI-2 (enigmi di ragionamento visivo) | 31.1% | 4.9% | +26.2 — guadagno multimodale molto ampio. |

| SimpleQA Verified (conoscenza parametrica) | 72.1% | 54.5% | +17.6. |

Questi numeri indicano che Gemini 3 Pro è ottimizzato per il ragionamento multi-step, l’uso complesso di strumenti e attività multimodali strettamente integrate (ad es. combinare fotogrammi video, ragionamento su grafici e generazione di codice).

Strumenti per sviluppatori agentic-first: Antigravity

Per dimostrare i workflow agentici, Google ha rilasciato Antigravity — un IDE “agent-first” che usa Gemini 3 Pro come base per workflow di programmazione multi-agente. Antigravity consente agli agenti di interagire direttamente con un editor, un terminale e un browser, e di produrre “Artifacts” (elenchi di attività, screenshot, registri del browser) che documentano le azioni degli agenti — affrontando tracciabilità e riproducibilità nello sviluppo agentico. Questo rende Gemini 3 Pro molto più pratico per i workflow reali degli sviluppatori rispetto a modelli focalizzati esclusivamente sulla generazione di testo.

Uso degli strumenti e coding migliorati

Google riporta miglioramenti notevoli su un benchmark incentrato sul terminale (Terminal-Bench 2.0) che misura la capacità di un modello di operare un computer tramite terminale: Gemini 3 Pro ottiene 54.2% in quel test — un grande salto rispetto alle versioni precedenti di Gemini — indicando progressi reali nell’uso autonomo degli strumenti e nella generazione di codice.

Soprattutto quando gli si chiede di eseguire script, orchestrare strumenti o gestire attività per sviluppatori a più passaggi. In pratica ciò significa meno allucinazioni quando il modello esegue comandi, una gestione degli errori migliore e una maggiore capacità di recuperare da passaggi falliti.

Come si comporta Gemini 3 Pro nei benchmark

Google ha pubblicato un’ampia suite di confronti su benchmark che coprono il ragionamento NLP classico, la comprensione multimodale, la generazione di codice e l’uso agentico di strumenti. Numeri chiave riportati direttamente da Google includono:

- LMArena: Gemini 3 Pro ha ottenuto 1501 Elo, un posizionamento di vertice nella classifica competitiva (misura qualità del ragionamento/risposte in confronti a coppie).

- MMMU-Pro (benchmark multimodale): 81% — un aumento significativo rispetto ai modelli precedenti.

- Video-MMMU: 87.6% su attività multimodali sensibili al video.

- SimpleQA Verified: 72.1% a indicare miglioramenti nella QA fattuale per input complessi.

- WebDev Arena: 1487 Elo (sviluppo web / ragionamento sul codice).

- Terminal-Bench 2.0 & SWE-bench Verified: grandi balzi nelle prestazioni di uso agentico di strumenti e agenti di coding.

- Deep Think: ulteriori incrementi sui test di massima difficoltà (ad es., Humanity’s Last Exam migliorato da 37.5% a 41.0% in Deep Think su alcune metriche riportate).

Tutto ciò indica un modello tarato per la profondità, non solo per la generazione superficiale di testo.

Quindi: sì, Gemini 3 Pro si colloca costantemente nella fascia alta in molti test odierni — ma “stracciare” dipende dal compito. Per la pura generazione di codice, alcuni concorrenti restano testa a testa; per lungo contesto, matematica e sintesi multimodale, Gemini 3 Pro è spesso riportato come best-in-class nelle esecuzioni di inizio novembre/novembre 2025.

Come accedere a Gemini 3 Pro Preview?

Punti di accesso ufficiali

- App Gemini (consumer / utenti Pro): Il modello è in fase di rollout nell’app Gemini come parte del lancio dell’era “Gemini 3”.

- Google AI Studio / Gemini Developer API: Gli sviluppatori possono fare esperimenti tramite AI Studio e la Gemini Developer API. L’API ha interfacce REST e SDK e supporta funzionalità avanzate come function calling e streaming.

- Vertex AI (Google Cloud): Imprese e team possono accedere a Gemini 3 Pro tramite Vertex AI per workflow di produzione e MLOps. Vertex supporta esempi in Python, Node, Java, Go e curl.

- Integrazioni di terze parti (CometAPI): CometAPI fornisce accesso all’API di Gemini 3 Pro, con il nome di chiamata gemini-3-pro-preview. CometAPI offre un prezzo molto inferiore a quello ufficiale per aiutarti a integrare.

Quickstart: esempio in Python (pattern SDK ufficiale)

Di seguito un esempio minimo e pratico in Python, adattato dal quickstart di Gemini di Google, che mostra come chiamare l’API Gemini tramite il client GenAI di Google. Sostituisci GEMINI_API_KEY con la tua chiave API ottenuta da Google AI Studio o dal tuo progetto GCP.

# Esempio: chiamare Gemini 3 Pro Preview utilizzando il Google GenAI Python SDK

# Requisiti: pip install google-generativeai

import os

from google import genai

# Imposta la chiave API nell'ambiente:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # il client preleva GEMINI_API_KEY dall'ambiente

# Usa l'identificatore del modello di anteprima. L'ID esatto può variare; usa l'ID indicato nella documentazione dell'API.

model_id = "gemini-3-pro-preview" # oppure "gemini-3-pro" a seconda della disponibilità

prompt = """

Sei un assistente che scrive una breve funzione Python per recuperare JSON da un URL,

gestire gli errori HTTP e restituire il JSON analizzato o None in caso di errore.

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("RISPOSTA DEL MODELLO:\n", resp.text)

Se scegli CometAPI, sostituisci url con https://api.cometapi.com/v1/chat/completions e key con la chiave ottenuta da CometAPI.

Come ottenere i migliori risultati — pattern di prompt e suggerimenti

Usa la modalità “thinking” per i problemi difficili

Se stai risolvendo compiti di ragionamento progressivo o problemi complessi di matematica/codice, abilita la variante “thinking” della preview (se disponibile) — alloca più passaggi di ragionamento interni e spesso produce soluzioni più affidabili su attività multi-stage. Verifica i nomi dei modelli in console per un suffisso -thinking.

Function calling e orchestrazione degli strumenti

Usa funzioni dichiarate (function calling in Vertex AI/GenAI) per output affidabili e strutturati e per ridurre le allucinazioni. Lascia che il modello proponga le chiamate di funzione ed eseguirle in modo deterministico nel tuo ambiente. La documentazione del function calling include esempi per restituire argomenti JSON tipizzati eseguibili in sicurezza.

Grounding quando servono fatti aggiornati

Se la tua app dipende da fatti web aggiornati, usa il grounding ma tieni presenti i costi e i rate limit dei prompt con grounding. Il grounding è potente — consente a Gemini di interrogare Search o Maps — ma ogni prompt con grounding può incidere su billing e latenza.

Come si comporta Gemini 3 Pro nelle attività del mondo reale (casi d’uso)

Generazione di codice e produttività degli sviluppatori

Gemini 3 Pro migliora il ragionamento multi-file, il lungo contesto del repository e la sintesi di test/documentazione insieme al codice. Abbinato al function calling e a un agente da terminale, può predisporre e convalidare progetti di medie dimensioni più rapidamente dei modelli più vecchi. I test della community mostrano punteggi LiveCodeBench/Elo di coding elevati.

Ricerca e workflow STEM

La capacità Deep Think del modello e il budget di ragionamento più ampio lo rendono adatto a compiti di ricerca che richiedono derivazioni matematiche multi-step, sintesi di dataset o sintesi di articoli multi-file. I risultati preliminari sui benchmark lo collocano ai vertici per molti dataset STEM.

Progettazione dei contenuti, workflow creativi multimodali

Le uscite multimodali di Gemini 3 Pro e l’integrazione con Veo/Whisk/Flow lo rendono una scelta forte per workflow che combinano testo, immagini e video — dagli storyboard di marketing a bozze video automatizzate. Google raggruppa alcuni strumenti per creator in AI Ultra per chi desidera i limiti più alti.

Conclusione: Gemini 3 Pro straccia gli altri modelli?

Gemini 3 Pro Preview è un grande passo avanti. In un ampio ventaglio di benchmark e nei primi test reali spesso si piazza ai vertici o alla pari con i migliori modelli disponibili a fine 2025, in particolare in:

- Ragionamento complesso (matematica / STEM)

- Comprensione e sintesi multimodale

- Workflow agentici e function calling

Tuttavia, il margine varia in base al compito. Per alcune attività ristrette (certi stili di scrittura creativa o conoscenze di dominio molto specialistiche), altri modelli possono restare competitivi o preferibili a seconda di costi/latenza e dell’ecosistema. Benchmark e punteggi trapelati suggeriscono che Gemini 3 Pro spesso si colloca nella fascia alta, ma lo “stracciare” è dipendente dal compito — per molti casi d’uso enterprise e di sviluppo, Gemini 3 Pro è ora il primo modello da valutare.

Come iniziare con CometAPI

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di AI da provider leader — come la serie GPT di OpenAI, Google Gemini, Anthropic Claude, Midjourney, Suno e altri — in un’unica interfaccia per sviluppatori. Offrendo autenticazione coerente, formattazione delle richieste e gestione delle risposte uniformi, CometAPI semplifica radicalmente l’integrazione di funzionalità AI nelle tue applicazioni. Che tu stia costruendo chatbot, generatori di immagini, compositori musicali o pipeline di analytics data-driven, CometAPI ti consente di iterare più velocemente, controllare i costi e restare vendor-agnostic — attingendo al contempo alle ultime innovazioni dell’ecosistema AI.

Gli sviluppatori possono accedere alla Gemini 3 Pro Preview API tramite CometAPI. Per iniziare, esplora le funzionalità dei modelli di CometAPI nel Playground e consulta la guida all’API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo molto inferiore a quello ufficiale per aiutarti a integrare.

Pronto a partire? → Registrati a CometAPI oggi !

Se vuoi conoscere altri suggerimenti, guide e notizie sull’AI seguici su VK, X e Discord!