Kluczowe funkcje

- Natywne / wysokiej jakości renderowanie tekstu wewnątrz obrazów — świetnie radzi sobie z tworzeniem czytelnego, semantycznie poprawnego tekstu w generowanych obrazach (plakaty, opakowania, zrzuty ekranu) — obszar, z którym wiele wcześniejszych modeli obrazów miało problemy.

- Wielomodalne wyjście o wysokiej wierności — generuje fotorealistyczne i stylizowane obrazy z dobrym poziomem detali oraz układem uwzględniającym język.

- Transfer stylu i ulepszanie detali — potrafi stosować spójne style artystyczne lub poprawiać lokalne detale, zachowując spójność sceny.

Szczegóły techniczne — jak działa Qwen-Image

Architektura i komponenty (słowa kluczowe: MMDiT, Qwen2.5-VL). Model wykorzystuje oparty na MMDiT transformator dyfuzyjny do syntezy obrazów, połączony z enkoderem wizualno-językowym (Qwen2.5-VL) do interpretacji promptów i kontekstu wizualnego. Taki podział pozwala modelowi inaczej traktować wskazówki semantyczne i wygląd pikseli, poprawiając wierność tekstu i spójność edycji. Oficjalne repozytorium i raport techniczny wskazują na szkielet o 20 miliardach parametrów dla głównego modelu T2I.

Pipeline treningowy (słowa kluczowe: curriculum learning, data pipeline). Aby rozwiązać trudny problem renderowania tekstu, Qwen-Image wykorzystuje progresywny program nauczania: zaczyna od prostszych obrazów bez tekstu i stopniowo uczy się na coraz bardziej złożonych przykładach bogatych w tekst, aż do danych wejściowych na poziomie akapitów. Zespół zbudował kompleksowy pipeline obejmujący zbieranie danych na dużą skalę, staranną filtrację, syntetyczne augmentacje oraz balansowanie, aby zapewnić modelowi kontakt z wieloma realistycznymi kompozycjami tekstu i zdjęć podczas treningu. Ta strategiczna progresja jest jednym z głównych powodów, dla których model tak dobrze radzi sobie z renderowaniem wielojęzycznego tekstu.

Mechanizm edycji (słowa kluczowe: dual-encoding, VAE + VL encoder). W przypadku edycji system dwukrotnie podaje oryginalny obraz: raz do enkodera Qwen2.5-VL w celu kontroli semantycznej i raz do enkodera VAE w celu uzyskania rekonstrukcyjnych informacji o wyglądzie. Konstrukcja oparta na podwójnym kodowaniu pozwala modułowi edycji zachować tożsamość i wierność wizualną, jednocześnie umożliwiając modyfikacje semantyczne — na przykład zastąpienie obiektu lub zmianę treści tekstowej bez pogarszania niezwiązanych obszarów.

Wyniki benchmarków

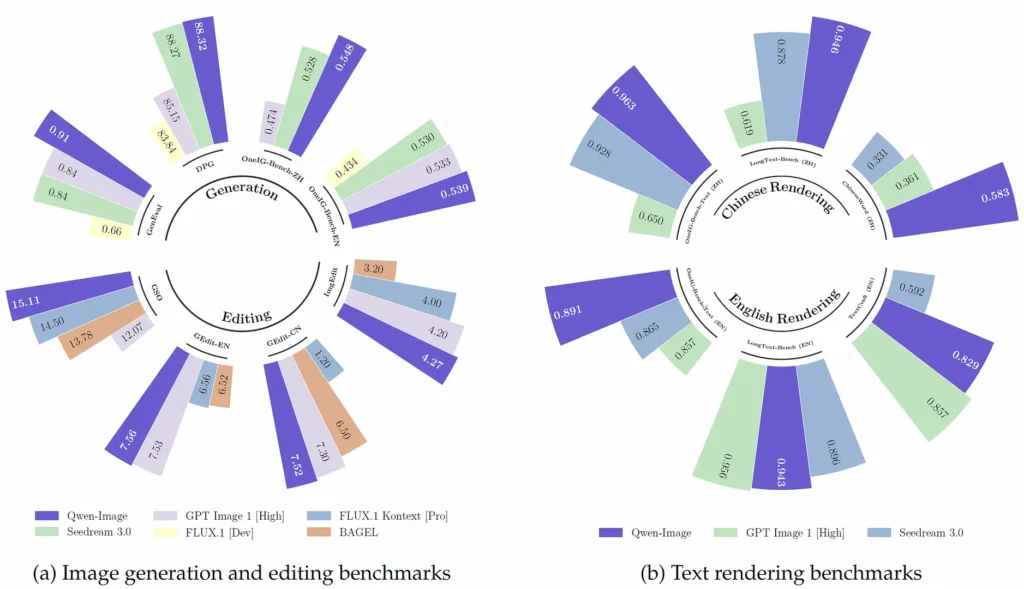

Qwen-Image osiąga wyniki SOTA lub zbliżone do SOTA w wielu publicznych benchmarkach zarówno dla generowania, jak i edycji, ze szczególnie mocnymi rezultatami w zadaniach renderowania tekstu oraz benchmarkach rzeczywistych kompozycji (np. T2I-CoreBench i wyselekcjonowane zestawy do edycji obrazów).

Jak Qwen-Image wypada na tle innych czołowych modeli

Względne mocne strony: renderowanie tekstu i wierność tekstu dwujęzycznego to charakterystyczne przewagi modelu nad wieloma konkurencyjnymi modelami generatywnymi (np. DALL·E 3, SDXL, Midjourney), które często są lepsze w czysto artystycznej kompozycji lub różnorodności stylistycznej, ale słabsze w gęstym, wielowierszowym układzie tekstu lub układzie tekstu chińskiego. Tę charakterystykę potwierdzają liczne porównania społeczności oraz tabele benchmarkowe autorów modelu.

Względne kompromisy: w porównaniu z zamkniętymi, intensywnie dostrajanymi systemami komercyjnymi, Qwen-Image może wymagać post-processingu lub dostrajania promptów/adapterów, aby osiągnąć identyczny realizm w niektórych kontekstach (zniekształcenia na zakrzywionych powierzchniach, fotorealistyczne komponowanie), zgodnie z niezależnymi testami. Dla użytkowników, dla których priorytetem są szablonowe projekty, makiety opakowań lub dwujęzyczne układy tekstowe, Qwen-Image zwykle będzie lepszym wyborem.

Typowe i wartościowe zastosowania

- Makiety opakowań i produktów: dokładny tekst i wielowierszowe układy dla etykiet oraz testów opakowań.

- Szkice reklamowe i projektowe: szybkie prototypowanie tam, gdzie liczy się wierność tekstu (plakaty, banery).

- Generowanie obrazów przypominających dokumenty: tworzenie obrazów, które muszą zawierać czytelną treść (menu, znaki, interfejsy).

- Pipeline’y edycji obrazów: ukierunkowane edycje (zamiana tekstu, dodawanie/usuwanie obiektów) z zachowaniem stylu i perspektywy.

- Jak uzyskać dostęp do API Qwen image

Krok 1: Zarejestruj się, aby uzyskać klucz API

Zaloguj się na cometapi.com. Jeśli nie jesteś jeszcze naszym użytkownikiem, najpierw się zarejestruj. Zaloguj się do swojej konsoli CometAPI. Uzyskaj poświadczenie dostępu — klucz API interfejsu. Kliknij „Add Token” w sekcji API token w centrum osobistym, uzyskaj klucz tokenu: sk-xxxxx i zatwierdź.

Krok 2: Wysyłaj żądania do API Qwen image

Wybierz endpoint „qwen-image”, aby wysłać żądanie API i ustawić treść żądania. Metoda żądania i treść żądania są dostępne w dokumentacji API na naszej stronie. Nasza strona internetowa udostępnia również test Apifox dla Twojej wygody. Zastąp <YOUR_API_KEY> swoim rzeczywistym kluczem CometAPI z konta. Bazowy adres URL to Images format(https://api.cometapi.com/v1/images/generations) przez CometAPI.

Wstaw swoje pytanie lub żądanie do pola content — to na nie model odpowie.

Krok 3: Pobierz i zweryfikuj wyniki

Przetwórz odpowiedź API, aby uzyskać wygenerowaną odpowiedź. Po przetworzeniu API zwraca status zadania oraz dane wyjściowe.