Specifiche tecniche dell'API Seed 1.8

| Voce | Specifiche / note |

|---|---|

| Nome del modello / famiglia | Doubao-Seed-1.8 (Seed1.8) — ByteDance Seed / Volcano Engine |

| Modalità supportate | Testo, immagini, video (capacità VLM multimodali), strumenti audio nell'ecosistema (modelli separati per la generazione audio/video). |

| Finestra di contesto (testo) | 256K token |

| Capacità video/visiva | Progettato per il ragionamento su video lunghi, supporta codifica visiva efficiente e grandi budget di token video (la model card riporta esperimenti sui token video e benchmark su video lunghi). |

| Formati di input | Prompt in linguaggio naturale; caricamento di immagini (screenshot, grafici, foto); video come frame tokenizzati / strumenti video per ispezione di segmenti; caricamento di file (documenti). |

| Formati di output | Testo in linguaggio naturale, output strutturati (structured-output beta), chiamate di funzione/chiamate a strumenti, codice e output multimodali via orchestrazione. |

| Modalità di pensiero/inferenza | no_think, think-low, think-medium, think-high — bilanciano accuratezza vs latenza/costo. |

Che cos'è Doubao Seed 1.8?

Doubao Seed 1.8 è la release 1.8 del team Seed: un LLM+VLM unificato che mira esplicitamente all’agenzia generalizzata nel mondo reale — cioè percezione (immagini/video), ragionamento, orchestrazione di strumenti (ricerca, chiamate di funzione, esecuzione di codice, grounding della GUI) e presa di decisioni multi-step all’interno di un singolo modello. L’architettura enfatizza “modalità di pensiero” configurabili (compromessi tra latenza e profondità), codifica visiva efficiente e supporto nativo per contesto lungo e input multimodali, così che il modello possa operare come assistente/agente autonomo in flussi di lavoro di produzione.

Caratteristiche principali dell'API Seed 1.8

- Modello agentico multimodale unificato. Integra percezione (immagine/video), ragionamento (LLM) e azione (chiamate a strumenti/G U I, esecuzione di codice) in un singolo modello invece di una pipeline separata. Ciò consente flussi agentici compatti e minore complessità di orchestrazione.

- Contesto ultra-lungo e gestione di video lunghi. Contesto esteso (supporto del prodotto fino a 256k token) e benchmark specifici su video lunghi (Seed1.8 mostra una forte efficienza dei token su video lunghi). Il modello supporta strumenti video selettivi (VideoCut) per focalizzare il ragionamento su timestamp specifici.

- Automazione GUI agentica e uso di strumenti. Benchmark e test interni (OSWorld, AndroidWorld, LiveCodeBench, benchmark di grounding GUI) mostrano miglioramenti nei compiti di agenti GUI e nell’automazione multi-step. Il modello può emettere comandi di grounding della GUI e operare in contesti OS/web/mobile simulati.

- Modalità di pensiero configurabili per il controllo di latenza/costo. Quattro modalità di inferenza permettono agli sviluppatori di modulare il calcolo a test-time per compiti interattivi vs batch di alta qualità. Utile per sistemi di produzione con budget di latenza rigorosi.

- Migliore efficienza dei token (multimodale). Seed 1.8 dimostra una maggiore efficienza dei token sui benchmark multimodali rispetto ai predecessori (serie Seed-1.5/1.6), raggiungendo alta accuratezza con budget di token ridotti in diversi compiti su video lunghi.

- Modalità di pensiero configurabili: bilanciare profondità dell’inferenza vs latenza/costo con modalità distinte (

no_think→think-high) per ottimizzare l’uso in produzione interattiva. - Capacità tecniche

- Efficienza dei token: Seed1.8 mostra una marcata efficienza dei token rispetto ai predecessori (Seed-1.5/1.6), offrendo maggiore accuratezza con budget di token inferiori nei compiti su video lunghi (ad es., raggiungendo accuratezza competitiva anche a 32K token video). Ciò permette di ridurre i costi di inferenza per input lunghi.

- Ragionamento e percezione multimodali: Il modello raggiunge SOTA su diversi compiti VQA multi-immagine e di movimento/percezione e ottiene il secondo posto o quasi SOTA su molti benchmark di ragionamento multimodale; in particolare supera il suo predecessore in quasi ogni dimensione visiva/video misurata.

- Uso agentico degli strumenti e grounding GUI: Supporto documentato per il grounding della GUI e benchmark di operazioni basate su schermo (ScreenSpot-Pro, agenting GUI) con punteggi di grounding elevati (ad es., miglioramenti rispetto a Seed-1.5-VL su ScreenSpot-Pro).

- Ragionamento parallelo/a step: L’aumento del calcolo a test-time (pensiero parallelo) produce guadagni misurabili su benchmark di matematica, coding e ragionamento multimodale

Punti salienti di benchmark pubblici selezionati di Seed1.8

- VCRBench (visual commonsense reasoning): Seed1.8 ha ottenuto 59.8 (Pass@1 riportato nella tabella della model card), un miglioramento rispetto a Seed-1.5-VL e competitivo con i modelli top

- VideoHolmes (video reasoning): Seed1.8 65.5, superando Seed-1.5-VL e avvicinandosi a modelli concorrenti di livello pro.

- MMLB-NIAH (contesto lungo multimodale, 128k): Seed1.8 ha raggiunto 72.2 Pass@1 a 128k di contesto in MMLB-NIAH, superando alcuni modelli pro contemporanei.

- Suite Motion & Perception: SOTA in 5 su 6 compiti valutati; esempi includono TVBench, TempCompass e TOMATO in cui Seed1.8 mostra notevoli incrementi nella percezione temporale.

- Flussi di lavoro agentici: Su BrowseComp e altri benchmark agentici di ricerca/codice, Seed1.8 spesso si colloca vicino o sopra modelli pro concorrenti

Seed 1.8 vs Gemini 3 Pro / GPT-5.x

- Seed1.8 vs Seed-1.5-VL / Seed-1.6: Chiari miglioramenti in percezione multimodale, efficienza dei token per video lunghi ed esecuzione agentica.

- Seed1.8 vs Gemini 3 Pro / GPT-5.x: Su molti benchmark multimodali Seed1.8 corrisponde o supera Gemini 3 Pro (SOTA su diversi compiti VQA/movimento; migliore sul run MMLB-NIAH a 128k). Tuttavia, la scheda mostra anche aree in cui i modelli della famiglia Gemini conservano vantaggi in alcune discipline di conoscenza — quindi l’ordinamento relativo dipende dal benchmark.

- Variante Seed-Code (Doubao-Seed-Code): specializzata per compiti di programmazione/agentici sul codice (contesto ampio per codebase; benchmark SWE specializzati). Seed1.8 è il modello multimodale agentico generalista, mentre Seed-Code è la variante focalizzata sulla programmazione.

Casi d'uso pratici con la Seedream 4.5 API su CometAPI

- Assistenti di ricerca multimodali e analisi di documenti: estrarre, riassumere e ragionare su documenti lunghi, presentazioni e report multi-pagina.

- Comprensione e monitoraggio di video lunghi: analytics per sicurezza/trasmissioni sportive, sintesi di riunioni lunghe e analisi in streaming, dove l’efficienza di token su video lunghi del modello è rilevante.

- Flussi di lavoro agentici / automazione: ricerca web multi-step + esecuzione di codice + estrazione dati (ad es., pipeline automatiche per analisi competitiva, pianificazione viaggi, ricerca, dimostrate in benchmark interni).

- Strumenti per sviluppatori (se si usa Seed-Code): analisi di grandi codebase, assistenti IDE e esecuzione agentica del codice per test e riparazione (Seed-Code è la variante specializzata consigliata).

- Automazione GUI & RPA: i benchmark di grounding dello schermo e degli agenti GUI indicano che il modello può svolgere compiti GUI strutturati meglio delle release Seed precedenti.

Come usare l'API Doubao Seed 1.8 tramite CometAPI

Doubao Seed1.8 è esposto commercialmente tramite CometAPI come API di inferenza hosted. L’API supporta payload multimodali (testo + immagini + frammenti/timestamp video) e modalità di inferenza configurabili per bilanciare latenza e calcolo rispetto alla qualità della risposta.

Pattern di chiamata: l’API supporta richieste standard in stile chat/completamento, risposte in streaming e flussi agentici in cui il modello emette chiamate a strumenti (ricerca, esecuzione di codice, azioni GUI) e ingloba gli output degli strumenti come contesto successivo.

Streaming e gestione del contesto lungo: l’API supporta lo streaming e dispone di primitive integrate di gestione del contesto per sessioni lunghe (per abilitare contesti 100K+ / tracce agentiche multi-step).

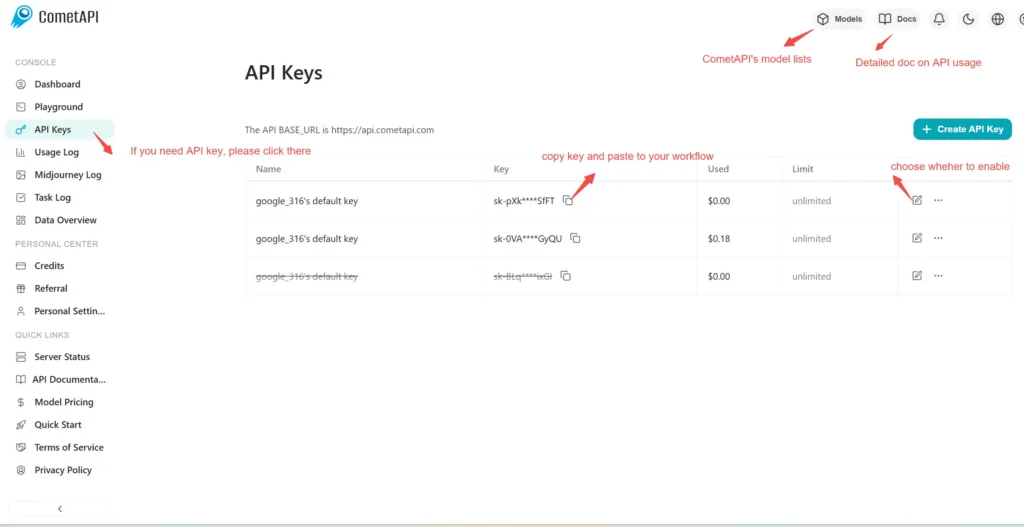

Passaggio 1: Registrati per ottenere la chiave API

Accedi a cometapi.com. Se non sei ancora nostro utente, registrati prima. Accedi alla tua console CometAPI. Ottieni la chiave API di accesso dell’interfaccia. Clicca “Add Token” nella sezione API token del centro personale, ottieni la chiave del token: sk-xxxxx e invia.

Passaggio 2: Invia richieste all'API Doubao Seed 1.8

Seleziona l’“doubao-seed-1-8-251228” endpoint per inviare la richiesta API e imposta il body della richiesta. Metodo e body della richiesta sono reperibili nella documentazione API sul nostro sito. Il nostro sito fornisce anche test Apifox per tua comodità. Sostituisci <YOUR_API_KEY> con la tua chiave CometAPI effettiva dal tuo account. Compatibile con le API Chat.

Inserisci la tua domanda o richiesta nel campo content — è a questo che il modello risponderà. Elabora la risposta dell’API per ottenere la risposta generata.

Passaggio 3: Recupera e verifica i risultati

Elabora la risposta dell’API per ottenere l’output generato. Dopo l’elaborazione, l’API risponde con lo stato dell’attività e i dati di output.