Che cos'è MiniMax M2.1

MiniMax M2.1 è la release successiva della famiglia MiniMax M2, pubblicata da MiniMax il 23 dicembre 2025. È posizionato come un modello open-source orientato alla produzione, progettato specificamente per il coding, workflow agentici multi-step (uso di strumenti, pianificazione multi-turno) e generazione di app full-stack (web, mobile, backend). Il rilascio enfatizza un miglioramento nella programmazione multilingue, migliori capacità per app mobile/native, risposte concise e una migliore generalizzazione di strumenti/agenti.

Main features

- Efficienza MoE: Numero totale di parametri elevato ma solo un piccolo sottoinsieme attivo per token (architettura progettata per scambiare capacità di picco con efficienza in inferenza).

- Ottimizzazioni “coding-first”: Solida comprensione e generazione di codice poliglotta attraverso molti linguaggi (Python, TypeScript, Rust, Go, C++, Java, Swift, linguaggi nativi mobile).

- Workflow agentici e basati su strumenti: Progettato per chiamate a strumenti, piani multi-step e “interleaved thinking”/esecuzione concatenata di vincoli istruzionali compositi.

- Supporto per contesti ampi e output lunghi: Mirato a workflow per sviluppatori con contesto esteso e traccia/storia dell’agente.

- Bassa latenza / elevato throughput: Pratico per assistenti di coding interattivi e loop agentici su larga scala grazie alla progettazione con attivazione selettiva e ottimizzazioni di deployment.

Capacità tecniche e specifiche

- Architettura: design Mixture-of-Experts (MoE).

- Parametri: Progetto dichiarato: ~230 miliardi di parametri totali con ~10 miliardi di parametri attivi usati per inferenza (sottoinsieme attivo MoE). È lo stesso modello di efficienza dei parametri attivi usato nella famiglia M2.

- Caratteristiche di inferenza: Progettato per uso interattivo a bassa latenza, inferenza batch ad alto throughput e loop agentici con frequenti chiamate a strumenti.

- Streaming / chiamate di funzione: supporta output di token in streaming e interfacce avanzate di chiamata di funzione/strumento per I/O strutturato.

Prestazioni ai benchmark

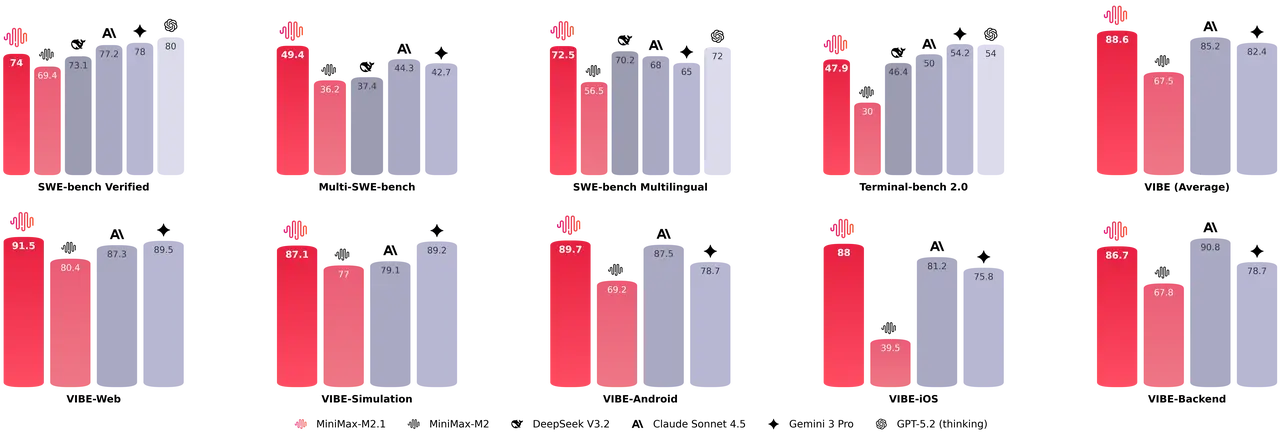

MiniMax ha pubblicato affermazioni comparative sui benchmark e aggregatori di terze parti hanno riportato punteggi al lancio; cifre rappresentative pubblicate includono:

Multi-SWE Bench / SWE-Bench (suite di coding/agentiche): indicazioni del provider e degli aggregatori citano 49,4% su Multi-SWE-Bench e 72,5% su SWE-Bench Multilingual per M2.1 (si tratta di punteggi aggregati per attività di generazione di codice e ragionamento sul codice).

M2.1 mostra miglioramenti completi rispetto a M2 nella generazione di casi di test, ottimizzazione del codice, code review e aderenza alle istruzioni; M2.1 supera M2 e spesso eguaglia o sorpassa Claude Sonnet 4.5 su diverse sottoattività di coding.

Casi d’uso rappresentativi in produzione

- Assistente IDE per codice e refactoring: Refactor multi-file, suggerimenti per code review, generazione automatica di test e generazione di patch in più linguaggi.

- “Dipendente digitale” agentico: Automazione di workflow d’ufficio ripetitivi (ricerca nei sistemi di ticketing, riepilogo di documenti, interazione con app web tramite comandi testuali) usando integrazione con strumenti e pensiero intercalato.

- Supporto ingegneristico multilinguaggio: I team che mantengono codebase poliglotte (Rust, Go, Java, C++, TypeScript) possono usare M2.1 per sintesi di codice e conversioni tra lingue.

- Valutazione automatizzata del codice e generazione di test: Generazione di casi di test, esecuzione di analisi del codice e produzione di correzioni o ottimizzazioni suggerite come parte degli strumenti di CI.

- Ricerca e personalizzazione locali/on‑prem: Le organizzazioni che richiedono controllo on‑prem possono effettuare fine-tuning o eseguire M2.1 in locale usando i pesi pubblicati e gli stack di inferenza consigliati.

Come accedere e usare l’API di MiniMax M2.1

Passaggio 1: Registrati per ottenere una chiave API

Accedi a cometapi.com. Se non sei ancora nostro utente, registrati prima. Accedi alla tua console CometAPI. Ottieni la chiave API di accesso dell’interfaccia. Clicca “Add Token” nel token API nell’area personale, ottieni la chiave token: sk-xxxxx e invia.

Passaggio 2: Invia richieste all’API di MiniMax M2.1

Seleziona l’endpoint “minimax-m2.1” per inviare la richiesta API e imposta il body della richiesta. Il metodo e il body della richiesta sono ottenuti dalla documentazione API sul nostro sito web. Il nostro sito fornisce anche un test Apifox per tua comodità. Sostituisci <YOUR_API_KEY> con la tua chiave CometAPI effettiva dal tuo account. Dove chiamarlo: API in stile Chat.

Inserisci la tua domanda o richiesta nel campo content — è a questo che il modello risponderà. Elabora la risposta dell’API per ottenere l’output generato.

Passaggio 3: Recupera e verifica i risultati

Elabora la risposta dell’API per ottenere l’output generato. Dopo l’elaborazione, l’API risponde con lo stato dell’attività e i dati di output.