Che cos'è l'API GPT-5.2

L’API GPT-5.2 è la stessa di GPT-5.2 Thinking in ChatGPT. GPT-5.2 Thinking è la variante di fascia media della famiglia GPT-5.2 di OpenAI progettata per il lavoro più approfondito: ragionamento a più fasi, sintesi di documenti lunghi, generazione di codice di qualità e attività professionali di knowledge work in cui accuratezza e struttura utilizzabile contano più del throughput puro. Nell’API è esposto come modello gpt-5.2 (Responses API / Chat Completions) e si colloca tra la variante a bassa latenza Instant e la Pro di qualità superiore ma più costosa.

Caratteristiche principali

- Contesto molto lungo e compattazione: finestra effettiva da 400K e strumenti di compattazione per gestire la rilevanza in conversazioni e documenti lunghi.

- Sforzo di ragionamento configurabile:

none | medium | high | xhigh(xhigh abilita il massimo calcolo interno per ragionamenti difficili).xhighè disponibile nelle varianti Thinking/Pro. - Supporto potenziato per tool e funzioni: invocazione di tool di prima classe, grammatiche (CFG/Lark) per vincolare gli output strutturati, e comportamenti agentici migliorati che semplificano automazioni complesse a più fasi.

- Comprensione multimodale: comprensione più ricca di immagini + testo e integrazione in attività a più fasi.

- Sicurezza migliorata/gestione di contenuti sensibili: interventi mirati per ridurre risposte indesiderate in aree come l’autolesionismo e altri contesti sensibili.

Capacità tecniche e specifiche (per sviluppatori)

- Endpoint API e ID modello:

gpt-5.2per Thinking (Responses API),gpt-5.2-chat-latestper flussi chat/instant egpt-5.2-proper il tier Pro; disponibili tramite Responses API e Chat Completions dove indicato. - Token di ragionamento e gestione dello sforzo: l’API supporta parametri espliciti per allocare il calcolo (reasoning effort) per richiesta; un effort più alto aumenta latenza e costo ma migliora la qualità dell’output per compiti complessi.

- Strumenti per output strutturati: supporto a grammatiche (Lark / CFG) per vincolare l’output del modello a un DSL o a una sintassi esatta (utile per SQL, JSON, generazione di DSL).

- Chiamata parallela agli strumenti e coordinamento agentico: parallelismo migliorato e orchestrazione degli strumenti più pulita riducono la necessità di system prompt elaborati e scaffolding multi-agente.

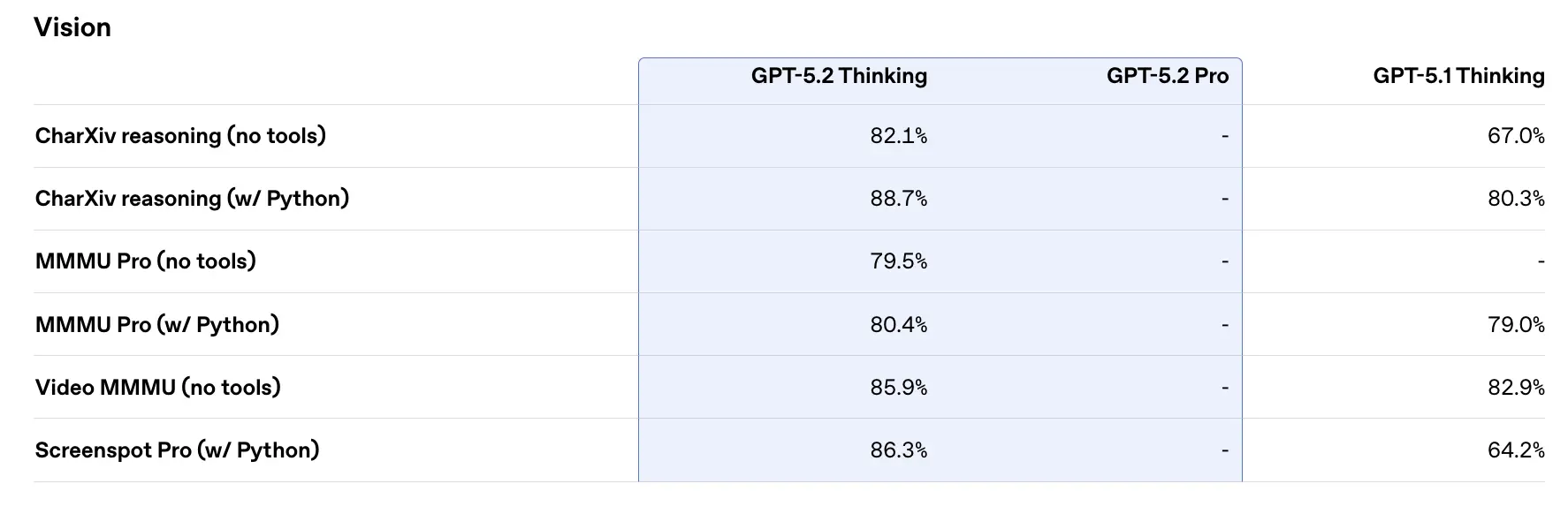

Prestazioni sui benchmark e dati di supporto

OpenAI ha pubblicato diversi risultati di benchmark interni ed esterni per GPT-5.2. Alcuni punti salienti (numeri riportati da OpenAI):

- GDPval (44 professioni, knowledge work) — GPT-5.2 Thinking “supera o eguaglia i migliori professionisti del settore nel 70.9% dei confronti”; OpenAI riporta che gli output sono stati prodotti a >11× la velocità e a <1% del costo dei professionisti esperti sui loro task GDPval (stime di velocità e costo basate su dati storici). Questi compiti includono modelli di fogli di calcolo, presentazioni e video brevi.

- SWE-Bench Pro (coding) — GPT-5.2 Thinking raggiunge ≈55.6% su SWE-Bench Pro e ~80% su SWE-Bench Verified (solo Python) secondo OpenAI, stabilendo un nuovo stato dell’arte per la generazione di codice/valutazioni di ingegneria nei loro test. Secondo gli esempi di OpenAI, questo si traduce in un debug più affidabile e correzioni end-to-end nella pratica.

- GPQA Diamond (Q&A a livello graduate di scienze) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% su GPQA Diamond (senza strumenti, massimo ragionamento).

- Serie ARC-AGI — Su ARC-AGI-2 (un benchmark di ragionamento fluido più difficile), GPT-5.2 Thinking ha segnato 52.9% e GPT-5.2 Pro 54.2% (OpenAI afferma che si tratta di nuovi record per modelli in stile chain-of-thought).

- Long-context (OpenAI MRCRv2) — GPT-5.2 Thinking mostra un’accuratezza quasi del 100% sulla variante a 4-needle di MRCR fino a 256k token e punteggi sostanzialmente migliorati rispetto a GPT-5.1 in contesti long-context. (OpenAI ha pubblicato grafici e tabelle MRCRv2.)

Confronto con i contemporanei

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro è stato pubblicizzato con una finestra di contesto di ~1,048,576 (≈1M) token e un ampio supporto multimodale in input (testo, immagine, audio, video, PDF) e robuste integrazioni agentiche tramite Vertex AI / AI Studio. Sulla carta, la finestra di contesto più ampia di Gemini 3 è un elemento distintivo per carichi di lavoro di singola sessione estremamente grandi; i compromessi includono la superficie del tooling e l’aderenza all’ecosistema.

- vs Anthropic Claude Opus 4.5: Opus 4.5 di Anthropic enfatizza i flussi di lavoro di coding/agent enterprise e riporta ottimi risultati su SWE-bench e robustezza per sessioni agentiche lunghe; Anthropic posiziona Opus per automazione e generazione di codice con una finestra di contesto da 200k e integrazioni specializzate per agent/Excel. Opus 4.5 è un forte concorrente in automazione enterprise e compiti di codice.

Conclusione pratica: GPT-5.2 punta a un set bilanciato di miglioramenti (contesto 400k, output di token elevati, ragionamento/coding migliorati). Gemini 3 punta ai contesti di singola sessione assolutamente più grandi (≈1M), mentre Claude Opus si concentra sull’ingegneria enterprise e sulla robustezza agentica. Scegli in base a dimensione del contesto, esigenze di modalità, aderenza a feature/tooling e compromessi costo/latenza.

Come accedere e usare l’API GPT-5.2

Passaggio 1: Registrati per ottenere la chiave API

Accedi a cometapi.com. Se non sei ancora un nostro utente, registrati prima. Accedi alla console di CometAPI. Ottieni le credenziali di accesso (API key) dell’interfaccia. Fai clic su “Add Token” nel token API nel centro personale, ottieni la chiave token: sk-xxxxx e inviala.

Passaggio 2: Invia richieste all’API GPT-5.2

Seleziona l’endpoint “gpt-5.2” per inviare la richiesta API e imposta il corpo della richiesta. Il metodo e il corpo della richiesta sono disponibili nella documentazione API del nostro sito web. Il nostro sito fornisce anche test Apifox per tua comodità. Sostituisci <YOUR_API_KEY> con la tua chiave CometAPI effettiva dal tuo account. Gli sviluppatori le invocano tramite le API Responses / gli endpoint Chat.

Inserisci la tua domanda o richiesta nel campo content — è ciò a cui il modello risponderà. Elabora la risposta dell’API per ottenere l’output generato.

Passaggio 3: Recupera e verifica i risultati

Elabora la risposta dell’API per ottenere l’output generato. Dopo l’elaborazione, l’API risponde con lo stato dell’attività e i dati di output.

Vedi anche Gemini 3 Pro Preview API