Specifiche tecniche di GPT-5.4 Mini

| Voce | GPT-5.4 Mini (stima da fonti ufficiali + convalida incrociata) |

|---|---|

| Famiglia di modelli | Serie GPT-5.4 (variante “mini” conveniente) |

| Provider | OpenAI |

| Tipi di input | Testo, Immagine |

| Tipi di output | Testo |

| Finestra di contesto | 400.000 token |

| Token massimi in output | 128.000 token |

| Cutoff della conoscenza | ~31 maggio 2024 (eredita la lineage mini) |

| Supporto al ragionamento | Sì (leggero rispetto a GPT-5.4 completo) |

| Supporto agli strumenti | Function calling, ricerca web, ricerca file, agenti (dedotto dalla famiglia GPT-5) |

| Posizionamento | Modello quasi di frontiera ad alta velocità ed economicamente efficiente |

Che cos’è GPT-5.4 Mini?

GPT-5.4 Mini è una variante di GPT-5.4 ad alta velocità ed economicamente efficiente progettata per carichi di lavoro sensibili alla latenza e ad alto volume. Porta una parte significativa delle capacità di ragionamento, coding e multimodalità di GPT-5.4 in un modello più piccolo e veloce, ottimizzato per sistemi su scala produttiva.

Rispetto ai precedenti modelli “mini”, GPT-5.4 Mini è posizionato come un piccolo modello quasi di frontiera, il che significa che si avvicina alle prestazioni dei modelli di punta riducendo drasticamente costi e tempi di risposta.

Caratteristiche principali di GPT-5.4 Mini

- Inferenza ad alta velocità: ottimizzata per applicazioni a bassa latenza come chatbot, copiloti e sistemi in tempo reale

- Ampia finestra di contesto (400K): supporta documenti lunghi, flussi di lavoro multi-step e memoria degli agenti

- Solido supporto per coding e agenti: progettato per l’uso di strumenti, il ragionamento multi-step e i compiti delegati a sotto-agenti

- Input multimodale: accetta sia testo sia immagini per flussi di lavoro più ricchi

- Scalabilità economicamente efficiente: significativamente più economico di GPT-5.4 pur mantenendo una forte capacità di ragionamento

- Ottimizzazione della pipeline di agenti: ideale per architetture multi-modello in cui i modelli grandi pianificano e i modelli mini eseguono

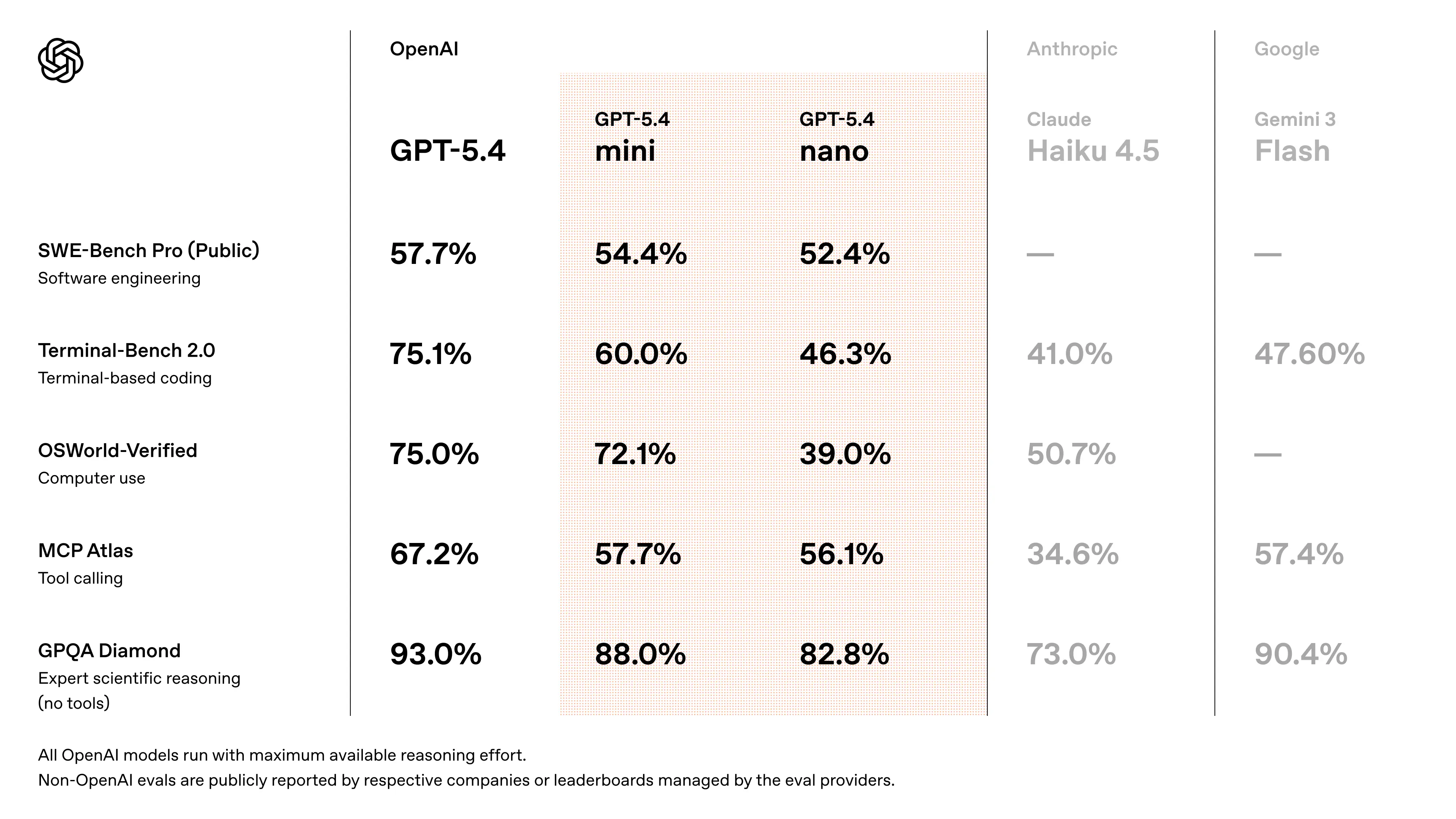

Prestazioni nei benchmark di GPT-5.4 Mini

- Si avvicina alle prestazioni di GPT-5.4 su task di coding in stile SWE-Bench (~94–95% delle prestazioni del modello di punta) (stima convalidata incrociando le discussioni sul rilascio)

- Miglioramenti significativi rispetto a GPT-5 Mini in:

- accuratezza del ragionamento

- affidabilità nell’uso degli strumenti

- comprensione multimodale

- Progettato per superare le precedenti generazioni “mini” nei flussi di lavoro con agenti e nei benchmark di coding

- misurazioni della velocità: i primi tester API riportano ~180–190 token/sec su GPT-5.4 Mini (contro ~55–120 t/s per le vecchie varianti GPT-5 mini a seconda delle modalità di priorità).

👉 Punto chiave: GPT-5.4 Mini offre prestazioni quasi di frontiera a una frazione del costo e della latenza, rendendolo ideale per sistemi scalabili.

Casi d’uso rappresentativi

- Assistenti di coding ed editor (plugin IDE, Copilot): parsing rapido del contesto, esplorazione della codebase e completamenti veloci rendono GPT-5.4 Mini ideale per suggerimenti direttamente nell’editor, dove il tempo al primo token è importante. GitHub Copilot è una delle prime integrazioni.

- Subagenti / worker delegati: scenari in cui un agente master delega compiti brevi e veloci (formattazione, piccoli passaggi di ragionamento, ricerche in stile grep) a un worker economico e rapido. OpenAI posiziona mini/nano per questi ruoli.

- Automazione API ad alto volume: generazione massiva di codice, smistamento automatico dei ticket, riepilogo dei log su larga scala, dove costo per chiamata e latenza sono i principali vincoli. I dati di throughput della community indicano vantaggi operativi concreti per mini.

- Wrapping di strumenti e toolchain: chiamate rapide agli strumenti, in cui il modello orchestra chiamate a strumenti esterni (ricerca, grep, esecuzione di test) e restituisce output compatti e utilizzabili. La famiglia GPT-5.4 include capacità migliorate di “computer use”.

Come accedere all’API di GPT-5.4 Mini

Passaggio 1: Registrarsi per ottenere una chiave API

Accedi a cometapi.com. Se non sei ancora un nostro utente, registrati prima. Accedi alla tua console CometAPI. Ottieni la credenziale di accesso API key dell’interfaccia. Fai clic su “Add Token” nella sezione API token del centro personale, ottieni la chiave token: sk-xxxxx e inviala.

Passaggio 2: Inviare richieste all’API di GPT-5.4 Mini

Seleziona l’endpoint “gpt-5.4-mini” per inviare la richiesta API e imposta il corpo della richiesta. Il metodo della richiesta e il corpo della richiesta si ottengono dalla documentazione API sul nostro sito web. Il nostro sito web fornisce anche il test Apifox per tua comodità. Sostituisci <YOUR_API_KEY> con la tua effettiva chiave CometAPI del tuo account. Il base url è Chat Completions e Responses.

Inserisci la tua domanda o richiesta nel campo content: è ciò a cui il modello risponderà. Elabora la risposta API per ottenere la risposta generata.

Passaggio 3: Recuperare e verificare i risultati

Elabora la risposta API per ottenere la risposta generata. Dopo l’elaborazione, l’API risponde con lo stato del task e i dati di output.