L’integrazione di CometAPI con n8n ti consente di potenziare le tue automazioni con i modelli di IA più avanzati al mondo in soli tre passaggi. Utilizzando un’unica credenziale compatibile con OpenAI, ottieni accesso istantaneo a oltre 500 modelli, tra cui GPT 5.5, Claude Opus 4.7 e DeepSeek V4 Pro. Questa configurazione è identica sia per le istanze n8n cloud che self-hosted, offrendo una base stabile e ad alta disponibilità per l’automazione dei workflow IA in n8n.

Che cos’è n8n e perché è importante

n8n è uno strumento open-source di automazione dei workflow. Ti permette di collegare app, servizi e API per automatizzare attività, senza dover scrivere molto codice.

Cosa fa

Pensa a n8n come a un modo visivo per creare automazioni:

- Crei workflow usando un editor drag-and-drop

- Ogni passaggio (chiamato nodo) esegue un’azione

- I dati fluiscono automaticamente da un passaggio al successivo

Caratteristiche principali

- Open source (puoi auto-ospitarlo)

- Supporta centinaia di integrazioni (API, app, database)

- Consente logica JavaScript personalizzata all’interno dei workflow

- Può essere eseguito sul tuo server o tramite il servizio cloud sul sito ufficiale n8n

Perché collegare n8n a CometAPI

Usare CometAPI come gateway centrale in n8n offre vantaggi operativi significativi. Sostituendo le chiavi separate per OpenAI, Anthropic e Google con un’unica credenziale, il tuo team può eliminare l’onere di gestire molteplici account vendor e cicli di fatturazione complessi. Questa architettura garantisce assenza di lock-in verso un fornitore: puoi passare ai modelli più recenti di diversi provider semplicemente aggiornando il nome del modello nelle impostazioni del nodo, consentendo ai tuoi workflow di rimanere agili man mano che l’ecosistema IA evolve.

CometAPI funge da API REST unificata che aggrega oltre 500 modelli per chat, immagini, video, audio (TTS/STT) ed embeddings. Benefici principali:

- Endpoint compatibile con OpenAI (

https://api.cometapi.com/v1): compatibilità plug-and-play con i nodi OpenAI o HTTP Request. - Prezzi inferiori del 20-40% rispetto ai vendor diretti, con pay-as-you-go, nessun canone mensile per le funzionalità di base e fatturazione unificata.

- Nessun vendor lock-in: cambia modello con una singola modifica di parametro.

- Funzionalità Enterprise: routing di failover, analytics, controlli di privacy (nessuna raccolta di prompt, come affermato in alcune discussioni) e accesso affidabile.

Ultimi sviluppi (a maggio 2026): CometAPI mantiene un’integrazione verificata/partner su n8n.io, con un nodo community dedicato (n8n-nodes-cometapi) disponibile via npm per istanze locali/self-hosted. Gli utenti segnalano una fluida compatibilità con i nodi OpenAI e un’adozione crescente per workflow multi-modello. Aggiornamenti recenti di n8n migliorano tool-calling e nodi HTTP, rendendo le integrazioni più robuste.

Per iniziare: prerequisiti e configurazione dell’account

Registrati a CometAPI

Visita cometapi.com, crea un account gratuito e genera una chiave API nella dashboard. I nuovi utenti spesso ricevono crediti di prova. Esplora l’elenco dei modelli e la pagina dei prezzi.

Configura n8n

- Cloud: n8n.cloud (gestito, con scalabilità semplice).

- Self-hosted: Docker, npm o Kubernetes. Raccomandato per la privacy dei dati e esecuzioni illimitate. Guide recenti trattano l’esecuzione dei nodi CometAPI in locale.

Aggiorna all’ultima versione (es. 2.20+ a maggio 2026) per miglioramenti in ambito IA e stabilità.

Installa il nodo CometAPI (opzionale ma consigliato per il self-hosting)

Usa il nodo community:

npm install n8n-nodes-cometapi

Riavvia n8n. Apparirà nel pannello dei nodi per un’esperienza nativa.

Guida passo-passo alla configurazione

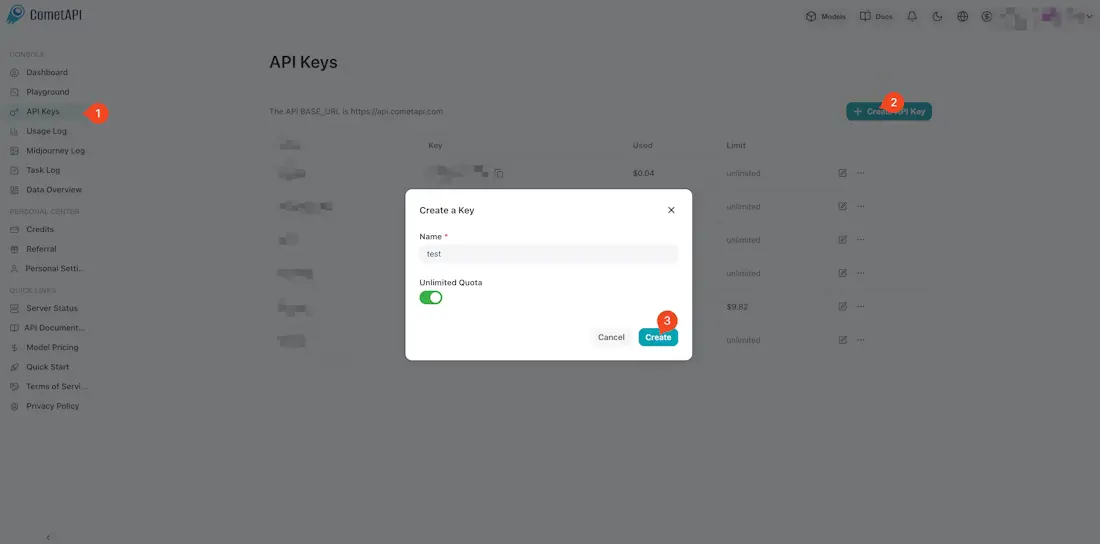

Passaggio 1: ottieni la tua chiave API CometAPI

Accedi alla dashboard di CometAPI e vai alla sezione API Token. Fai clic su Add API Key per generare la tua credenziale univoca.

Copia la tua chiave (in genere nel formato sk-xxxx) e tieni a portata di mano la Base URL: https://api.cometapi.com/v1.

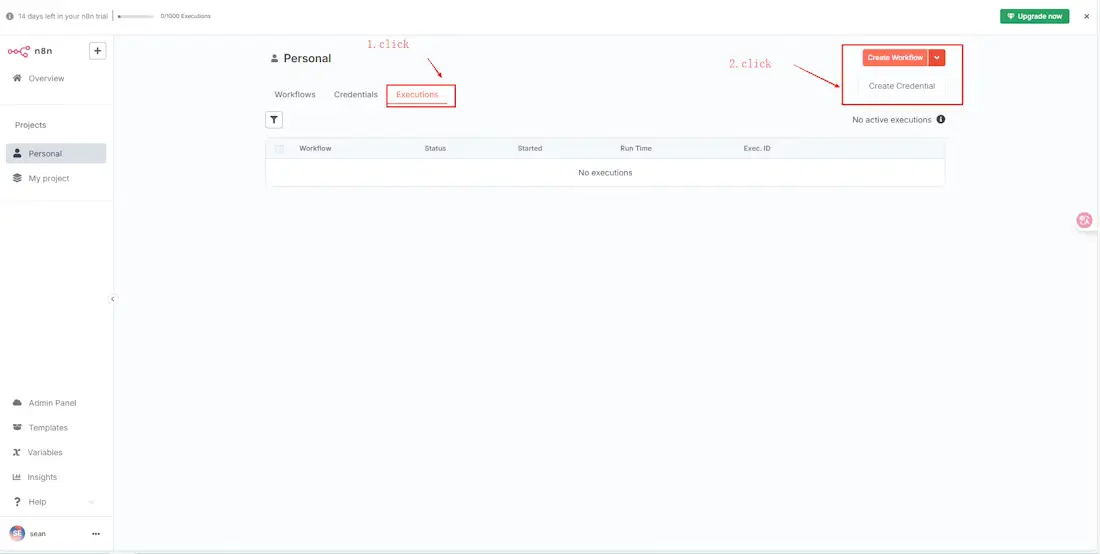

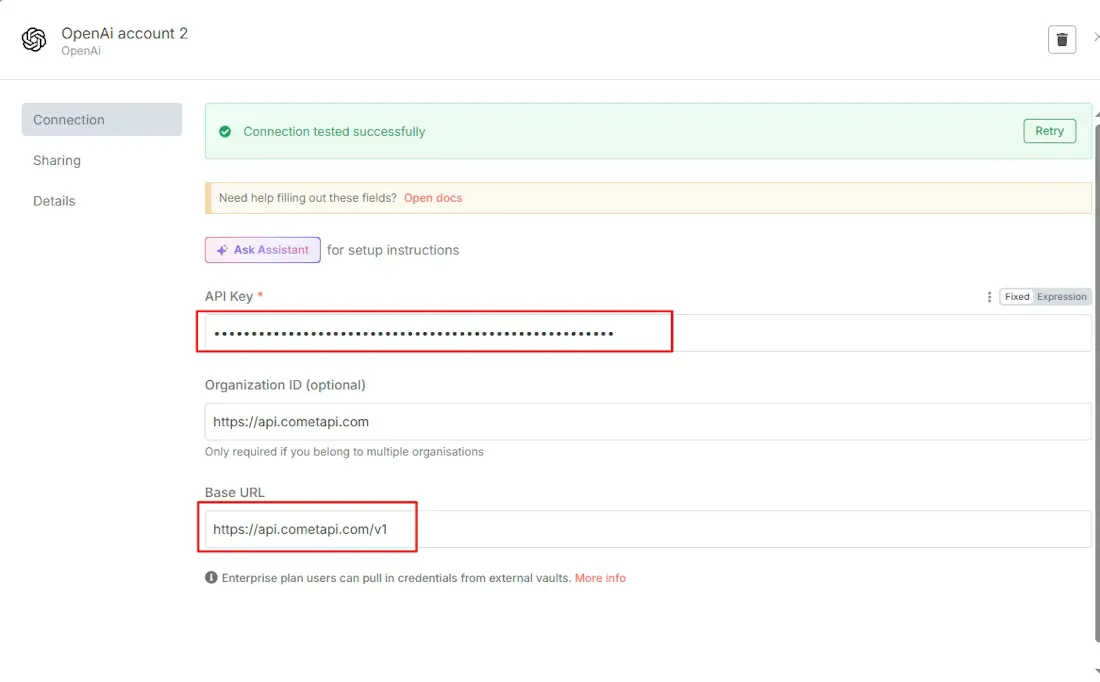

Passaggio 2: crea la credenziale OpenAI in n8n

Apri la tua istanza n8n e vai su Credentials → Create Credential. Cerca e seleziona il tipo di credenziale OpenAI API.

- API Key: incolla qui il tuo token CometAPI.

- Base URL: inserisci

https://api.cometapi.com/v1.

Fai clic su Save per completare la configurazione.

Passaggio 3: testa la connessione

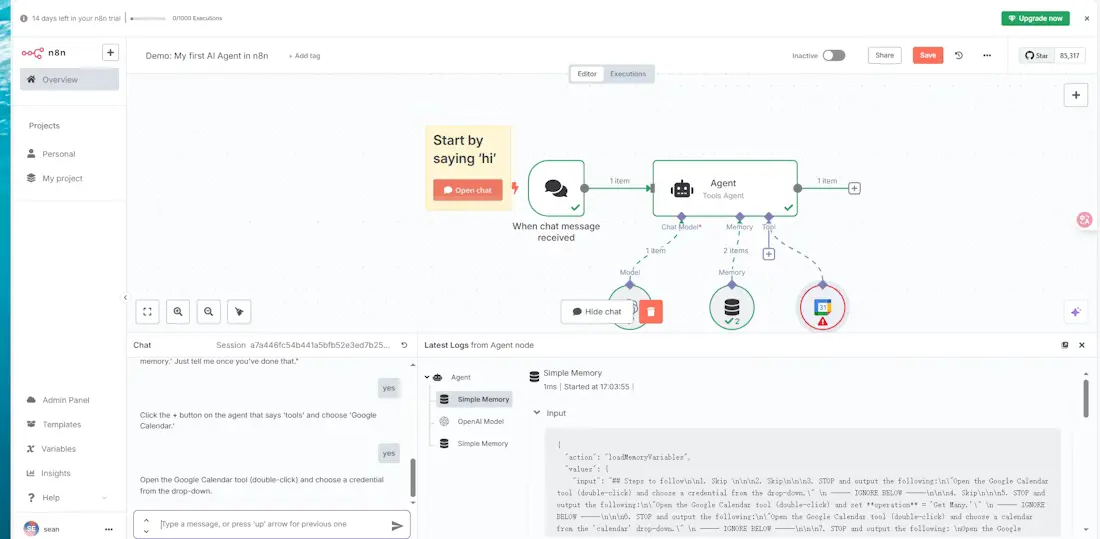

Crea un nuovo workflow e aggiungi un nodo OpenAI (come Chat Model o AI Agent). Seleziona la credenziale CometAPI che hai appena creato. Nel campo del modello, ora puoi inserire qualsiasi ID modello supportato, come gpt-5.5 o claude-opus-4-7. Esegui il nodo; una risposta positiva verifica che il tuo bridge API compatibile con OpenAI in n8n sia configurato correttamente.

Risoluzione dei problemi comuni

Se l’integrazione non funziona subito, verifica queste tre aree comuni:

L’API restituisce un errore 401 Unauthorized

Questo errore in genere significa che n8n non riesce ad autenticarsi con il gateway. Per prima cosa, verifica di aver copiato correttamente la chiave API senza spazi iniziali o finali. In secondo luogo, assicurati che la tua Base URL includa il suffisso /v1. Senza il path di versione, l’endpoint potrebbe rifiutare la richiesta.

Nome del modello non riconosciuto

CometAPI ospita oltre 500 modelli, ognuno con un identificatore specifico. Se n8n restituisce un errore "Model not found", assicurati di utilizzare l’ID modello esatto dalla documentazione di CometAPI. Ad esempio, usa gpt-5.5-pro invece di gpt-5-pro se questo è l’identificatore nel catalogo corrente.

La velocità di risposta è lenta

Per applicazioni in tempo reale in cui la latenza è critica, alcuni modelli orientati al ragionamento possono richiedere più tempo. Se il tuo workflow necessita di risposte quasi istantanee, prova a passare a un modello ad alto throughput come Gemini 3.1 Flash-Lite o DeepSeek V4 Flash, ottimizzati per la velocità.

Quali modelli puoi usare in n8n tramite CometAPI

| Categoria modello | Esempi | Ideale per |

|---|---|---|

| Testo/Chat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Ragionamento professionale e logica complessa |

| Code | DeepSeek V4 Pro, GPT 5.3 Codex | Coding agentico e refactor su interi repo |

| Immagine | GPT Image 2, Flux 2 Max | Contenuti visivi ad alta fedeltà e design |

| Video | Sora 2, Doubao-Seedance 2.0 | Automazione cinematografica e clip social |

Template di workflow n8n pronti all’uso

Integrare CometAPI in n8n consente logiche multi-modello sofisticate. Ecco tre template che puoi creare oggi.

Template 1: automazione dell’assistenza clienti

- Trigger: un Webhook node riceve un ticket di assistenza dal tuo sito.

- Elaborazione: un nodo CometAPI (OpenAI) utilizza Claude Opus 4.7 per analizzare il testo del ticket.

- Logica: un Switch node valuta la "gravità" o la "complessità" prodotta dall’IA.

- Diramazione: le richieste semplici (per es., "Dov’è il mio ordine?") vengono instradate a un nodo di risposta automatica. Le problematiche tecniche complesse sono instradate a un Slack node o Zendesk node per l’intervento umano.

- Configurazione del nodo: imposta il nodo Claude su

thinking: {type: "adaptive"}per assicurarti che dedichi più tempo ai casi di sentiment analysis difficili.

Template 2: pipeline di contenuti automatizzata

- Trigger: un RSS Feed node rileva un nuovo articolo nel tuo settore.

- Elaborazione 1: usa GPT 5.5 per leggere l’articolo e generare un executive summary di 200 parole per la newsletter interna.

- Elaborazione 2: passa il sommario a DeepSeek V3 per generare cinque tag e keyword SEO.

- Output: il sommario e i tag vengono pubblicati su un database Notion o su un WordPress node.

- Perché questo Swarm?: usando GPT 5.5 per il sommario di alta qualità e il più economico DeepSeek V3 per il semplice tagging, mantieni alta la qualità riducendo sensibilmente il costo totale dei token.

Template 3: workflow di generazione immagini

- Trigger: un Google Sheets node rileva una nuova riga con nome e descrizione del prodotto.

- Elaborazione: la descrizione viene inviata a un nodo CometAPI (OpenAI) usando l’endpoint

/v1/images/generationscon il modello Flux 2 Max. - Storage: l’URL dell’immagine generata viene passato a un Google Drive node per il caricamento e il salvataggio del file.

- Configurazione del nodo: imposta il parametro

nsu 1 e scegli una risoluzione come1024x1024per mockup di prodotto ad alta qualità.

Consigli per l’ottimizzazione dei costi con n8n + CometAPI

Per massimizzare lo sconto del 20-40%, segui queste strategie architetturali.

Usa modelli economici per classificazione e instradamento

Non usare GPT 5.5 Pro per semplici decisioni "Sì/No" o "Categoria A/B". Usa DeepSeek V4 Flash o GPT 5.4 nano per questi compiti. Questi modelli costano una frazione dei flagship e spesso sono più veloci, quindi il tuo workflow n8n viene eseguito in modo più efficiente.

Imposta la selezione condizionale del modello in n8n

Usa uno Switch node o un If node per scegliere un modello in base alla lunghezza dell’input o alla priorità. Ad esempio, se un documento ha meno di 1.000 parole, instradalo a un modello standard. Se è un repository enorme da 500.000 token, instradalo a un modello a contesto lungo come Grok 4.20 o Claude Opus 4.7.

Elaborazione a lotti vs. in tempo reale

Se il tuo workflow n8n non richiede risposte immediate (per es., un report di fine giornata), usa un Wait node o un Schedule node per raccogliere gli input ed elaborarli in un unico batch. CometAPI supporta un’elevata concorrenza, ma ridurre la frequenza di chiamate piccole e separate può aiutarti a rimanere entro limiti di rate più bassi e a semplificare i log d’uso.

Tabella di confronto: n8n + CometAPI vs. alternative

| Funzionalità | n8n + CometAPI | Zapier + Multiple AIs | Make.com + Direct APIs | Custom Code (Python/Node) |

|---|---|---|---|---|

| Costo | Basso (risparmio 20-40% + n8n free/self-host) | Alto (per task + per API) | Medio | Variabile (tempo di sviluppo) |

| Facilità d’uso | Visuale, low-code | Molto facile | Visuale | Richiede molto coding |

| Flessibilità | Illimitata (HTTP + 400+ nodi) | Template limitati | Buona | Massima |

| Accesso ai modelli | 500+ unificati | Frammentato | Dipende | Manuale |

| Self-hosting/Privacy dati | Eccellente | Limitata | Orientato al cloud | Controllo totale |

| Scalabilità | Alta (modalità coda, worker) | Limiti di prezzo basati sull’uso | Buona | Dipende dall’infrastruttura |

| Manutenzione | Bassa (un’integrazione) | Alta (connessioni multiple) | Media | Alta |

| Supporto agli agenti IA | Nativo + strumenti | Base | In crescita | Personalizzato |

Verdetto: n8n + CometAPI vince per i team che necessitano di potenza, controllo ed efficienza dei costi.

Prospettive future e consigli di ottimizzazione

Con la proliferazione dei modelli nel 2026, piattaforme unificate come CometAPI, abbinate a orchestratori flessibili come n8n, diventano essenziali. Aspettati nodi sempre più nativi, migliori integrazioni MCP/server e capacità avanzate per agenti.

Ottimizzazione su Cometapi.com:

- Monitora l’uso dei token tra i workflow per analizzare il ROI.

- Sfrutta gli analytics di CometAPI + i dati di esecuzione di n8n.

- Sperimenta con modelli più recenti (es., DeepSeek-V4) per task specializzati a costo inferiore.

- Combina con altri strumenti CometAPI per soluzioni IA end-to-end.

Guida rapida: crea oggi un semplice workflow di sintesi. Scala domani verso operazioni IA complete.

Pronto per iniziare? Vai su CometAPI per ottenere la tua chiave API gratuita e i crediti. In self-hosting o su cloud n8n, connettiti seguendo i passaggi sopra e trasforma le tue automazioni. Per workflow personalizzati o consulenza enterprise, esplora le opzioni su Cometapi.com.

Questa integrazione non è solo tecnica: è un moltiplicatore strategico di produttività e innovazione nell’era dell’IA.

FAQ

D: Ho bisogno di una credenziale separata per ogni modello di IA?

R: No. Un’unica credenziale CometAPI fornisce accesso a oltre 500 modelli in n8n, da GPT e Claude a DeepSeek e Kimi.

D: CometAPI è più economico rispetto all’uso diretto di OpenAI in n8n?

R: Sì. I prezzi CometAPI sono fissati al 20-40% in meno rispetto alle tariffe retail ufficiali per gli stessi modelli.

D: Funziona con n8n self-hosted?

R: Sì. Il processo di configurazione è identico sia per n8n Cloud che per le versioni Docker self-hosted.

D: Quali nodi n8n funzionano con CometAPI?

R: Qualsiasi nodo che accetta credenziali OpenAI funziona, inclusi AI Agent, Chat Model e i nodi di completion standard.

D: Posso cambiare modello senza riconfigurare n8n?

R: Sì. Basta aggiornare la stringa del nome modello nelle impostazioni del nodo (es., cambia gpt-5.5 in claude-opus-4-7); la credenziale sottostante rimane valida per tutti i provider.