. Pensatore aperto-32B API è un'interfaccia open source altamente efficiente che consente agli sviluppatori di sfruttare la comprensione avanzata del linguaggio, le capacità multimodali e le funzionalità personalizzabili del modello per un'ampia gamma di applicazioni con un sovraccarico minimo di risorse.

Introduzione

L'intelligenza artificiale continua a ridefinire i confini della tecnologia e OpenThinker-32B rappresenta una testimonianza di questa evoluzione. Progettato per spingere i limiti delle capacità di apprendimento automatico, questo modello rappresenta un significativo balzo in avanti nell'elaborazione del linguaggio naturale (NLP), nel ragionamento e nell'intelligenza multimodale. Che tu sia uno sviluppatore, un ricercatore o un leader aziendale, comprendere le complessità di OpenThinker-32B può aprire nuove possibilità di innovazione ed efficienza.

In questa introduzione completa, esploreremo l' OpenThinker-32B modello in profondità, a partire dalla sua definizione di base e API, seguita dalla sua architettura tecnica, percorso evolutivo, vantaggi chiave, indicatori di prestazioni misurabili e scenari di applicazione nel mondo reale. Alla fine, avrai un quadro chiaro del motivo per cui questo modello di IA è pronto a plasmare il futuro dei sistemi intelligenti.

Che cosa è OpenThinker-32B? Una rapida panoramica

Nel suo nucleo, OpenThinker-32B è un modello di intelligenza artificiale basato su un trasformatore da 32 miliardi di parametri sviluppato per eccellere nella comprensione di linguaggi complessi, nella generazione e nella risoluzione di problemi multi-task. API OpenThinker-32B può essere descritto in una frase: Un'interfaccia potente che consente agli sviluppatori di integrare facilmente funzionalità NLP, ragionamento e multimodali avanzate nelle applicazioni. Progettata pensando a scalabilità e adattabilità, si rivolge a un'ampia gamma di settori, dall'assistenza sanitaria alla finanza, fino alla generazione di contenuti creativi.

L'architettura del modello sfrutta i progressi all'avanguardia nell'apprendimento profondo, rendendolo un elemento di spicco nel panorama affollato delle soluzioni AI. La sua capacità di elaborare vasti set di dati, generare testo simile a quello umano ed eseguire ragionamenti contestuali lo distingue come uno strumento versatile per uso sia accademico che commerciale.

Le basi tecniche di OpenThinker-32B

Architettura di modello

. OpenThinker-32B Il modello è basato su un'architettura di trasformazione, un framework che è diventato la spina dorsale dei moderni sistemi NLP. Con 32 miliardi di parametri, raggiunge un equilibrio tra efficienza computazionale e alte prestazioni. L'architettura include più livelli di nodi interconnessi, consentendo al modello di catturare dipendenze a lungo raggio nel testo ed eseguire l'elaborazione parallela dei dati.

I componenti tecnici chiave includono:

- Meccanismi di attenzione: I livelli di auto-attenzione multi-testa migliorati consentono OpenThinker-32B per concentrarsi sulle parti rilevanti dei dati di input, migliorando la precisione in attività come la traduzione e la sintesi.

- tokenizzazione: Un tokenizzatore personalizzato ottimizza l'elaborazione degli input, riducendo la latenza e migliorando la capacità del modello di gestire linguaggi e formati diversi.

- Dati di allenamento: Addestrato su un corpus enorme e diversificato di testo e dati multimodali, il modello eccelle nella generalizzazione tra domini.

Requisiti computazionali

corsa OpenThinker-32B richiede risorse computazionali significative, che in genere coinvolgono GPU o TPU ad alte prestazioni. Ad esempio, l'inferenza su una singola GPU A100 può elaborare fino a 50 token al secondo, a seconda della complessità dell'input. Questa scalabilità lo rende adatto sia per distribuzioni basate su cloud che per soluzioni on-premise, a seconda delle esigenze dell'utente.

Il viaggio evolutivo di OpenThinker-32B

Dai primi modelli alla 32B

Lo sviluppo di OpenThinker-32B è il culmine di anni di ricerca e iterazione. I suoi predecessori, come le varianti più piccole di OpenThinker (ad esempio, i modelli 7B e 13B), hanno gettato le basi perfezionando le tecniche di training e ottimizzando l'efficienza dei parametri. Il salto a 32 miliardi di parametri riflette un focus strategico sulla scalabilità dell'intelligenza senza sacrificare la precisione.

Pietre miliari

- Fase di pre-allenamento:La formazione iniziale ha comportato un apprendimento non supervisionato su un set di dati multi-terabyte, consentendo al modello di costruire una solida base di conoscenza.

- Ritocchi:La messa a punto specifica del dominio ha migliorato le prestazioni in attività specialistiche come l'analisi legale e la diagnosi medica.

- Integrazione multimodale: Gli aggiornamenti recenti hanno incorporato l'elaborazione di immagini e testo, ampliandone la portata oltre la tradizionale PNL.

Questo percorso evolutivo sottolinea l'adattabilità del modello, garantendone la pertinenza in un panorama tecnologico in continua evoluzione.

Vantaggi di OpenThinker-32B

Comprensione linguistica superiore

Una delle caratteristiche distintive di OpenThinker-32B è la sua capacità di comprendere e generare linguaggio naturale con una fluidità notevole. A differenza dei modelli precedenti, può gestire query sfumate, rilevare il sarcasmo e mantenere il contesto su conversazioni estese. Ciò lo rende ideale per chatbot, assistenti virtuali e sistemi di assistenza clienti.

Capacità multimodali

Al di là del testo, OpenThinker-32B supporta input multimodali, come immagini e dati strutturati. Ad esempio, può analizzare un referto medico insieme a un'immagine radiografica per fornire una diagnosi completa, dimostrando la sua versatilità nelle applicazioni del mondo reale.

Scalabilità ed efficienza

Nonostante le sue dimensioni, OpenThinker-32B è ottimizzato per l'efficienza. Tecniche come la sparsità e la quantizzazione riducono l'utilizzo della memoria, consentendone l'esecuzione su hardware che potrebbe avere difficoltà con modelli di dimensioni simili. Questo equilibrio di potenza e praticità è un vantaggio fondamentale per gli sviluppatori che lavorano con risorse limitate.

Ecosistema aperto

. OpenThinker-32B L'API è progettata con un ecosistema aperto in mente, incoraggiando la collaborazione e la personalizzazione. Gli sviluppatori possono perfezionare il modello per casi d'uso specifici, integrarlo con strumenti esistenti e contribuire al suo sviluppo continuo, promuovendo un approccio guidato dalla comunità all'innovazione dell'IA.

Indicatori tecnici e parametri di prestazione

Risultati del benchmark

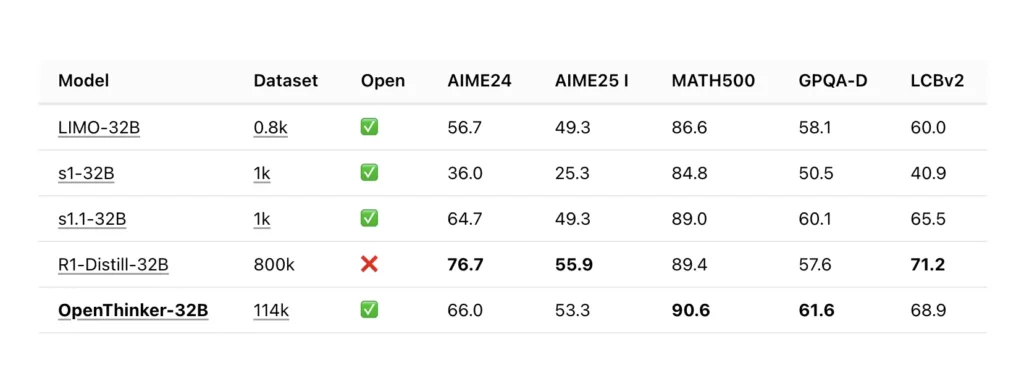

La performance di OpenThinker-32B è quantificabile attraverso parametri di riferimento standard del settore:

- Punteggio GLUE: Raggiungendo un punteggio di 92.5, rivaleggia con i modelli di livello superiore nei compiti di comprensione del linguaggio.

- SQUADRA 2.0: Un punteggio F91.3 di 1 dimostra la sua abilità nel rispondere alle domande e nella comprensione della lettura.

- Perplessità: Con una perplessità di 12.4 su diversi set di dati, genera testo coerente e contestualmente appropriato.

Velocità e latenza

La velocità di inferenza varia a seconda dell'hardware, ma in media, OpenThinker-32B elabora 45-60 token al secondo su GPU di fascia alta. La latenza per le chiamate API varia in genere da 50 a 200 millisecondi, rendendolo adatto per applicazioni in tempo reale.

Energy Efficiency

Rispetto ai peer con conteggi dei parametri simili, OpenThinker-32B consuma il 15% di energia in meno durante l'inferenza, grazie ad algoritmi ottimizzati e alla ridotta ridondanza nella sua architettura.

Scenari applicativi per OpenThinker-32B

Sistema Sanitario

In campo medico, OpenThinker-32B eccelle nell'analisi delle cartelle cliniche dei pazienti, nell'interpretazione delle immagini diagnostiche e nella generazione di report dettagliati. Ad esempio, un ospedale potrebbe utilizzarlo per confrontare i sintomi con un database globale, migliorando l'accuratezza diagnostica e la pianificazione del trattamento.

Amministrazione

Leva finanziaria degli istituti finanziari OpenThinker-32B per la valutazione del rischio, il rilevamento delle frodi e l'analisi di mercato. La sua capacità di elaborare dati non strutturati, come articoli di giornale e resoconti sugli utili, consente un processo decisionale più informato.

Formazione

Gli educatori e gli studenti ne traggono vantaggio OpenThinker-32B tramite strumenti di apprendimento personalizzati. Può generare materiali di studio personalizzati, valutare saggi con feedback contestuale e persino simulare sessioni di tutoraggio.

Industrie creative

Scrittori, addetti al marketing e designer utilizzano OpenThinker-32B per fare brainstorming di idee, abbozzare contenuti e creare narrazioni visivamente ispirate. Le sue capacità multimodali gli consentono di suggerire modifiche basate sia sul testo che sulle immagini di accompagnamento.

Servizio clienti

Le aziende distribuiscono OpenThinker-32B in chatbot e agenti virtuali per gestire richieste complesse dei clienti. La sua fluidità del linguaggio naturale riduce i tassi di escalation e migliora la soddisfazione dell'utente.

Argomenti correlati:I 3 migliori modelli di generazione musicale AI del 2025

Conclusione

. OpenThinker-32B modello è più di una semplice IA: è uno strumento trasformativo che unisce l'ingegno umano e l'intelligenza artificiale. Dalle sue solide basi tecniche alle sue applicazioni di vasta portata, esemplifica il potenziale dell'IA moderna per risolvere le sfide del mondo reale. Che tu stia cercando di semplificare le operazioni, innovare nel tuo campo o spingere i confini della ricerca, OpenThinker-32B fornisce le capacità per realizzarlo.

Con i suoi 32 miliardi di parametri che lavorano in armonia, questo modello è pronto a guidare la carica nella prossima era dell'intelligenza artificiale. Esplora il API OpenThinker-32B oggi stesso e scopri come può portare i tuoi progetti a nuovi livelli.

Come chiamare OpenThinker-32B API dal nostro CometAPI

1.Accesso su cometapi.com. Se non sei ancora nostro utente, registrati prima

2.Ottieni la chiave API delle credenziali di accesso dell'interfaccia. Fai clic su "Aggiungi token" nel token API nel centro personale, ottieni la chiave del token: sk-xxxxx e invia.

-

Ottieni l'URL di questo sito: https://api.cometapi.com/

-

Seleziona il OpenThinker-32B endpoint per inviare la richiesta API e impostare il corpo della richiesta. Il metodo di richiesta e il corpo della richiesta sono ottenuti da il nostro documento API del sito webPer vostra comodità, il nostro sito web fornisce anche il test Apifox.

-

Elabora la risposta API per ottenere la risposta generata. Dopo aver inviato la richiesta API, riceverai un oggetto JSON contenente il completamento generato.