Il 19–20 novembre 2025 OpenAI ha rilasciato due aggiornamenti correlati ma distinti: GPT-5.1-Codex-Max, un nuovo modello di coding agentico per Codex che enfatizza il coding a lungo orizzonte, l’efficienza dei token e la “compattazione” per sostenere sessioni multi‑finestra; e GPT-5.1 Pro, un modello ChatGPT del tier Pro aggiornato, ottimizzato per risposte più chiare e capaci in lavori complessi e professionali.

Che cos’è GPT-5.1-Codex-Max e quale problema cerca di risolvere?

GPT-5.1-Codex-Max è un modello Codex specializzato di OpenAI, ottimizzato per flussi di lavoro di coding che richiedono ragionamento ed esecuzione sostenuti e a lungo orizzonte. Dove i modelli ordinari possono inciampare con contesti estremamente lunghi — ad esempio refactoring multi‑file, loop agentici complessi o attività CI/CD persistenti — Codex‑Max è progettato per compattare automaticamente e gestire lo stato di sessione su più finestre di contesto, consentendogli di continuare a lavorare in modo coerente man mano che un singolo progetto si estende a molte migliaia (o più) di token. OpenAI posiziona Codex‑Max come il passo successivo per rendere gli agenti capaci di codice realmente utili per lavori di ingegneria estesi.

Che cos’è GPT-5.1-Codex-Max e quale problema cerca di risolvere?

GPT-5.1-Codex-Max è un modello Codex specializzato di OpenAI, ottimizzato per flussi di lavoro di coding che richiedono ragionamento ed esecuzione sostenuti e a lungo orizzonte. Dove i modelli ordinari possono inciampare con contesti estremamente lunghi — ad esempio refactoring multi‑file, loop agentici complessi o attività CI/CD persistenti — Codex‑Max è progettato per compattare automaticamente e gestire lo stato di sessione su più finestre di contesto, consentendogli di continuare a lavorare in modo coerente man mano che un singolo progetto si estende a molte migliaia (o più) di token.

OpenAI lo descrive come “più veloce, più intelligente e più efficiente in termini di token in ogni fase del ciclo di sviluppo” ed è esplicitamente pensato per sostituire GPT‑5.1‑Codex come modello predefinito nelle interfacce Codex.

Panoramica delle funzionalità

- Compattazione per la continuità multi‑finestra: esegue il pruning e preserva il contesto critico per lavorare in modo coerente su milioni di token e ore. 0

- Efficienza dei token migliorata rispetto a GPT‑5.1‑Codex: fino a ~30% di token di ragionamento in meno per sforzi di ragionamento simili su alcuni benchmark di codice.

- Durabilità agentica a lungo orizzonte: osservata internamente la capacità di sostenere loop agentici multi‑ora/multi‑giorno (OpenAI ha documentato esecuzioni interne >24 ore).

- Integrazioni di piattaforma: disponibile oggi nel CLI di Codex, nelle estensioni IDE, nel cloud e negli strumenti di code review; accesso API in arrivo.

- Supporto all’ambiente Windows: OpenAI segnala specificamente che Windows è supportato per la prima volta nei flussi di lavoro Codex, ampliando la portata reale tra gli sviluppatori.

Come si confronta con i prodotti concorrenti (es. GitHub Copilot, altri AI per il coding)?

GPT‑5.1‑Codex‑Max è presentato come un collaboratore più autonomo e a lungo orizzonte rispetto agli strumenti di completamento per singola richiesta. Mentre Copilot e assistenti simili eccellono nei completamenti a breve termine all’interno dell’editor, i punti di forza di Codex‑Max sono l’orchestrazione di attività multi‑step, il mantenimento di uno stato coerente tra sessioni e la gestione di flussi che richiedono pianificazione, test e iterazione. Detto ciò, l’approccio migliore nella maggior parte dei team sarà ibrido: usare Codex‑Max per automazioni complesse e compiti agentici sostenuti e usare assistenti più leggeri per completamenti a livello di riga.

Come funziona GPT-5.1-Codex-Max?

Che cos’è la “compattazione” e come abilita lavori di lunga durata?

Un progresso tecnico centrale è la compattazione — un meccanismo interno che sottopone a pruning la cronologia della sessione preservando i pezzi salienti del contesto, così che il modello possa continuare il lavoro in modo coerente su più finestre di contesto. In pratica, ciò significa che le sessioni Codex prossime al limite di contesto verranno compattate (token più vecchi o di minor valore riassunti/preservati) in modo che l’agente disponga di una finestra fresca e possa continuare a iterare ripetutamente fino al completamento dell’attività. OpenAI riporta esecuzioni interne in cui il modello ha lavorato su compiti ininterrottamente per oltre 24 ore.

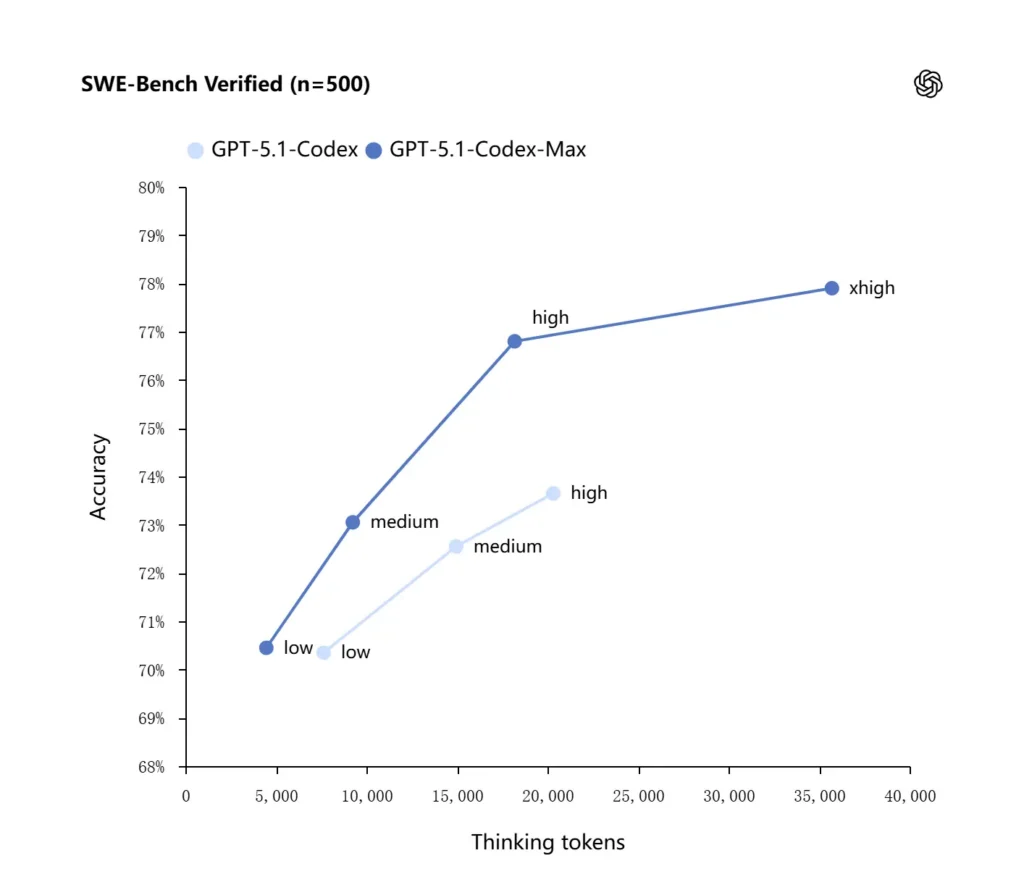

Ragionamento adattivo ed efficienza dei token

GPT‑5.1‑Codex‑Max applica strategie di ragionamento migliorate che lo rendono più efficiente nell’uso dei token: nei benchmark interni riportati da OpenAI, il modello Max ottiene prestazioni simili o migliori rispetto a GPT‑5.1‑Codex utilizzando significativamente meno token di ragionamento — OpenAI cita circa il 30% in meno di token di ragionamento su SWE‑bench Verified a parità di sforzo di ragionamento. Il modello introduce anche una modalità di sforzo di ragionamento “Extra High (xhigh)” per compiti non sensibili alla latenza che gli consente di spendere più ragionamento interno per ottenere output di qualità superiore.

Integrazioni di sistema e strumenti agentici

Codex‑Max viene distribuito all’interno dei flussi di lavoro Codex (CLI, estensioni IDE, cloud e superfici di code review) affinché possa interagire con le toolchain reali degli sviluppatori. Le prime integrazioni includono il CLI di Codex e gli agent IDE (VS Code, JetBrains, ecc.), con l’accesso API pianificato a seguire. L’obiettivo di design non è solo una sintesi di codice più intelligente, ma un’IA in grado di eseguire flussi multi‑step: aprire file, eseguire test, correggere i fallimenti, rifattorizzare e rieseguire.

Come si comporta GPT-5.1-Codex-Max nei benchmark e nel lavoro reale?

Ragionamento sostenuto e compiti a lungo orizzonte

Le valutazioni indicano miglioramenti misurabili nel ragionamento sostenuto e in compiti a lungo orizzonte:

- Valutazioni interne di OpenAI: Codex‑Max può lavorare su compiti per “più di 24 ore” in esperimenti interni e l’integrazione di Codex con gli strumenti per sviluppatori ha aumentato metriche interne di produttività ingegneristica (ad es. utilizzo e throughput di pull request). Queste sono affermazioni interne di OpenAI e indicano miglioramenti a livello di compito nella produttività reale.

- Valutazioni indipendenti (METR): il report indipendente di METR ha misurato l’orizzonte temporale osservato al 50% (una statistica che rappresenta il tempo mediano in cui il modello può sostenere in modo coerente un compito lungo) per GPT‑5.1‑Codex‑Max a circa 2 ore e 40 minuti (con un ampio intervallo di confidenza), in aumento rispetto alle 2 ore e 17 minuti di GPT‑5 in misurazioni comparabili — un miglioramento significativo e coerente nel mantenimento della coerenza a lungo.

Benchmark di codice

OpenAI riporta risultati migliorati sulle valutazioni di frontiera per il coding, in particolare su SWE‑bench Verified dove GPT‑5.1‑Codex‑Max supera GPT‑5.1‑Codex con migliore efficienza dei token. L’azienda evidenzia che, per lo stesso sforzo di ragionamento “medium”, il modello Max produce risultati migliori utilizzando circa il 30% in meno di token di ragionamento; per gli utenti che consentono un ragionamento interno più lungo, la modalità xhigh può elevare ulteriormente le risposte al costo della latenza.

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

In che modo GPT-5.1-Codex-Max si confronta con GPT-5.1-Codex?

Differenze in prestazioni e scopo

- Ambito: GPT‑5.1‑Codex era una variante di coding ad alte prestazioni della famiglia GPT‑5.1; Codex‑Max è esplicitamente un successore agentico a lungo orizzonte pensato per essere il default consigliato per ambienti Codex e simili.

- Efficienza dei token: Codex‑Max mostra guadagni materiali di efficienza dei token (affermazione di OpenAI di ~30% di token di ragionamento in meno) su SWE‑bench e nell’uso interno.

- Gestione del contesto: Codex‑Max introduce compattazione e gestione nativa multi‑finestra per sostenere compiti che superano una singola finestra di contesto; Codex non forniva nativamente questa capacità alla stessa scala.

- Prontezza degli strumenti: Codex‑Max viene fornito come modello predefinito di Codex su CLI, IDE e superfici di code review, segnalando una migrazione per i flussi di lavoro in produzione degli sviluppatori.

Quando usare quale modello?

- Usa GPT‑5.1‑Codex per assistenza interattiva al coding, modifiche rapide, piccoli refactoring e casi d’uso a bassa latenza in cui l’intero contesto rilevante rientra facilmente in una singola finestra.

- Usa GPT‑5.1‑Codex‑Max per refactoring multi‑file, attività agentiche automatizzate che richiedono molti cicli di iterazione, flussi di lavoro simili a CI/CD o quando ti serve che il modello mantenga una prospettiva a livello di progetto su molte interazioni.

Schemi di prompt pratici ed esempi per ottenere i risultati migliori?

Schemi di prompt che funzionano bene

- Sii esplicito su obiettivi e vincoli: “Rifattorizza X, preserva l’API pubblica, mantieni i nomi delle funzioni e assicurati che i test A,B,C passino.”

- Fornisci il contesto minimo riproducibile: collega il test che fallisce, includi stack trace e frammenti di file rilevanti anziché scaricare interi repository. Codex‑Max compatterà la cronologia secondo necessità.

- Usa istruzioni passo‑passo per compiti complessi: suddividi lavori grandi in una sequenza di sotto‑attività e lascia che Codex‑Max le iteri (ad es., “1) esegui i test 2) correggi i 3 test che falliscono più spesso 3) esegui il linter 4) riassumi le modifiche”).

- Chiedi spiegazioni e diff: richiedi sia la patch sia una breve motivazione, così i revisori umani possono valutare rapidamente sicurezza e intento.

Esempi di template di prompt

Attività di refactoring

“Rifattorizza il modulo

payment/per estrarre l’elaborazione dei pagamenti inpayment/processor.py. Mantieni stabili le firme delle funzioni pubbliche per i chiamanti esistenti. Crea unit test perprocess_payment()che coprano successo, errore di rete e carta non valida. Esegui la suite di test e restituisci i test falliti e una patch in formato diff unificato.”

Correzione bug + test

“Un test

tests/test_user_auth.py::test_token_refreshfallisce con traceback . Indaga la causa radice, proponi una correzione con modifiche minime e aggiungi un unit test per prevenire regressioni. Applica la patch ed esegui i test.”

Generazione iterativa di PR

“Implementa la funzionalità X: aggiungi l’endpoint

POST /api/exportche trasmette in streaming i risultati dell’export ed è autenticato. Crea l’endpoint, aggiungi la documentazione, crea i test e apri una PR con riepilogo e checklist degli elementi manuali.”

Per la maggior parte di questi, inizia con medium; passa a xhigh quando ti serve che il modello effettui ragionamento profondo su molti file e più iterazioni di test.

Come accedere a GPT-5.1-Codex-Max

Dove è disponibile oggi

OpenAI ha integrato GPT‑5.1‑Codex‑Max negli strumenti Codex oggi: il CLI di Codex, le estensioni IDE, il cloud e i flussi di code review usano Codex‑Max per impostazione predefinita (puoi optare per Codex‑Mini). La disponibilità API è in preparazione; GitHub Copilot ha anteprime pubbliche che includono i modelli GPT‑5.1 e della serie Codex.

Gli sviluppatori possono accedere a GPT‑5.1‑Codex‑Max e alla GPT-5.1-Codex API tramite CometAPI. Per iniziare, esplora le capacità dei modelli di CometAPI nel Playground e consulta la guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo di gran lunga inferiore al prezzo ufficiale per aiutarti nell’integrazione.

Pronto a iniziare?→ Iscriviti a CometAPI oggi!

Se vuoi conoscere altri suggerimenti, guide e notizie sull’AI, seguici su VK, X e Discord!

Avvio rapido (passo dopo passo pratico)

- Assicurati di avere accesso: conferma che il tuo piano di prodotto ChatGPT/Codex (Plus, Pro, Business, Edu, Enterprise) o il tuo piano API per sviluppatori supporti i modelli della famiglia GPT‑5.1/Codex.

- Installa il CLI di Codex o l’estensione IDE: se vuoi eseguire attività di codice localmente, installa il CLI di Codex o l’estensione IDE di Codex per VS Code / JetBrains / Xcode secondo le esigenze. Gli strumenti useranno per default GPT‑5.1‑Codex‑Max nelle configurazioni supportate.

- Scegli lo sforzo di ragionamento: inizia con medium per la maggior parte dei compiti. Per debug approfondito, refactoring complessi o quando vuoi che il modello “pensi” di più e non ti interessa la latenza della risposta, passa alle modalità high o xhigh. Per piccole correzioni rapide, low è ragionevole.

- Fornisci il contesto del repository: dai al modello un punto di partenza chiaro — un URL del repo o un set di file e una breve istruzione (ad es., “rifattorizza il modulo payment per usare I/O async e aggiungi unit test, mantieni i contratti a livello di funzione”). Codex‑Max compatterà la cronologia man mano che si avvicina ai limiti di contesto e continuerà il lavoro.

- Itera con i test: dopo che il modello ha prodotto patch, esegui le suite di test e restituisci i fallimenti come parte della sessione in corso. La compattazione e la continuità multi‑finestra consentono a Codex‑Max di conservare il contesto importante dei test falliti e iterare.

Conclusione:

GPT‑5.1‑Codex‑Max rappresenta un passo sostanziale verso assistenti di coding agentici in grado di sostenere compiti ingegneristici complessi e di lunga durata con maggiore efficienza e ragionamento. I progressi tecnici (compattazione, modalità di sforzo di ragionamento, training su ambiente Windows) lo rendono eccezionalmente adatto alle moderne organizzazioni di ingegneria — a patto che i team affianchino il modello a controlli operativi prudenti, chiare policy con l’uomo nel loop e un monitoraggio robusto. Per i team che lo adottano con attenzione, Codex‑Max ha il potenziale di trasformare il modo in cui il software è progettato, testato e mantenuto — convertendo il lavoro ingegneristico ripetitivo e gravoso in una collaborazione di maggior valore tra persone e modelli.