DeepSeek ha rilasciato DeepSeek V3.2 come successore della sua linea V3.x e una variante complementare DeepSeek-V3.2-Speciale che l’azienda posiziona come un’edizione “reasoning-first” ad alte prestazioni per l’uso con agenti/strumenti. V3.2 si basa sul lavoro sperimentale (V3.2-Exp) e introduce una maggiore capacità di ragionamento, un’edizione Speciale ottimizzata per prestazioni di livello “gold” in matematica/programmazione competitiva e ciò che DeepSeek descrive come un sistema dual-mode “thinking + tool” (pensiero + strumento) senza precedenti, che integra strettamente il ragionamento interno passo-passo con l’invocazione di strumenti esterni e i workflow degli agenti.

Che cos’è DeepSeek V3.2 — e in cosa differisce V3.2-Speciale?

DeepSeek-V3.2 è il successore ufficiale del ramo sperimentale DeepSeek V3.2-Exp. DeepSeek lo descrive come una famiglia di modelli “reasoning-first” costruiti per agenti, ossia modelli ottimizzati non solo per una qualità conversazionale naturale, ma specificamente per l’inferenza a più passaggi, l’invocazione di strumenti e un ragionamento in stile chain-of-thought affidabile quando operano in ambienti che includono strumenti esterni (API, esecuzione di codice, connettori dati).

Che cos’è DeepSeek-V3.2 (base)

- Posizionato come successore mainstream in produzione della linea sperimentale V3.2-Exp; pensato per un’ampia disponibilità tramite app/web/API di DeepSeek.

- Mantiene un equilibrio tra efficienza computazionale e ragionamento robusto per compiti agentici.

Che cos’è DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale è una variante che DeepSeek propone come “Edizione Speciale” a capacità superiore, messa a punto per ragionamento da competizione, matematica avanzata e prestazioni degli agenti. Presentata come una variante a capacità superiore che “spinge i confini delle capacità di ragionamento”. Al momento DeepSeek espone Speciale come modello solo API con instradamento di accesso temporaneo; le prime valutazioni indipendenti suggeriscono che sia posizionata per competere con modelli chiusi di fascia alta nei benchmark di ragionamento e coding.

Qual è la linea evolutiva e le scelte ingegneristiche che hanno portato a V3.2?

V3.2 eredita una linea di ingegneria iterativa pubblicizzata da DeepSeek nel 2025: V3 → V3.1 (Terminus) → V3.2-Exp (uno step sperimentale) → V3.2 → V3.2-Speciale. La sperimentale V3.2-Exp ha introdotto DeepSeek Sparse Attention (DSA) — un meccanismo di attenzione sparsa a grana fine volto a ridurre i costi di memoria e calcolo per contesti lunghissimi preservando la qualità dell’output. Quella ricerca su DSA e il lavoro di riduzione dei costi hanno rappresentato un trampolino tecnico per la famiglia V3.2 ufficiale.

Cosa c’è di nuovo in DeepSeek 3.2 ufficiale?

1) Capacità di ragionamento potenziate — in che modo è migliorato il ragionamento?

DeepSeek presenta V3.2 come “reasoning-first.” Ciò significa che architettura e fine-tuning si concentrano sull’esecuzione affidabile di inferenze multi-step, sul mantenimento di catene di pensiero interne e sul supporto dei tipi di deliberazione strutturata di cui gli agenti hanno bisogno per usare correttamente gli strumenti esterni.

In concreto, i miglioramenti includono:

- Training e RLHF (o procedure di allineamento analoghe) ottimizzati per incoraggiare la risoluzione esplicita dei problemi per passi e stati intermedi stabili (utili per ragionamento matematico, generazione di codice a più passaggi e compiti logici).

- Scelte architetturali e di funzione di perdita che preservano finestre di contesto più lunghe e consentono al modello di richiamare con fedeltà i passaggi di ragionamento precedenti.

- Modalità pratiche (vedi “dual-mode” di seguito) che consentono allo stesso modello di operare in modalità “chat” più veloce o in una modalità deliberativa “thinking”, in cui lavora intenzionalmente attraverso passaggi intermedi prima di agire.

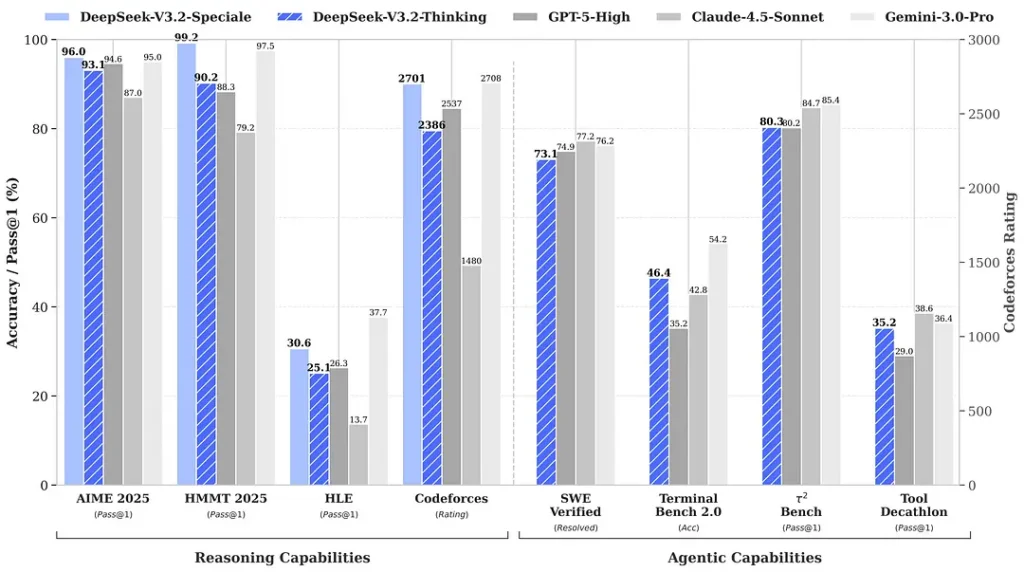

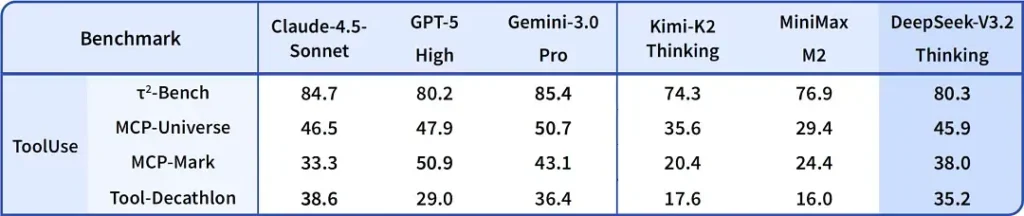

I benchmark citati al momento del rilascio riportano guadagni notevoli nelle suite di matematica e ragionamento; benchmark comunitari indipendenti iniziali segnalano anche punteggi impressionanti su set di valutazione competitivi:

2) Prestazioni rivoluzionarie nell’Edizione Speciale — quanto è migliore?

Si afferma che DeepSeek-V3.2-Speciale offra un salto in accuratezza di ragionamento e orchestrazione degli agenti rispetto a V3.2 standard. Il provider inquadra Speciale come un tier di prestazioni mirato a carichi pesanti di ragionamento e compiti agentici impegnativi; al momento è solo API ed è offerta come endpoint temporaneo, a capacità superiore (DeepSeek ha indicato che la disponibilità di Speciale sarà inizialmente limitata). La versione Speciale integra il precedente modello matematico DeepSeek-Math-V2; può dimostrare teoremi matematici e verificare autonomamente il ragionamento logico; ha ottenuto risultati notevoli in più competizioni di livello mondiale:

- 🥇 IMO (International Mathematical Olympiad) Medaglia d’oro

- 🥇 CMO (Chinese Mathematical Olympiad) Medaglia d’oro

- 🥈 ICPC (International Computer Programming Contest) Secondo posto (Competizione umana)

- 🥉 IOI (International Olympiad in Informatics) Decimo posto (Competizione umana)

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Prima implementazione in assoluto di un sistema dual-mode “thinking + tool”

Una delle affermazioni più interessanti sul piano pratico in V3.2 è un workflow dual-mode che separa (e consente di scegliere tra) operatività conversazionale rapida e una modalità “thinking” più lenta e deliberativa, integrata strettamente con l’uso degli strumenti.

- Modalità “Chat / veloce”: progettata per chat a bassa latenza, rivolte all’utente, con risposte concise e meno tracce di ragionamento interno — ideale per aiuto informale, brevi Q&A e applicazioni sensibili alla latenza.

- Modalità “Thinking / reasoner”: ottimizzata per chain-of-thought rigorosa, pianificazione per passi e orchestrazione di strumenti esterni (API, query a database, esecuzione di codice). In modalità thinking, il modello produce passaggi intermedi più espliciti, che possono essere ispezionati o usati per guidare chiamate a strumenti sicure e corrette nei sistemi agentici.

Questo schema (un design a due modalità) era presente nei rami sperimentali precedenti, e DeepSeek lo ha integrato più in profondità in V3.2 e Speciale — Speciale al momento supporta esclusivamente la modalità thinking (da qui il gating via API). La possibilità di scegliere tra velocità e deliberazione è preziosa in ingegneria perché consente agli sviluppatori di scegliere il giusto compromesso tra latenza e affidabilità quando costruiscono agenti che devono interagire con sistemi reali.

Perché è importante: molti sistemi moderni offrono o un modello con strong chain-of-thought (per spiegare il ragionamento) o un livello separato di orchestrazione agenti/strumenti. L’impostazione di DeepSeek suggerisce un accoppiamento più stretto — il modello può “pensare” e poi chiamare gli strumenti in modo deterministico, usando le risposte degli strumenti per informare il pensiero successivo — il che risulta più fluido per gli sviluppatori che costruiscono agenti autonomi.

Dove ottenere DeepSeek v3.2

In breve — puoi ottenere DeepSeek v3.2 in diversi modi a seconda delle tue esigenze:

- Web/app ufficiale (uso online) — prova l’interfaccia web DeepSeek o l’app mobile per usare V3.2 in modo interattivo.

- Accesso API — DeepSeek espone V3.2 tramite la sua API (nei documenti trovi i nomi dei modelli /

base_urle i prezzi). Registrati per ottenere una chiave API e chiama l’endpoint v3.2. - Pesi scaricabili/open (Hugging Face) — il modello (varianti V3.2 / V3.2-Exp) è pubblicato su Hugging Face e può essere scaricato (open-weight). Usa

huggingface-hubotransformersper recuperare i file. - CometAPI — una piattaforma di aggregazione API di AI che fornisce endpoint hosted per V3.2-Exp. Il prezzo è inferiore a quello ufficiale.

Alcune note pratiche:

- Se vuoi i pesi per eseguire in locale, vai alla pagina del modello su Hugging Face (accetta eventuale licenza/condizioni di accesso) e usa

huggingface-cliotransformersper scaricare; il repo GitHub di solito mostra i comandi esatti. - Se vuoi uso in produzione via API, segui la documentazione API della piattaforma che desideri, come CometAPI, per i nomi degli endpoint e il

base_urlcorretto per la variante V3.2.

DeepSeek-V3.2-Speciale:* Solo per uso di ricerca, supporta il dialogo in “Thinking Mode”, ma non supporta chiamate a strumenti.

- L’output massimo può raggiungere 128K token (catena di pensiero ultra-lunga).

- Attualmente gratuito per i test fino al 15 dicembre 2025.

Considerazioni finali

DeepSeek-V3.2 rappresenta un passo significativo nella maturazione dei modelli incentrati sul ragionamento. La combinazione di migliorato ragionamento multi-step, edizioni specializzate ad alte prestazioni (Speciale) e un’integrazione “thinking + tool” pronta per la produzione è degna di nota per chiunque costruisca agenti avanzati, assistenti di coding o workflow di ricerca che devono alternare deliberazione e azioni esterne.

Gli sviluppatori possono accedere a DeepSeek V3.2 tramite CometAPI. Per iniziare, esplora le capacità del modello di CometAPI nel Playground e consulta la Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo ben inferiore a quello ufficiale per aiutarti nell’integrazione.

Pronti a partire?→ Registrati a CometAPI oggi !

Se vuoi conoscere altri suggerimenti, guide e notizie sull’AI, seguici su VK, X e Discord!