GPT-5.2 è la release incrementale di dicembre 2025 della famiglia GPT-5 di OpenAI: una famiglia di modelli multimodali di punta (testo + visione + strumenti) ottimizzata per il lavoro di conoscenza professionale, il ragionamento su contesti lunghi, l’uso agentico degli strumenti e l’ingegneria del software. OpenAI posiziona GPT-5.2 come il modello più capace della serie GPT-5 fino ad oggi e afferma che è stato sviluppato con enfasi su ragionamento affidabile multi-step, gestione di documenti molto grandi e sicurezza/conformità alle policy migliorate; la release include tre varianti per gli utenti — Instant, Thinking e Pro — e viene distribuita inizialmente agli abbonati paganti di ChatGPT e ai clienti API.

Che cos’è GPT-5.2 e perché è importante?

GPT-5.2 è l’ultimo membro della famiglia GPT-5 — una nuova serie di modelli “di frontiera” progettata specificamente per colmare il divario tra assistenti conversazionali one-shot e sistemi che devono ragionare su documenti lunghi, chiamare strumenti, interpretare immagini ed eseguire flussi di lavoro multi-step in modo affidabile. OpenAI posiziona la 5.2 come la sua release più capace per il lavoro di conoscenza professionale: stabilisce nuovi risultati allo stato dell’arte su benchmark interni (in particolare un nuovo benchmark GDPval per il knowledge work), dimostra prestazioni di coding più solide su benchmark di ingegneria del software e offre capacità significativamente migliorate su contesti lunghi e visione.

In termini pratici, GPT-5.2 è più di un semplice “modello di chat più grande”. È una famiglia di tre varianti ottimizzate (Instant, Thinking, Pro) che bilanciano latenza, profondità di ragionamento e costo — e che, insieme all’API di OpenAI e al routing di ChatGPT, possono essere usate per eseguire lunghi lavori di ricerca, costruire agenti che chiamano strumenti esterni, interpretare immagini e grafici complessi e generare codice di livello produttivo con una fedeltà maggiore rispetto alle release precedenti. Il modello supporta finestre di contesto molto ampie (la documentazione OpenAI indica una finestra di contesto da 400.000 token e un limite di output massimo di 128.000 per i modelli di punta), nuove funzionalità API per livelli espliciti di sforzo di ragionamento e un comportamento di invocazione “agentico” degli strumenti.

5 funzionalità principali aggiornate in GPT-5.2

1) GPT-5.2 è migliore nella logica a più passaggi e nella matematica?

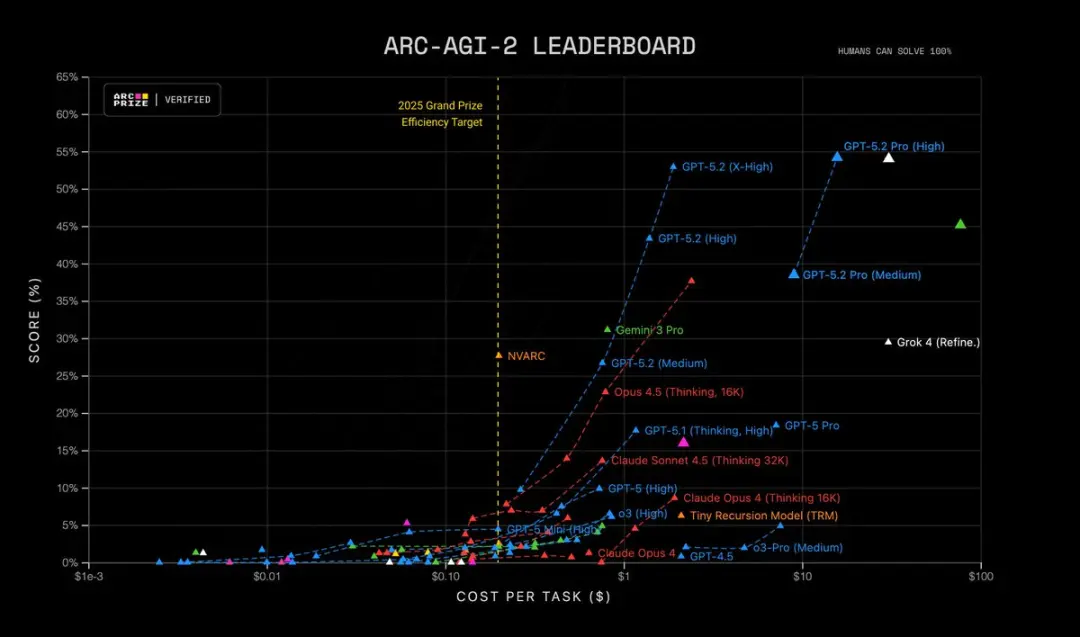

GPT-5.2 porta un ragionamento multi-step più acuto e prestazioni sensibilmente più forti in matematica e problem solving strutturato. OpenAI afferma di aver aggiunto un controllo più granulare dello sforzo di ragionamento (nuovi livelli come xhigh), introdotto il supporto per “token di ragionamento” e ottimizzato il modello per mantenere la catena di ragionamento su tracce interne più lunghe. Benchmark come FrontierMath e test in stile ARC-AGI mostrano guadagni sostanziali rispetto a GPT-5.1; margini maggiori su benchmark specifici di dominio usati in flussi di lavoro scientifici e finanziari. In breve: GPT-5.2 “pensa più a lungo” quando richiesto e può svolgere lavori simbolici/matematici più complessi con maggiore coerenza.

| RC-AGI-1 (Verified) Ragionamento astratto | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (Verified) Ragionamento astratto | 52.9% | 17.6% |

GPT-5.2 Thinking stabilisce record in molteplici test avanzati di scienza e ragionamento matematico:

- GPQA Diamond Science Quiz: 92.4% (versione Pro 93.2%)

- ARC-AGI-1 Ragionamento astratto: 86.2% (primo modello a superare la soglia del 90%)

- ARC-AGI-2 Ragionamento di ordine superiore: 52.9%, nuovo record per il modello Thinking Chain

- FrontierMath Test di matematica avanzata: 40.3%, nettamente superiore al suo predecessore;

- HMMT Problemi di gara di matematica: 99.4%

- Test AIME di matematica: 100% Soluzione completa

Inoltre, GPT-5.2 Pro (High) è lo stato dell’arte su ARC-AGI-2, raggiungendo un punteggio del 54.2% a un costo di $15.72 per task! Superando tutti gli altri modelli.

Perché è importante: molti compiti reali — modellazione finanziaria, progettazione di esperimenti, sintesi di programmi che richiede ragionamento formale — sono limitati dalla capacità di concatenare molti passaggi corretti. GPT-5.2 riduce i “passaggi allucinati” e produce tracce intermedie di ragionamento più stabili quando gli si chiede di mostrare il lavoro svolto.

2) In che modo sono migliorate la comprensione di testi lunghi e il ragionamento tra documenti?

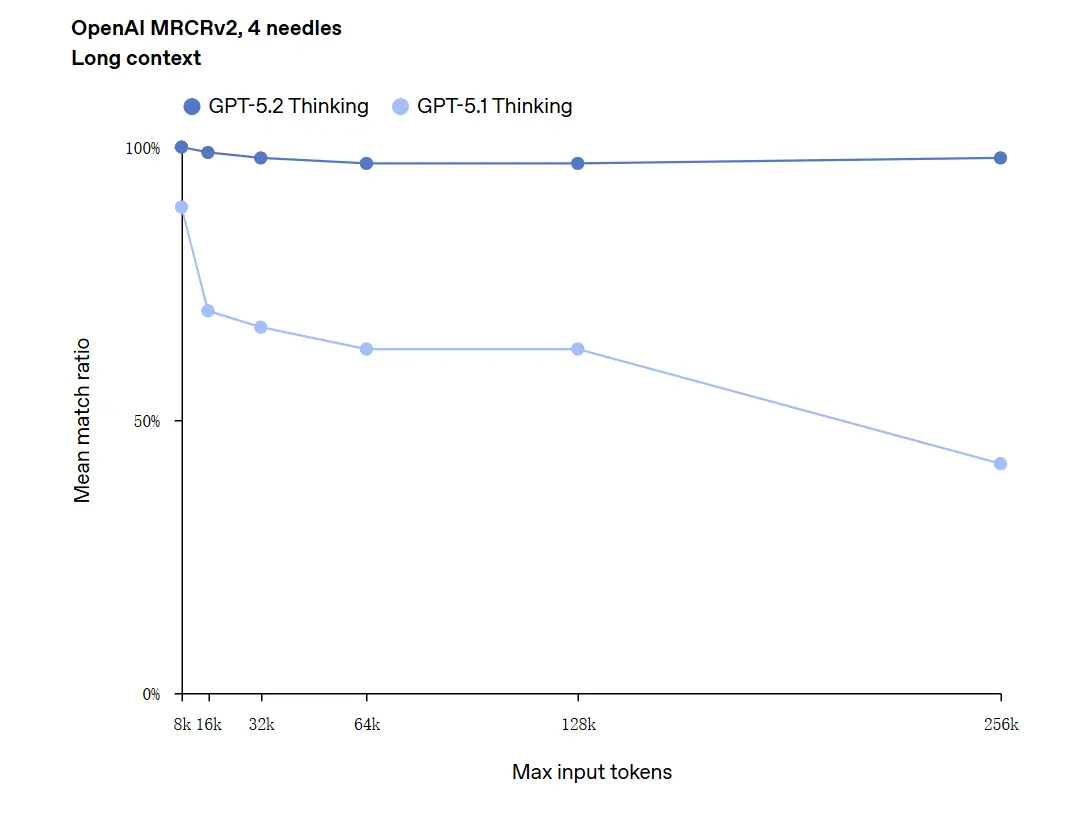

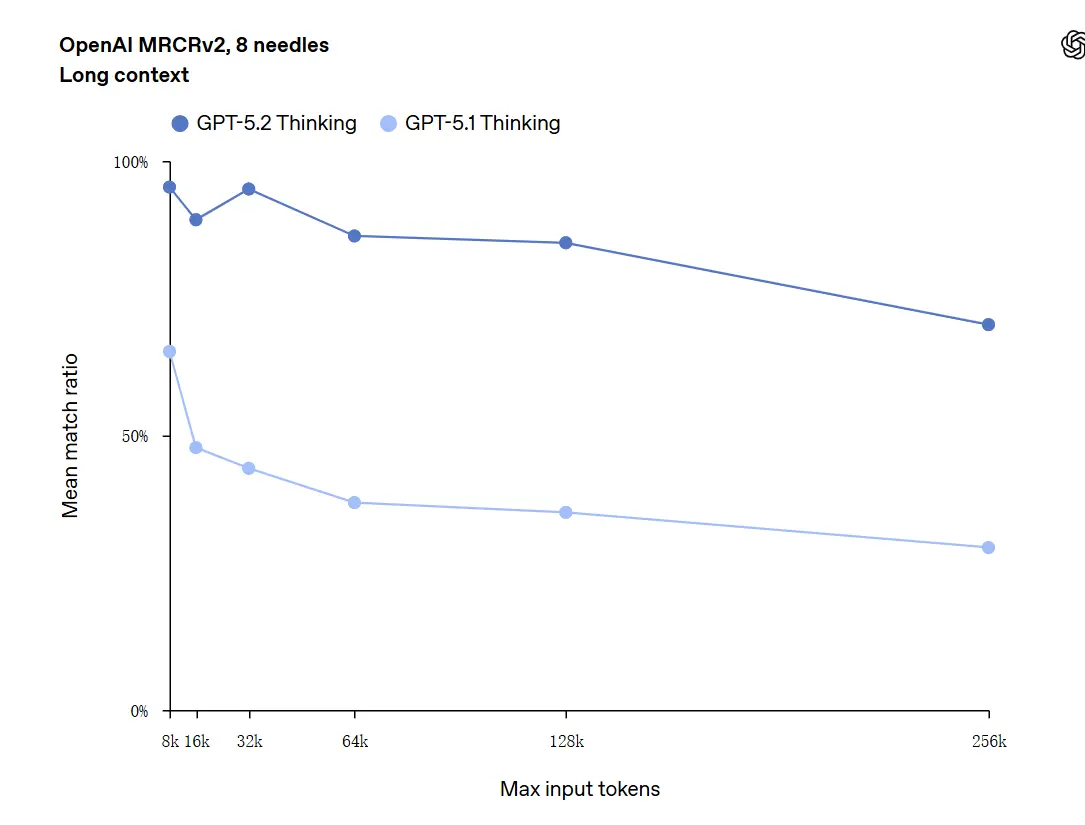

La comprensione di contesti lunghi è uno dei miglioramenti di punta. Il modello sottostante di GPT-5.2 supporta una finestra di contesto da 400k token e — cosa importante — mantiene una precisione più elevata man mano che i contenuti rilevanti si spostano in profondità nel contesto. GDPval, una suite di task per “lavoro di conoscenza ben specificato” in 44 professioni, dove GPT-5.2 Thinking raggiunge la parità o supera i giudici umani esperti su una larga quota di task. Report indipendenti confermano che il modello mantiene e sintetizza informazioni su molti documenti molto meglio dei modelli precedenti. Questo è un passo avanti realmente pratico per compiti come due diligence, sintesi legale, rassegne della letteratura e comprensione di codebase.

GPT-5.2 può gestire contesti fino a 256.000 token (circa 200+ pagine di documenti). Inoltre, nel test di comprensione di testi lunghi "OpenAI MRCRv2", GPT-5.2 Thinking ha raggiunto un tasso di accuratezza vicino al 100%.

Avvertenza sul “100% di accuratezza”: le migliorie sono descritte come “in avvicinamento al 100%” per micro-task ristretti; i dati di OpenAI sono meglio descritti come “allo stato dell’arte e in molti casi al livello o sopra quello degli esperti umani sui task valutati”, non letteralmente impeccabili in tutti gli usi. I benchmark mostrano grandi guadagni ma non una perfezione universale.

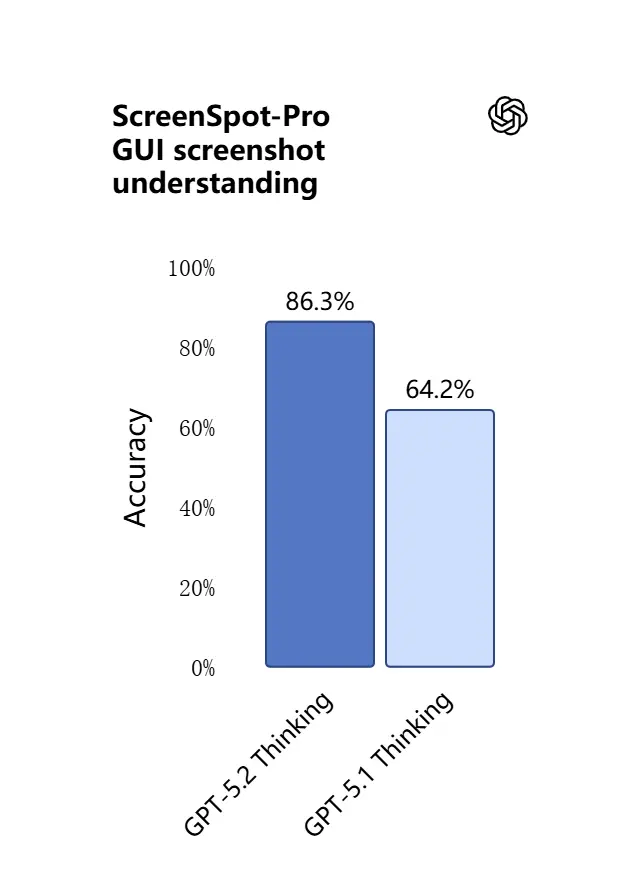

3) Cosa c’è di nuovo nella comprensione visiva e nel ragionamento multimodale?

Le capacità di visione in GPT-5.2 sono più nitide e pratiche. Il modello è migliore nell’interpretare screenshot, leggere grafici e tabelle, riconoscere elementi dell’interfaccia utente e combinare input visivi con un lungo contesto testuale. Non si tratta solo di didascalie: GPT-5.2 può estrarre dati strutturati dalle immagini (ad es. tabelle in un PDF), spiegare grafici e ragionare su diagrammi in modi che supportano azioni su strumenti a valle (ad es. generare un foglio di calcolo da un report fotografato).

.webp)

Effetto pratico: i team possono fornire direttamente al modello intere presentazioni, report di ricerca scansionati o documenti ricchi di immagini e chiedere sintesi trasversali tra i documenti — riducendo notevolmente il lavoro di estrazione manuale.

4) Come sono cambiati l’invocazione degli strumenti e l’esecuzione dei task?

GPT-5.2 spinge oltre il comportamento agentico: è migliore nel pianificare compiti multi-step, decidere quando chiamare strumenti esterni ed eseguire sequenze di chiamate ad API/strumenti per portare a termine un lavoro end-to-end. Miglioramenti di “agentic tool-calling” — il modello proporrà un piano, chiamerà strumenti (database, calcolo, file system, browser, ambienti di esecuzione del codice) e sintetizzerà i risultati in un deliverable finale in modo più affidabile rispetto ai modelli precedenti. L’API introduce routing e controlli di sicurezza (elenchi di strumenti consentiti, impalcature per tool) e l’interfaccia di ChatGPT può instradare automaticamente le richieste verso la variante 5.2 appropriata (Instant vs Thinking).

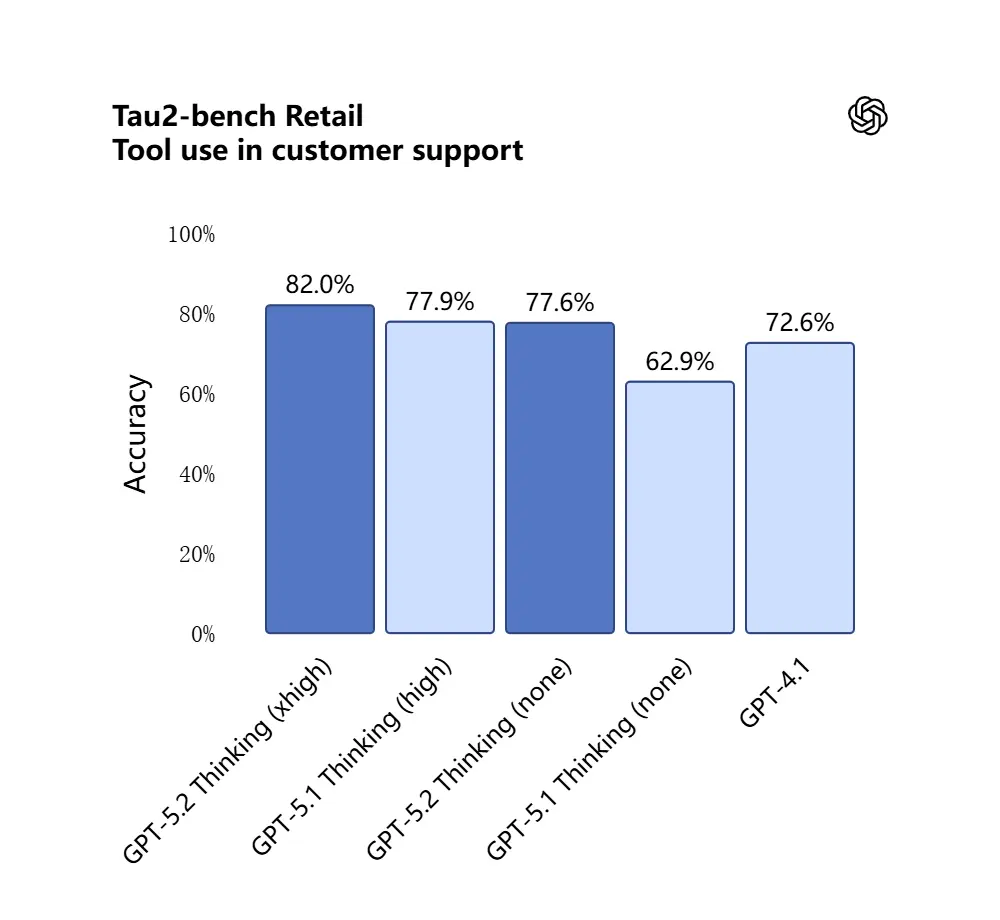

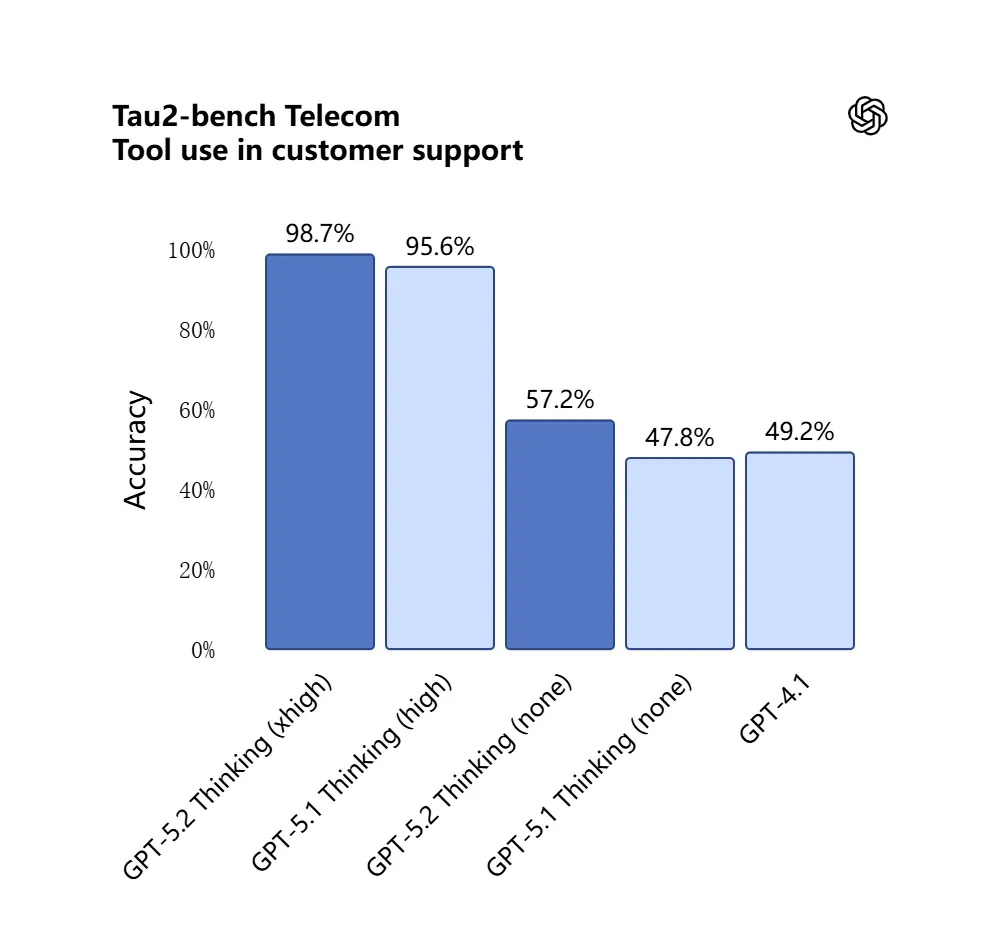

GPT-5.2 ha ottenuto il 98.7% nel benchmark Tau2-Bench Telecom, dimostrando capacità mature di chiamata di strumenti in task multi-turn complessi.

Perché è importante: questo rende GPT-5.2 più utile come assistente autonomo per flussi di lavoro come “acquisisci questi contratti, estrai le clausole, aggiorna un foglio di calcolo e scrivi un’email di sintesi” — attività che prima richiedevano un’orchestrazione attenta.

5) Evoluzione della capacità di programmazione

GPT-5.2 è decisamente migliore nei compiti di ingegneria del software: scrive moduli più completi, genera ed esegue test in modo più affidabile, comprende grafi di dipendenze di progetto complessi ed è meno incline al “lazy coding” (saltare il boilerplate o non collegare i moduli). Su benchmark di coding di livello industriale (SWE-bench Pro, ecc.) GPT-5.2 stabilisce nuovi record. Per i team che usano LLM come pair-programmer, questo miglioramento può ridurre la verifica manuale e il rework necessari dopo la generazione.

Nel test SWE-Bench Pro (compito reale di ingegneria del software industriale), il punteggio di GPT-5.2 Thinking è salito al 55.6%, mentre ha raggiunto un nuovo massimo dell’80% nel test SWE-Bench Verified.

_Software%20engineering.webp)

In applicazioni pratiche, questo significa:

- Debug automatico del codice in ambiente di produzione con maggiore stabilità;

- Supporto per programmazione multilanguage (non limitata a Python);

- Capacità di completare autonomamente task di riparazione end-to-end.

Quali sono le differenze tra GPT-5.2 e GPT-5.1?

Risposta breve: GPT-5.2 è un miglioramento iterativo ma sostanziale. Mantiene l’architettura della famiglia GPT-5 e le fondamenta multimodali, ma fa avanzare quattro dimensioni pratiche:

- Profondità e coerenza del ragionamento. 5.2 introduce livelli più alti di sforzo di ragionamento e un chaining migliore per problemi multi-step; 5.1 aveva già migliorato il ragionamento, ma 5.2 alza l’asticella per matematica complessa e logica multi-stadio.

- Affidabilità su contesti lunghi. Entrambe le versioni hanno esteso il contesto, ma 5.2 è ottimizzata per mantenere l’accuratezza in profondità su input molto lunghi (OpenAI afferma una ritenzione migliorata fino a centinaia di migliaia di token).

- Visione + fedeltà multimodale. 5.2 migliora il riferimento incrociato tra immagini e testo — ad es., leggere un grafico e integrare quei dati in un foglio di calcolo — mostrando una maggiore accuratezza a livello di task.

- Comportamento agentico degli strumenti e funzionalità API. 5.2 espone nuovi parametri di sforzo di ragionamento (

xhigh) e funzionalità di compattazione del contesto nell’API, e OpenAI ha affinato la logica di routing in ChatGPT così che l’interfaccia possa scegliere automaticamente la migliore variante. - Meno errori, maggiore stabilità: GPT-5.2 riduce il suo “tasso di illusione” (tasso di risposte false) del 38%. Risponde a domande di ricerca, scrittura e analisi in modo più affidabile, riducendo i casi di “fatti inventati”. Nei compiti complessi, il suo output strutturato è più chiaro e la logica più stabile. Nel frattempo, la sicurezza delle risposte del modello è notevolmente migliorata nei compiti legati alla salute mentale. Si comporta in modo più robusto in scenari sensibili come salute mentale, autolesionismo, suicidio e dipendenza emotiva.

Nelle valutazioni di sistema, GPT-5.2 Instant ha ottenuto 0.995 (su 1.0) sul task "Mental Health Support", significativamente superiore a GPT-5.1 (0.883).

Quantitativamente, i benchmark pubblicati da OpenAI mostrano guadagni misurabili su GDPval, benchmark matematici (FrontierMath) e valutazioni di ingegneria del software. GPT-5.2 supera GPT-5.1 in task di fogli di calcolo tipici dell’investment banking junior di diversi punti percentuali.

GPT-5.2 è gratuito — quanto costa?

Posso usare GPT-5.2 gratuitamente?

OpenAI ha distribuito GPT-5.2 a partire dai piani ChatGPT a pagamento e dall’accesso API. Storicamente OpenAI ha mantenuto i modelli più veloci/profondi dietro livelli a pagamento, mentre ha reso disponibili varianti più leggere più ampiamente in seguito; con la 5.2 l’azienda ha dichiarato che il rollout sarebbe iniziato sui piani a pagamento (Plus, Pro, Business, Enterprise) e che l’API è disponibile per gli sviluppatori. Questo significa che l’accesso gratuito immediato è limitato: il livello free potrebbe ricevere accesso declassato o instradato (ad esempio a sotto-varianti più leggere) più avanti, man mano che OpenAI scala la distribuzione.

La buona notizia è che CometAPI ora si integra con GPT-5.2, ed è attualmente in offerta di Natale. Ora puoi usare GPT-5.2 tramite CometAPI; il playground consente di interagire liberamente con GPT-5.2 e gli sviluppatori possono usare l’API di GPT-5.2 (CometAPI è prezzata al 20% di OpenAI) per creare workflow.

Quanto costa tramite API (uso per sviluppatori/produzione)?

L’uso dell’API è fatturato per token. I prezzi pubblicati da OpenAI al lancio mostrano (CometAPI è prezzata al 20% di OpenAI):

- GPT-5.2 (chat standard) — $1.75 per 1M token in input e $14 per 1M token in output (si applicano sconti per input in cache).

- GPT-5.2 Pro (flagship) — $21 per 1M token in input e $168 per 1M token in output (significativamente più costoso perché destinato a carichi di lavoro ad alta accuratezza e compute-intensive).

- In confronto, GPT-5.1 era più economico (ad es., $1.25 in / $10 out per 1M token).

Interpretazione: i costi API sono aumentati rispetto alle generazioni precedenti; il prezzo segnala che il ragionamento premium e le prestazioni su contesti lunghi di 5.2 sono prezzati come un livello di prodotto distinto. Per i sistemi in produzione, i costi del piano dipendono fortemente da quanti token inserisci/produttivi e da quanto spesso riusi input in cache (gli input in cache ricevono forti sconti).

Cosa significa in pratica

- Per l’uso occasionale tramite l’interfaccia di ChatGPT, i piani di abbonamento mensili (Plus, Pro, Business, Enterprise) sono il percorso principale. I prezzi dei livelli di abbonamento a ChatGPT non sono cambiati con la release 5.2 (OpenAI mantiene stabili i prezzi dei piani anche se l’offerta di modelli cambia).

- Per l’uso in produzione e per sviluppatori, pianifica i costi per token. Se la tua app effettua lo streaming di molte risposte lunghe o elabora documenti lunghi, il costo dei token di output ($14 / 1M token per Thinking) dominerà i costi a meno che tu non metta in cache con attenzione gli input e non riutilizzi gli output.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

OpenAI ha lanciato GPT-5.2 con tre varianti mirate per adattarsi ai casi d’uso: Instant, Thinking e Pro:

- GPT-5.2 Instant: Veloce, conveniente, ottimizzato per il lavoro quotidiano — FAQ, how-to, traduzioni, bozze rapide. Latenza ridotta; buone prime bozze e workflow semplici.

- GPT-5.2 Thinking: Risposte più profonde e di qualità superiore per lavoro sostenuto — sintesi di documenti lunghi, pianificazione multi-step, revisioni di codice dettagliate. Compromesso tra latenza e qualità; il “mulo da lavoro” predefinito per i compiti professionali.

- GPT-5.2 Pro: La qualità e l’affidabilità più alte. Più lento e costoso; ideale per compiti difficili e ad alto rischio (ingegneria complessa, sintesi legale, decisioni di alto valore) e quando è richiesto uno sforzo di ragionamento

xhigh.

Tabella di confronto

| Caratteristica / Metrica | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Uso previsto | Attività quotidiane, bozze rapide | Analisi profonda, documenti lunghi | Massima qualità, problemi complessi |

| Latenza | La più bassa | Moderata | La più alta |

| Sforzo di ragionamento | Standard | Alto | xHigh disponibile |

| Ideale per | FAQ, tutorial, traduzioni, prompt brevi | Sintesi, pianificazione, fogli di calcolo, coding | Ingegneria complessa, sintesi legale, ricerca |

| Esempi di nome API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Prezzo token input (API) | $1.75 / 1M | $1.75 / 1M | $21 / 1M |

| Prezzo token output (API) | $14 / 1M | $14 / 1M | $168 / 1M |

| Disponibilità (ChatGPT) | Rollout; piani a pagamento poi più ampio | Rollout ai piani a pagamento | Utenti Pro / Enterprise (a pagamento) |

| Esempio di caso d’uso | Stesura email, piccoli snippet di codice | Costruire modello finanziario multi-sheet, Q&A lungo | Audit codebase, generare design di sistema di produzione |

Chi è adatto a usare GPT-5.2?

GPT-5.2 è progettato per un ampio set di utenti target. Di seguito le raccomandazioni per ruolo:

Imprese e team di prodotto

Se costruisci prodotti per il lavoro di conoscenza (assistenti alla ricerca, revisione contrattuale, pipeline analitiche o strumenti per sviluppatori), le capacità su contesti lunghi e agentiche di GPT-5.2 possono ridurre significativamente la complessità di integrazione. Le imprese che necessitano di comprensione robusta dei documenti, reportistica automatizzata o copiloti intelligenti troveranno utili Thinking/Pro. Microsoft e altri partner di piattaforma stanno già integrando la 5.2 negli stack di produttività (ad es., Microsoft 365 Copilot).

Sviluppatori e team di ingegneria

I team che desiderano usare LLM come pair-programmer o automatizzare generazione/testing del codice beneficeranno della maggiore fedeltà di programmazione in 5.2. L’accesso API (con modalità thinking o pro) abilita sintesi più profonde di grandi codebase grazie alla finestra di contesto da 400k token. Aspettati costi maggiori in API usando Pro, ma la riduzione di debug e revisione manuali può giustificare il costo per sistemi complessi.

Ricercatori e analyst data-intensive

Se sintetizzi regolarmente letteratura, analizzi lunghi report tecnici o desideri progettazione di esperimenti assistita dal modello, le migliorie su contesti lunghi e matematica di GPT-5.2 aiutano ad accelerare i workflow. Per ricerche riproducibili, abbina il modello a prompt engineering accurato e passaggi di verifica.

Piccole imprese e power user

ChatGPT Plus (e Pro per i power user) riceverà accesso instradato alle varianti 5.2; ciò rende l’automazione avanzata e output di alta qualità alla portata di team più piccoli senza dover costruire un’integrazione API. Per utenti non tecnici che necessitano di migliori sintesi documentali o creazione di slide, GPT-5.2 offre benefici pratici tangibili.

Note pratiche per sviluppatori e operatori

Funzionalità API da tenere d’occhio

- Livelli di

reasoning.effort(ad es.,medium,high,xhigh) ti consentono di indicare al modello quanta compute spendere per il ragionamento interno; usali per scambiare latenza con accuratezza per richiesta. - Compattazione del contesto: l’API include strumenti per comprimere e compattare la cronologia così che i contenuti realmente rilevanti siano preservati per catene lunghe. Critico quando devi mantenere gestibile l’uso effettivo dei token.

- Impalcature per tool e controlli di strumenti consentiti: nei sistemi di produzione, limita esplicitamente cosa il modello può invocare e registra le chiamate agli strumenti per auditing.

Consigli per il controllo dei costi

- Metti in cache gli embedding dei documenti usati di frequente e usa input in cache (che ricevono sconti significativi) per query ripetute sullo stesso corpus. Il pricing della piattaforma OpenAI include sconti rilevanti per input in cache.

- Instrada le query esplorative/a basso valore su Instant e riserva Thinking/Pro a job batch o passaggi finali.

- Stima con attenzione l’uso di token (input + output) quando proietti i costi API, perché output lunghi moltiplicano il costo.

In sintesi — dovresti passare a GPT-5.2?

Se il tuo lavoro dipende dal ragionamento su documenti lunghi, dalla sintesi tra documenti, dall’interpretazione multimodale (immagini + testo) o dalla costruzione di agenti che chiamano strumenti, GPT-5.2 è un aggiornamento evidente: aumenta l’accuratezza pratica e riduce il lavoro di integrazione manuale. Se esegui principalmente chatbot ad alto volume e bassa latenza o applicazioni con budget stretti, Instant (o modelli precedenti) può essere ancora una scelta ragionevole.

GPT-5.2 rappresenta un passaggio deliberato da “miglior chat” a “miglior assistente professionale”: più compute, più capacità e livelli di costo più alti — ma anche reali guadagni di produttività per i team che possono sfruttare contesti lunghi affidabili, matematica/ragionamento migliorati, comprensione delle immagini ed esecuzione agentica degli strumenti.

Per iniziare, esplora le capacità dei modelli GPT-5.2 (GPT-5.2;GPT-5.2 pro, GPT-5.2 chat) nel Playground e consulta la guida all’API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo di gran lunga inferiore a quello ufficiale per aiutarti a integrare.

Pronti a iniziare?→ Prova gratuita dei modelli gpt-5.2 !