Vidu Q3 è entrato in scena all’inizio del 2026 come uno dei segnali più chiari che la generazione video guidata dall’IA si stia spostando dai clip brevi e di novità verso un vero racconto narrativo multi-shot. Nei mesi successivi al suo ampio rilascio, Vidu Q3 è diventato un elemento imprescindibile nei workflow dei creator, nei piloti di ricerca e nei piloti commerciali — e a ragione: spinge più in là di molti modelli precedenti la durata, l’integrazione audiovisiva e la coerenza multi-shot, offrendo anche un’API orientata agli sviluppatori per l’uso programmatico.

Che cos’è Vidu Q3?

Vidu Q3 è l’ultima iterazione di punta dell’architettura LVM (large video model) di ShengShu Technology. A differenza dei suoi predecessori (Vidu 1.0 e 1.5), che richiedevano workflow separati per la generazione visiva e il doppiaggio audio in post-produzione, Vidu Q3 è un motore generativo “all-in-one”.

La svolta fondamentale di Vidu Q3 è la capacità di generare simultaneamente immagini in alta definizione e audio ad alta fedeltà.[ Comprendendo la fisica del suono e della luce insieme, il modello elimina la “uncanny valley” dell’audio desincronizzato spesso riscontrata nei modelli concorrenti. Supporta fino a 16 secondi di generazione continua in risoluzione nativa 1080p, posizionandosi come uno strumento pronto per la produzione di cortometraggi, spot pubblicitari e narrazioni.

Come funziona Vidu Q3 sotto il cofano?

Sebbene i dettagli dell’architettura di base siano proprietari, Vidu si basa su U-ViT, fusione di modelli di diffusione e transformer — un design noto per bilanciare coerenza, continuità temporale ed espressività nella generazione video.

Questa architettura ibrida consente al modello di ragionare su movimento, suono e contesto narrativo su sequenze estese.

6 caratteristiche distintive di Vidu Q3

1. Generazione a durata estesa — quanto può durare?

Una delle funzionalità di punta di Vidu Q3 è la maggiore durata della generazione singola. Molti modelli delle generazioni precedenti si concentravano su micro-clip; Q3 estende intenzionalmente la lunghezza del clip per consentire archi narrativi semplici e sequenze multi-shot senza costringere i creator a unire molti clip minuscoli. La documentazione della piattaforma e i portali partner pubblicizzano fino a ~16 secondi di generazione nativa in un’unica passata (il formato e le opzioni di qualità possono variare in base al provider e al piano API). Questo è importante perché passare da 4–8 secondi a 16 secondi cambia il modo in cui i creator pianificano le scene, scrivono i beat e scandiscono gli indizi audio.

2. Fedeltà visiva e coerenza temporale

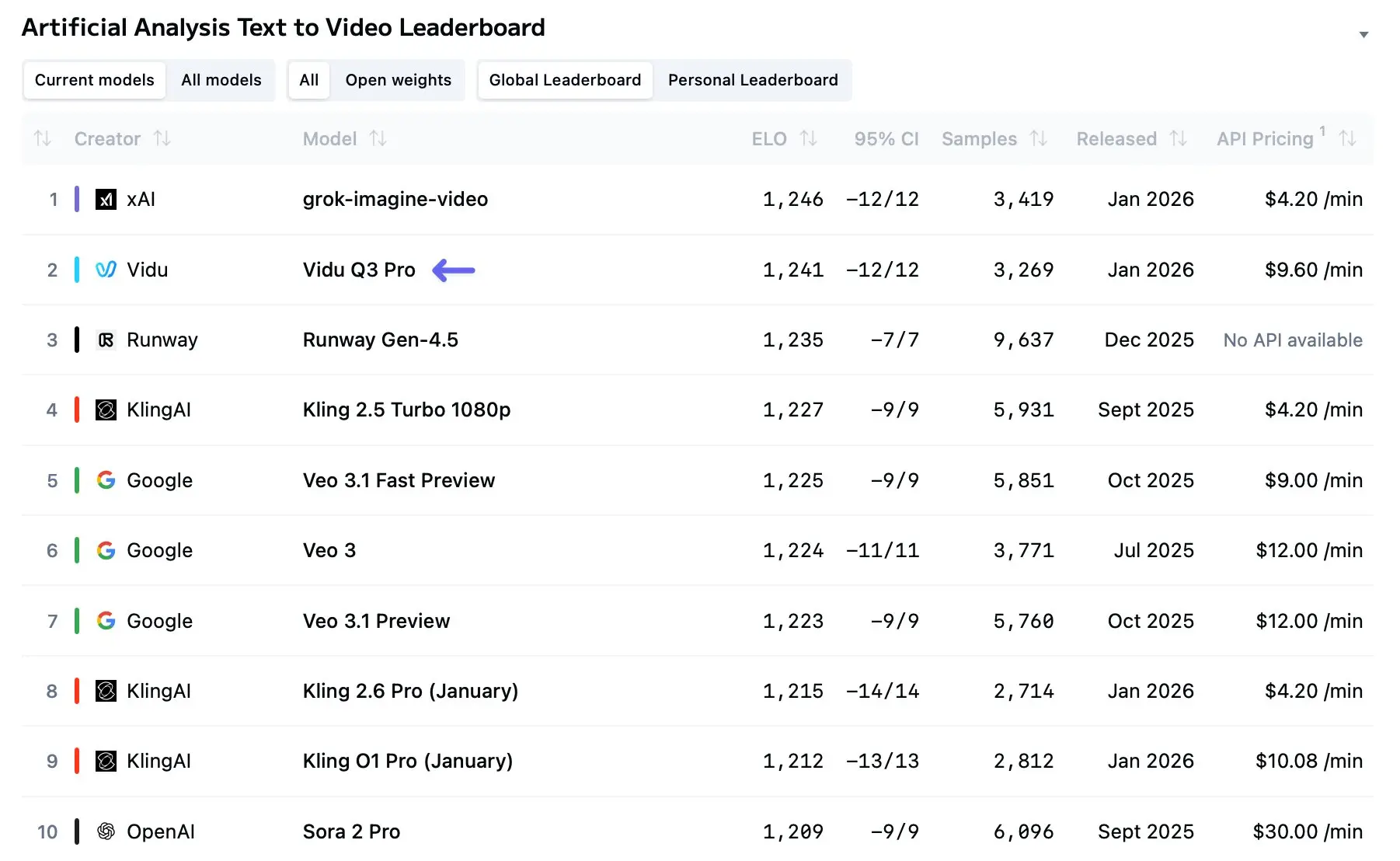

Valutazioni indipendenti e primi benchmark mostrano che Vidu Q3 produce immagini più nitide e meno distorsioni a livello di fotogramma rispetto ai modelli consumer precedenti. Miglioramenti nell’architettura e nell’aumento dei dati sembrano ridurre lo sfarfallio e migliorare la continuità del movimento per clip sotto i 10–16 secondi. Tuttavia, il modello può ancora faticare con scene dense e multi-soggetto (f folle, interazioni fisiche complicate) dove l’occlusione e i movimenti fini richiedono un forte ragionamento fisico. Siti di ranking comparativo e classifiche dei modelli hanno già posizionato Vidu Q3 in alto nelle liste T2V (text-to-video), sebbene le classifiche varino per benchmark e dataset.

3. Generazione nativa di audio + video

A differenza dei sistemi che producono visual silenziosi lasciando l’audio alla post-produzione, Vidu Q3 integra la generazione audio all’interno del modello. Il risultato è dialogo con labiale sincronizzato, SFX a tempo e musica di sottofondo opzionale prodotti insieme ai frame. L’integrazione del suono a livello di modello riduce gli errori di allineamento (drift del lip sync, cue fuori tempo) e accorcia il ciclo di produzione per demo, anteprime e molti corti in formato finale.

4. Controllo intelligente della camera e narrazioni multi-shot

Le funzionalità di “smart camera” di Q3 interpretano i prompt per i movimenti di camera (pan, dolly, tracking) e per sequenze multi-shot. Invece di produrre un singolo punto di vista statico, il modello può generare tagli e transizioni pianificati così che il clip risultante sembri una scena diretta. Per i creator ciò trasforma l’output da “un’immagine composta che si muove” in “una breve scena con più inquadrature”. Questo migliora la fruibilità e abilita uno storytelling visivo più ricco in una singola generazione.

5. Coerenza multi-riferimento e fedeltà dei personaggi

Vidu (come piattaforma) ha investito in sistemi “reference to video” e di coerenza multi-riferimento che permettono ai creator di caricare più immagini di riferimento per bloccare l’identità del personaggio attraverso i frame. Q3 estende queste idee per mantenere l’aspetto dei personaggi e gli oggetti di scena coerenti su più angolazioni di camera e tagli — un requisito di base ma essenziale per un output narrativo coerente. Ciò è particolarmente utile per progetti anime o stilizzati in cui è fondamentale mantenere coerente l’arte dei personaggi.

6. Prontezza per gli sviluppatori: API e workflow

La suite di modelli Vidu — Q3 inclusa — è disponibile tramite interfacce web e una REST API programmatica. Gli sviluppatori possono inviare job di text-to-video o immagine+testo a un endpoint di inferenza, ricevere un ID attività e fare polling per i risultati (tipico pattern di job asincroni). L’API offre parametri come risoluzione, rapporto d’aspetto, durata, ampiezza del movimento e un toggle per la generazione audio. Questo rende Q3 accessibile per automazione, workflow batch e integrazione con pipeline editoriali.

Come si confronta Vidu Q3 con Sora 2 e Veo 3.1?

Risposta breve: Vidu Q3 compete fortemente sugli output narrativi più lunghi e sull’audio/video integrato per scene da 10–20 s, Sora 2 eccelle nel realismo single-shot fisicamente plausibile e nell’integrazione sociale, e Veo 3.1 guida su finitura a livello di pixel, strumenti di continuità multi-frame e integrazione API enterprise. Di seguito approfondiamo le differenze su assi pratici.

Quale modello è più forte per realismo e fisica: Sora 2 o Vidu Q3?

Sora 2 (OpenAI) è stato esplicitamente addestrato per la plausibilità fisica e la simulazione del mondo — le sue note pubbliche evidenziano comportamento fisico avanzato, interazioni oggettuali accurate e traiettorie di movimento altamente realistiche. Sora 2 offre anche audio sincronizzato e integrazioni con app social (inclusi cameo e un’app mobile), rendendolo eccezionalmente forte per scene verosimili e fisicamente coerenti. Se il tuo brief richiede collisioni accurate, dinamiche realistiche o movimento umano fotorealistico in riprese brevi e autoconcluse, Sora 2 è spesso superiore.

Vidu Q3, per contro, è posizionato più come un motore di storytelling: clip più lunghi, sequenziamento multi-shot e controllo della camera in stile regia. Ciò non significa che Vidu sacrifichi il realismo, ma i suoi guadagni principali sono la continuità narrativa e l’output audiovisivo combinato piuttosto che la pura simulazione fisica. Per lo storytelling cinematografico breve (ad es., una demo di prodotto di 16 s con tagli e VO), il workflow di Q3 è spesso più rapido e semplice.

Quale modello è migliore per finitura cinematografica e alta fedeltà: Veo 3.1 vs Vidu Q3?

Veo 3.1 (Google / DeepMind / Gemini) è stato promosso come opzione ad alta fedeltà, di livello enterprise, con forti controlli di continuità, generazione audio nativa e supporto all’interno degli stack cloud/Vertex/Gemini di Google. Veo 3.1 ha introdotto funzionalità avanzate “ingredients to video”, supporto nativo verticale (9:16) e upscaling a risoluzioni elevate (incluse capacità 4K in alcuni flussi). Per progetti che richiedono la massima qualità di pixel, armonia cromatica precisa e API enterprise rigorose, Veo 3.1 è spesso la scelta giusta.

Vidu Q3 regge il confronto concentrandosi su durata estesa + coerenza della storia multi-shot e su una productizzazione incentrata sul creator (playground web rapidi, orchestrazione multi-riferimento). Se la tua priorità è produrre una breve scena diretta umanamente con più movimenti di camera e cue audio integrati (e valorizzi la lunghezza più della finitura del pixel puro), Vidu Q3 è convincente. Per la pura fedeltà fotorealistica, Veo 3.1 in genere ha il vantaggio.

All’inizio del 2026, il triumvirato del video AI è composto da Sora 2 di OpenAI, Veo 3.1 di Google e Vidu Q3. Ecco come si confrontano direttamente:

| Caratteristica | Vidu Q3 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Durata massima singolo clip | ~16 s | Fino a ~25 s (Pro) | 8 s (con funzionalità di stitching narrativo) |

| Generazione audio nativa | Sì (integrata) | Sì (sperimentale) | Sì (avanzata) |

| Controllo cinematografico della camera | Sì (consapevole delle inquadrature) | Preset limitati | Sì (coerenza multi-shot) |

| Narrazione multi-shot | Sì | Sì | Sì |

| Rendering di testo nei frame | Sì | Variabile | Variabile |

| Risoluzione | 1080p | 1080p | 1080p / 4K in casi speciali |

| Caso d’uso principale | Storytelling narrativo, Animazione | Concept/film ad alto budget | YouTube Shorts / TikTok |

Analisi:

- Vs. Sora 2: Sora 2 resta il peso massimo per pura fedeltà visiva e immaginazione surrealista (“qualità da Hollywood”). Tuttavia, Vidu Q3 lo supera in efficienza del workflow grazie al limite di 16 secondi e a una migliore integrazione audio. Per i creator che necessitano di un clip “fatto e finito” in un colpo solo, Q3 è più veloce.

- Vs. Veo 3.1: Veo 3.1 di Google eccelle in velocità per clip più brevi, orientati ai social (4–8 s) e si integra profondamente con YouTube. Vidu Q3 mira più in alto nella catena del valore, puntando ad animatori professionisti e filmmaker che hanno bisogno di tagli più lunghi e continui che Veo fatica a mantenere con coerenza.

Quali applicazioni pratiche abilita Vidu Q3?

Pubblicità e marketing short-form

I brand possono prototipare concept pubblicitari end-to-end molto più rapidamente: scrivere uno script, generare un visual di 16 secondi con VO e SFX sincronizzati, iterare su testi e composizione delle inquadrature e produrre doppiaggi in più lingue tramite prompt in lingua. Per l’A/B testing dei creativi social, la riduzione dei tempi è un chiaro vantaggio di business. Case study pubblicati dalle piattaforme mostrano marketer che usano Vidu Q3 per micro-ads e teaser di prodotto.

Storyboard e previsualizzazione per cinema e TV

Registi e montatori utilizzano brevi clip IA come previsualizzazioni (previz) per impostare le scene, testare movimenti di camera e proporre trattamenti. Le funzionalità di sequenziamento multi-shot e smart camera di Vidu Q3 sono particolarmente utili: i team creativi possono iterare su blocking e dialoghi senza i costi dei sopralluoghi. Sebbene la previz IA non sostituisca la direzione sul set, accorcia i cicli decisionali delle fasi iniziali.

E-learning e video esplicativi

I dipartimenti educativi e di formazione aziendale possono generare segmenti esplicativi animati concisi con narrazione sincronizzata e SFX annotati. Per contenuti standardizzati (formazione prodotto, onboarding), ciò riduce la dipendenza da costose case di produzione e accelera le versioni localizzate. La velocità di pubblicazione e le capacità audio native rendono Vidu Q3 attraente per questi casi d’uso.

Gaming, concept art e produzione indie

Sviluppatori indie e team di gioco utilizzano brevi clip cinematografici IA per trailer, mockup di dialoghi NPC o esplorazione di stile. Il supporto di Vidu Q3 per immagini di riferimento e coerenza dei personaggi aiuta a mantenere l’identità visiva dell’IP di gioco coerente nei trailer di prototipo. Il modello è usato anche per materiali di pitch per ottenere finanziamenti o l’interesse di publisher.

Accessibilità e localizzazione rapida

Poiché l’audio è generato nativamente, Vidu Q3 semplifica le versioni multilingue: genera la stessa ripresa con prompt in lingue diverse o richiedi timbri vocali variati. Questo abilita una localizzazione rapida di contenuti di marketing o materiali formativi mantenendo approssimazioni del lip-sync sufficientemente buone per molti contesti short-form (sebbene un lip‑match di livello broadcast possa ancora richiedere un intervento umano).

Vidu Q3 è il miglior modello video IA del 2026?

Dichiarare un singolo modello “migliore” manca di sfumature: il vincitore dipende dal caso d’uso.

- Per output fotorealistici, fisicamente fondati e una gestione della sicurezza conservativa, Sora 2 di OpenAI è spesso considerato la scelta migliore. Enfatizza realismo e moderazione robusta, rendendolo attraente per produzioni di alto livello e aziende avverse al rischio.

- Per contenuti short-form ottimizzati per la piattaforma e integrati nell’ecosistema, il supporto nativo verticale di Veo 3.1 e le integrazioni delle app di Google (YouTube Shorts, Google Photos) lo rendono univocamente comodo.

- Per prototipazione audio-video rapida, controllo narrativo multi-shot e un forte equilibrio di funzionalità di storytelling, Vidu Q3 spicca — soprattutto quando la velocità di iterazione e l’audio integrato contano più del fotorealismo assoluto. I primi benchmark e i report dei vendor collocano Vidu Q3 in alto nelle classifiche T2V, e le sue funzionalità lo rendono una scelta pratica per marketer, creator indipendenti e studi che prototipano nuove idee.

Limitazioni e considerazioni

Sebbene Vidu Q3 rappresenti una svolta, ci sono compromessi:

- La durata dei clip è comunque limitata (~16 s), quindi narrazioni più lunghe richiedono stitching o prompt multipli.

- Il costo delle risorse può crescere con la generazione in HD e audio complesso.

- Gli strumenti IA richiedono comunque giudizio editoriale per rifinire e montare gli output in prodotti finiti.

Dunque: Vidu Q3 è un contendente di prim’ordine nel 2026, in particolare per i creator che danno priorità a workflow audio nativi e storytelling multi-shot. Se sia il migliore dipende dal brief di produzione, dai vincoli normativi e dalla pipeline di distribuzione dell’utente.

Conclusione

Vidu Q3 si distingue nel 2026 come un modello video IA leader in grado di produrre clip audio-video integrati pronti per la narrazione che colmano il divario tra creatività ed esigenze di produzione. Rispetto alla forte coesione narrativa di Sora 2 e al realismo cinematografico di Veo 3.1, Vidu Q3 offre un toolkit equilibrato ideale per storyteller, content creator e workflow commerciali.

Come mostrano i benchmark, le sue alte prestazioni e le funzionalità integrate fanno di Vidu Q3 un punto di svolta nel video generativo — rendendo la produzione audiovisiva complessa più accessibile ed efficiente.

Gli sviluppatori possono accedere a Vidu Q3, Veo 3.1 e Sora 2 tramite CometAPI, i modelli più recenti elencati sono aggiornati alla data di pubblicazione dell’articolo. Per iniziare, esplora le capacità del modello nel Playground e consulta la guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo molto inferiore a quello ufficiale per aiutarti a integrare.

Pronto a partire?→ Iscriviti alla generazione video oggi !

Se vuoi scoprire altri suggerimenti, guide e notizie sull’IA seguici su VK, X e Discord!