OpenAIのGPT-5は2025年5月初旬にリリースされ、すぐに複数の配信チャネルを通じて利用可能になりました。ベンダーのSDKを切り替えることなくGPT-5を試すための最も迅速な方法の一つは、CometAPIです。これは、GPT-XNUMXを他の数百のモデルとともに公開するマルチモデルゲートウェイです。この記事では、実践的なドキュメントでGPT-XNUMXの仕組みを説明します。 何 CometAPIは、 の GPT-5 を呼び出す方法、評価する必要があるトレードオフ、重要なワークフローを GPT-5 に移行する前に実施する実用的なガバナンスとコスト管理について説明します。

GPT-5 とは何ですか? 以前のモデルと何が違うのですか?

GPT-5は、OpenAIが2025年5月初旬にリリースする次期主力大規模言語モデルファミリーです。高速な非推論コンポーネント、より深い「推論」バリアント(しばしば「GPT-XNUMX思考」と呼ばれます)、そして複雑さと必要なツールに基づいてどのサブモデルを使用するかを決定するルーターを組み合わせた、統合されたマルチモーダル推論システムとして提示されています。OpenAIが主張する最終的な効果は、推論の向上、コンテキストウィンドウの拡大、コーディングとエージェントタスクのサポートの向上です。

アーキテクチャと主要機能

- マルチコンポーネントシステム: GPT-5 は、必要に応じてリクエストをさまざまな内部サブモデル (高速推論と深い推論) にルーティングするシステムとして説明されています。開発者は、API 経由で推論モデルをリクエストして、パフォーマンスを最大限に高めることができます。

- 大きなコンテキスト: モデル ファミリは非常に大きなコンテキスト (数十万のトークン) をサポートし、長いドキュメント、コードベース、または複数ファイルの会話を 1 パスで処理できます。

- 多様なサイズの家族: OpenAIはGPT-5を複数のサイズ(標準サイズ)でリリースした。

gpt-5,gpt-5-mini,gpt-5-nano) により、チームはレイテンシー、コスト、推論能力のバランスを取ることができます。

CometAPI とは何ですか? 実際に GPT-5 を提供していますか?

簡単な定義

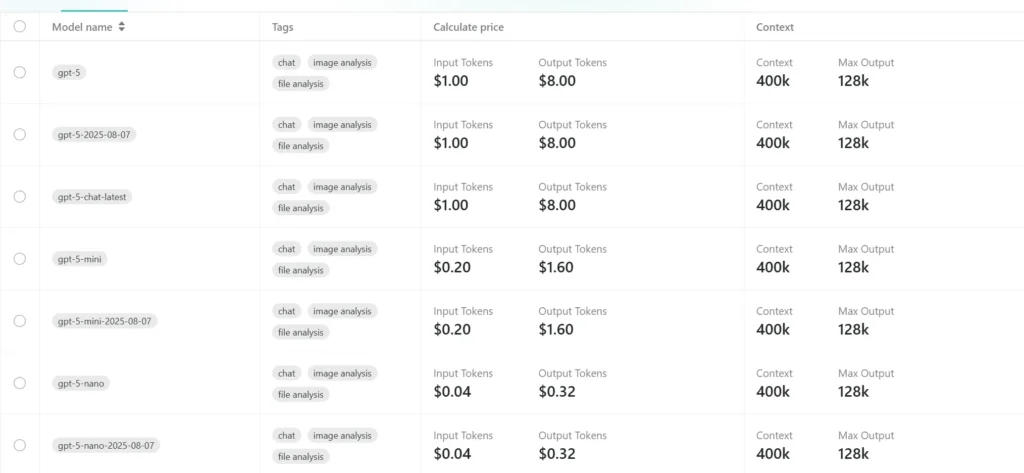

コメットAPI CometAPIは、OpenAI互換のRESTインターフェースを通じて、数百ものAIモデル(OpenAIのGPTファミリー、Anthropic Claude、xAI Grok、画像モデルなど)への統合アクセスを提供するAPI集約プラットフォームです。つまり、開発者はネットワークコードを書き換えるのではなく、モデル名の文字列を変更するだけでモデルプロバイダーを切り替えることができます。CometAPIの製品ページには、 GPT-5 および関連する変種(例: gpt-5, gpt-5-chat-latest, gpt-5-mini) を利用可能なエンドポイントとして設定します。

チームがCometAPIのようなゲートウェイを使用する理由

CometAPI のようなゲートウェイ サービスは、次のことができるため魅力的です。

- モデルを交換する 大量の統合コードを変更することなく、迅速に実行できます。

- 価格を比較する 特定のリクエストをより安価または高速なモデルバリアントにルーティングします。

- 課金とログの集計 複数のモデルとベンダーにわたって。

CometAPI のドキュメントでは、シンプルな移行パスと OpenAI スタイルのクライアントが提供されています (そのため、既存の OpenAI または「openai 互換」コードでは、多くの場合、わずかな変更のみが必要になります)。

CometAPI はどのようにして GPT-5 をプログラムで公開するのでしょうか?

CometAPIは OpenAI互換のREST API 表面: ベースURL、 Authorization: Bearer <YOUR_KEY>、OpenAIのチャット/補完エンドポイントに似たリクエストボディ。 GPT-5 プラットフォームはモデル名を次のように文書化する。 gpt-5, gpt-5-mini, gpt-5-nano 言及されているエンドポイントには以下が含まれます POST https://api.cometapi.com/v1/chat/completions チャット形式の通話と /v1/responses チャット以外のいくつかのバリエーションについて。設定例の詳細(ベースURL、ヘッダーフォーマット、モデルパラメータ)は、 CometAPIドキュメント および クイックスタートガイド.

一般的なエンドポイントと認証パターン

- ベースURL:

https://api.cometapi.com/v1(または文書化された/v1/chat/completionsチャットと/v1/responses(一部の非チャットバリアントの場合)。 - 認証ヘッダー:

Authorization: Bearer sk-xxxxxxxxxxxx(CometAPIの問題sk-ダッシュボードのスタイル トークン)。 - コンテンツタイプ:

application/json. - モデルパラメータ: セッションに

model〜へgpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-miniまたはその他については、 モデルページ.

CometAPI を使い始めて GPT-5 をリクエストするにはどうすればよいですか? (ステップバイステップ)

以下は、今日から実行できる簡潔で信頼性の高いオンボーディング フローです。

ステップ1: サインアップしてCometAPIキーを取得する

- に行く コムタピ そしてアカウントを作成します。

- ダッシュボードから APIトークン or 個人センター → トークンを追加CometAPIはトークンを発行します

sk-...形式。これを安全に保管してください(公開リポジトリにキーを埋め込まないでください)。

ステップ2: モデル文字列を選択する

- ニーズに合ったモデル名を選択してください(例:

gpt-5,gpt-5-nano-2025-08-07)。CometAPI では、モデルごとに複数のエイリアスが公開されることが多いため、精度とコストのトレードオフを選択できます。

ステップ3: 最初のリクエストを実行する (curl)

最小限 curl OpenAI 互換パターンに従った例:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

これは OpenAI のチャット API 構造を反映していますが、CometAPI のベース URL を指し、Comet トークンを使用します。

ステップ4: Pythonの例(リクエスト)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

交換する model gpt-5-nano または、より小型で安価なバリアントの正確なエイリアス CometAPI ドキュメント。

CometAPIの価格

実稼働環境での使用における実用的なベストプラクティスと緩和策は何ですか?

以下は、CometAPI のような仲介者を使用する際にリスクを軽減し、信頼性を向上させる具体的なパターンです。

小規模なパイロットから始めて、並行してテストを実行します

OpenAI(直接アクセスできる場合)とCometAPIに同一のリクエストを実行し、出力、レイテンシ、コストを比較します。これにより、暗黙的な変換、コンテンツフィルター、モデルエイリアスの不一致が明らかになります。

可観測性と品質保証のための機器

プロンプト、返されたトークン(個人情報(PII)は難読化済み)、レイテンシ、エラーコードをログに記録します。プロンプトドリフトと幻覚率の自動テストを実装します。モデルエイリアスの使用状況を追跡し、移行を監査可能にします。

鍵を安全に保管し、定期的に交換する

CometAPI トークンを他の API シークレットと同様に扱います。シークレット マネージャーに保存し、定期的にローテーションし、トークンのスコープを環境 (dev/stage/prod) に限定します。

階層化された安全性を実装する

以下を組み合わせて使用します。

- 迅速なエンジニアリング 幻覚を軽減する(明示的な制約、構造化された出力)。

- 後処理チェック (事実検証、ブロック リスト、PII の正規表現チェック)。

- ループの人間 高リスクの出力の場合。

これらは、重要なコンテンツや法的なコンテンツを処理する GPT-5 展開の標準です。

よくある落とし穴は何ですか? また、アクセスの問題をどのようにトラブルシューティングしますか?

落とし穴:「モデルが存在しない / アクセスできない」。一部の開発者から、直接プロバイダーAPIを使用する場合、プロバイダー検証または組織検証手順によってモデルアクセスが制限される可能性があるという報告があります。アグリゲータがプロバイダーモデルをプロキシする場合にも同様の制限が発生する可能性があります。「モデルが存在しない」または権限エラーが表示された場合は、次の点を確認してください。(a) CometAPIキーが有効で期限切れではないか、(b) 要求されたモデル名がCometAPIのサポート対象リストと完全に一致しているか、(c) 基盤となるプロバイダーによって追加の検証または課金手順が必要かどうか。または、検証関連のアクセスエラーやタイムアウト/権限の異常が発生した場合は、解決のために担当者(メールアドレス: support@cometapi.com)に詳細を提供してください。

落とし穴: 予期しない遅延またはコスト。 高度な推論モードと大規模なコンテキストは、レイテンシとトークン消費を引き起こします。 max_tokens削減 temperature 適切な場合には、 mini 高スループットのワークロード向けのバリアント。ログとアラートで監視します。

最後に

CometAPIは、モデルへのアクセスを一元化しながら、チームがGPT-5のバリアントを迅速に実験できる手段を提供します。しかし、本番環境での使用には、強力なモデルに適用するのと同じ規律、つまり安全なキー、慎重なプロンプトエンジニアリング、幻覚の監視、機密性の高いワークロードに対するポリシー/法的レビューが求められます。まずは小規模なパイロットから始め、CometAPIのダッシュボードを使用してトークンの消費量とレイテンシを測定し、ドメインにおける精度と安全性を検証した上で、より高度な推論を行うバリアントへとエスカレーションしてください。

開発者はアクセスできる GPT-5 、GPT-5 NanoおよびGPT-5 MiniをCometAPI経由で(CometAPIは /v1/responses)に掲載されている最新モデルのバージョンは、記事の公開日時点のものです。まずは、モデルの機能について プレイグラウンド 詳細な手順についてはAPIガイドをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

も参照してください GPT-5の新しいパラメータとツールの使い方

よくあるご質問

1. どの GPT-5 モデルバリアントを選択する必要がありますか?また、トークン/価格はどうですか?

CometAPIは複数のGPT-5バリアントをリストします(デフォルト gpt-5チャットのスナップショット gpt-5-chat-latest、およびより小型のバージョンとして、 gpt-5-mini/gpt-5-nano)。ニーズに応じて選択してください。

gpt-5/gpt-5-chat-latest— 汎用チャットに完全な機能を備え、品質と推論に最適です。gpt-5-mini/gpt-5-nano— 大量のタスクや重要度の低いタスクのコストとレイテンシを削減します。

2. 大規模なコンテキストと高品質の推論を求める呼び出しをどのように設計すればよいでしょうか?

長いコンテキスト:GPT-5は非常に大きなコンテキストウィンドウをサポートします。大きなドキュメントを送信する場合は、入力を意図的にチャンク化し、検索拡張(ベクトルDB + コンテキストウィンドウ)を使用し、出力のmax_tokensを制限してコストを制御します。

3. どのようなセキュリティ、プライバシー、コンプライアンス対策を適用する必要がありますか?

API キーの衛生管理。 キーは環境変数に保存し、定期的にローテーションし、可能な場合はスコープを設定します。キーをリポジトリにコミットしないでください。(このベストプラクティスは、開発者ガイド全体で共通しています。)

データの保存場所とプライバシー。 機密性の高い個人情報、健康情報、または規制対象データをサードパーティのアグリゲーターに送信する前に、CometAPIのプライバシーポリシーと利用規約(およびOpenAIのポリシー)をお読みください。企業によっては、ベンダーとの直接契約またはプライベートインスタンスが必要となる場合があります。

レート制限とクォータ保護。 コストの暴走や連鎖的な障害を防ぐため、本番環境でサーキットブレーカー、指数バックオフ、クォータチェックを実装してください。CometAPIダッシュボードでは使用状況とクォータが公開されており、プログラムによる制限の適用に利用できます。