アリババのQwenチームがリリース Qwen3-Max-プレビュー(指導) — 同社史上最大のモデルで、 1兆以上のパラメータ Qwen Chat、Alibaba Cloud Model Studio(API)、そしてCometAPIなどのサードパーティマーケットプレイスを通じて、すぐに利用可能になりました。プレビュー版は、推論、コーディング、そして長文ドキュメントを扱うワークフローを対象としており、極めて大規模なスケールと非常に大きなコンテキストウィンドウ、そしてコンテキストキャッシュを組み合わせることで、長時間セッションでもレイテンシを低く抑えます。

主な技術的ハイライト

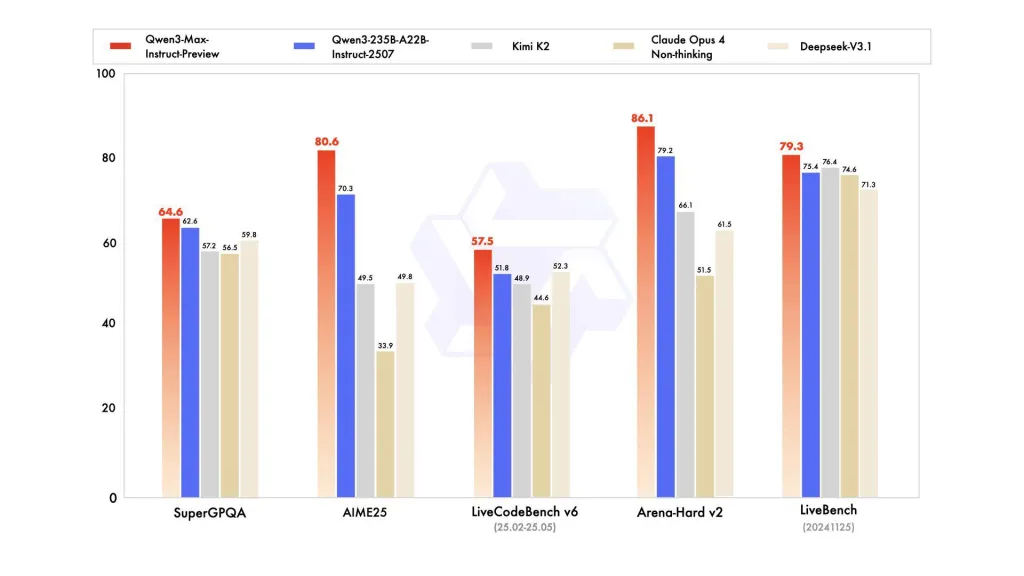

- 膨大なパラメータ数(兆以上): 1兆以上のパラメータを持つモデルへの移行は、複雑なパターン学習(多段階推論、コード合成、文書の深層理解)の能力向上を目的としています。Qwenが発表した初期ベンチマークでは、Qwenの以前のトップモデルと比較して、推論、コーディング、ベンチマークスイートの性能が向上していることが示されています。

- 超長いコンテキストとキャッシュ: 当学校区の 262kトークン ウィンドウを使用すると、チームは長いレポート全体、複数ファイルのコードベース、または長いチャット履歴を1回のパスで入力できます。コンテキストキャッシュのサポートにより、繰り返し発生するコンテキストの繰り返し計算が削減され、長時間セッションのレイテンシとコストを削減できます。

- 多言語 + コーディング能力: Qwen3 ファミリは、バイリンガル (中国語/英語) および幅広い多言語サポート、さらに強力なコーディングと構造化された出力処理に重点を置いており、コード アシスタント、自動レポート生成、大規模なテキスト分析に役立ちます。

- スピードと品質を重視して設計されています。 プレビュー版のユーザーは、Qwen3の以前のバージョンと比較して、「驚異的な」応答速度と、命令追従および推論性能の向上を実感しています。アリババは、このモデルを本番環境、エージェント、開発者向けのシナリオに対応する高スループットのフラッグシップモデルと位置付けています。

可用性とアクセス

アリババクラウドの料金 階層型、トークンベース Qwen3-Max-Previewの料金(入力と出力のレートは別々です)。課金はXNUMX万トークン単位で、無料クォータを差し引いた実際の消費トークンに適用されます。

アリババが公開しているプレビュー価格(米ドル)はリクエストに応じて段階的に設定されています トークン量(同じティアによってどの単位レートが適用されるかが決まります):

- 0~32Kの入力トークン: $0.861 / 1万入力トークン および 3.441ドル / 1万出力トークン.

- 32K~128Kの入力トークン: $1.434 / 1万入力トークン および 5.735ドル / 1万出力トークン.

- 128K~252Kの入力トークン: $2.151 / 1万入力トークン および 8.602ドル / 1万出力トークン.

CometAPIは、ユーザーがAPIを呼び出すのを助けるために公式の20%割引を提供しています。詳細については、 Qwen3-Max-プレビュー:

| 入力トークン | $0.24 |

| 出力トークン | $2.42 |

Qwen3-MaxはQwen3ファミリーの拡張版です(以前のビルドでは、Mixture-of-Expertsバリアントや複数のアクティブパラメータ層などのハイブリッド設計を採用していました)。アリババの以前のQwen3リリースは、「思考」(ステップバイステップの推論)モードと「指示」モードの両方に重点を置いていました。Qwen3-Maxは、このラインにおける新たな最上位の指示バリアントとして位置付けられ、同社のこれまでの最高性能製品であるQwen3-235B-A22B-2507を凌駕し、1Tパラメータモデルが様々なテストでリードしていることを示しています。

SuperGPQA、AIME25、LiveCodeBench v6、Arena-Hard v2、および LiveBench (20241125) では、Qwen3-Max-Preview は、Claude Opus 4、Kimi K2、および Deepseek-V3.1 よりも常に上位にランクされています。

Qwen3-Max へのアクセス方法と使用方法(実用ガイド)

1) ブラウザで試してみる (Qwen Chat)

ロケーション選択 Qwen チャット (公式Qwenウェブ/チャットインターフェース)を選択し、 Qwen3-Max-プレビュー モデルピッカーに表示されている場合は、(指示)モデルを使用します。これは、会話や指示のタスクを視覚的に評価する最も速い方法です。

2) アクセス方法 アリババクラウド (モデルスタジオ / クラウドAPI)

- Alibaba Cloudにサインイン→ モデルスタジオ / モデルサービング推論インスタンスを作成するか、ホストされたモデルエンドポイントを選択します。 qwen3-max-プレビュー (またはラベルの付いたプレビュー バージョン)。

- Alibaba Cloud アクセスキー/RAM ロールを使用して認証し、プロンプトと生成パラメータ (温度、最大トークンなど) を含む POST リクエストで推論エンドポイントを呼び出します。

3) 使用方法 サードパーティのホスト/アグリゲーター

報道によると、プレビュー版はCometAPIやその他のAPIアグリゲータを介してアクセス可能で、開発者は単一のAPIキーで複数のホストモデルを呼び出すことができます。これにより、プロバイダー間のテストが簡素化されるだけでなく、各ホストのレイテンシ、リージョンの可用性、データ処理ポリシーを検証できます。

スタートガイド

CometAPIは、OpenAIのGPTシリーズ、GoogleのGemini、AnthropicのClaude、Midjourney、Sunoなど、主要プロバイダーの500以上のAIモデルを、開発者にとって使いやすい単一のインターフェースに統合する統合APIプラットフォームです。一貫した認証、リクエストフォーマット、レスポンス処理を提供することで、CometAPIはAI機能をアプリケーションに統合することを劇的に簡素化します。チャットボット、画像ジェネレーター、音楽作曲ツール、データドリブン分析パイプラインなど、どのようなアプリケーションを構築する場合でも、CometAPIを利用することで、反復処理を高速化し、コストを抑え、ベンダーに依存しない環境を実現できます。同時に、AIエコシステム全体の最新のブレークスルーを活用できます。

結論

Qwen3-Max-Previewは、Alibabaを顧客に兆単位のスケールモデルを提供する組織の中で確固たる地位に押し上げます。極めて長いコンテキスト長とOpenAI互換APIの組み合わせは、長文推論、コード自動化、エージェントオーケストレーションを必要とする企業にとって、統合の障壁を低くします。導入にあたっては、コストとプレビューの安定性が主な検討事項です。組織は、レイテンシと価格の両方を管理するために、キャッシュ、ストリーミング、バッチ呼び出しをパイロット運用することを検討するでしょう。