DeepSeek は V4 をオープンソースのモデルファミリーとして正式にプレビュー発表し、その見出しは単なる「またひとつのモデル更新」ではありません。同社は V4 を、実運用のワークロード(ドキュメント主体の分析、コーディングアシスタント、検索エージェント、多段の自動化)向けに構築された、長いコンテキストに強くエージェントフレンドリーなシステムとして位置付けています。リリースは Web・アプリ・API で提供が開始され、V4 ラインは公式サービス全体でコスト効率の高い1M-token コンテキストウィンドウを導入しています。

今回の発表がとりわけ注目に値するのは、スケールと効率の両立です。DeepSeek は、V4-Pro が総パラメータ 1.6T・アクティブ 49B、V4-Flash が総パラメータ 284B・アクティブ 13Bだとしています。技術レポートでは、V4 のアーキテクチャがハイブリッドアテンション、MoE ルーティング、そして超長コンテキストでの計算負荷を抑えつつエージェント的挙動を改善するために設計されたポストトレーニングを用いていると述べています。

What is DeepSeek V4?

DeepSeek-V4 は同社の最新プレビュー版フラッグシップファミリーで、公開バリアントとして V4-Pro と V4-Flash の 2 つが含まれます。DeepSeek は、V4-Pro を世界知識、数学、STEM、コーディング、エージェント的コーディングでより強力と説明し、V4-Flash は応答性が高くコスト効率に優れ、推論品質と長コンテキスト能力の多くを維持するとしています。V4-Pro はエージェント的コーディングと世界知識で現行のオープンモデルをリードし、V4-Flash は速度と経済的な展開を重視して設計されています。

V4 は Compressed Sparse Attention (CSA) と Heavily Compressed Attention (HCA) を組み合わせたハイブリッドアテンションアーキテクチャに加え、Manifold-Constrained Hyper-Connections と Muon optimizer を採用しています。同社はさらに、モデルが 32T tokens 超で事前学習され、1M コンテキストにおいて V4-Pro は DeepSeek-V3.2 比で単一トークン推論の FLOPs が27%、KV キャッシュが**10%**で済むと述べています。効率面こそが、このリリースの真の見どころです。

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro は品質を最重視するユーザー向けのフラッグシップモデルです。DeepSeek-V4-Pro は、より強力なエージェント的コーディング性能、より豊かな世界知識、そして世界水準の推論力を提供し、ローンチページによれば世界知識では現行のオープンモデルをリードしつつ Gemini-3.1-Pro にのみわずかに後れを取ります。技術レポートでは、V4-Pro はファミリー内でより大きいモデルであり、DeepSeek-V4-Pro は V4-Flash と同じ OpenAI 互換および Anthropic 互換のインターフェースを通じて利用可能です。

DeepSeek-V4-Flash

V4-Flash は効率最優先のモデルで、推論能力は V4-Pro に肉薄し、パラメータ規模を抑えつつ応答時間を短縮することで、シンプルなエージェントタスクでは V4-Pro と同等の性能を示します。同一の 1M コンテキスト長と中核機能を維持しつつ、思考モードと非思考モードの両方をサポートし、はるかに低コストです。

Which one should you choose?

タスクが高リスク、知識依存、もしくは検証が難しい場合(エンタープライズ研究、複雑なコーディング、多段の意思決定支援、最も強力な回答を求める場面)は V4-Pro を使いましょう。スループット、レイテンシ、あるいはトークンコストを重視し、ベンチマークで最後の数ポイントを追い込む必要がない場合は V4-Flash が適しています。この選択は公式のポジショニングと、両モデル間の報告されたベンチマーク差にも整合しています。

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | 高速推論、高スループットアプリ、コスト重視のエージェント | 最高能力の推論、より難しいコーディングや知識タスク |

| Official API pricing | キャッシュヒット $0.028 / キャッシュミス $0.14 / 出力 $0.28 per 1M tokens | キャッシュヒット $0.145 / キャッシュミス $1.74 / 出力 $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI は Deepseek v4 Pro と V4 Flash へのアクセスを提供し、公式より 20% 安価で、かつ単一の OpenAI 互換または Anthropic Messages エンドポイントで 500+ モデル(GPT-5.4、Gemini 3.1 など)間のシームレスな切り替えを実現します。

Performance benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

ベースモデルの比較表では、V4-Flash と V4-Pro はいずれも中核ベンチマークで DeepSeek-V3.2 を上回り、多くの場合 V4-Pro がリードします。たとえば、レポートでは次のスコアが挙げられています:AGIEval は 82.6 / 83.1(V3.2 は 80.1)、MMLU は 88.7 / 90.1(87.8)、MMLU-Pro は 68.3 / 73.5(65.5)、HumanEval は 69.5 / 76.8(62.8)、LongBench-V2 は 44.7 / 51.5(40.2)。中央が V4-Flash、最後が V4-Pro です。

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

出典: DeepSeek-V4 技術レポート(Table 1)

パターンは明快です:Flash は Pro との差を縮めていますが、Pro は依然としてより強力な汎用モデルです。これにより、多くの本番システムでは V4-Flash が実用的なデフォルトとなり、回答品質がコストやレイテンシより重要な場合には V4-Pro を選ぶのが適切です。

Western model comparisons: where V4 fits

ある中国語のホワイトカラータスクに関する人手評価では、レポートによれば DeepSeek-V4-Pro-Max が Claude Opus 4.6-Max を上回り、63% の非敗率を示しました。DeepSeek-V4-Pro は Claude Sonnet 4.5 に対して「大幅に優位」で、R&D コーディングベンチマークでは Claude Opus 4.5 に肉薄するとしています。

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% non-loss rate | vs Claude Opus 4.6-Max | 実務的なビジネスタスクでの強いパフォーマンス |

| R&D coding benchmark | V4-Pro-Max pass rate 67 | vs Claude Sonnet 4.5 at 47; Opus 4.5 at 70; Opus 4.6 Thinking at 80 | 先端モデル群と競合、特に Sonnet クラスのシステムに対して優位 |

「すべての側面でナンバーワン」ではないものの、「真剣に評価すべき水準」にすでに達しています。

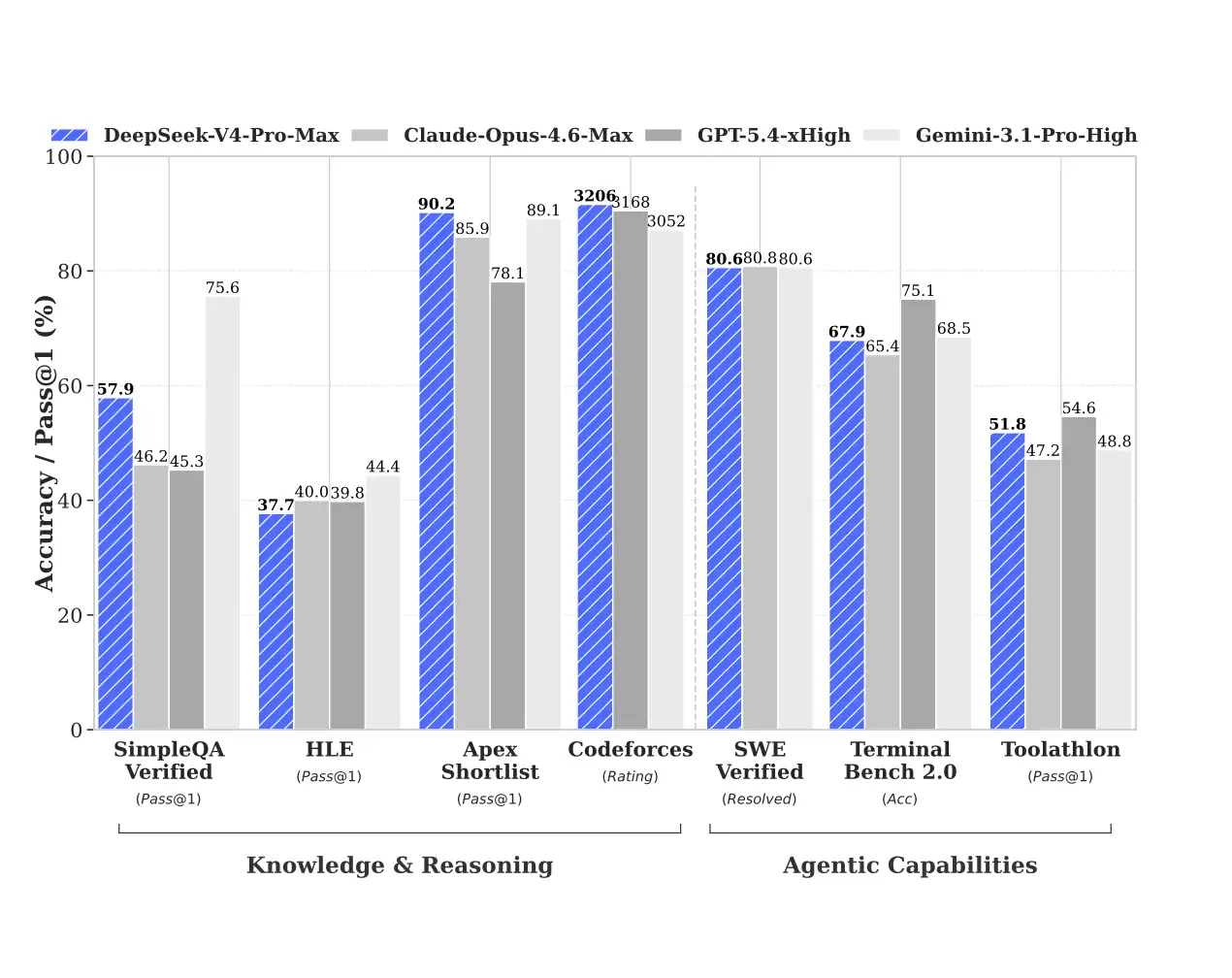

DeepSeek の技術レポートは、同一の表で V4-Pro-Max を Claude Opus 4.6 Max、GPT-5.4 xHigh、Gemini 3.1 Pro High と比較しています。結果は単純ではありません。西側のクローズドソースモデルは知識や推論のいくつかの側面で依然として強力ですが、V4-Pro-Max はコード、長コンテキスト、そして一部のエージェントタスクで非常に強い存在感を示します。言い換えれば、もはや「国内代替」という低次元の物語ではなく、「自分のシナリオにどれが適しているか」という段階に入っています。

知識と推論能力の面では、Opus 4.6 Max、GPT-5.4 xHigh、Gemini 3.1 ProHigh に匹敵します。ただし、エージェント能力ではやや後れを取るものの、その差は大きくありません。

DeepSeek-V4-Pro-Max はコード指向および長コンテキストのシナリオで非常に競争力が高く、一方で西側モデルは純粋な推論や知識ベンチマークのいくつかで依然として非常に強力です。正しい読み方はこうです:DeepSeek V4 は確実にフロンティアの土俵に立っているが、ベンチマークの主導権はタスク依存である。

How to access DeepSeek V4

1) Use the official web and app

DeepSeek は、V4 Preview をweb、app、APIで「今すぐ」利用可能としています。一般ユーザーにとって最も簡単なのは公式のチャットインターフェースで、Expert Mode または Instant Mode を通じてモデルにアクセスできます。

2) Use the API

DeepSeek V4 にアクセスするには CometAPI を強く推奨します。価格とアグリゲーションの優位性があるためです。

モデル名は次のとおりです:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek は、従来の名称である

deepseek-chatとdeepseek-reasonerを非推奨とし、2026-07-24 までは V4-Flash の非思考モード/思考モードにマッピングされるとしています。これは、既存の本番インテグレーションがある場合の移行計画にとって重要です。

- CometAPI に登録して API キーを取得します。

- 標準の OpenAI Python SDK(または任意の互換クライアント)をカスタムの base URL とともに使用します。

以下は、公式の OpenAI 互換フォーマットを用いたシンプルな例です:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

このリクエストパターンはクイックスタートに沿っています:base URL を設定し、deepseek-v4-pro または deepseek-v4-flash を選び、より深い推論が必要な場合は思考モードを有効化します。

How to use DeepSeek V4 effectively

長文ドキュメントのワークフローでは、コンテキストをクリーンかつ構造化して保つのが最も強力なパターンです。V4 の 1M-token ウィンドウは大きな利点ですが、入力をセクション、ソース抜粋、タスク指示、明確な出力制約に整理したときに、モデルは依然として最良のパフォーマンスを発揮します。これは、DeepSeek がアピールする長コンテキスト能力を最も自然に活用する方法です。

コードとエージェントのワークフローでは、まずはV4-Flash で高速に反復し、最終実行や最も困難なステップで V4-Pro に切り替えるのが良いでしょう。これは公式のポジショニングに合致します:Flash は効率的な選択肢、Pro はより強力なモデルであり、API サーフェスとコンテキスト長は同じです。

Final word

DeepSeek-V4 が注目されるのは、市場が同時に求めてきた 4 つ(長いコンテキスト、強い推論、オープンな利用性、攻めた価格)を兼ね備えているからです。重要なのは、DeepSeek が「またひとつモデルを出した」ことではありません。同社がフロンティア級 AI を本番で経済的に使えるようにしようとしていることです。次の AI 投資先を検討するチームにとって、これは無視ではなくテストすべきシグナルです。

複数プロバイダを跨いで構築するチームにとっても、これは自社スタック内でのベンチマークに値するリリースです。CometAPI は、製品チームが市場の変化のたびにインテグレーションを作り直すことなく、DeepSeek-V4 と他のフロンティアモデルを並行比較するための実用的なレイヤーになり得ます。