Google DeepMind は 2026 年 4 月 2 日に Gemma 4 を正式リリースし、オープンソース AI における大きなマイルストーンを打ち立てました。このモデルファミリーは、Gemini 3 を支える研究と技術と同根でありながら、パラメータあたりの最先端レベルの知性を実現します。従来の Gemma がカスタムライセンスだったのとは異なり、Gemma 4 は完全に寛容な Apache 2.0 ライセンスで提供され、商用利用・改変・再配布を無制限に可能にします。

Gemma 4 はマルチモーダル機能(全サイズでテキスト+画像入力、さらにエッジモデルでは音声)や、高度な推論とエージェントワークフローのネイティブ対応、最大 256K トークンの長文脈、スマートフォンや Raspberry Pi からハイエンド GPU まで最適化された設計が特徴です。140 を超える言語に対応し、効率性を重視。クラウドに依存せず、コンシューマやエッジハードウェア上でも強力な AI を利用可能にします。

CometAPI は優れたオープンソースおよびクローズドソースのモデル API を提供しています。

What Is Gemma 4?

Gemma 4 は Google DeepMind による最新のオープンなマルチモーダル大規模言語モデル(LLM)ファミリーで、高度な推論、エージェント型 AI ワークフロー、効率的なオンデバイス展開のために設計されています。プロプライエタリな Gemini 3 の研究から得た知見を活用しつつ、完全にオープンウェイトかつオープンソースで、「パラメータあたりの知性」を最大化します。

従来の Gemma モデルからの主な進歩点:

- ネイティブなマルチモーダリティ: テキスト+画像理解(全モデル)、小型エッジ系では音声にも対応。

- 設定可能な思考モード: 構造化された <|think|> 出力によるステップバイステップ推論。

- ネイティブな関数呼び出しとツール使用: 自律エージェントに最適。

- 拡張コンテキスト: 大型モデルで最大 256K トークン。

- ハイブリッド注意アーキテクチャ: 局所のスライディングウィンドウとグローバル注意を組み合わせ、効率と長文脈性能を両立。

- 小型モデルでの Per-Layer Embeddings (PLE) と共有 KV キャッシュによりメモリ節約。

- 幅広い多言語サポート: 140 以上の言語をカバーするデータで事前学習し、文化的ニュアンスも考慮。

Apache 2.0 によってリリースされた Gemma 4 は、これまで企業導入を制限していたライセンス上の制約を取り除きました。開発者はファインチューニング、デプロイ、商用化を摩擦なく行え、Llama や Qwen のような完全オープンなエコシステムに正面から対抗できる存在となります。

Gemma 4 は多様なハードウェアをターゲットにしています。エッジデバイス(電話、IoT、Raspberry Pi、Jetson Nano)では低レイテンシーのオフライン AI を、ワークステーション/GPU ではローカルサーバーとして高性能を発揮。この「ローカルファースト」設計は、プライバシー、コスト削減、ゼロレイテンシー推論を重視しています。

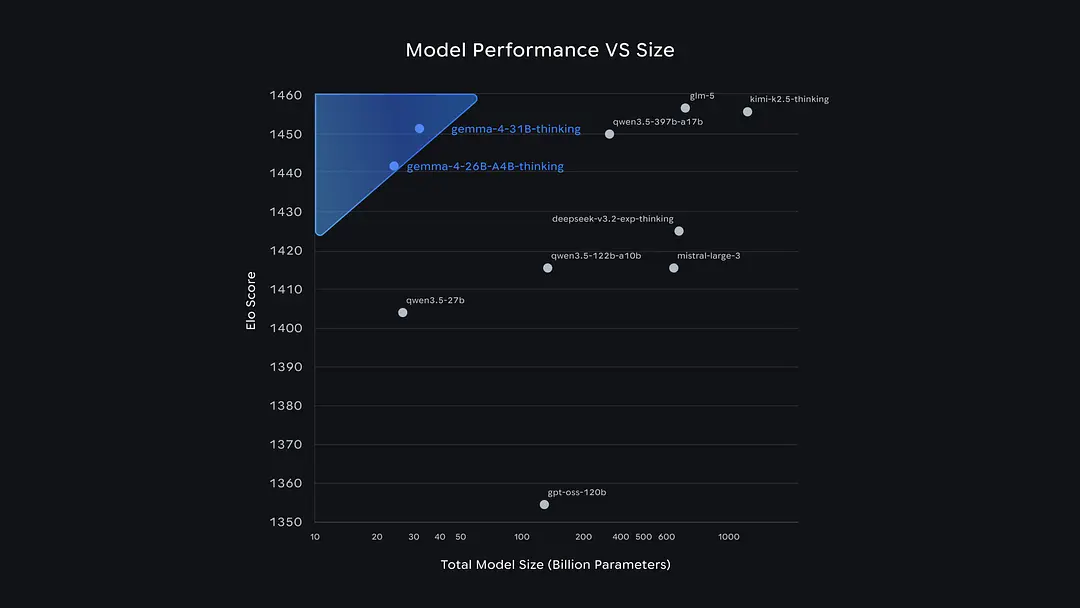

Arena リーダーボードで Gemma 4 より上位にランクされているオープンソースモデルは、主に中国のチームによるものです。Gemma 4 は Qwen 3.5 や GLM-5 と大差はありませんが、OpenAI の GPT-OSS-120B とは大きく異なります。

開発者は、CometAPI 上で GLM-5、Qwen 3.5 などを見つけることができます。

The Four Versions of Gemma 4

Google は、パフォーマンス、効率、デプロイシナリオのバランスをとった 4 つのサイズの Gemma 4 をリリースしました。2 つはエッジ効率のための革新的な Per-Layer Embeddings (PLE) を備えた密(Dense)アーキテクチャ、1 つはアクティブパラメータを抑えつつ高性能な Mixture-of-Experts(MoE)、もう 1 つはフラッグシップの密モデルです。

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Text, Image, Audio | Smartphones, Raspberry Pi, edge IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Text, Image, Audio | Mobile devices, lightweight GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Image | Workstations, consumer GPUs, local servers |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Image | High-end GPUs (fits on single H100/A100 in FP16) |

Gemma 4 E2B および E4B(エッジ最適化): PLE により、わずかなパラメータ増で層ごとの専門性を追加。バッテリー駆動やメモリ制約のあるデバイスに最適。音声エンコーダ(USM スタイルの Conformer、~300M パラメータ)により、音声認識と翻訳に対応。

Gemma 4 26B A4B(MoE): 合計 25B+ のサイズながら、推論時には ~4B のパラメータのみをアクティブ化。大幅に低い計算コストで 31B に近い性能を発揮し、コスト効率の良いスケーリングに最適。

Gemma 4 31B(Dense): 最大能力を追求したフラッグシップ。フル精度の 80GB 単一 GPU に収まり、リーダーボードでもトップクラスのオープンモデル。

すべてのモデルには、チャット、推論、ツール使用に最適化されたインストラクションチューニング済み(“-it”)の派生と、ファインチューニング用の事前学習ベース版が含まれます。大型 2 モデルはアプローチが異なり、31B Dense は最高品質を追求し、ファインチューニングの最良の土台に。26B MoE は速度を優先し、推論時に 38 億パラメータのみをアクティブ化することで語生成が大幅に高速になりますが、全体的な品質はわずかに劣ります。

小型の E2B と E4B は、モバイル端末や IoT デバイス向けに特化設計され、完全オフラインで動作し、メモリと電力を節約します。さらに、これらの小型モデルには大型モデルにはない機能、すなわちネイティブ音声入力があり、直接の音声認識が可能です。

Core Capabilities of Gemma 4

Gemma 4 は、実運用の AI アプリケーションで重要となる領域で卓越した性能を示します。

1. Advanced Reasoning & Thinking Mode

システムプロンプトまたは enable_thinking=True により、ステップバイステップ推論を設定可能。構造化された <|think|> タグと最終回答を出力します。追加のファインチューニングなしで複雑なタスクの性能を大幅に向上。

2. Multimodal Understanding

- Vision: 物体検出(JSON のバウンディングボックス)、OCR(多言語)、ドキュメント/PDF 解析、チャート理解、UI 理解、手書き認識、可変解像度画像対応(トークンバジェット: 70–1120 トークン)。

- Video: 最大 60 秒(1 fps のフレーム処理)。

- Audio(E2B/E4B のみ): 音声認識(ASR)と音声からテキストへの翻訳(最大 30 秒)。

- インターリーブ入力: テキスト、画像、音声を任意の順序で混在可能。

3. Agentic Workflows & Function Calling

ネイティブなツール使用に対応し、複数ステップの計画、API 呼び出し、アプリ操作、タスク完了を行う自律エージェントを実現。τ2-bench(エージェント的ツール使用)で強力。

4. Coding & Developer Tools

コード生成、補完、デバッグ、リポジトリ全体の理解に優れます。シームレス統合のための JSON 構造化出力をサポート。LiveCodeBench v6 で 80.0%(31B)を記録し、オフライン開発に適したローカルファーストの AI プログラミングアシスタントとして位置づけられます。

5. Long-Context & Multilingual

128K–256K トークンを安定して処理(MRCR の needle-in-haystack テストで検証)。2025 年 1 月までの多様なデータで事前学習し、強力なクロスリンガル性能を備えます。単なる多言語翻訳にとどまらず、140 を超える言語をネイティブに学習しています。

Benchmark Data: Gemma 4 Performance Breakdown

Gemma 4 はオープンモデルの新たな基準を打ち立てています。31B と 26B は、かつてはより大規模なプロプライエタリシステムの領域だったスコアを達成し、エッジモデルは Gemma 3 のより大きな先行モデルを上回ります。

Full Benchmark Results (Instruction-Tuned Models)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Reasoning & Knowledge | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Math | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Graduate-level Science | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentic Tool Use | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Coding | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Competitive Coding | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal Reasoning | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Math + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Long Context | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Key Insights:

- Gemma 3 からの大幅な飛躍: 31B は AIME 数学で 20.8% から 89.2%、LiveCodeBench は 29.1% から 80.0% に向上。

- MoE の効率性: 26B A4B は推論計算を大幅に抑えつつ 31B に迫る性能。

- エッジでの優位: E4B と E2B は、6–10 倍小さいにもかかわらず、多くの指標で Gemma 3 27B を上回る。

- リーダーボードの順位: 31B は Arena AI(テキスト)で ~1452、26B A4B は ~1441。26B はユーザー嗜好とコーディングで、Qwen 3.5 397B のようなはるかに大型のモデルを凌駕するとの報告。

ビジョンと音声のベンチマークでも、特化した追加チューニングなしで、即戦力のマルチモーダル性能が確認されています。

Ecosystem and Tool Support

Gemma 4 は、即日で広範なエコシステム統合を享受します。

- Hugging Face:

transformers、pipeline("any-to-any")、GGUF、ONNX、マルチモーダルプロセッサに対応。 - ローカルランタイム: Ollama、Llama.cpp(LM Studio、Jan)、MLX(Apple Silicon with TurboQuant)、Mistral.rs(Rust)、Transformers.js(WebGPU ブラウザ推論)。

- ファインチューニング: TRL、Unsloth、PEFT、Vertex AI、フルマルチモーダルデータセット対応。

- ハードウェア最適化: NVIDIA RTX/DGX Spark/Jetson(TensorRT-LLM 経由)、Google AI Edge ツール、Android/iOS のオンデバイス展開。

- エージェントフレームワーク: OpenClaw、Hermes、Pi、CARLA シミュレーションテスト。

- クラウド/スタジオ: Google AI Studio で迅速に試験可能;Kaggle Models からダウンロード。

このエコシステムにより、Gemma 4 はノート PC、サーバー、エッジデバイスに数分でデプロイできます。

Limitations & Safety:

- 学習データのカットオフ: 2025 年 1 月(ツールなしではリアルタイム知識なし)。

- 音声はスピーチに限定(音楽は対象外);動画は最大 60 秒。

- 幻覚のリスクは残るため、思考モードや検証を活用。

- 安全性: Google AI Principles に基づく厳格なフィルタリングと評価;開発者は用途に応じたガードを追加すべきです。

Why Gemma 4 Matters in 2026

Gemma 4 は最先端 AI を民主化します。マルチモーダル知性、エージェント能力、Apache 2.0 の自由度、ハードウェア非依存の効率性を組み合わせることで、開発者と企業が安全・プライベート・コスト効率に優れた AI ソリューションを大規模に構築できるようにします。とりわけエッジモデルが昨日のフラッグシップ級オープンモデルを上回る「パラメータあたりの知性」のブレークスルーは、真のユビキタス AI への転換点を示します。

スマートフォン上で 2B モデルを動かすにせよ、ローカルで 31B のパワーハウスを稼働させるにせよ、Gemma 4 は、実用面でオープンソース AI がクローズド代替を追い抜きつつあることを証明しています。