2025年12月15日現在、公開情報によれば、Google の Gemini 3 Pro(プレビュー)とOpenAI の GPT-5.2は、推論、マルチモーダリティ、長コンテキストで新たな地平を切り開いています――ただし取りうる工学的アプローチは異なります(Gemini → スパース MoE + 巨大コンテキスト;GPT-5.2 → 密/「ルーティング」設計、コンパクションおよび x-high 推論モード)。そのため、ピーク・ベンチマークの勝利 と エンジニアリングの予測可能性、ツール群、エコシステムとの間でトレードオフがあります。どちらが「より良いか」は主目的に依存します。極端なコンテキストとマルチモーダルなエージェント型アプリケーションなら Gemini 3 Pro が適し、安定したエンタープライズ向け開発ツール、予測可能なコスト、即時の API 利用を求めるなら GPT-5.2 が有利です。

GPT-5.2 とは?主な特徴は?

GPT-5.2 は OpenAI が 2025年12月11日にリリースした GPT-5 ファミリーの最新版(バリアント:Instant, Thinking, Pro)です。「プロフェッショナルな知識労働」に最適化された同社で最も高性能なモデルとして位置づけられ、スプレッドシート、プレゼンテーション、長コンテキスト推論、ツール呼び出し、コード生成、ビジョンタスクに強みがあります。GPT-5.2 は有料の ChatGPT ユーザーおよび OpenAI API(Responses API / Chat Completions)で、gpt-5.2、gpt-5.2-chat-latest、gpt-5.2-pro などのモデル名で利用可能です。

モデルのバリアントと想定用途

- gpt-5.2 / GPT-5.2 (Thinking) — 複雑なマルチステップ推論に最適(Responses API のデフォルト「Thinking」ファミリー)。

- gpt-5.2-chat-latest / Instant — 日常的なアシスタント/チャット用途向けの低レイテンシ。

- gpt-5.2-pro / Pro — 最難関課題に対する最高精度/信頼性(追加計算、

reasoning_effort: "xhigh"をサポート)。

主な技術的機能(ユーザー向け)

- ビジョン & マルチモーダルの改善 — 画像での空間的推論が向上し、コードツール(Python ツール)併用時の動画理解も改善。スニペット実行のためのコードインタープリタ風ツールもサポート。

- 推論深度の調整が可能(

reasoning_effort: none|minimal|low|medium|high|xhigh)。レイテンシ/コストと深さをトレードオフ可能。xhighは GPT-5.2 の新機能(Pro でサポート)。 - 長コンテキスト処理の改善とコンパクション機能により数十万トークン規模で推論(OpenAI は MRCRv2 / 長コンテキスト指標で好成績を報告)。

- 高度なツール呼び出し & エージェント型ワークフロー — 複数ターンの調整が強化され、単一の「メガエージェント」的な構成でツールのオーケストレーションが可能(OpenAI は Tau2-bench のツール性能を強調)。

Gemini 3 Pro Preview とは?

Gemini 3 Pro Preview は、2025年11月にリリースされた Google の Gemini 3 ファミリーの最上位ジェネレーティブ AI モデルです。マルチモーダル理解を重視して設計され、テキスト、画像、動画、オーディオを理解・統合でき、約 100 万トークンの大規模コンテキストウィンドウを備え、広大なドキュメントやコードベースの処理に対応します。

Google は Gemini 3 Pro を推論の深さとニュアンスで最先端と位置づけ、Google AI Studio、Vertex AI、Google Antigravity のようなエージェント開発プラットフォームの中核エンジンとして提供しています。

現時点ではプレビュー段階で、機能とアクセスは拡大中ですが、すでに論理、マルチモーダル理解、エージェント型ワークフローの各種ベンチマークで高スコアを示しています。

主な技術・製品機能

- コンテキストウィンドウ: Gemini 3 Pro Preview は1,000,000 トークン入力(出力は最大 64k トークン)をサポート。膨大なドキュメント、書籍、動画トランスクリプトを単一リクエストで取り込める実用上の利点。

- API 機能: レイテンシと推論の深さをトレードオフする

thinking_level(low/high)や、マルチモーダルの忠実度とトークン消費を制御するmedia_resolution。検索グラウンディング、ファイル/URL コンテキスト、コード実行、関数呼び出しをサポート。思考シグネチャとコンテキストキャッシュでマルチコールの状態保持を支援。 - Deep Think モード / 高度推論: 追加の推論パスを付与する「Deep Think」オプションで、難問題ベンチマークのスコアを押し上げる。Google は Deep Think を複雑な課題向けの高性能経路として公開。

- ネイティブなマルチモーダル対応: テキスト、画像、音声、動画入力をサポートし、検索や製品統合でのグラウンディングが密接(Video-MMMU などのマルチモーダル指標を強調)。

クイックプレビュー — GPT-5.2 と Gemini 3 Pro

重要な事実を凝縮した比較表(出典明記)。

| 項目 | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| ベンダー / ポジショニング | OpenAI — プロフェッショナルな知識労働、コーディング、エージェント型ワークフローに焦点を当てた GPT-5.x のフラッグシップ。 | Google DeepMind / Google AI — 超長コンテキストのマルチモーダル推論とツール統合に焦点を当てた Gemini 世代のフラッグシップ。 |

| 主なモデル系統 | Instant, Thinking, Pro(自動切替あり)。Pro はより高い推論努力を追加。 | Gemini 3 ファミリー(Gemini 3 Pro と Deep-Think モードを含む)。マルチモーダル / エージェントに注力。 |

| コンテキストウィンドウ(入力 / 出力) | 総入力約 400,000 トークン;最大 128,000 の出力/推論トークン(非常に長い文書やコードベース向けに設計)。 | 最大約 1,000,000 トークンの入力/コンテキストウィンドウ(1M)、出力最大 64K トークン。 |

| 主な強み / フォーカス | 長コンテキスト推論、エージェント的なツール呼び出し、コーディング、構造化された職場タスク(スプレッドシート、プレゼン)。安全性/システムカードの更新で信頼性を強調。 | 大規模スケールでのマルチモーダル理解、推論 + 画像合成、非常に大きなコンテキスト + 「Deep Think」推論モード、Google エコシステムでの強力なツール/エージェント統合。 |

| マルチモーダル & 画像機能 | ビジョンとマルチモーダルのグラウンディングが改善。ツール利用とドキュメント解析に最適化。 | 高忠実度の画像生成 + 推論強化された合成、複数参照に基づく画像編集、可読なテキストレンダリング。 |

| レイテンシ / 対話性 | 以前の GPT-5.x より低レイテンシの推論と応答性を強調;複数ティア(Instant / Thinking / Pro)。 | Google は最適化された「Flash」/サービングで多くのフローにおいて同等の対話速度を強調;Deep Think モードはレイテンシと引き換えに推論を深める。 |

| 注目機能 / 差別化点 | 推論努力レベル(medium/high/xhigh)、改良されたツール呼び出し、高品質コード生成、エンタープライズ向けワークフローでの高いトークン効率。 | 100 万トークンのコンテキスト、強力なネイティブマルチモーダル入力(動画/音声)、「Deep Think」推論モード、Google 製品統合(Docs/Drive/NotebookLM)との緊密さ。 |

| 典型的な最適用途(短) | 長文書分析、エージェント型ワークフロー、複雑なコーディングプロジェクト、エンタープライズ自動化(スプレッドシート/レポート)。 | 極めて大規模なマルチモーダル案件、100 万トークン級の長期エージェントワークフロー、先進的な画像 + 推論パイプライン。 |

GPT-5.2 と Gemini 3 Pro はアーキテクチャ的にどう違う?

コアアーキテクチャ

- ベンチマーク / 実務評価: GPT-5.2 Thinking は GDPval(44職種の知識労働評価)で 70.9% の勝利/同点を達成し、旧 GPT-5 系から工学/数学ベンチマークで大幅な伸び。SWE-Bench Pro(コーディング)や GPQA Diamond(領域科学 QA)でも改善。

- ツール & エージェント: ツール呼び出し、Python 実行、エージェント型ワークフロー(ドキュメント検索、ファイル分析、データサイエンスエージェント)を強化。一部の GDPval タスクで人間専門家比 11x の速度 / コスト <1% を達成(潜在的経済価値の指標、70.9% は従来の約 38.8% からの伸長)。スプレッドシート・モデリングでも向上(例:GPT-5.1 比 +9.3%)。

- Gemini 3 Pro: スパース Mixture-of-Experts Transformer(MoE)。トークンごとに少数のエキスパートのみを起動し、トークン当たりの計算を抑えつつ総パラメータ容量を極大化。Google のモデルカードは、こうした Sparse MoE 設計が性能向上の主要因であると明記。線形な推論コストにせずに容量を押し上げることを可能に。

- GPT-5.2(OpenAI): Transformer 系を継続しつつ GPT-5 ファミリーでルーティング/コンパクション戦略を活用(「ルータ」が Instant と Thinking のモードを切り替え、長期タスク向けに回答前の思考とコンパクションを重視)。GPT-5.2は、巨大スパース MoE の発表ではなく、思考重視の学習/評価と長期タスクのためのコンパクションに焦点。

アーキテクチャの含意

- レイテンシ & コストのトレードオフ: Gemini 3 Pro のような MoE は、トークン当たりに動かすエキスパートを限定することで、多くのタスクで高いピーク能力/低い推論コストを両立可能。一方で、サービングやスケジューリングの複雑性(エキスパートのコールドスタートや I/O バランス)を招き得る。GPT-5.2 の(密/ルーティング + コンパクション)アプローチは、確定的なレイテンシと開発者の使い勝手を重視し、Responses/Realtime/Assistants/Batch などの既存ツール群に馴染みやすい。

- 長コンテキストのスケーリング: Gemini の 100 万入力トークンは、極端に長い文書やマルチモーダルストリームをネイティブに取り込める。GPT-5.2 の約 40 万(入力+出力合算)は企業用途では十分に巨大だが、1M の仕様には及ばない。超大規模コーパスや数時間級の動画書き起こしには Gemini に明確な優位。

ツール、エージェント、マルチモーダル基盤

- OpenAI: ツール呼び出し、Python 実行、「Pro」推論モード、有償のエージェントエコシステム(ChatGPT Agents / 企業向けツール統合)との深い統合。コード中心のワークフローやスプレッドシート/スライド生成を一級の出力として重視。

- Google / Gemini: Google 検索へのグラウンディング(オプション課金)、コード実行、URL/ファイルのコンテキスト、視覚メディアの忠実度を調整するメディア解像度などを内蔵。API は

thinking_levelなどのノブを提供し、コスト/レイテンシ/品質をチューニング可能。

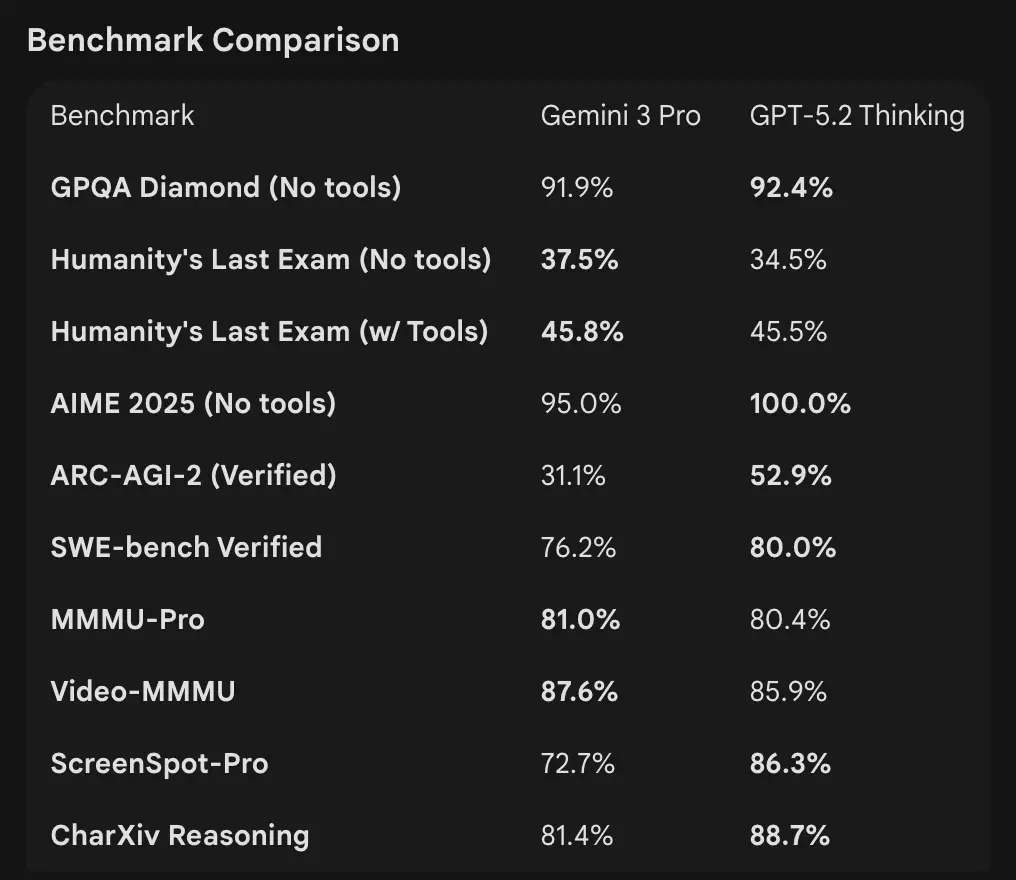

ベンチマーク数値の比較

コンテキストウィンドウとトークン処理

- Gemini 3 Pro Preview: 1,000,000 入力トークン / 64k 出力トークン(Pro プレビューのモデルカード)。ナレッジカットオフ:2025年1月(Google)。

- GPT-5.2: OpenAI は長コンテキスト性能(4k–256k の MRCRv2「針」タスクで多くが 85–95% 範囲)を示し、コンパクション機能を強調。API では

gpt-5.2、gpt-5.2-chat-latest、gpt-5.2-proを提供し、統一の 1M 数値よりもバリアント別のウィンドウとコンパクション活用を前面に。

推論とエージェント型ベンチマーク

- OpenAI(抜粋): Tau2-bench Telecom 98.7%(GPT-5.2 Thinking)。ツール多段利用やエージェントタスクでの伸長(複数エージェントを「メガエージェント」に統合する事例を強調)。GPQA Diamond や ARC-AGI でも GPT-5.1 からの段差的伸び。

- Google(抜粋): Gemini 3 Pro:LMArena 1501 Elo、MMMU-Pro 81%、Video-MMMU 87.6%、高い GPQA と Humanity’s Last Exam スコア。長期プランニングを要するエージェント事例も提示。

ツール & エージェント:

GPT-5.2:ツール呼び出し、Python 実行、エージェント型ワークフロー(ドキュメント検索、ファイル分析、データサイエンスエージェント)を強化。一部の GDPval タスクで人間専門家比 11x の速度 / コスト <1%(潜在的経済価値の測度、70.9% は従来の約 38.8%)を示し、スプレッドシート・モデリングでも具体的な改善(例:ジュニア投資銀行業務で GPT-5.1 比 +9.3%)。

解釈: ベンチマークは相補的です――OpenAI は実務の知識労働(GDPval)を強調し、GPT-5.2 がスプレッドシート、スライド、長いエージェント連鎖のようなプロダクションタスクで卓越することを示します。Google は生の推論リーダーボードと、単一リクエストでの超長コンテキストを強調。どちらが重要かはワークロード次第です。エージェント型の長文書エンタープライズ・パイプラインには GPT-5.2 の GDPval 実績が適し、大量の生コンテキスト(例:動画コーパス全体/書籍一冊を一括投入)には Gemini の 1M 入力が有利。

マルチモーダル機能の比較

入出力

- Gemini 3 Pro Preview: テキスト、画像、動画、音声、PDF の入力とテキスト出力をサポート。

media_resolutionで粒度を制御し、thinking_levelでコストと忠実度を調整。出力上限 64k、入力最大 1M トークン。 - GPT-5.2: リッチなビジョン/マルチモーダル・ワークフローをサポート。画像の空間推論(コンポーネントの境界・ラベル推定)が改善し、ツール併用で動画理解(Video MMMU)も向上。ビジョン + コードの複合課題は、ツール(Python 実行)有効化で大幅に伸びると強調。

実務上の違い

細やかさ vs. 網羅性: Gemini はメディア種別ごとのトレードオフを調整するノブ(media_resolution、thinking_level など)を豊富に用意。GPT-5.2 は、ツール利用の統合(ループ内で Python 実行)によって、ビジョン・コード・データ変換を組み合わせる実務を重視。大量の動画/画像解析かつ極端な長コンテキストなら Gemini の 1M が魅力。コード実行を伴うデータ変換やスプレッドシート生成が中核なら、GPT-5.2 のツール群とエージェント親和性が便利。

API アクセス、SDK、料金は?

OpenAI GPT-5.2(API & 料金)

- API:

gpt-5.2、gpt-5.2-chat-latest、gpt-5.2-pro(Responses API / Chat Completions)。成熟した SDK(Python/JS)、クックブック、充実したエコシステム。 - 料金(公開): $1.75 / 100万入力トークン、$14 / 100万出力トークン。キャッシュ済み入力に 90% 割引が適用され、反復データでは実効コストを大幅低減。OpenAI は「所要品質に到達するまでの総トークン量」を抑えるトークン効率を強調。

Gemini 3 Pro Preview(API & 料金)

- API:

gemini-3-pro-preview(Google GenAI SDK、Vertex AI / GenerativeLanguage エンドポイント)。thinking_level、media_resolution、検索グラウンディングやツール統合を提供。 - 料金(公開プレビュー): 概ね $2 / 100万入力トークン、$12 / 100万出力トークン(200k トークン未満のプレビューティア基準)。検索グラウンディングや Maps 等の追加サービスで別課金の可能性(検索グラウンディングの課金開始は 2026年1月5日)。

CometAPI 経由で GPT-5.2 と Gemini 3 を利用する

CometAPI はゲートウェイ/アグリゲータ API で、単一の OpenAI 風 REST エンドポイントから多数ベンダーの数百モデル(LLM、画像/動画、埋め込み等)に統一アクセスを提供します。複数のベンダー SDK を統合する代わりに、OpenAI 形式のエンドポイント(chat/completions/embeddings/images)で呼び出しつつ、裏側でモデル/ベンダーを切り替え可能。

開発者は CometAPI を使うことで、2社のフラッグシップモデルを同時に扱え、価格は通常公式より約 20% オフでより手頃です。

例:クイック API スニペット(コピペで試せます)

以下は最小の実行例です。各社のクイックスタート(OpenAI Responses API と Google GenAI クライアント)に準拠しています。$OPENAI_API_KEY / $GEMINI_API_KEY を自身のキーに置き換えてください。

GPT-5.2 — Python(OpenAI Responses API、深い課題向けに reasoning を xhigh に設定)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

注: reasoning.effort によりコストと深さを調整可能。日常的なチャットには gpt-5.2-chat-latest を。OpenAI ドキュメントは responses.create の例を掲載。

GPT-5.2 — curl(シンプル)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(JSON の output_text または構造化出力を参照)

Gemini 3 Pro Preview — Python(Google GenAI クライアント)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

注: thinking_level はモデルの内部思考を制御。画像/動画には media_resolution を設定可能。REST と JS の例は Gemini 開発ガイドに掲載。

Gemini 3 Pro — curl(REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Google のドキュメントにはマルチモーダルの例(画像インラインデータ、media_resolution)が含まれます。

どちらが「優れている」か — 実務的ガイダンス

次の場合は GPT-5.2 を選ぶ:

- コード実行ツールとの緊密な統合(OpenAI のインタープリタ/ツール群)が必要で、プログラム的なデータパイプライン、スプレッドシート生成、エージェント型のコードワークフローを重視。OpenAI は Python ツールの改善とメガエージェント活用を強調。

- ベンダーの主張するトークン効率を優先し、キャッシュ済み入力の大幅割引による明確で予測可能な従量課金を望む(バッチ/本番ワークフローに有利)。

- OpenAI のエコシステム(ChatGPT 製品統合、Azure / Microsoft 連携、Responses API や Codex 周辺ツール)を活用したい。

次の場合は Gemini 3 Pro を選ぶ:

- **極めて重いマルチモーダル入力(動画 + 画像 + 音声 + PDF)**を単一モデルでネイティブに受け付け、1,000,000 トークンの入力窓が必要。Google は長尺動画や大規模ドキュメント + 動画パイプライン、対話型 Search/AI Mode を明確に訴求。

- Google Cloud / Vertex AI を基盤に、検索グラウンディング、Vertex のプロビジョニング、GenAI クライアント API との緊密な統合を求める。Google 製品統合(Search AI Mode、AI Studio、Antigravity エージェントツール)で恩恵がある。

結論:2026年時点でどちらが優れているか?

GPT-5.2 vs. Gemini 3 Pro Preview の勝敗はコンテキスト依存です。

- GPT-5.2 はプロフェッショナルな知識労働、分析の深さ、構造化ワークフローでリード。

- Gemini 3 Pro Preview はマルチモーダル理解、統合エコシステム、巨大コンテキスト課題で卓越。

万能の「勝者」は存在せず、両者の強みは実世界の異なる要求を補完します。導入者は、ユースケース、予算、エコシステム適合に合わせてモデルを選ぶべきです。

2026年の明白な点は、AI フロンティアが大きく前進したことであり、GPT-5.2 と Gemini 3 Pro の両者が、エンタープライズのみならず幅広い領域で知的システムの可能性を押し広げていることです。

すぐに試したい方は、GPT-5.2 と Gemini 3 Pro を CometAPI の Playground で体験し、詳細は API ガイドをご確認ください。アクセス前に、CometAPI へログインして API キーを取得してください。CometAPI は公式より大幅に低い価格での統合を支援します。

準備はいいですか?→ GPT-5.2 と Gemini 3 Pro の無料トライアル !

もしあなたが