GPT-5.5 Instant は、ChatGPT を支える日常的なインテリジェンスの最新アップグレードです。2026年5月5日にリリースされ、数億人のユーザー向けのデフォルトモデルとして GPT-5.3 Instant を置き換えました。ユーザーが期待する低レイテンシの「インスタント」体験を維持しつつ、より賢く正確で、ハルシネーションを大幅に抑えた応答を提供します。

開発者、起業家、SaaS ビルダー、エンタープライズチームにとって、このモデルアップグレードは、スピードやコストを犠牲にすることなく、信頼できる AI 統合の新たな可能性を開きます。本包括ガイドでは、素早い ChatGPT アクセスから本番グレードの API 利用まで、実践的な例と最適化戦略とともに網羅します。

GPT-5.5 Instant とは何か、なぜ重要か

GPT-5.5 Instant は、日々の対話、検索拡張応答、画像解析、パーソナライズされたコンテキスト想起に最適化された、高速かつ効率的なバリアントです。デフォルトの ChatGPT 体験を支えつつ、前世代に対して測定可能な改善を提供します。

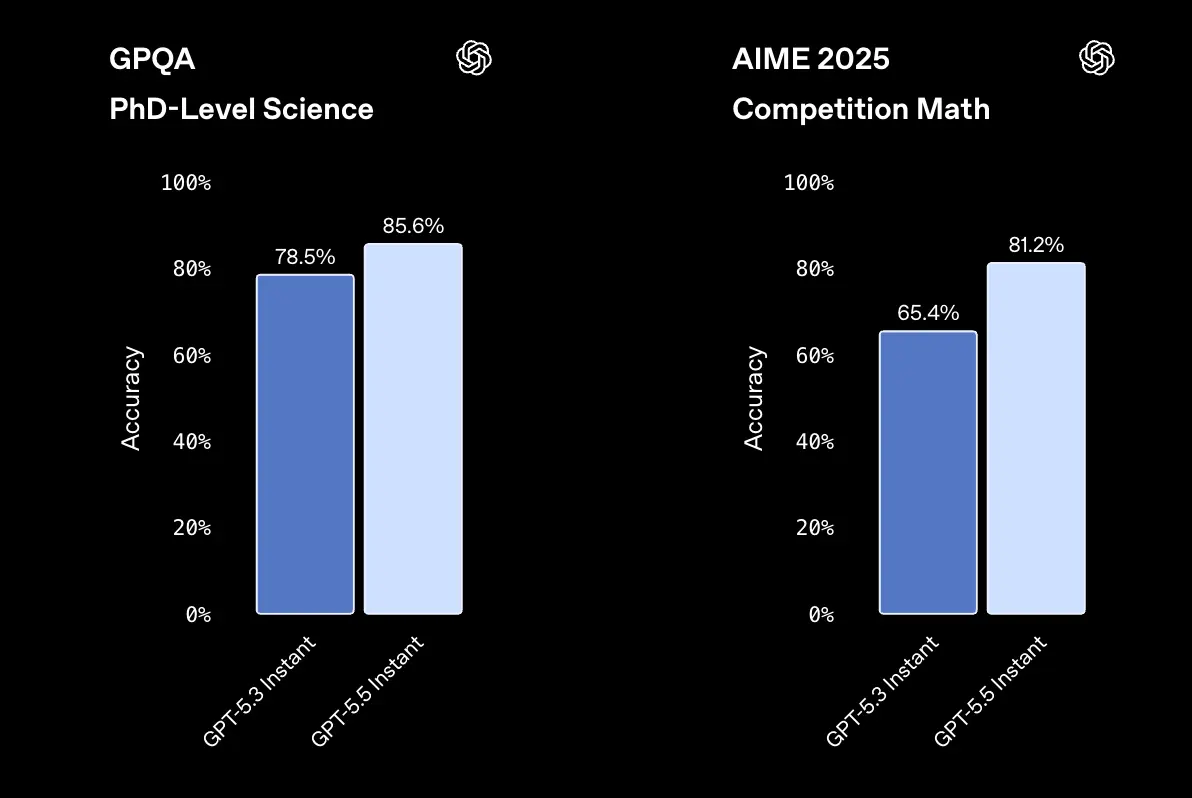

主な改善点(OpenAI の評価に基づく):

- 高リスクなプロンプトにおいて、GPT-5.5 Instant は GPT-5.3 Instant よりもハルシネーションの主張を52.5%削減

- 困難な会話での不正確な主張を 37.3% 減少

- 写真/画像解析、STEM 質問、必要な場面でのウェブ検索の呼び出し判断で性能が強化

- 過去のチャット、ファイル、接続された Gmail からのより優れたコンテキスト管理により、より簡潔で自然、パーソナライズされた応答を実現

深い推論や高度なエージェントタスク向けに設計された重量級の GPT-5.5(Thinking/Pro バリアント)とは異なり、GPT-5.5 Instant は一般利用におけるスピードと信頼性を優先しつつ、実質的な能力向上も提供します。

GPT-5.5 Instant と GPT-5.5、および既存モデルの比較表

| Feature/Model | GPT-5.5 Instant (Default) | GPT-5.5 (Full/Thinking) | GPT-5.3 Instant (Previous) |

|---|---|---|---|

| Primary Strength | Speed + Reliability | Deep Reasoning & Agents | General Use |

| Latency | Lowest | Higher | Low |

| Hallucination Reduction | 52.5% fewer (high-stakes) | Highest | Baseline |

| Personalization | Excellent (memory search) | Strong | Good |

| Image/STEM Performance | Significantly Improved | Superior | Good |

| API Pricing (approx.) | Competitive via providers | $5/$30 per M tokens | Lower |

| Best For | Chat, quick tasks, apps | Complex workflows | Legacy |

Instant を選ぶべき状況: 日常アプリケーション、カスタマーサポートボット、コンテンツ生成、レイテンシに敏感なインターフェース。

本質的に、GPT-5.5 Instant と GPT-5.5 Thinking は同じ基盤アーキテクチャを共有しています。違いは知識レベルではなく推論の深さにあります。有料ユーザーは GPT-5.5 Thinking を使用でき、無料ユーザーは ChatGPT で GPT-5.5 Instant を制限付きで利用できます。

詳細は GPT-5.5 overview およびメカニズムを参照してください。

ChatGPT で GPT-5.5 Instant にアクセスする方法

ChatGPT を直接使用している場合、GPT-5.5 Instant はログイン済みユーザーすべてのデフォルトです。OpenAI によれば、すべての ChatGPT ユーザーに段階的に展開され、GPT-5.3 Instant をデフォルトモデルとして置き換えます。つまり、多くのユーザーは新しい Instant 体験の恩恵を受けるために手動で切り替える必要がありません。

有料ユーザー向けには、GPT-5.5 Instant または GPT-5.5 Thinking を手動選択できるモデルピッカーが用意されています(有料ユーザー向けには、GPT‑5.3 Instant は 3 か月間引き続き利用可能)。OpenAI のヘルプセンターによると、Plus、Pro、Business ユーザーがピッカーにアクセスでき、GPT-5.5 Pro は Pro、Business、Enterprise、Edu プランに限定されています。

無料ユーザーも ChatGPT で GPT-5.5 を使用できますが、利用制限があります。OpenAI によれば、Free ティアのアカウントは 5 時間あたり最大 10 メッセージを GPT-5.5 に送信でき、Plus と Go ユーザーは 3 時間あたり最大 160 メッセージを送信できます。上限に達すると、チャットは制限がリセットされるまで GPT-5.5 mini バージョンに切り替わります。Pro とビジネスチームはリバートせず、引き続き GPT-5.5 を使用できます。

Pro または Enterprise エディションを使用しており、実タスクで Instant と Thinking の性能を比較したい場合は、2 つのタブを並べて開き、それぞれに固定し、同じプロンプトを入力してください。暗黙的な多段推論を伴うタスクでは違いが特に顕著で、Thinking は応答前に推論の分岐を探索します。日常的なチャットでは、Instant は初期応答がより高速です。

実用的な ChatGPT アクセスフロー

ほとんどのユーザーにとってフローはシンプルです:

- ChatGPT にサインインする。

- デフォルトの Instant 体験を利用する。

- 有料プランでは、必要に応じてモデルピッカーを開き、GPT-5.5 Instant を手動選択する。

- より深い推論が本当に必要なときだけ GPT-5.5 Thinking に切り替える。

これはユーザー向けの経路です。ただし、プロダクトチームにとって重要なのは、同等の品質を自社アプリケーションで運用可能にする方法です。そこで API ルートが重要になります。

高度な機能

- メモリとパーソナライゼーション: モデルは会話履歴、アップロードしたファイル、Gmail(接続されている場合)から適切に情報を取り出し、パーソナライズが価値を生む場面を判断します。

- 画像解析: 写真をアップロードして、視覚的推論を強化できます。

- ウェブ検索統合: 必要に応じて自動で実行します(最新情報の取得)。

プロ向けのヒント: もっともクリーンなデフォルト体験のために新しいチャットを開始しましょう。設定のカスタム手順を使うと、セッションをまたいだ一貫したトーンとコンテキストが得られます。

API 経由で GPT-5.5 Instant にアクセスして使う方法

OpenAI の API へ直接アクセスする場合、chat-latest のようなモデルエイリアスを使用します。chat-latest は、ChatGPT で現在使われている最新の Instant モデルを指します。多くのチームは、低コスト、高いレート制限、複数モデル横断の統一インテグレーションのために CometAPI などの統合プロバイダーを好みます。

API では、GPT-5.5 Instant と GPT-5.5 Thinking は単一のモデル識別子 gpt-5.5 に統合されています。gpt-5.5-instant という別エンドポイントはありません。代わりに、reasoning_effort パラメータで推論の深さを制御します。指定可能な値は minimal、low、medium、high です。reasoning_effort: "minimal" を設定するのが、ChatGPT における Instant 体験にもっとも近い API 上の同等設定です。

GPT-5.5 は 2 つのエンドポイントで提供されます:

- Responses API(

/v1/responses): ツール、構造化出力、ストリーミングを第一級でサポートする、新規構築に推奨のエンドポイント。 - Chat Completions API(

/v1/chat/completions): 後方互換性のために維持されるレガシーエンドポイント。

CometAPI を使ったステップバイステップの API セットアップ(多くのチームに推奨)

1. サインアップして API キーを取得

- CometAPI.com を訪問し、アカウントを作成します。

- コンソール/ダッシュボードで API キー(

sk-で始まります)を発行します。

2. 基本的な統合例(Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI key

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # or specific alias

messages=[

{"role": "system", "content": "You are a helpful, concise assistant."},

{"role": "user", "content": "Explain how GPT-5.5 Instant improves factuality."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. UX 向上のためのストリーミング応答

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

JavaScript、cURL、その他の言語の例も、OpenAI SDK 互換のパターンに概ね従います。

GPT-5.5 Instant の主要 API パラメータ

- temperature: 0.0–1.0(ファクト重視のタスクでは低め)。

- reasoning_effort(バリアントでサポートされる場合): バランス重視なら low/medium。

- tools/function calling: エージェント的ワークフローを完全サポート。

- Vision: 画像 URL または base64 を渡してマルチモーダルプロンプトを実行。

より良い結果を得るためのベストプラクティス

GPT-5.5 は「曖昧なプロンプトを1つ書いて祈る」タイプのモデルではありません。成果ファーストのプロンプティングを強く推奨します: 期待する結果、成功基準、制約、副作用、出力形式を明確にしてください。ドキュメントでも、プロダクト要件としてプロセス自体が必要な場合を除き、ステップバイステップの過度な指示を減らすよう勧めています。実務上は、進路の細かな指示ではなく、目的地を記述するということです。

構造化出力も重要なレバーです。とくに自動バリデーションや信頼性の高い下流パースが必要な本番システムでは、プロンプト内でスキーマを説明するのではなく、構造化出力を使うことを OpenAI は推奨しています。SaaS プロダクトでは、アプリがモデル出力のクレンジングに費やす時間が減るほど、UX は安定します。

GPT-5.5 Instant のプロンプト作成チェックリスト

以下を満たすプロンプトを書く:

- 目標を明確に述べる。

- 受け入れ基準を定義する。

- 必須のフォーマット要件を記載する。

- 不要な指示を制限する。

- 最適な進め方の選択余地をモデルに残す。

推論努力のガイダンス

OpenAI は、medium がデフォルトで推奨のバランス設定、low は多くのワークロードで有効、none は推論を必要としないレイテンシ最優先のジョブ向け、high や xhigh は評価により測定可能な品質向上が示されたタスクに限定すべきだとしています。重要なのは、推論量が多ければ自動的に良いわけではないという点です。とくに停止基準が弱いタスクや、ツールアクセスが過度に開かれた状況では注意が必要です。

実運用で有効なパターン

カスタマーサポート、社内ナレッジアシスタント、ワークフロー自動化では、以下の構成が強力です:

- 会話状態の管理に Responses API

- 予測可能なパースのための構造化出力

- ユースケースに合わせた推論努力の調整

- 繰り返しのプレフィックス向けプロンプトキャッシュ

- ワークフローに適合する範囲でのホスト型ツール

この組み合わせにより、GPT-5.5 はチャットモデルというより本番エンジンの様相を帯びてきます。

コスト最適化戦略

- よく使うプロンプト/応答をキャッシュする。

- 構造化出力(JSON モード)で確実にパースする。

- トークン使用量を監視し、推論努力レベルを賢く選ぶ。

- 単純な問い合わせは軽量モデルにルーティングし、必要に応じて Instant/GPT-5.5 にエスカレーションする。

ステップバイステップの実装例

1) ChatGPT ワークフロー

もっとも簡単な使い方は、ChatGPT 内で GPT-5.5 Instant を使うことです。サインインし、デフォルトの Instant 体験に日常業務を任せ、有料ティアでは必要に応じてモデルピッカーで GPT-5.5 Instant または GPT-5.5 Thinking を手動選択します。OpenAI によれば、デフォルトの Instant 体験はすでに情報探索、チュートリアル、技術文書、翻訳に最適化されています。

これは、コードを出荷せずに素早く回答が欲しい創業者、オペレーター、プロダクトマネージャーに最適です。また、統合に投資する前に、GPT-5.5 のトーンや正確性が自分たちのワークフローを改善するかどうかをベンチマークするのにも最適な場所です。

2) 直接 API ワークフロー

プロダクト開発では、API ルートを使用します。OpenAI のドキュメントでは、モデルスラッグを gpt-5.5 に更新し、推論とツール使用には Responses API を使い、reasoning.effort を意図的に設定するよう案内しています。ドキュメントはまた、プロンプトキャッシュ、構造化出力、マルチターン処理が優れた統合の中核であることも強調しています。

実践的な実装シーケンスは次のとおりです:

- 新しいプロンプトのベースラインから開始する。

- モデルを

gpt-5.5に設定する。 - Responses API を使用する。

- アプリが機械可読な応答を必要とする場合は構造化出力を追加する。

- レイテンシと品質の目標に合わせて

reasoning.effortをチューニングする。 - 出荷前にエンドツーエンドの動作をベンチマークする。

3) CometAPI を使った統一ゲートウェイワークフロー

CometAPI は、自社を OpenAI スタイルの API 集約プラットフォームとして位置付け、単一のインターフェース、単一の API キー、従量課金で 500 を超える AI モデルへアクセスできるとしています。プロバイダー切り替え時の統合フリクションの低減、単一の認証情報、再認証や大規模な移行なしでモデルを切り替えられる点を強調しています。

マルチモデルプロダクトを構築するチームにとって重要なのは、スタックを単一プロバイダーの統合経路に固定しないことです。ゲートウェイ方式であれば、リクエスト処理を標準化し、ベンダー比較実験を容易にし、モデル固有の SDK 乱立による保守負荷を低減できます。

CometAPI の利点: 価格が大幅に低い(例: 公式比で約 ~20% 割引)、500+ モデルに 1 つの API キーでアクセス、寛容なレート制限、テスト用プレイグラウンド。すぐに高額な OpenAI 請求を発生させずに AI 機能をスケールしたいスタートアップに最適です。

GPT-5.5 の価格変更について知りたい場合は、GPT-5.5 pricing breakdowns の詳細分析を参照ください。

FAQ

1. ChatGPT で GPT-5.5 Instant にアクセスするには?

GPT-5.5 Instant はログイン済みユーザーのデフォルトであり、有料ティアではモデルピッカーから GPT-5.5 Instant または GPT-5.5 Thinking を手動選択できます。

2. GPT-5.5 Instant は API で利用できますか?

OpenAI によれば、GPT-5.5 Instant は API では chat-latest として展開されつつあり、開発者向けのモデルスラッグとしてはドキュメントで gpt-5.5 が使われています。

3. GPT-5.5 Instant と GPT-5.5 Thinking の違いは?

GPT-5.5 Instant は日常利用と ChatGPT に最適化された高速・低レイテンシのデフォルトです。GPT-5.5(および Pro)バリアントは、より高いレイテンシとコストと引き換えに、複雑で多段的なタスク向けの深い推論を提供します。OpenAI によれば、Thinking は前段の手順をより良く追跡し、推論開始前に短い前置きを示す場合があります。

4. GPT-5.5 ではどの API を使うべき?

OpenAI は、推論、ツール呼び出し、マルチターンのユースケースには Responses API を推奨しています。

5. 推論設定は何から始めるべき?

OpenAI は medium から開始し、レイテンシ重視のワークロードでは low を試し、評価で測定可能な品質向上が示された場合にのみ high や xhigh を使うことを推奨しています。

6. GPT-5.5 はツール中心のワークフローを扱えますか?

はい。OpenAI によれば、GPT-5.5 は広いツール面を持つシステム、複数ステップのサービスワークフロー、長時間稼働のエージェントタスクで特に有用で、ツール選択と引数指定の精度が強化されています。

7. なぜダイレクトではなく CometAPI を使うチームがあるのですか?

CometAPI は、1 つの API キーで 500+ モデルにアクセスできる OpenAI スタイルの統一ゲートウェイとして自らを位置付け、プロバイダー切り替え時の統合フリクションを下げられるとしています。

結論と次のステップ

GPT-5.5 Instant は、誰もが使える信頼できる AI の水準を引き上げます。ChatGPT のワークフローを強化する場合でも、次世代の AI 搭載プロダクトを構築する場合でも、そのアクセス方法と使いこなしを理解することが不可欠です。

統合の準備はできましたか?Get started with CometAPI にアクセスして、競争力のある料金で GPT-5.5 Instant と GPT-5.5 ファミリーをすぐに利用しましょう。無料でサインアップし、プレイグラウンドを試し、馴染みのある OpenAI SDK 互換で数分でデプロイできます。