2025~2026年にかけて、AI ツールの状況は引き続き統合が進みました。ゲートウェイ API(CometAPI など)は拡張され、数百のモデルに対して OpenAI スタイルのアクセスを提供する一方、エンドユーザー向け LLM アプリ(AnythingLLM など)は、デスクトップやローカルファーストのアプリが任意の OpenAI 互換エンドポイントを呼び出せるよう「Generic OpenAI」プロバイダの改善を続けました。これにより、現在では AnythingLLM のトラフィックを CometAPI に経由させ、モデル選択、コストルーティング、請求の一元化といった利点を得つつ、AnythingLLM のローカル UI および RAG/エージェント機能を引き続き利用することが容易になっています。

AnythingLLM とは何で、なぜ CometAPI と接続するのか?

AnythingLLM とは?

AnythingLLM はオープンソースのオールインワン AI アプリケーションであり、チャットアシスタント、RAG(retrieval-augmented generation)ワークフロー、LLM 駆動のエージェントを構築するためのローカル/クラウドクライアントです。洗練された UI、開発者向け API、ワークスペース/エージェント機能、ローカルおよびクラウド LLM のサポートを提供し、デフォルトでプライバシー重視、プラグインによる拡張性も備えます。AnythingLLM は OpenAI 互換 LLM API と通信できる Generic OpenAI プロバイダを公開しています。

CometAPI とは?

CometAPI は商用の API 集約プラットフォームで、OpenAI 風の REST インターフェースと一元課金によって 500+ の AI モデル を提供します。実際には、単一の https://api.cometapi.com/v1 エンドポイントと 1 つの API キー(形式 sk-xxxxx)を通じて、複数ベンダー(OpenAI、Anthropic、Google/Gemini 系、画像/音声モデルなど)のモデルを呼び出せます。CometAPI は /v1/chat/completions、/v1/embeddings など標準的な OpenAI 互換エンドポイントをサポートしており、すでに OpenAI 互換 API をサポートするツールへの適用が容易です。

なぜ AnythingLLM と CometAPI を統合するのか?

3 つの実利があります。

- モデル選択とベンダーフレキシビリティ: AnythingLLM は Generic OpenAI ラッパー経由で「任意の OpenAI 互換」LLM を利用できます。このラッパーを CometAPI に向けるだけで、AnythingLLM の UI やフローを変更せずに数百のモデルへ即時アクセス可能になります。

- コスト/運用最適化: CometAPI を使うことで、コスト管理のためにモデルを切り替えたり(より安価なモデルにダウンシフト)、複数プロバイダのキーを管理する代わりに請求を一元化できます。

- より速い検証: AnythingLLM の同一 UI 上で

gpt-4o、gpt-4.5、Claude 系やオープンソースのマルチモーダルモデルなどを A/B テストできます。エージェント、RAG 応答、要約、マルチモーダルタスクに有用です。

統合前に準備すべき環境と条件

システム/ソフトウェア要件(ハイレベル)

- AnythingLLM を実行するデスクトップまたはサーバー(Windows/macOS/Linux)— デスクトップ版またはセルフホスト環境。設定に LLM Preferences/AI Providers がある最新ビルドであることを確認してください。

- CometAPI のアカウントと API キー(

sk-xxxxx形式のシークレット)。AnythingLLM の Generic OpenAI プロバイダでこのシークレットを使用します。 - マシンから

https://api.cometapi.comへのネットワーク接続(アウトバウンド HTTPS をファイアウォールで遮断していないこと)。 - 任意(推奨):接続確認用の最新 Python または Node 環境(Python 3.10+ または Node 18+)、curl、および HTTP クライアント(Postman/HTTPie)を用意し、AnythingLLM へ接続する前に CometAPI の正常動作をサニティチェック。

AnythingLLM 固有の条件

OpenAI の API サーフェスを模倣するエンドポイント向けには Generic OpenAI LLM プロバイダが推奨です。AnythingLLM のドキュメントでは、このプロバイダは開発者向けであり、入力内容の理解が必要とされています。ストリーミングを利用する場合、またはエンドポイントがストリーミングをサポートしない場合は、Generic OpenAI 用にストリーミングを無効化する設定が AnythingLLM に用意されています。

セキュリティ/運用チェックリスト

- CometAPI キーは他のシークレット同様に扱ってください — リポジトリにコミットしないこと。可能なら OS のキーチェーンや環境変数に保存します。

- RAG で機密文書を使用する場合、エンドポイントのプライバシー保証がコンプライアンス要件に合致することを確認します(CometAPI のドキュメント/規約を参照)。

- 暴走コストを防ぐため、最大トークン数やコンテキストウィンドウの上限を決めておきます。

AnythingLLM を CometAPI で使うにはどう設定する?(ステップバイステップ)

以下に具体的な手順を示します。続いて、設定を保存する前に AnythingLLM に接続できるかを確認するための環境変数例とテスト用コード断片を示します。

Step 1 — CometAPI キーを取得

- CometAPI に登録またはサインインします。

- 「API Keys」へ移動してキーを生成します —

sk-xxxxxのような文字列が発行されます。厳重に保管してください。

Step 2 — クイックリクエストで CometAPI が動作するか検証

curl または Python で簡単な chat completion を呼び出し、接続性を確認します。

Curl の例

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

200 が返り、choices 配列を含む JSON 応答が得られれば、キーとネットワークは正常です。(CometAPI のドキュメントは OpenAI スタイルのサーフェスとエンドポイントを示しています)

Python の例(requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

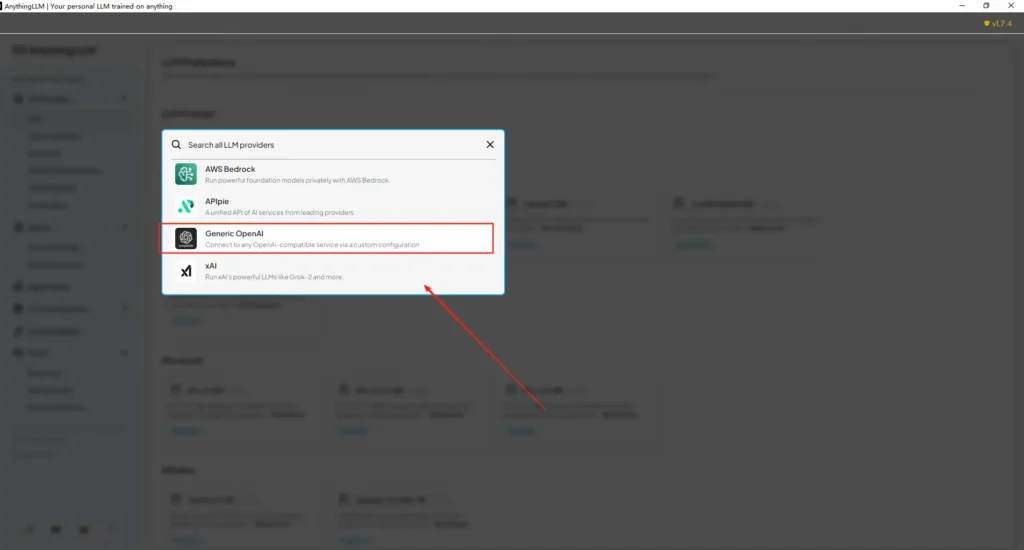

Step 3 — AnythingLLM を設定(UI)

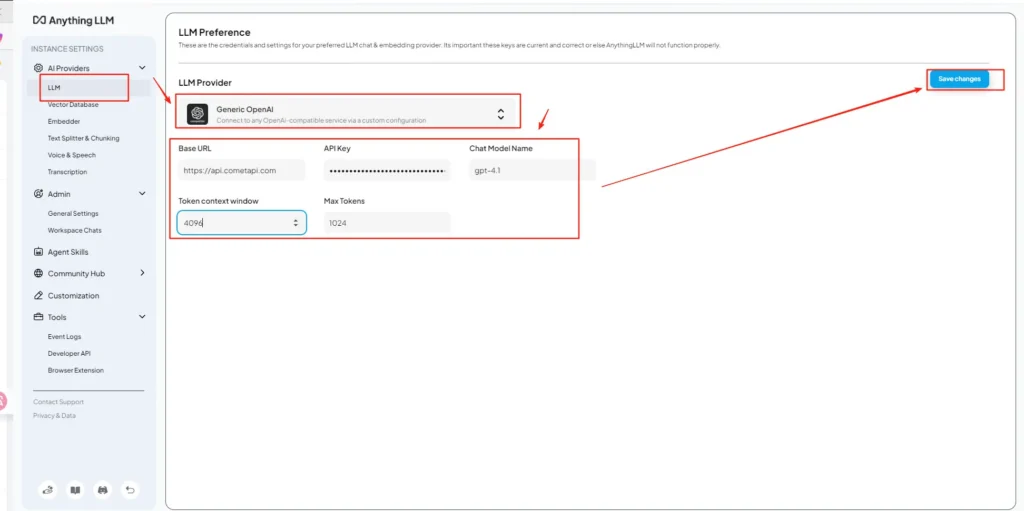

AnythingLLM を開く → Settings → AI Providers → LLM Preferences(バージョンにより表記は近似)。Generic OpenAI プロバイダを使用し、以下のように入力します。

API Configuration(例)

• AnythingLLM の設定メニューを開き、AI Providers 内の LLM Preferences を見つけます。

• モデルプロバイダに Generic OpenAI を選択し、URL フィールドにhttps://api.cometapi.com/v1を入力します。

• CometAPI のsk-xxxxxを API キー入力欄に貼り付けます。利用モデルに合わせて Token context window と Max Tokens を設定します。このページでgpt-4oなどのモデル名を追加・カスタマイズすることも可能です。

これは AnythingLLM の「Generic OpenAI」ガイダンス(開発者向けラッパー)と、CometAPI の OpenAI 互換ベース URL 方針に沿っています。

Step 4 — モデル名とトークン上限を設定

同じ設定画面で、CometAPI が公開しているモデル名(例:gpt-4o、minimax-m2、kimi-k2-thinking)を正確に追加/カスタマイズして、AnythingLLM の UI でそれらのモデルを選択できるようにします。各ベンダーのモデル文字列は CometAPI が公開しています。

Step 5 — AnythingLLM でテスト

新しいチャットを開始するか既存のワークスペースを使い、(複数プロバイダがある場合は)Generic OpenAI プロバイダを選択し、追加した CometAPI のモデル名を選んで簡単なプロンプトを実行します。首尾一貫した出力が得られれば、統合は完了です。

AnythingLLM が内部でこれらの設定をどう使うか

AnythingLLM の Generic OpenAI ラッパーは OpenAI スタイルのリクエスト(/v1/chat/completions、/v1/embeddings)を構築するため、ベース URL を指定して CometAPI キーを与えると、チャット、エージェント呼び出し、埋め込みのリクエストが透過的に CometAPI 経由でルーティングされます。AnythingLLM のエージェント(@agent フロー)を利用する場合も同じプロバイダ設定が継承されます。

ベストプラクティスと落とし穴

ベストプラクティス

- モデルに適したコンテキスト設定: AnythingLLM の Token Context Window と Max Tokens は、CometAPI 上で選択したモデルに合わせてください。不一致は予期しない切り捨てや失敗の原因になります。

- API キーの保護: CometAPI キーは環境変数や Kubernetes/シークレットマネージャに保存し、git にコミットしないでください。UI にキーを入力した場合、AnythingLLM はローカル設定に保存するため、ホストストレージは機密として扱ってください。

- 実験には小型/低コストモデルから: 検証段階では CometAPI で安価なモデルを試し、本番ではプレミアムモデルを使用します。CometAPI はコスト切り替えと一元課金を明確に打ち出しています。

- 利用状況の監視とアラート設定: CometAPI の利用状況ダッシュボードで予算やアラートを設定し、想定外の請求を防ぎます。

- エージェントやツールは分離してテスト: AnythingLLM のエージェントはアクションを実行可能です。安全なプロンプトで、まずステージング環境で検証してください。

よくある落とし穴

- UI と

.envの競合: セルフホスト時、UI 設定が.env変更を上書きする(またはその逆)ことがあります。再起動後に設定が戻る場合は生成された/app/server/.envを確認してください。コミュニティではLLM_PROVIDERリセットの報告があります。 - モデル名の不一致: CometAPI で提供されていないモデル名を使うと、ゲートウェイから 400/404 が返ります。CometAPI のモデル一覧で常に確認してください。

- トークン上限とストリーミング: ストリーミング応答が必要な場合、CometAPI 側のモデルがストリーミングに対応しているか(および利用中の AnythingLLM の UI バージョンが対応しているか)を確認してください。プロバイダによりストリーミングの挙動が異なることがあります。

この統合で実現できる実用ユースケース

Retrieval-Augmented Generation(RAG)

AnythingLLM のドキュメントローダー+ベクタ DB と CometAPI の LLM を組み合わせ、コンテキストに即した回答を生成します。埋め込みに安価なモデル、チャットに高価なモデルを使い分けたり、すべてを CometAPI にまとめて請求を一元化したりできます。RAG フローは AnythingLLM の主要機能です。

エージェント自動化

AnythingLLM は @agent ワークフロー(ページの閲覧、ツール呼び出し、オートメーション実行)をサポートします。エージェントの LLM 呼び出しを CometAPI 経由にすることで、制御/解釈ステップのモデル選択をコード変更なしで柔軟に行えます。

複数モデルの A/B テストとコスト最適化

ワークスペースや機能ごとにモデルを切り替えます(例:本番回答には gpt-4o、開発には gpt-4o-mini)。CometAPI によりモデル交換が容易になり、コストが一元管理できます。

マルチモーダルパイプライン

CometAPI は画像、音声、特化型モデルを提供します。AnythingLLM のプロバイダ経由のマルチモーダル対応と CometAPI のモデルを組み合わせ、画像キャプション、マルチモーダル要約、音声文字起こしといった処理を同一インターフェースで実現できます。

結論

CometAPI は(500+ モデル、OpenAI スタイル API)というマルチモデルのゲートウェイとしての立ち位置を強化し続けており、Generic OpenAI プロバイダをサポートする AnythingLLM のようなアプリにとって自然なパートナーです。同様に、AnythingLLM の Generic プロバイダと最近の設定オプションにより、こうしたゲートウェイとの接続は容易になっています。この収斂によって、2025 年後半の実験や本番移行が単純化されます。

Comet API をはじめるには

CometAPI は、OpenAI の GPT シリーズ、Google の Gemini、Anthropic の Claude、Midjourney、Suno など主要プロバイダの 500 以上の AI モデルを、開発者に優しい単一のインターフェースへ集約した統合 API プラットフォームです。認証、リクエスト形式、レスポンス処理を一貫化することで、アプリケーションへの AI 機能統合を大幅に簡素化します。チャットボット、画像生成、音楽生成、データ駆動の分析パイプラインなど、どのようなユースケースでも、CometAPI を使えば検証を加速し、コストを制御し、ベンダーロックインを回避しながら、AI エコシステムの最新成果を活用できます。

開始するには、CometAPI のモデル機能をPlaygroundで試し、詳細は API ガイドをご参照ください。アクセス前に CometAPI にログインし、API キーを取得していることを確認してください。CometAPI は公式価格を大幅に下回る料金で、統合を支援します。

準備はできましたか?→ 今すぐ CometAPI にサインアップ!