2026年2月5日、AnthropicはClaudeファミリーの最新フラッグシップであるClaude Opus 4.6を発表しました。Opus 4.6は長期的な知識作業とエージェント型ソフトウェアワークフローに一層注力しており、ベータ版の1,000,000トークンコンテキストウィンドウ、Agent Teamsと呼ばれる洗練されたマルチエージェント協調、effort制御によって動作する適応型推論システム(Adaptive Thinking)を搭載しています。モデルはClaude Developer PlatformおよびサードパーティのアグリゲーターAPI(例:CometAPI)から提供され、多くのClaudeユースケースに対するドロップインのアップグレードとして提案されています。

Claude Opus 4.6とは

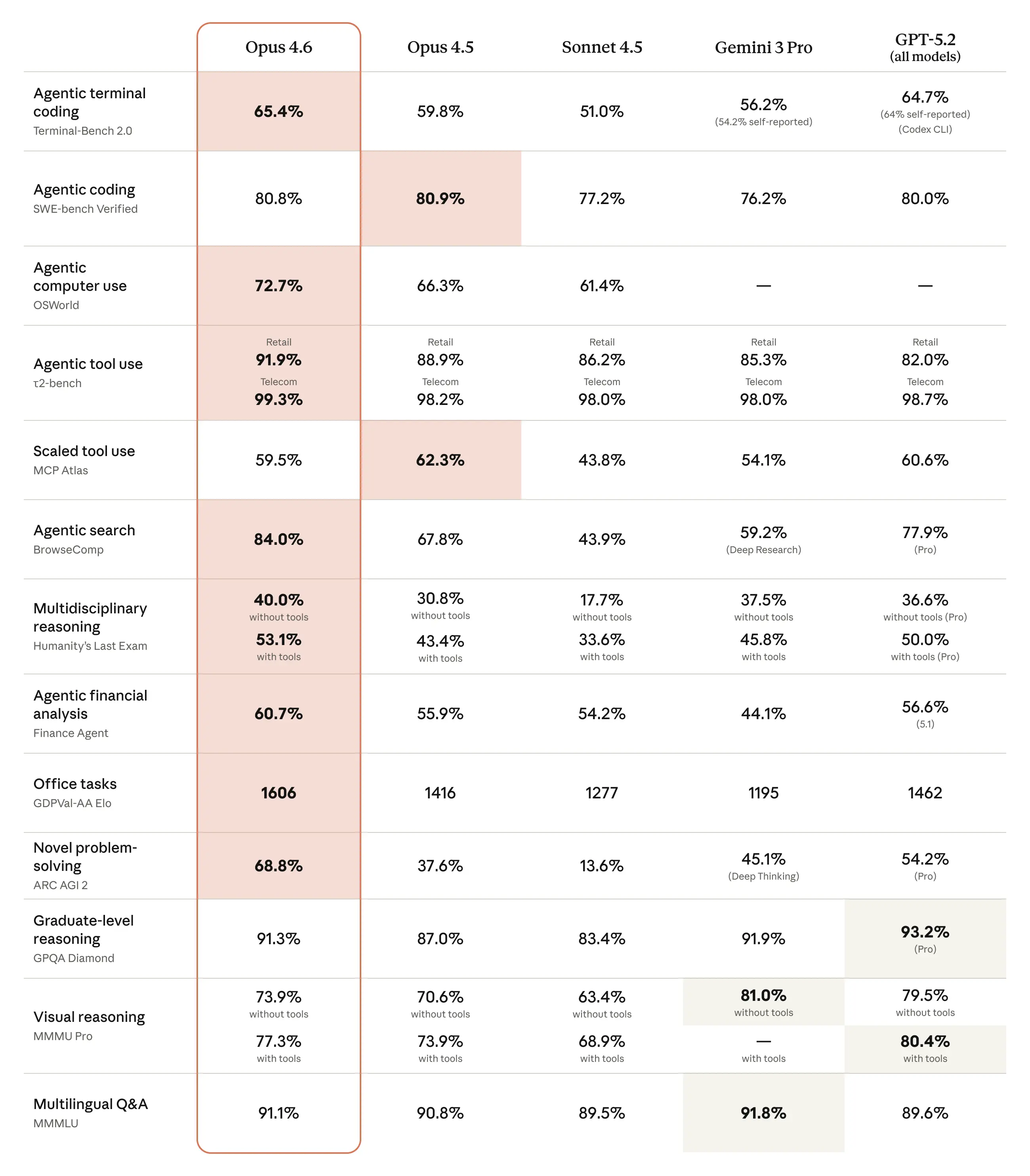

Claude Opus 4.6はAnthropicの最新のOpusクラスモデルで、コーディング、エージェント型ワークフロー、長コンテキスト推論においてこれまでで最も高い能力を持つモデルとして位置付けられています。このリリースは、長期間にわたる「エージェント型」タスク(段階的なコード移行、複数ファイルのリファクタ、協調するリサーチエージェントなど)、大規模ドキュメント処理、エンタープライズ統合を優先しています。AnthropicはOpus 4.6を4.5からほぼドロップインで置き換え可能だと説明していますが、実装者にとって重要な挙動や能力の変更がいくつか存在します。

Claude Opus 4.6の主要機能(すぐに把握しておきたいポイント)

- 1Mトークンのコンテキストウィンドウ(ベータ): Opus 4.6は非常に大きなコンテキストウィンドウを導入(Anthropicによりベータ提供)し、単一セッションで極めて大きな文書やコードベース全体を参照・推論できるようにします。これにより、リポジトリ全体のリファクタ、長文の法務レビュー、複数文書の統合などの作業が格段に実用的になります。

- Agent Teams: Opus 4.6はエージェント機能を拡張し、協調するエージェント群(Agent Teams)— 異なるサブタスクで並行作業し状態を共有する複数のClaudeエージェント — を実現します。これにより、難しい問題を分解し(例:テスト作成に専念するエージェント、リファクタに専念するエージェント、QAに専念するエージェント)、出力を調整できるよう設計されています。

- Adaptive Thinking(effortレベル): 二値的な「thinking」トグルではなく、Opus 4.6は複数のeffortレベル(例:low/medium/high/max)を公開し、レイテンシとコストを、より深い思考連鎖と熟慮的な推論と引き換えに調整できます。Anthropicは長い会話を効率的に管理するためのコンテキスト圧縮などの制御機構も公開しています。

- 128Kの出力トークン予算: Opus 4.6は以前の最大出力予算を倍増(64K → 128K)し、モデルが途切れずにより長く持続する出力を提供可能にします — 複数パートのレポートや多数ファイルに及ぶコード生成に有用です。このような大容量の出力にはストリーミングが推奨されます。

その他の実務的な改善点として、コーディングとデバッグ能力の向上、エンタープライズや統合ワークフロー向けのモード/優先度オプションが含まれます(GitHub CopilotなどでのCopilot統合はすでに展開が進んでいます)。

これらの機能が重要な理由(クイックテイク)

- 1Mトークンウィンドウにより、繰り返しの検索サイクルや多くの文書を複数回の呼び出しに分割して繋ぎ合わせる必要が減ります — 単一の呼び出しにより多くのコンテキストを保持でき、知識集約型ワークフローのアプリケーションロジックが簡素化されます。

- Agent Teamsはアーキテクチャを変えます:単一のモノリシックなアシスタントではなく、協調する小さな専門エージェントを設計します — 並列化が容易になり、責任範囲が明確になり、複雑なタスクで信頼性が向上する可能性があります。

- Adaptive Thinkingは、時間と品質のトレードオフに対する予測可能な調整ノブを提供します。レイテンシ、決定性、コストが制約となる本番システムにとって不可欠です。

CometAPI経由でClaude Opus 4.6を呼び出す方法 — ステップバイステップ

CometAPIを使ってOpus 4.6を呼び出す

多くのチームは(ベンダーをまたいでクライアントコードを正規化したい場合に)統一されたマルチモデルゲートウェイを好みます。CometAPIはその一つで、単一のOpenAI互換インターフェースで多くのベンダーモデルを公開しています。また、Anthropicのメッセージ形式も提供されます(AnthropicのAPI固有の圧縮機能が必要で、CometAPI経由でClaude Codeを利用したい場合)。以下の例は本番利用のパターンを示します:認証、モデルの選択、長コンテキスト機能の有効化、ストリーミング、コスト制御。(Cometがモデル識別子を変更した場合は、プロバイダーのモデルレジストリに合わせて名前やヘッダーを調整してください。)

はじめに(開発者チェックリスト)

- CometAPIに登録し、

COMET_API_KEYを取得、クライアントのbase_urlをhttps://api.cometapi.com/v1に設定します(CometはOpenAI互換のクライアントとサンプルを提供)。Cometのコンソールには利用可能なモデルと、プロバイダー固有のフラグが掲載されています。 - 事前に能力設定を決める:

thinking: {type: "adaptive"}、output_config.effortレベル、max_tokens(出力予算)、大きな出力のためのストリーミング、そしてコンテキスト圧縮の使用有無。

Claude API(Python風の疑似コード):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

CometAPI経由(OpenAI互換シムの例):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

注: CometAPIのラッパーにおけるパラメータ名はSDKにより異なります。CometAPIはシンプルな統合モデルを文書化しており、一般的に

model="claude-opus-4-6"をサポートします。正確なフィールドマッピングや必要なリクエスト形式の調整についてはCometAPIのドキュメントを確認してください。

ベストプラクティスと使い方

Agent Teams:設計パターンと短いレシピ

Agent Teamsを使うべき場面: 大規模コードベースのリファクタ、複数段階のドキュメント処理、自然に専門エージェントへと分割できるワークフロー(例:設計者、実装者、レビュー担当)。

シンプルなAgent Teamsパターン:

- オーケストレーターエージェントが全体タスクを受け取り、サブタスクに分割します。

- ワーカーエージェント(各Claudeインスタンス)を、焦点化されたプロンプトと明確な成功基準で起動します。

- 並列処理:ワーカーは独立したコンテキストで並行して実行し、結果をオーケストレーターへ返します。

- マージ&レビュー:オーケストレーターが出力をコンパクト化し、統合パスと最終の安全性/レビュー確認を実施します(必要に応じて最終パスで

effort=maxを使用)。

実践的なヒント:

- 各サブエージェントに厳格なシステムプロンプトを与え、

max_tokensを制限して暴走コストを防ぎます。 - 並列呼び出しとリトライを管理するためにCometAPIやオーケストレーションフレームワークを利用します。

- オーケストレーターの履歴にはコンテキスト圧縮を使い、重要な決定事項を保持しつつ、全文の逐語的履歴に対するコストを避けます。

コンテキスト管理:大規模入力と1Mトークンウィンドウの扱い

- 構造化インジェストを優先:文書をセグメント化された断片(文書メタデータ+コンテンツブロック)として投入します。アンカーポイント(タイトル、インデックス)を保持し、ソースはインデックスで引用させます。生ファイルの貼り付けより堅牢です。

- 長い対話セッションにはコンテキスト圧縮(利用可能な場合)を使用:過去のやり取りを要約させ、重要な事実を保持しつつトークン予算の枯渇を避けます。Anthropicは圧縮をベータ機能として提供しています。

- 決定的な再現性が必要な場合、正準アーティファクトを自前のDBに保存し、IDで参照します。各ステップで必要な部分のみをモデルに要約・抽出させて利用します。

コスト、レイテンシ、品質のトレードオフ — effortなどのノブの使い方

- Effort:コストと能力のバランスをとる最も効果的な制御です。本番では効率重視の

mediumを基準に、監査や最終レビュー、複雑な統合など重要局面でhighやmaxに引き上げます。lowは日常的な検索や短いQ&Aに有用です。多くのチームが、デフォルトをmediumにして必要時のみeffortを引き上げることで優れたコスト削減を報告しています。 - バッチ処理とキャッシュ:繰り返しの質問にはプロンプトキャッシュを活用し、多数の小規模で類似タスクにはバッチ処理を利用してトークン再投入コストを削減します。Anthropicのプラットフォームやサードパーティはキャッシュ/バッチモードをサポートしています。

- ストリーミングとチャンク化出力:非常に大きな出力(長いコード生成、書籍の草稿)を要求する場合、ストリーミングを使ってメモリ負荷を軽減し、早期の受け入れ/中止を可能にします。

最後に — Opus 4.6が開発者の設計判断をどう変えるか

Opus 4.6は、多くの短いリクエストをつなぎ合わせることなく、大規模で耐久性のあるエージェント型ワークフローを構築する方向へ明確に歩を進めています。1MトークンウィンドウとAgent Teamsは(大規模コードベースの自動化、長文の法務/財務レビュー、複数文書のリサーチアシスタントなど)新しいクラスのアプリケーションを解放しますが、同時に設計の重点をプロンプトエンジニアリングの微調整からシステム設計へとシフトさせます:アーティファクトの保存方法、専門家のオーケストレーション、コストの測定と抑制、エージェント行動の監視などです。

開発者はOpus 4.6にCometAPI経由で今すぐアクセスできます。始めるには、Playgroundでモデルの機能を試し、詳細な手順についてはAPI guideを参照してください。アクセス前に、CometAPIにログインしAPIキーを取得していることを確認してください。CometAPIは統合を支援するために公式価格よりかなり低い価格を提供しています。

準備はできましたか?→ 今すぐ openclaw に登録 !

.png&w=3840&q=75)