MiniMax-M2.5 は、生産性に焦点を当てた MiniMax の新しい大規模言語モデルで、コーディング、エージェント的なツール利用、オフィス系ワークフローに最適化されています。ネイティブの MiniMax プラットフォームで呼び出すことも、CometAPI などの API アグリゲーター経由で呼び出すこともできます。API を利用するには CometAPI の API キーを取得するだけで十分で、Minimax-M2.5 はチャット形式にも対応しています。

MiniMax-M2.5 とは?

MiniMax-M2.5 は MiniMax による最新のメジャーリリースで、M2 ファミリーの進化版です。同社はこれを汎用かつエージェント対応のモデルとして位置づけ、特にコード生成、ツール利用、マルチステップ推論に強みがあるとしています。M2.5 ファミリーは 2026年2月のリリースとして発表され、標準版 M2.5 と、同等の中核機能を維持しつつレイテンシを低減した “highspeed” 版を含みます。M2.5 ファミリーは、ソフトウェアエンジニアリング評価におけるベンチマークスコアと、外部ツール(検索、エージェントなど)との対話時の挙動を改善しています。

ベンダーは M2.5 を、従来の M2.x リリースからのステップアップとして位置づけ、より強力な推論能力、より良いコード生成、そして改良されたツール呼び出しの信頼性を強調しています。2026年2月上旬の MiniMax による公開リリースノートでは、M2.5 をマイルストーンと位置づけ、指示チューニングの洗練、コード理解の強化、複数のコード中心ベンチマークでの測定可能な向上を示しています。リリースには以下が含まれます。

- 標準の M2.5 モデル(正確性と推論を重視)。

- インタラクティブな開発者ワークフロー向けに低レイテンシ化した M2.5-highspeed 版。

- 大量のコード生成用途を想定した「Coding Plan」に関する明確なガイダンスと課金オプション。

主要な技術ハイライト

- アーキテクチャ: MoE(総パラメータ数は大きいが推論時に有効化される集合ははるかに小さい)により、ヘビーなタスクでコスト/性能のスイートスポットを実現。

- 強み: 最先端のコーディング性能、マルチターン推論、長文脈対応、エージェント/ツール統合。

- バリエーション: スループットとレイテンシのトレードオフに合わせて調整された派生(例:

MiniMax-M2.5とM2.5-highspeed)を提供。

なぜ今重要か: 開発者ツール、プログラミングアシスタント、エージェント的自動化を構築する多くのチームにとって、複数ターンにわたり推論し、安全にツールを呼び出し、高品質なコードを出力できるモデルは価値があります。M2.5 は、アーキテクチャと学習の選択により、まさにそのシナリオを想定してマーケティングされています。

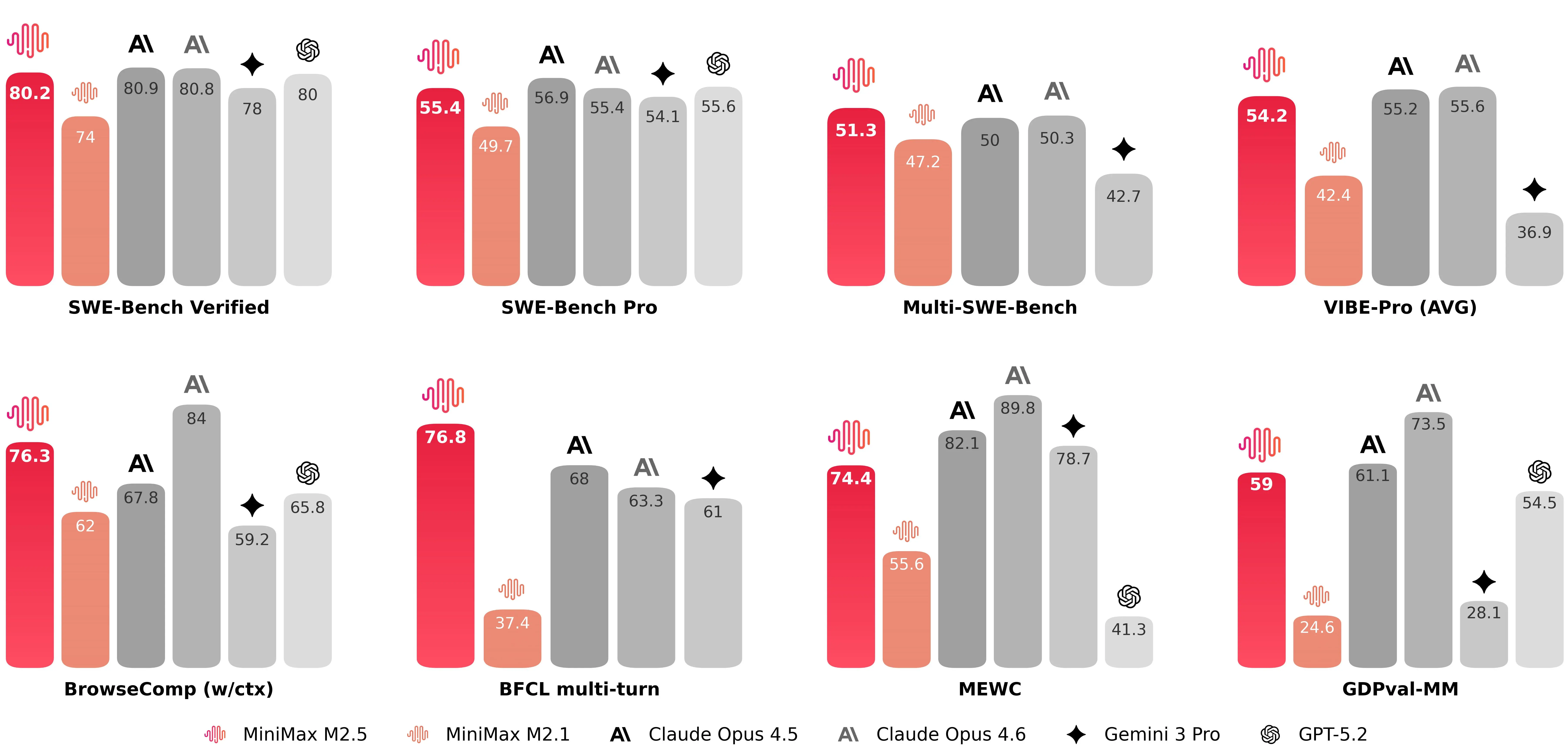

MiniMax-M2.5 のベンチマーク

コーディング特化ベンチマークでの位置づけ

MiniMax-M2.5 は SWE-Bench Verified で 80.2% を記録し、マルチタスク・コーディングやブラウジング拡張ベンチマークでも強い評価を得ています(同社の公表値として、Multi-SWE-Bench で 51.3%、コンテキスト管理有効時の BrowseComp で 76.3% など)。これらの数値は、ローンチ時点でのコード生成と問題解決において、M2.5 が一般に利用可能な最高水準のモデル群に位置づけられることを示しています。MiniMax-M2.5 のローンチは、M2.5 がトップティアのコーディングモデルと競合していることを裏付けています。

開発者にとっての利点は主に二点あります。

- 初回成功率の向上: 修正の反復が減り、人手によるデバッグも少なく、自律的なコーディングエージェントに対する過度な監視の負担が軽減。

- フルスタックのカバレッジ向上: M2.5 はデスクトップ、モバイル、クロスプラットフォームのツールチェーンにまたがるフルスタック・ワークフローをサポートするとされ、スニペットにとどまらず、複数ファイルにまたがる一貫したソリューションやビルドスクリプトの生成を目指しています。

エージェント的ワークフロー向けに設計

M2.5 は「エージェント・シナリオ向けにネイティブ設計」されたと説明されています。実際には、アーキテクチャとトレーニング体系が次を優先します。

- ツール呼び出しの忠実性: API 呼び出しや shell/SQL コマンドを、構文やパラメータを含め正確に発行。

- コンテキスト切り替えとメモリ: 中断されたマルチステップ処理を、既に計算済みの状態を失わずに継続。

- ファイル操作: 一般的なオフィス形式をプログラム的に生成・編集(例: PowerPoint を生成し、その後のリクエストに基づいて修正)。

検索・ブラウジングの拡張

M2.5 をブラウジングやリトリーバル層と組み合わせると、ブラウジング系ベンチマークのスコアが大幅に向上したと MiniMax は報告しています。これは、外部情報や引用を出力に統合する性能が強化されたことを反映しています。これにより、最新情報の取得、API 結果のクロスチェック、実データでのコード生成の補強(例: 最新の SDK ドキュメントを取得し、コード生成時に正しく利用)を要するツールに適しています。こうした能力は、自動 QA、CI ツールチェーン、ドキュメント駆動型アシスタントといった「エージェント的」機能を構築するチームにとって重要です。

MiniMax-2.5 API(CometAPI 経由)の利用方法

CometAPI は、単一の OpenAI 互換 REST インターフェースで数百のモデルを提供する API 集約プラットフォームです。CometAPI のインターフェースは OpenAI の chat/completions エンドポイントを模しているため、api_base と API キーを切り替えるだけで、既存の OpenAI 風クライアントをそのまま再利用できることが多いです。統一課金、マルチモデルの A/B テスト、ベンダーの抽象化などの理由で MiniMax のプラットフォームへ直接統合したくない場合でも、CometAPI の “chat” インターフェースを通じて MiniMax-M2.5 を呼び出せます。CometAPI プラットフォームは一貫したリクエスト形式、SDK、Web のプレイグラウンドを提供し、モデルごとの名称とパラメータを公開しています(呼び出し時にプロバイダ/モデル文字列を正確に選択)。

以下は、CometAPI 経由で MiniMax-M2.5 を呼び出すための、簡潔かつ実用的なガイドです(curl と Python の例付き)。

基本的な開始手順は?

- CometAPI アカウントにサインアップして API キーを取得します。(CometAPI にはプレイグラウンドと SDK があり、モデルを試せます。)

- CometAPI のモデル一覧または CometAPI のプレイグラウンドで、MiniMax-M2.5 の正確なモデル名を確認します。

modelパラメータに選択した MiniMax モデルを設定し、CometAPI の chat/completion スキーマに従ったペイロードで、認証付き POST リクエストを送信します。- ワークフローに応じてパラメータ(temperature、max_tokens、system メッセージ、ストリーミング)を調整します。

認証とエンドポイントの基本

- Base URL:

https://api.cometapi.com/v1(/chat/completionsなど OpenAI 風のパスに対応) - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Model フィールド: CometAPI のモデルカタログに記載の正確なモデル文字列を使用(例:

"minimax-m2.5")

例1 — 手早い curl(REST、OpenAI 風)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: "application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

注意:

- CometAPI のカタログに記載されたモデル文字列をそのまま使用してください。

stream: trueにするとストリーミング出力に対応します(部分トークンを受け取る場合は SSE やチャンク応答の処理が必要)。

例2 — Python(requests)でのチャット補完

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

例3 — litellm / CometAPI 統合(Python 向けの簡便レイヤー)

CometAPI は複数のコミュニティ製 SDK やアダプタでサポートされています。liteLLM のドキュメントでは、COMETAPI_KEY を設定し、モデル名で呼び出す簡潔なフローが紹介されています。プロトタイピングに最適です。

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

LiteLLM / Comet の統合は、(ストリーミング、非同期、明示的な api_key パラメータなど)多くの既存の OpenAI SDK パターンに似た便利機能を提供します。

M2.5 向けのプロンプトとシステムメッセージ設計

役割と制約を明確に

コードを依頼する際は、M2.5 に明確なシステムロールを与えましょう。例:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

複雑な課題にはステップ分解を

M2.5 に複雑な機能実装を依頼する際は、短い分解を使います。

- まず設計アウトラインを依頼する。

- インターフェースのシグネチャを依頼する。

- 実装とテストを依頼する。

これにより幻覚のリスクが下がり、モジュール化されレビューしやすい成果が得られます。

Temperature、max_tokens と安全性

- 決定的なコードが欲しい場合は、

temperatureを 0.0 に近づけます。 - 探索的な設計には、

temperatureを 0.2–0.5 に設定すると創造的なアプローチが出やすくなります。 - 大規模なリファクタや長いテストスイートには、

max_tokensを十分に確保します。

単体テストと根拠説明も依頼

コードを依頼する際は、ユニットテストとアルゴリズムの簡単な説明も求めましょう。微妙なバグの検出や、初回から実行可能な成果物の取得に役立ちます。

長時間タスク推論と状態トラッキング

M2.5 は優れた状態トラッキング機構を備え、すべてを並列で処理するのではなく、各タイミングで限られた目的に集中することで、長時間の思考の連続性と方向性を効果的に維持します。M2.5 はコンテキスト認識機能を備え、効率的なタスク実行と最適化されたコンテキスト管理を可能にします。

本番利用のための M2.5 実践ヒント

MiniMax-M2.5 は、マルチステップのツール連携とコードに特化してチューニングされています。以下は、本番で最良の結果を得るための実践的なヒントです。

プロンプトエンジニアリング & システムメッセージ

- 役割と制約をシステムメッセージで明示します。コードタスクでは、必要なランタイムやテストフレームワーク(例: 「Python 3.11 で動作する pytest を返す」)を含めます。

- 文脈を与える: エージェント的/マルチステップのジョブでは、ステップのメタデータやツールの説明を構造化 JSON や箇条書きで渡します。M2.5 はツール利用に最適化されているため、構造化入力に良く反応します。

関数/ツール呼び出し

- CometAPI をツール呼び出しのゲートウェイとして使う場合は、追加フィールド(OpenAI 形式の

function_callなど)が CometAPI/モデルの期待と一致していることを確認します。ツールのセマンティクスはプロバイダにより異なる場合があるため、Comet のモデルページでサポート状況を確認してください。 - 堅牢なオーケストレーションのために、大きなタスクは小さく分割し、決定的なチェックポイントを維持します。M2.5 はマルチステップ指示に強いものの、各ステップで検証するとより信頼性が高まります。

Temperature、max_tokens とコスト管理

- コード生成やリファクタリングでは、

temperatureを低く(0.0–0.2)設定し、出力規模に合わせてmax_tokensを調整します。 - 探索的なプロンプトでは

temperatureを上げてもよいですが、トークン消費の増加に注意します。CometAPI 経由でルーティングする場合は、プロバイダごとの価格とフォールバックルールを比較してください。CometAPI のカタログにはモデルごとのトークン単価が掲載されています。

コンテキストウィンドウと長文ドキュメント

- M2.5 の派生モデルは長いコンテキストに対応することが多いですが(対応長はモデル仕様を確認)、非常に長いドキュメントでは分割と要約を行い、要約と関連チャンクのみを投入する方が効果的です。

セーフティ、有害コンテンツ、幻覚の抑制

- ガードレールを設定: システムメッセージ、外部バリデータ、テストスイート(例: 生成コードのユニットテスト)でリスクを低減します。

- 外部参照の検証: モデルがウェブの事実やコードを引用する場合は、信頼・出荷前にプログラム的に検証します。

よくある落とし穴と回避策

落とし穴: 単一のモデル出力を過信する

回避策: テストや静的解析を実行し、重要なロジックでは複数の独立した出力を生成して比較します。CometAPI では複数モデルの切り替えが可能で、OpenAI のチャット形式を用いていつでもモデルを切り替えられます。

落とし穴: 本番コードで高い temperature を使う

回避策: temperature は低く保ちます。創造的な代替案が必要な場合は、低温度で複数案を生成するか、差分の説明をモデルに求めます。

落とし穴: モデルのバージョニングを無視する

回避策: デプロイのマニフェストでモデル名とプロバイダ文字列を追跡します。MiniMax-M2.5 から MiniMax-M2.5-highspeed、または別プロバイダに切り替える場合は、リリース変更として扱い、回帰テストを実施します。

最終的な推奨事項と現実的な期待値

MiniMax-M2.5 はコード中心かつエージェント対応の LLM として大きく前進しており、強力なコード生成、マルチターン推論、ツールに安全な挙動を約束します。堅牢な開発者ツール、エージェントフレームワーク、コードアシスタントの構築が優先事項であれば、比較対象として M2.5 を検討する価値があります。CometAPI を統一ゲートウェイとして使えば、実験を加速し、統合を大きく変更せずにプロバイダやモデルの A/B を切り替えられます。

実践的な要点:

- まず CometAPI のプレイグラウンドで素早く試作し、その後コード内でモデル識別子を固定します。

- 低温度を用い、テストと説明を依頼し、自動検証を必ず実行します。

- モデルを強力な共同開発者として扱い、決して万能とは見なさないこと。人的レビュー、CI パイプライン、テレメトリを適用しましょう。

開発者は MInimax-M2.5 を CometAPI 経由で今すぐ利用できます。まずは Playground でモデルの能力を試し、詳細は API guide を参照してください。アクセス前に、CometAPI にログインして API キーを取得していることを確認してください。CometAPI は公式価格よりもはるかに低い価格を提供しており、統合を支援します。

Ready to Go?→ Sign up fo M2.5 today