急速に進化する人工知能(AI)分野において、堅牢なAIアプリケーションを開発するには、プラットフォームとモデルの相乗効果が不可欠です。オープンソースのLLM(大規模言語モデル)アプリケーション開発プラットフォームであるDifyは、CometAPIの強力なモデルとのシームレスな統合機能を提供します。この記事では、Difyの機能、CometAPIとの統合プロセス、そしてこの連携の活用と最適化に関する洞察を紹介します。

Dify を CometAPI と統合する理由

Dify と CometAPI を統合すると、両方のプラットフォームの長所が組み合わされ、開発者は次のことが可能になります。

- 高度な言語モデルを活用する: Dify の直感的なインターフェースに統合された の LLM モデルを活用します。

- AIアプリケーション開発を効率化: Dify の包括的なツールと CometAPI の機能を活用して、プロトタイプから生産への移行を加速します。

- AIソリューションのカスタマイズと制御データとワークフローの制御を維持しながら、AI アプリケーションを特定のニーズに合わせてカスタマイズします。

CometAPI とは何ですか?

CometAPIは、OpenAIのGPTシリーズ、GoogleのGemini、AnthropicのClaude、Midjourney、Sunoなど、主要プロバイダーの500以上のAIモデルを、開発者にとって使いやすい単一のインターフェースに統合する統合APIプラットフォームです。一貫した認証、リクエストフォーマット、レスポンス処理を提供することで、CometAPIはAI機能をアプリケーションに統合することを劇的に簡素化します。チャットボット、画像ジェネレーター、音楽作曲ツール、データドリブン分析パイプラインなど、どのようなアプリケーションを構築する場合でも、CometAPIを利用することで、反復処理を高速化し、コストを抑え、ベンダーに依存しない環境を実現できます。同時に、AIエコシステム全体の最新のブレークスルーを活用できます。

Difyとは何ですか?

ディファイ は、大規模言語モデルを活用したAIアプリケーションの開発を簡素化するために設計されたオープンソースプラットフォームです。AIワークフロー、検索拡張生成(RAG)パイプライン、エージェント機能、モデル管理、可観測性機能など、様々な機能を統合し、構想から実装までシームレスなプロセスを実現します。

Difyの主な機能

- 直感的なインターフェイスDify は、AI アプリケーションの作成と管理を簡素化するユーザーフレンドリーなインターフェースを提供します。

- 包括的なモデルサポート: 多数の独自およびオープンソースの LLM との統合をサポートします。

- プロンプトIDEDify は、プロンプトの作成とテスト、モデルのパフォーマンスの比較、アプリケーションのインタラクションの強化のためのツールを提供します。

- RAGパイプライン: このプラットフォームには、ドキュメントの取り込みと取得のための強力な RAG パイプラインが含まれており、PDF や PPT などのさまざまな形式をサポートしています。

- エージェントフレームワークDify を使用すると、事前に構築されたツールやカスタム ツールを使用してエージェントを定義できるため、AI アプリケーションの機能が拡張されます。

- LLMOps: アプリケーション ログとパフォーマンスを観察し、継続的な改善を支援する監視および分析ツールを提供します。

- バックエンド・アズ・ア・サービスDify はすべての機能に対応する API を提供し、既存のビジネス ロジックへの統合を容易にします。

Dify はどのように機能しますか?

Dify は、開発者が AI アプリケーションを構築、テスト、展開できる構造化された環境を提供することで機能します。そのアーキテクチャはさまざまな言語モデルの統合をサポートし、アプリケーション開発における柔軟性とカスタマイズを可能にします。

Difyのワークフロー

- モデルの統合: OpenAIのAPIと互換性のある言語モデルを接続して設定します。(または他の ディープシークR1API, グロク4、ラマモデル、ゲイミンモデルなど)

- プロンプトエンジニアリング: Dify の Prompt IDE を使用してプロンプトを開発および調整し、目的の出力を実現します。

- アプリケーション開発: Dify のツールを活用して、必要に応じてワークフロー、エージェント、RAG パイプラインを組み込んだアプリケーションを作成します。

- テストと最適化: Dify 内でアプリケーションをテストし、パフォーマンス ログを分析して、必要な調整を行います。

- 展開: Dify のバックエンド サービスと API を活用してアプリケーションをデプロイし、より広範なシステムに統合します。

Dify を CometAPI と統合するにはどうすればいいですか?

Dify と CometAPI を統合するには、プラットフォーム間のシームレスな接続を確保するためにいくつかの重要な手順が必要です。

以下は、CometAPIノード(プラグイン)のインストールとDifyフローへの接続の両方をカバーする実用的なワークフローです。UIラベルは変更される可能性がありますが、これらの手順はDifyとFlowiseで現在使用されているプラグイン/マーケットプレイス+モデルプロバイダーのパターンを反映しています。

ステップ1 - CometAPIキーを取得する

- サインアップまたはサインイン CometAPIコンソール.

- APIキーページを作成または移動して、

sk-xxxxx使用するプロジェクトのキーです。次の手順で使用するために安全に保管してください。

ステップ2 — DifyにCometAPIプラグインをインストールする

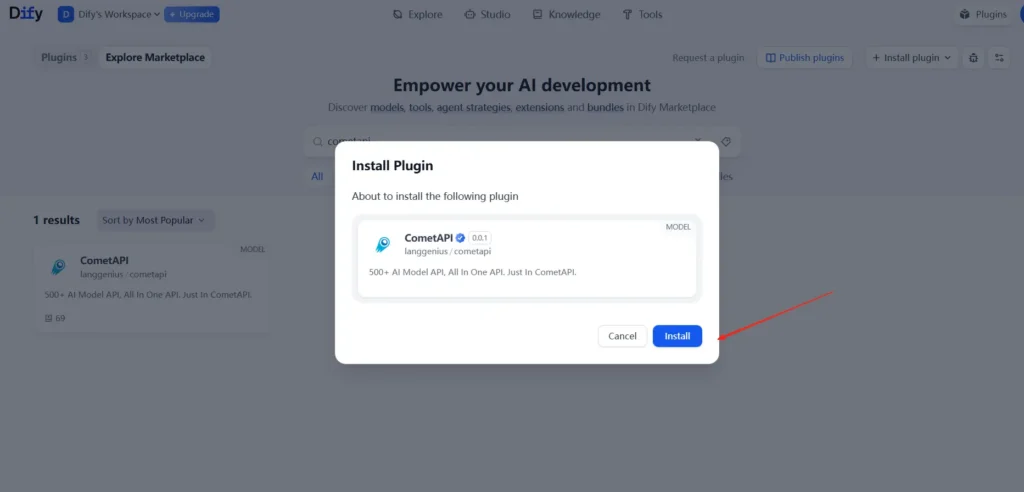

- Difyでは、 マーケットプレイス or プラグイン セクション (Dify のプラグイン マーケットプレイスは、サードパーティ統合のエントリ ポイントです)。

- もう完成させ、ワークスペースに掲示しましたか? コメットAPI (または「Comet」/「CometAPI」プロバイダー)をクリックし、 インストールを開始する.

- インストール後、Dify 内で CometAPI のプラグイン構成/設定を開きます。

注意: Dify のデプロイメントが自己ホストされている場合、プラグインを追加するには管理者権限が必要になる場合があります。

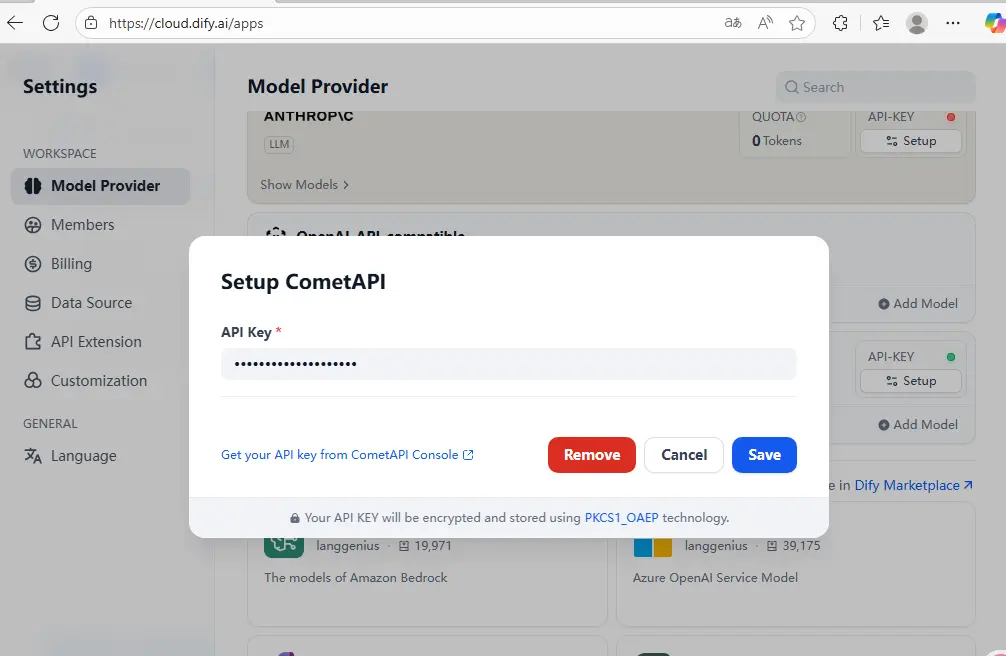

ステップ3 - DifyでCometAPIプラグインを設定する

- プラグインの設定で、

sk-xxxxxAPIキー APIキー / 秘密 フィールド。 - 必要に応じて、プラグインが要求するデフォルトのモデルまたはプロバイダー オプションを設定します (たとえば、デフォルトのモデル ファミリを選択できます)。

- プラグインの設定を保存します。これで、Dify はモデル推論のために CometAPI を呼び出せるようになります。(Dify にテスト呼び出しボタンがある場合は、接続を確認するために小さなテストリクエストを実行してください。)

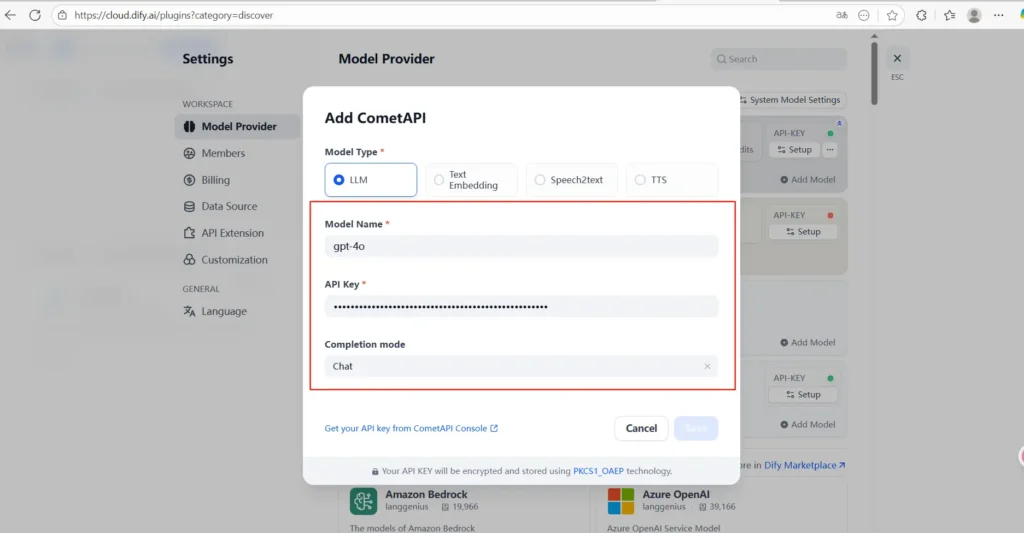

ステップ4 - DifyフローにCometAPIをモデルプロバイダーとして追加する

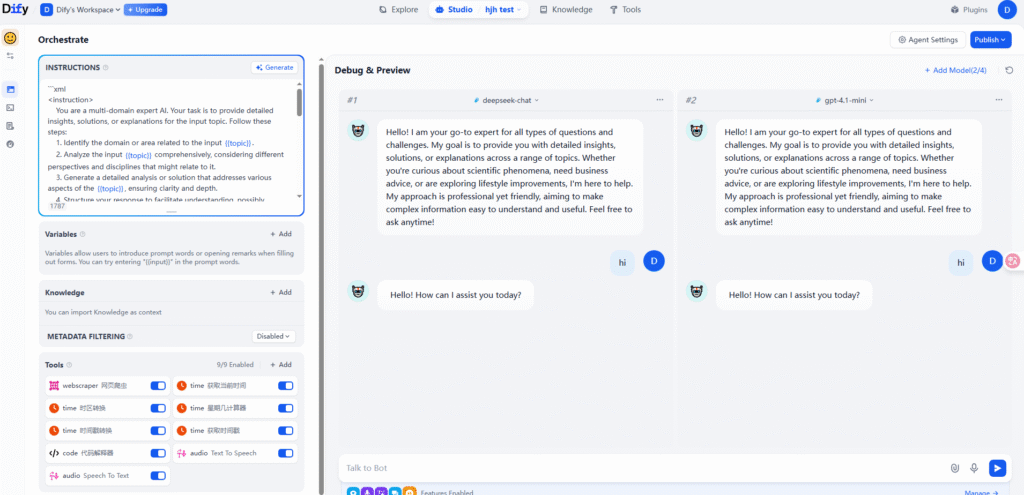

- 使用する Dify ワークフロー/エージェントを開くか作成します。

- ノード(LLM/モデル)を追加して選択 コメットAPI モデル プロバイダー リストから (これはプラグイン経由でインストールされた CometAPI ノードです)。

- 通常どおり、プロンプト テンプレート、コンテキスト ソース (RAG ナレッジ ベース)、温度/パラメータを構成します。

- エンドツーエンドの会話をテストします:プロンプト → Difyオーケストレーション → CometAPIモデル → レスポンス。DifyのPrompt IDEで、小さくて安価なモデル(例:

o3-mini(またはCometAPIでサポートされている同様の低コストのモデル名)を入力し、通常のテキスト応答を確認します。レイテンシとフォーマットを確認してください。 - ログを監視: Dify の可観測性ツールと CometAPI のダッシュボードを使用して、リクエスト/使用状況を確認し、エラー (認証、レート制限) をキャッチします。

Dify タスクの YAML スニペットの例(概念的)

Difyは多くのフローで宣言的な定義を使用します。以下のスニペットは概念的なものです。Difyのバージョンとプラグインのフィールドに合わせて調整してください。

model_provider: cometapi

model: gpt-4o-mini

api_key_secret: dify_plugin_cometapi_key

prompt:

- role: system

content: "You are an assistant..."

(正確なフィールド名については、必ず Dify のインストール ドキュメントを参照してください。)

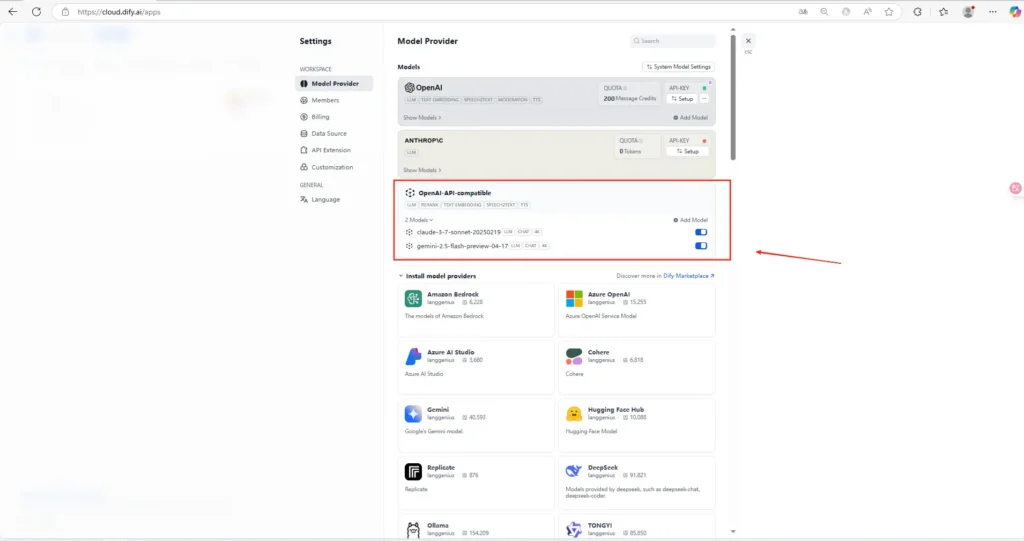

その他の方法: OpenAI形式

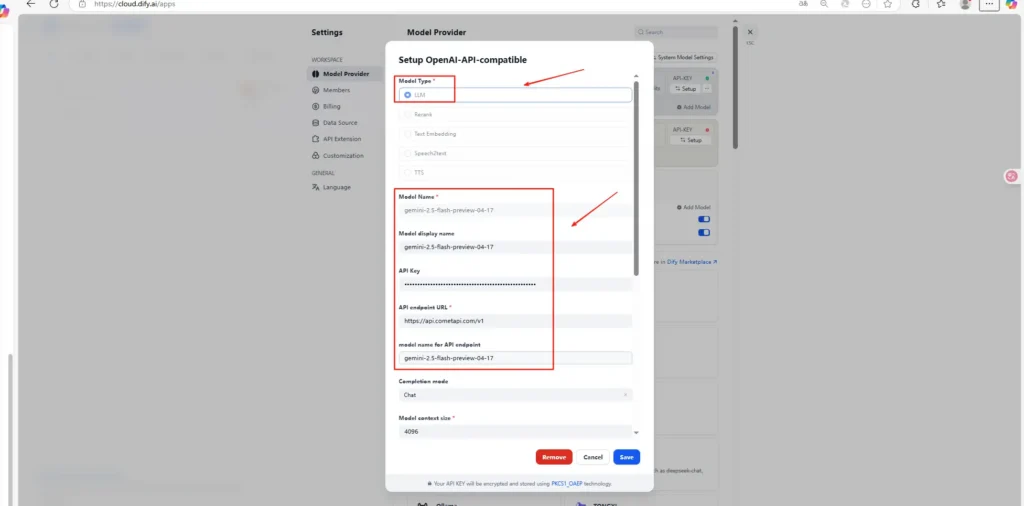

- Difyの設定にアクセスする: Dify プラットフォーム内の設定セクションに移動します。

- モデルプロバイダーを構成する: モデル プロバイダーのオプションを見つけて選択します。

- モデルをプロバイダーとして追加する: 新しいモデル プロバイダーを追加することを選択し、利用可能なオプションから OpenAI (またはその他) を選択します。

- API認証情報を入力してください: CometAPI API キーを入力し、API エンドポイント URL を構成します。

- モデルパラメータの設定モデルタイプ (GPT-4 など)、コンテキストの長さ、最大トークン制限などのパラメータを定義します。

- 機能を有効にする必要に応じて、関数呼び出し、ツール呼び出し、マルチモーダル サポートなどの追加設定を構成します。

- 保存してテストする: 構成を保存し、統合をテストして適切な機能を確認します。

openAIに加えて、CometAPIは次のようなコンテンツ生成モデルAPIも提供しています。 ディープシークR1API, グロク4、芸民モデルなどのほか、テキスト画像モデルや動画生成モデルなど FLUX.1 コンテキスト, Veo3 APIについて および ミッドジャーニーAPI など、独自のワークフローを構築するのに役立ちます。

一般的なトラブルシューティングのシナリオと解決策

- 認証エラー: Difyが認証エラーを表示した場合は、

sk-xxxxxキーと正しいプロバイダーフィールドに貼り付けたかどうかを確認してください。Difyがアクセスできることを確認してください。https://api.cometapi.com. - 予期しない応答/フォーマット: リクエストのフォーマットがOpenAIスタイルと一致していることを確認してください(CometAPIはOpenAI互換フォーマットを受け入れます)。また、

modelパラメータ名。 - 高レイテンシー: 様々なCometAPIモデルをテストしてください。レイテンシはモデルファミリーによって異なる場合があります。また、Difyホストからのネットワーク出力も確認してください。

- コストの急上昇: Dify のトークン制限と CometAPI ダッシュボードの使用状況を確認し、重要でないフローについてはスロットルするか、より安価なモデルに切り替えます。

この統合によってどのような実際の使用例が恩恵を受けるのでしょうか?

ユースケース1: 顧客サービスのためのマルチモデル評価

CometAPIノードとA/Bテストレスポンスを基盤としたDifyチャットフローを起動します。 gpt-4o, claude-3.7 より小規模で安価な候補。一般的なQ/Aの場合は、低コストのCometAPIモデルにルーティングします。複雑なクエリや複数ステップのクエリの場合は、CometAPIを介してより高機能なモデル(またはマルチモーダルモデル)にエスカレーションします。

ユースケース2: 安全なフォールバックを備えた内部ナレッジアシスタント

Dify で RAG パイプラインを構築します。埋め込みと検索を使用し、生成には CometAPI を呼び出します。大規模なモデルがレート制限に達した場合、自動的に小規模な CometAPI モデルにフォールバックします。Flowwise は、フローを Dify に移行して本番環境に移行する前に、プロンプトチェーンのプロトタイプを作成するために使用できます。

ユースケース3: マルチモーダルアプリの迅速な実験

CometAPIは画像および音声モデル(例:Suno、Runway)を公開しています。Difyのオーケストレーション(メディアアップロードを適切なサービスにルーティング)とCometAPIのモデル切り替えを組み合わせることで、マルチモーダル機能を迅速にプロトタイプ化できます。

- Dify オーケストレーションを使用して、概要、テンプレート、スタイル ガイドを収集します。

- CometAPIを使用して画像モデルを呼び出す(Midjourney/ Gemini 2.5 フラッシュイメージ API (Nano-Banana) モデルとキャプション用のLLMを同じフローで使用できます。CometAPIの統合モデルリストにより、このオーケストレーションが簡素化されます。

結論

Dify と CometAPI を統合すると、AI 駆動型アプリケーションの強力な可能性が解き放たれ、合理化されたワークフロー、広範なカスタマイズ オプション、強化された AI 機能が提供されます。ベスト プラクティスに従い、潜在的な課題に対処し、新しい進歩について最新情報を入手することで、開発者はこの統合の可能性を最大限に引き出し、革新的な AI 駆動型ソリューションを作成できます。

CometAPIとDifyの統合を始めるには、モデルの機能を調べてください。 プレイグラウンド Difyに相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

準備はいいですか?→ 今すぐCometAPIに登録しましょう !