GPT-5.2 API とは

GPT-5.2 API は、ChatGPT における GPT-5.2 Thinking と同じものです。GPT-5.2 Thinking は、OpenAI の GPT-5.2 ファミリーにおける中位ティアのバリアントで、より深い作業 のために設計されています。具体的には、多段階推論、長文ドキュメントの要約、高品質なコード生成、そして正確性と実用的な構造が単純なスループットより重要となる専門的なナレッジワークに適しています。API ではモデル gpt-5.2(Responses API / Chat Completions)として提供され、低レイテンシな Instant バリアントと、より高品質だが高コストな Pro バリアントの中間に位置します。

主な機能

- 非常に長いコンテキストと compaction: 有効ウィンドウは 400K で、長い会話やドキュメント全体で関連性を管理するための compaction ツールを備えています。

- 設定可能な推論 effort:

none | medium | high | xhigh(xhigh は難しい推論のために最大の内部計算を有効化)。xhighは Thinking / Pro バリアントで利用できます。 - より強力なツールおよび関数サポート: ツール呼び出しの第一級サポート、構造化出力を制約する文法(CFG/Lark)、そして複雑な多段階自動化を簡素化する改善されたエージェント的挙動。

- マルチモーダル理解: より豊かな画像 + テキスト理解と、多段階タスクへの統合。

- 改善された安全性 / センシティブコンテンツ対応: 自傷行為やその他のセンシティブな文脈において望ましくない応答を減らすための対象を絞った介入。

技術的な機能と仕様(開発者視点)

- API エンドポイントとモデル ID: Thinking 用の

gpt-5.2(Responses API)、チャット / instant ワークフロー用のgpt-5.2-chat-latest、および Pro ティア用のgpt-5.2-pro。該当する場合、Responses API と Chat Completions 経由で利用可能です。 - 推論トークンと effort 管理: API は、リクエストごとに計算資源(reasoning effort)を割り当てる明示的なパラメータをサポートします。より高い effort はレイテンシとコストを増加させますが、複雑なタスクにおける出力品質を向上させます。

- 構造化出力ツール: モデル出力を DSL や厳密な構文に制約するための文法(Lark / CFG)をサポートします(SQL、JSON、DSL 生成に有用)。

- 並列ツール呼び出しとエージェント的協調: 改善された並列性と、より洗練されたツールオーケストレーションにより、複雑なシステムプロンプトやマルチエージェントの足場構築の必要性が軽減されます。

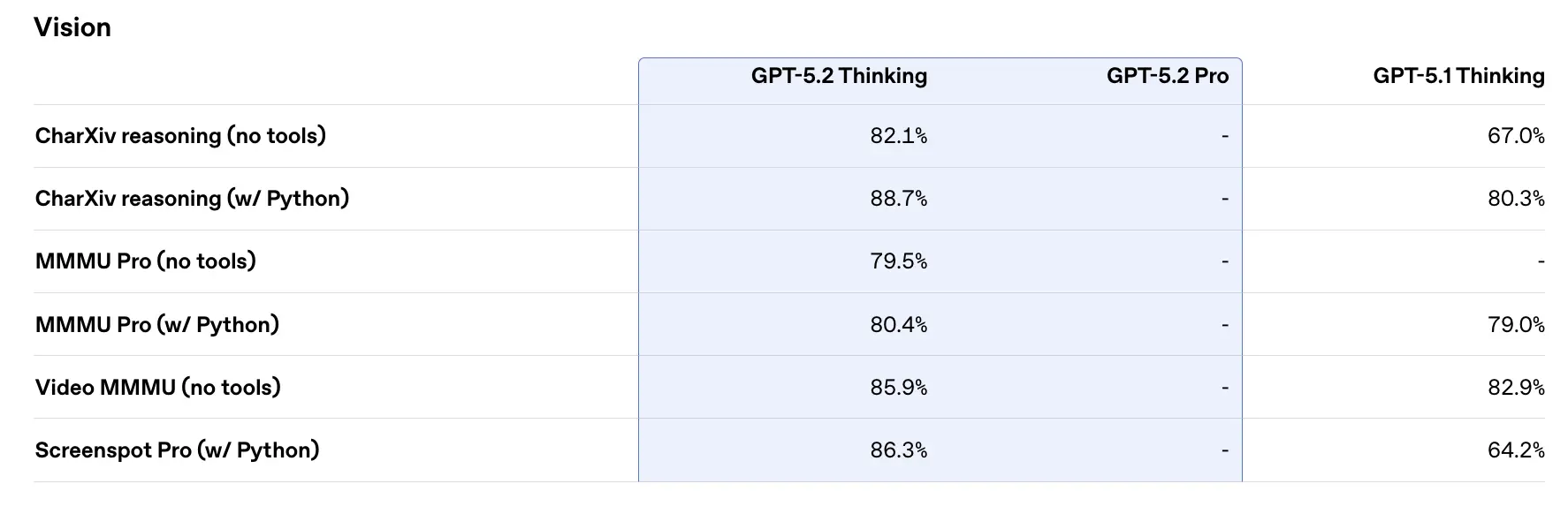

ベンチマーク性能と補足データ

OpenAI は GPT-5.2 に関するさまざまな内部および外部ベンチマーク結果を公開しています。主なハイライト(OpenAI 公表値)は以下のとおりです。

- GDPval(44 職種、ナレッジワーク) — GPT-5.2 Thinking は「比較の 70.9% において業界トップの専門家を上回るか同等」とされています。OpenAI は、GDPval タスクにおいて、出力が専門家と比べて 11 倍超の速度、かつ 1% 未満のコスト で生成されたと報告しています(速度とコストの推定は過去実績ベース)。これらのタスクには、スプレッドシートモデル、プレゼンテーション、短編動画が含まれます。

- SWE-Bench Pro(コーディング) — OpenAI によれば、GPT-5.2 Thinking は SWE-Bench Pro で 約 55.6%、SWE-Bench Verified(Python のみ)で 約 80% を達成し、同社のテストではコード生成 / エンジニアリング評価における新たな最先端水準を打ち立てています。OpenAI の事例によれば、これは実運用においてより信頼性の高いデバッグとエンドツーエンドの修正につながります。

- GPQA Diamond(大学院レベルの科学 Q&A) — GPT-5.2 Pro: 93.2%、GPT-5.2 Thinking: 92.4%(ツールなし、最大推論)で GPQA Diamond を達成。

- ARC-AGI シリーズ — より難しい流動的推論ベンチマークである ARC-AGI-2 において、GPT-5.2 Thinking は 52.9%、GPT-5.2 Pro は 54.2% を記録しました(OpenAI は、これらが chain-of-thought スタイルのモデルとして新たな最先端記録であると述べています)。

- 長文コンテキスト(OpenAI MRCRv2) — GPT-5.2 Thinking は、256k トークンまでの 4-needle MRCR バリアントでほぼ 100% の精度を示し、長文コンテキスト設定において GPT-5.1 を大幅に上回るスコア改善を見せています。(OpenAI は MRCRv2 のチャートと表を公開しています。)

同時代モデルとの比較

- vs Google Gemini 3(Gemini 3 Pro / Deep Think): Gemini 3 Pro は、約 1,048,576(約 100 万)トークン のコンテキストウィンドウ、そしてテキスト、画像、音声、動画、PDF という幅広いマルチモーダル入力を備えると公表されています。また、Vertex AI / AI Studio を通じた強力なエージェント統合も特徴です。仕様上、Gemini 3 のより大きなコンテキストウィンドウは、極めて大規模な単一セッションのワークロードにおける差別化要因です。一方で、トレードオフとして、ツール面の広がりやエコシステム適合性があります。

- vs Anthropic Claude Opus 4.5: Anthropic の Opus 4.5 は、エンタープライズ向けのコーディング / エージェントワークフローを重視しており、SWE-bench の強力な結果や、長時間のエージェント的セッションに対する堅牢性を報告しています。Anthropic は、200k のコンテキストウィンドウと専用のエージェント / Excel 統合を備えた自動化およびコード生成向けモデルとして Opus を位置付けています。Opus 4.5 は、エンタープライズ自動化およびコードタスクにおける強力な競合製品です。

実践的な要点: GPT-5.2 は、バランスの取れた改善セット(400k コンテキスト、高トークン出力、改善された推論 / コーディング)を対象としています。Gemini 3 は絶対的に最大の単一セッションコンテキスト(約 100 万)を狙い、Claude Opus はエンタープライズエンジニアリングとエージェント的堅牢性に重点を置いています。コンテキストサイズ、モダリティ要件、機能 / ツール適合性、そしてコスト / レイテンシのトレードオフに合わせて選択してください。

GPT-5.2 API へのアクセス方法と使い方

ステップ 1: API キーに登録する

cometapi.com にログインします。まだユーザーでない場合は、先に登録してください。CometAPI コンソール にサインインします。インターフェースのアクセス認証情報である API キーを取得します。パーソナルセンターの API token で「Add Token」をクリックし、token key: sk-xxxxx を取得して送信します。

ステップ 2: GPT-5.2 API にリクエストを送信する

API リクエストを送信し、リクエストボディを設定するには、「gpt-5.2」エンドポイントを選択します。リクエストメソッドとリクエストボディは、当社 Web サイトの API ドキュメントから取得できます。当社 Web サイトでは、利便性のために Apifox テストも提供しています。<YOUR_API_KEY> を、アカウントの実際の CometAPI キーに置き換えてください。開発者はこれらを Responses API / Chat エンドポイント経由で呼び出します。

content フィールドに質問またはリクエストを入力してください。モデルはこれに応答します。API レスポンスを処理して生成された回答を取得します。

ステップ 3: 結果を取得して確認する

API レスポンスを処理して生成された回答を取得します。処理後、API はタスクのステータスと出力データを返します。