GLM-4.6 は Z.ai(旧称 Zhipu AI)の GLM ファミリーにおける最新のメジャーリリースであり、エージェント型ワークフロー、長文脈推論、実務的なコーディング向けに調整された第4世代の大規模言語 MoE(専門家混合)モデル です。本リリースは、実用的なエージェント/ツールの統合、非常に大きな コンテキストウィンドウ、およびローカル導入向けの公開ウェイト提供を重視しています。

Key features

- Long context — ネイティブな 200K トークンのコンテキストウィンドウ(128K から拡張)。(docs.z.ai)

- Coding & agentic capability — 実務的なコーディングタスクでの改善と、エージェントによるツール呼び出しの向上を謳う。

- Efficiency — Z.ai のテストで ~30% のトークン消費削減が報告。

- Deployment & quantization — Cambricon チップ向けに FP8 と Int4 の統合を初発表;vLLM 経由で Moore Threads 上でネイティブな FP8 をサポート。

- Model size & tensor type — 公開アーティファクトは、Hugging Face 上で ~357B パラメータのモデル(BF16 / F32 テンソル)を示している。

Technical details

Modalities & formats. GLM-4.6 は テキストのみ の LLM(入力と出力のモダリティ:テキスト)。コンテキスト長 = 200K トークン;最大出力 = 128K トークン。

Quantization & hardware support. チームは Cambricon チップでの FP8/Int4 量子化と、vLLM を用いた Moore Threads GPU 上での ネイティブ FP8 実行を報告 — 推論コストを下げ、オンプレミスおよび国内クラウドでの導入を可能にする上で重要。

Tooling & integrations. GLM-4.6 は Z.ai の API、サードパーティのプロバイダーネットワーク(例:CometAPI)を通じて配布され、コーディングエージェント(Claude Code、Cline、Roo Code、Kilo Code)に統合されている。

Technical details

Modalities & formats. GLM-4.6 は テキストのみ の LLM(入力と出力のモダリティ:テキスト)。コンテキスト長 = 200K トークン;最大出力 = 128K トークン。

Quantization & hardware support. チームは Cambricon チップでの FP8/Int4 量子化と、vLLM を用いた Moore Threads GPU 上での ネイティブ FP8 実行を報告 — 推論コストを下げ、オンプレミスおよび国内クラウドでの導入を可能にする上で重要。

Tooling & integrations. GLM-4.6 は Z.ai の API、サードパーティのプロバイダーネットワーク(例:CometAPI)を通じて配布され、コーディングエージェント(Claude Code、Cline、Roo Code、Kilo Code)に統合されている。

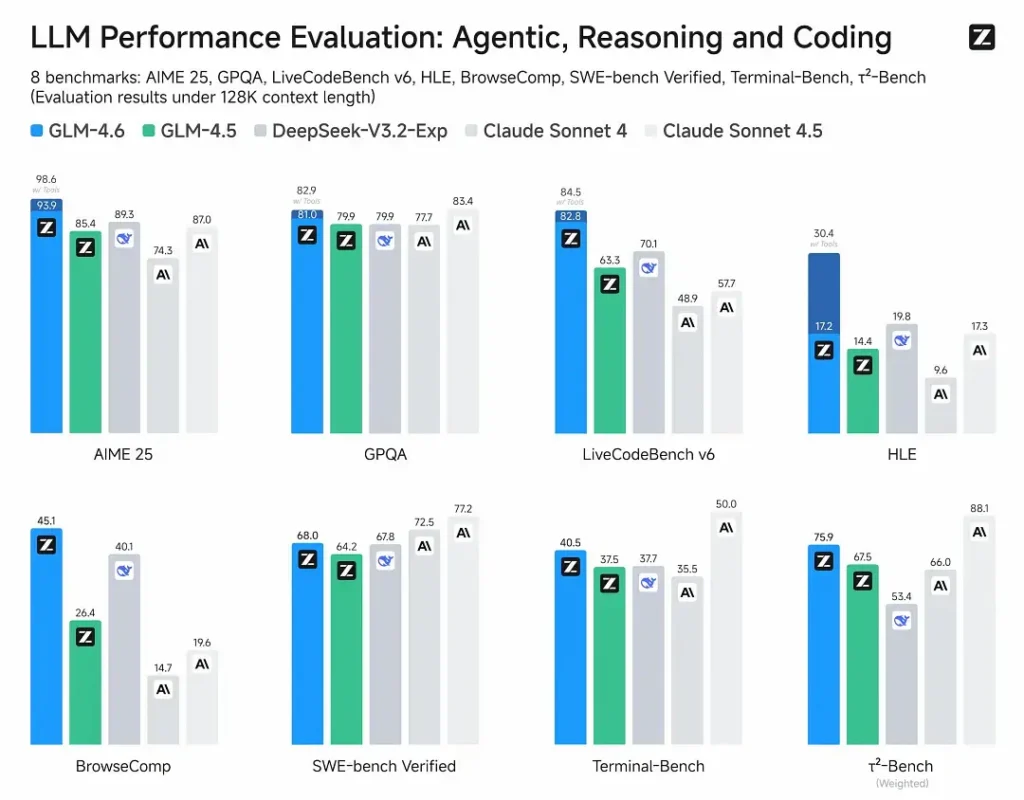

Benchmark performance

- Published evaluations: GLM-4.6 は、エージェント、推論、コーディングを対象とする 8 つの公開ベンチマークでテストされ、GLM-4.5 に対して明確な向上を示す。人手評価の実務的コーディングテスト(拡張版 CC-Bench)では、GLM-4.5 対比で ~15% 少ないトークンを使用し、Anthropic の Claude Sonnet 4 対比で ~48.6% の勝率を記録(多くのリーダーボードでほぼ同等)。

- Positioning: 結果は、GLM-4.6 が国内外の先進モデルと競合できると主張(例として DeepSeek-V3.1 や Claude Sonnet 4 が挙げられている)。

Limitations & risks

- Hallucinations & mistakes: 現在のすべての LLM と同様に、GLM-4.6 は事実誤りを起こし得る — Z.ai のドキュメントは、出力にミスが含まれる可能性を明示的に警告。重要な内容には検証とリトリーバル/RAGの適用が推奨。

- Model complexity & serving cost: 200K コンテキストと非常に大きな出力は、メモリとレイテンシの要求を劇的に増大させ、推論コストを引き上げ得る;大規模運用には量子化や推論エンジニアリングが必要。

- Domain gaps: エージェント/コーディング性能が強いと報告される一方で、公開レポートの一部では特定のマイクロベンチマークで競合モデルの一部バージョンに遅れを指摘(例:一部のコーディング指標での Sonnet 4.5 対比)。本番置換の前にタスク単位で評価すべき。

- Safety & policy: オープンウェイトはアクセス性を高める一方で、運用管理上の課題も生む(緩和策、ガードレール、レッドチーミングは引き続きユーザーの責任)。

Use cases

- Agentic systems & tool orchestration: 長いエージェントトレース、マルチツールの計画、動的ツール呼び出し;エージェント指向の調整が主要な訴求点。

- Real-world coding assistants: マルチターンのコード生成、コードレビュー、対話型 IDE アシスタント(Z.ai によれば Claude Code、Cline、Roo Code に統合)。トークン効率の改善により、ヘビーユースの開発者プランに魅力的。

- Long-document workflows: 200K ウィンドウにより、要約、複数文書の統合、長尺の法務/技術レビュー。

- Content creation & virtual characters: 長尺の対話、マルチターンシナリオでの一貫したペルソナ維持。

How GLM-4.6 compares to other models

- GLM-4.5 → GLM-4.6: **コンテキストサイズ(128K → 200K)**の大きな変更と トークン効率(CC-Bench で ~15% の削減);エージェント/ツール利用の向上。

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai は複数のリーダーボードでのほぼ同等と、CC-Bench の実務的コーディングタスクでの ~48.6% の勝率を報告(接戦で、一部マイクロベンチマークでは Sonnet が先行)。多くのエンジニアリングチームにとって、GLM-4.6 はコスト効率の高い代替として位置付けられている。

- GLM-4.6 vs other long-context models (DeepSeek, Gemini variants, GPT-4 family): GLM-4.6 は大きなコンテキストとエージェント型コーディングワークフローを強調;相対的な強みは指標に依存(トークン効率/エージェント統合 vs コード生成の素の精度やセーフティのパイプライン)。選定はタスク駆動で実証的に行うべき。

Zhipu AI の最新フラッグシップモデル GLM-4.6 をリリース:総 355B パラメータ、32B アクティブ。中核機能のすべてで GLM-4.5 を上回る。

- コーディング:Claude Sonnet 4 に肩を並べ、中国で最高。

- コンテキスト:128K から 200K に拡張。

- 推論:改善され、推論中のツール呼び出しをサポート。

- 検索:ツール呼び出しとエージェント性能が向上。

- ライティング:スタイル、可読性、ロールプレイで人間の嗜好により適合。

- 多言語:言語間翻訳が強化。