2025年11月19〜20日、OpenAI は関連しつつも異なる 2 つのアップグレードを発表しました。GPT-5.1-Codex-Max は、長期的なコーディング、トークン効率、そして複数ウィンドウのセッションを維持する「コンパクション」を重視した Codex 向けの新しいエージェント的コーディングモデル。また、GPT-5.1 Pro は、複雑でプロフェッショナルな業務において、より明確で高機能な回答を目指して調整された Pro 階層の ChatGPT モデルです。

GPT-5.1-Codex-Max とは何か、どのような課題を解決しようとしているのか?

GPT-5.1-Codex-Max は、OpenAI による Codex 専用モデルで、持続的で長期的な推論と実行を必要とするコーディングワークフローに最適化されています。一般的なモデルは極端に長いコンテキスト(たとえば、複数ファイルのリファクタリング、複雑なエージェントループ、永続的な CI/CD タスクなど)でつまずくことがありますが、Codex-Max は複数のコンテキストウィンドウにまたがってセッション状態を自動的にコンパクト化・管理し、数千(あるいはそれ以上)のトークンにわたる単一プロジェクトの一貫した作業を可能にします。OpenAI は Codex-Max を、拡張的なエンジニアリング作業において本当に役立つコード対応エージェントへと前進させる次の一歩として位置づけています。

GPT-5.1-Codex-Max とは何か、どのような課題を解決しようとしているのか?

GPT-5.1-Codex-Max は、OpenAI による Codex 専用モデルで、持続的で長期的な推論と実行を必要とするコーディングワークフローに最適化されています。一般的なモデルは極端に長いコンテキスト(たとえば、複数ファイルのリファクタリング、複雑なエージェントループ、永続的な CI/CD タスクなど)でつまずくことがありますが、Codex-Max は複数のコンテキストウィンドウにまたがってセッション状態を自動的にコンパクト化・管理し、数千(あるいはそれ以上)のトークンにわたる単一プロジェクトの一貫した作業を可能にします。

OpenAI はこれを「開発ライフサイクルのあらゆる段階で、より高速、より賢く、よりトークン効率が高い」と説明しており、Codex のデフォルトモデルとして GPT-5.1-Codex を置き換えることを明確に意図しています。

機能スナップショット

- 複数ウィンドウ継続のためのコンパクション: 重要なコンテキストを残しつつ不要部分を刈り込み、何百万トークン・数時間に及ぶ作業でも一貫性を維持。0

- GPT-5.1-Codex と比較したトークン効率の改善: 一部のコード系ベンチマークで、同等の推論量に対して約 ~30% 少ない思考トークン。

- 長期エージェント耐久性: マルチアワー/マルチデイのエージェントループを維持(OpenAI の内部実験で 24 時間超の連続稼働を記録)。

- プラットフォーム統合: Codex CLI、IDE 拡張、クラウド、コードレビュー ツールで本日より利用可能。API 提供は今後。

- Windows 環境サポート: Codex ワークフローで初めて Windows 対応が明記され、実開発者へのリーチが拡大。

競合製品(例: GitHub Copilot、その他のコーディング AI)との比較

GPT-5.1-Codex-Max は、リクエストごとの補完ツールと比べ、より自律的で長期的なコラボレーターとして位置づけられています。Copilot や類似アシスタントがエディタ内での短期的補完に強みを持つ一方、Codex-Max はマルチステップのオーケストレーション、セッションをまたいだ状態保持、計画・テスト・反復を必要とするワークフローに強みがあります。もっとも、多くのチームにとって最善のアプローチはハイブリッドです。複雑な自動化や持続的なエージェントタスクには Codex-Max を使用し、行単位の補完には軽量なアシスタントを併用するのがよいでしょう。

GPT-5.1-Codex-Max はどのように機能するのか?

「コンパクション」とは何か、それは長時間の作業をどのように可能にするのか

中心的な技術的進歩は「コンパクション」です。これは、セッション履歴を刈り込みながら、作業の一貫性に必要な要点だけを保持し、複数のコンテキストウィンドウをまたいでも連続した作業を可能にする内部メカニズムです。実務上は、コンテキスト上限に近づいた Codex セッションがコンパクト化され(古いまたは価値の低いトークンを要約・保持)、新しいウィンドウで反復を継続できます。OpenAI は、24 時間を超えて連続作業した内部実験を報告しています。

適応的推論とトークン効率

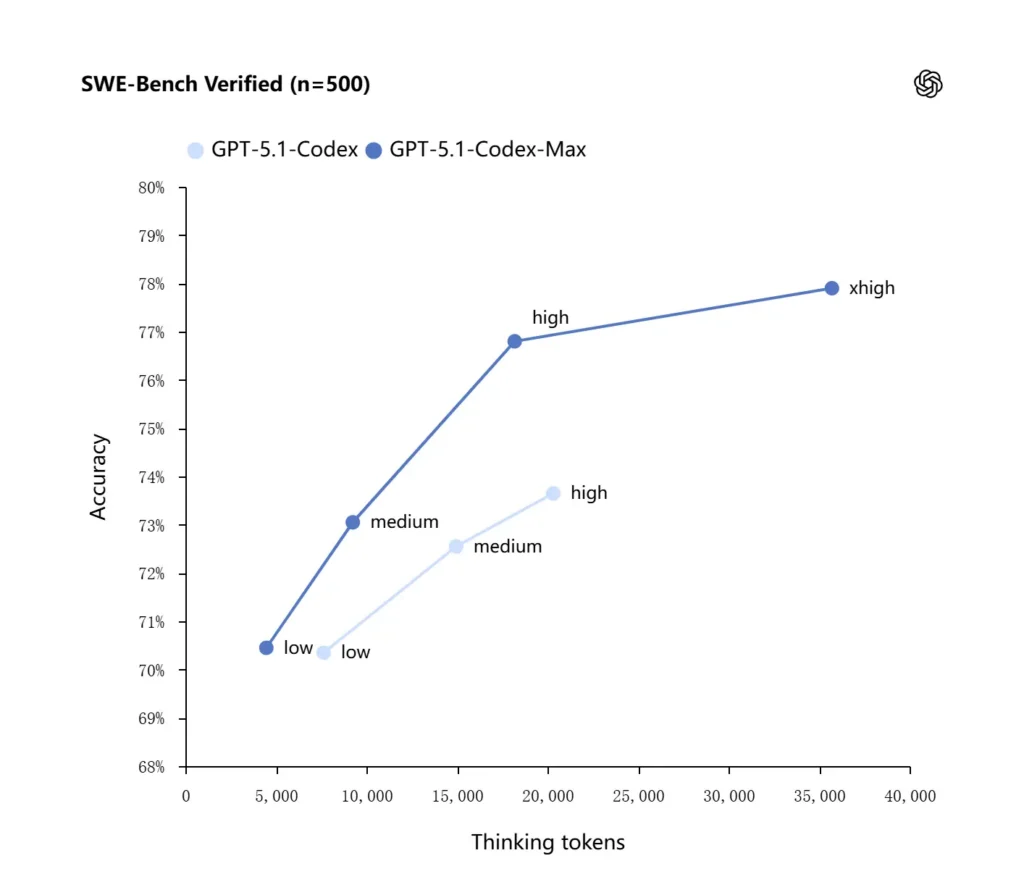

GPT-5.1-Codex-Max は推論戦略を改善し、トークン効率を高めています。OpenAI の内部ベンチマークによると、同等の推論量で GPT-5.1-Codex と同等以上の性能を示しつつ、使用する「思考」トークンを大幅に削減しました—SWE-bench Verified において、同一の推論負荷で約30% 少ない思考トークンを使用したとされています。また、レイテンシ非敏感なタスク向けに「Extra High (xhigh)」という推論努力モードを導入し、内部推論をより多く費やすことで出力品質のさらなる向上を図れます。

システム統合とエージェント的ツール化

Codex-Max は Codex のワークフロー(CLI、IDE 拡張、クラウド、コードレビュー面)に組み込まれ、実際の開発ツールチェーンと対話できるよう配布されています。初期の統合には Codex CLI と IDE エージェント(VS Code、JetBrains など)が含まれ、API 提供は追って予定されています。目標は、より賢いコード生成だけではなく、マルチステップのワークフローを実行できる AI を実現することです。すなわち、ファイルを開く、テストを実行する、失敗を修正する、リファクタリングする、再実行するといった一連の動作です。

ベンチマークおよび実務での性能

持続的推論と長期タスク

評価では、持続的推論と長期タスクにおける改善が測定されています。

- OpenAI の内部評価: Codex-Max は内部実験において「24 時間以上」作業を継続可能で、開発者ツールとの統合により、内部のエンジニアリング生産性指標(例: 利用状況やプルリクエストのスループット)が向上したとされています。これは OpenAI の内部主張であり、実世界の生産性におけるタスクレベルの改善を示唆しています。

- 独立評価(METR): METR の独立レポートでは、GPT-5.1-Codex-Max の「観測 50% タイムホライズン」(モデルが長いタスクを一貫して維持できる中央値の時間)を約2 時間 40 分(幅広い信頼区間あり)と測定。比較可能な測定で GPT-5 の 2 時間 17 分からの改善であり、持続的一貫性の実用的な向上を裏付ける結果です。METR の方法論と CI は変動性を強調しますが、傾向として Codex-Max の長期性能向上を支持しています。

コード系ベンチマーク

OpenAI はフロンティアのコーディング評価での改善を報告しており、特に SWE-bench Verified において、GPT-5.1-Codex より高いトークン効率で優れた結果を示しています。同じ「medium」推論努力で、Max モデルはおよそ 30% 少ない思考トークンでより良い結果を出し、ユーザーがより長い内部推論を許容する場合は xhigh モードで応答をさらに高品質化できます。

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

GPT-5.1-Codex-Max と GPT-5.1-Codex の比較

性能と目的の違い

- スコープ: GPT-5.1-Codex は GPT-5.1 ファミリーの高性能コーディング派生モデルでしたが、Codex-Max は明確にエージェント的で長期志向の後継として、Codex および類似環境の推奨デフォルトとなることを意図しています。

- トークン効率: Codex-Max は SWE-bench および内部利用で、およそ ~30% の思考トークン削減という OpenAI の主張どおり、顕著な効率向上を示しています。

- コンテキスト管理: Codex-Max はコンパクションとネイティブなマルチウィンドウ処理を導入し、単一のコンテキストウィンドウを超えるタスクを継続可能にしました。Codex には同規模のネイティブ機能がありませんでした。

- ツール準備度: Codex-Max は CLI、IDE、コードレビューの各サーフェスでデフォルトの Codex モデルとして提供されており、本番の開発ワークフローへの移行が示されています。

どのモデルをいつ使うべきか?

- GPT-5.1-Codex は、インタラクティブなコーディング支援、クイック編集、小規模リファクタリング、関連コンテキストが 1 ウィンドウに収まる低レイテンシ用途に。

- GPT-5.1-Codex-Max は、複数ファイルのリファクタリング、多数の反復サイクルを要する自動エージェントタスク、CI/CD に類するワークフロー、またはプロジェクト全体の観点を複数回のやり取りで保持する必要がある場合に。

実践的なプロンプトパターンとベストプラクティス例

有効なプロンプトパターン

- 目標と制約を明確にする: 「X をリファクタリングし、公開 API を維持し、関数名を保持し、テスト A,B,C が通ること」

- 最小再現のコンテキストを提供する: 失敗するテストへのリンク、スタックトレース、関連ファイルの抜粋などを含め、リポジトリ全体の投下は避ける。Codex-Max は必要に応じて履歴をコンパクト化します。

- 複雑な作業はステップ化する: 大きな作業をサブタスク列に分解し、Codex-Max に反復させる(例: 「1) テスト実行 2) 上位 3 件の失敗修正 3) リンター実行 4) 変更点の要約」)。

- 説明と差分を求める: パッチと短い根拠説明を求めることで、レビューアが意図と安全性を迅速に確認できます。

プロンプトテンプレート例

リファクタリングタスク

「

payment/モジュールをリファクタリングして、決済処理をpayment/processor.pyに抽出してください。既存の呼び出し元のために公開関数シグネチャは安定を保ってください。process_payment()のユニットテストを作成し、成功、ネットワーク障害、無効なカードをカバーしてください。テストスイートを実行し、失敗したテストと、unified diff 形式のパッチを返してください。」

バグ修正+テスト

「テスト

tests/test_user_auth.py::test_token_refreshが traceback で失敗します。根本原因を調査し、変更を最小化した修正案を提示し、再発防止のためのユニットテストを追加してください。パッチを適用してテストを実行してください。」

反復的な PR 生成

「機能 X を実装してください:エンドポイント

POST /api/exportを追加し、エクスポート結果をストリーミングし、認証を必須とします。エンドポイントを作成し、ドキュメントを追加し、テストを作成して、概要と手作業項目のチェックリスト付きで PR をオープンしてください。」

これらの多くでは、まず medium 努力で開始し、複数ファイルや多数のテスト反復にまたがる深い推論が必要なときは xhigh に切り替えてください。

GPT-5.1-Codex-Max へのアクセス方法

現在の提供状況

OpenAI は Codex のツール群 に GPT-5.1-Codex-Max を統合済みで、Codex CLI、IDE 拡張、クラウド、コードレビューの各フローでデフォルトとして Codex-Max が使用されます(Codex-Mini を選択可能)。API 提供は準備中です。GitHub Copilot には GPT-5.1 と Codex シリーズモデルを含むパブリックプレビューがあります。

開発者は、CometAPI を通じて GPT-5.1-Codex-Max および GPT-5.1-Codex API にアクセスできます。開始するには、CometAPI のモデル機能を Playground で確認し、詳細な手順は API ガイドを参照してください。アクセス前に、CometAPI にログインし API キーを取得していることを確認してください。CometAPI は公式価格より大幅に低い価格を提供し、統合を支援します。

準備はいいですか?→ Sign up for CometAPI today !

AI に関するより多くのヒント、ガイド、ニュースをご希望の場合は、VK、X、Discord をフォローしてください!

クイックスタート(実践的ステップバイステップ)

- アクセス権を確認: ChatGPT/Codex のプラン(Plus, Pro, Business, Edu, Enterprise)または開発者 API プランが GPT-5.1/Codex 系モデルをサポートしていることを確認します。

- Codex CLI または IDE 拡張をインストール: ローカルでコードタスクを実行したい場合は、Codex CLI または VS Code / JetBrains / Xcode 用の Codex IDE 拡張をインストールします。対応構成では、ツールはデフォルトで GPT-5.1-Codex-Max を使用します。

- 推論努力を選択: ほとんどのタスクでは medium から開始。深いデバッグ、複雑なリファクタリング、レイテンシを気にせずモデルに十分思考させたい場合は high または xhigh に切り替えます。小さな即時修正には low が適切です。

- リポジトリコンテキストを提供: モデルに明確な起点を与えます—リポジトリ URL、ファイルセット、短い指示(例: 「payment モジュールを async I/O 化し、ユニットテストを追加。関数レベルの契約は維持」)。Codex-Max はコンテキスト上限に近づくと履歴をコンパクト化し、作業を継続します。

- テストで反復: モデルがパッチを提示したらテストスイートを実行し、失敗をフィードバックし続けます。コンパクションとマルチウィンドウ継続性により、Codex-Max は重要な失敗テストのコンテキストを保持して反復できます。

まとめ:

GPT-5.1-Codex-Max は、複雑で長時間にわたるエンジニアリングタスクを持続して実行できるエージェント的コーディングアシスタントへ向けた大きな一歩です。技術的進歩(コンパクション、推論努力モード、Windows 環境対応)は、現代のエンジニアリング組織に極めて適しており、保守的な運用管理、人間の関与ポリシー、堅牢なモニタリングと組み合わせることでその価値が最大化されます。慎重に導入するチームにとって、Codex-Max はソフトウェアの設計・テスト・保守のあり方を変え、反復的な単純作業を、人とモデルの高付加価値な協働へと転換する潜在力を持っています。