DeepSeek は、V3.x ラインの後継として「DeepSeek V3.2」をリリースし、あわせてエージェント/ツール用途に向けた高性能な推論ファースト版と位置づける DeepSeek-V3.2-Speciale バリアントも公開しました。V3.2 は実験的作業(V3.2-Exp)を土台に、より高い推論能力、「ゴールド級」の数学/競技プログラミング性能に最適化された Speciale エディション、そして内部の段階的推論と外部ツール呼び出し・エージェントのワークフローを緊密に統合した、同社いわく業界初の二重モード「thinking + tool」システムを導入しています。

DeepSeek V3.2 とは — そして V3.2-Speciale はどう違う?

DeepSeek-V3.2 は、DeepSeek の実験的な V3.2-Exp ブランチの正式な後継です。DeepSeek によれば、これは**「エージェントのために構築された“推論ファースト”モデルファミリー」**であり、自然な会話品質だけでなく、多段推論、ツール呼び出し、そして外部ツール(API、コード実行、データコネクタ)を含む環境での信頼できるチェーン・オブ・ソートスタイルの推論に特化して調整されています。

What is DeepSeek-V3.2 (base)

- 実験的な V3.2-Exp ラインの主流プロダクション後継として位置づけられ、DeepSeek のアプリ/ウェブ/API を通じた広範な提供を意図。

- 計算効率とエージェント的タスク向けの堅牢な推論のバランスを維持。

What is DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale は、コンテストレベルの推論、先端数学、エージェント性能に合わせて調整された、より高性能な「スペシャルエディション」として DeepSeek が展開するバリアントです。「推論能力の境界を押し広げる」高性能版として位置づけられています。現在 Speciale は API 専用モデルとして暫定的なアクセスルーティングで提供されており、初期ベンチマークでは、推論やコーディングのベンチマークでハイエンドのクローズドモデルと競合するポジションにあることが示唆されています。

V3.2 はどのような系譜とエンジニアリング選択から生まれたのか?

V3.2 は、DeepSeek が 2025 年を通じて公開してきた反復的エンジニアリングの系譜を継承しています:V3 → V3.1(Terminus)→ V3.2-Exp(実験的ステップ)→ V3.2 → V3.2-Speciale。実験版の V3.2-Exp は、DeepSeek Sparse Attention(DSA) — 非常に長いコンテキスト長において出力品質を維持しつつメモリと計算コストを下げることを狙った、きめ細かなスパースアテンション機構 — を導入しました。この DSA 研究とコスト削減の取り組みが、正式な V3.2 ファミリーへの技術的な橋渡しとなりました。

公式 DeepSeek 3.2 の新機能は?

1) 推論能力の強化 — どのように改善されたのか?

DeepSeek は V3.2 を**「推論ファースト」**と位置づけています。つまり、アーキテクチャとファインチューニングが、多段推論の確実な実行、内部の思考過程(チェーン・オブ・ソート)の維持、そして外部ツールを正しく使用するための構造化された熟考を支えることに重点を置いています。

具体的な改善点には次が含まれます:

- 明示的な段階的問題解決と安定した中間状態(数学的推論、多段のコード生成、論理タスクに有用)を促すトレーニングと RLHF(あるいは類似のアラインメント手法)。

- より長いコンテキストウィンドウを維持し、より忠実に以前の推論ステップを参照できるようにするアーキテクチャおよび損失関数の選択。

- 実用モード(下記「二重モード」参照)により、同一モデルが高速な「チャット」スタイルと、実行前に意図的に中間ステップを踏む熟考的な「思考」スタイルのいずれでも動作可能。

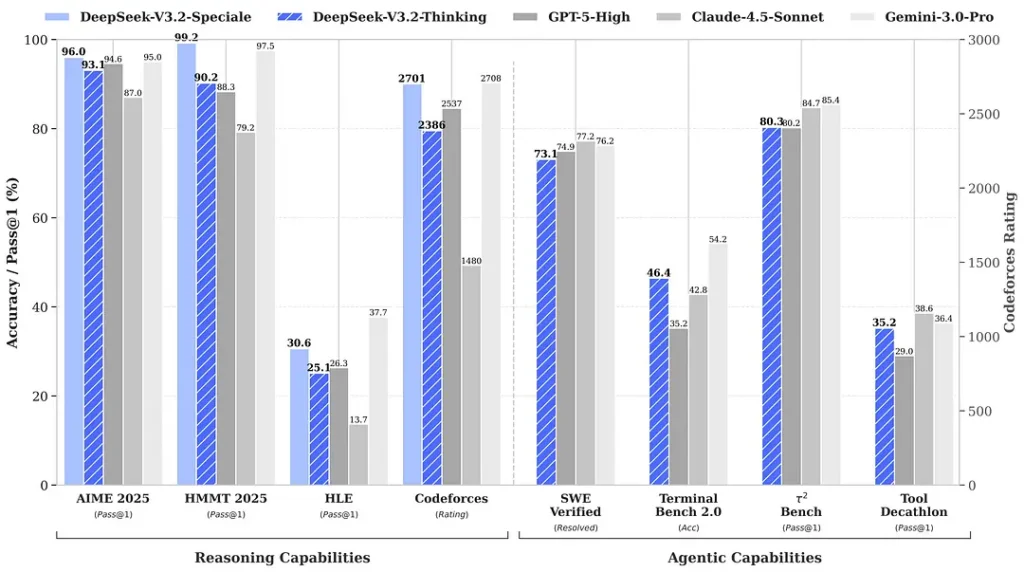

リリース時に引用されたベンチマークでは数学と推論スイートで顕著な向上が主張されており、コミュニティによる初期の独立ベンチマークでも競技的評価セットで印象的なスコアが報告されています:

2) スペシャルエディションでのブレークスルー性能 — どれほど向上?

DeepSeek-V3.2-Speciale は、標準の V3.2 と比べて推論精度とエージェントのオーケストレーションにおいて一段高い性能を発揮するとされています。Speciale は、重い推論ワークロードや難易度の高いエージェントタスクを対象としたパフォーマンス階層として位置づけられており、現時点では API 専用で、期間限定の高機能エンドポイントとして提供されています(DeepSeek は当初の Speciale 提供が限定的であることを示唆)。Speciale 版は従来の数学モデル DeepSeek-Math-V2 を統合し、数学定理の証明や論理推論の自己検証が可能です。世界クラスの複数の競技で目覚ましい成績を収めています:

- 🥇 IMO (International Mathematical Olympiad) Gold Medal

- 🥇 CMO (Chinese Mathematical Olympiad) Gold Medal

- 🥈 ICPC (International Computer Programming Contest) Second Place (Human Contest)

- 🥉 IOI (International Olympiad in Informatics) Tenth Place (Human Contest)

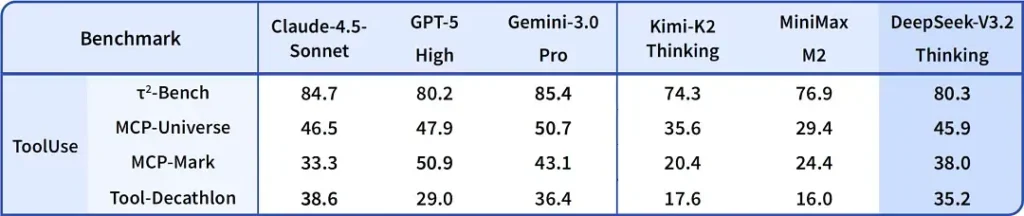

| ベンチマーク | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) 二重モード「thinking + tool」システムの初実装

V3.2 における実用面で興味深い主張のひとつが、高速な会話運用と、ツール利用と緊密に統合された遅延のある熟考的「思考」モードを分離(かつ選択)できる二重モードワークフローです。

- 「Chat / fast」モード: 低レイテンシのユーザー向けチャット用に設計され、簡潔な回答と内部推論痕跡の少なさを重視 — カジュアルなヘルプ、短い Q&A、速度重視のアプリケーションに適しています。

- 「Thinking / reasoner」モード: 厳密なチェーン・オブ・ソート、段階的プランニング、外部ツール(API、データベースクエリ、コード実行)のオーケストレーションに最適化。思考モードでは、より明示的な中間ステップを生成し、それらを検査したり、安全で正しいツール呼び出しを駆動するために活用できます。

この「二重モード」設計は以前の実験ブランチでも見られましたが、V3.2 と Speciale でより深く統合されました — Speciale は現在、思考モード専用(そのため API でのゲーティング)です。スピードと熟考の切り替えが可能であることは、現実世界のシステムと相互作用するエージェントを構築する際に、レイテンシと信頼性のトレードオフを選べるという点でエンジニアリング上価値があります。

注目点: 多くの最新システムは、強力なチェーン・オブ・ソートモデル(推論の説明用)か、別個のエージェント/ツールオーケストレーションレイヤーのいずれかを提供します。DeepSeek の構図は、よりタイトな結合を示唆しています — モデルが「考え」、その後決定的にツールを呼び出し、ツールからの応答を次の思考に反映する — これは自律エージェントを構築する開発者にとってよりシームレスです。

DeepSeek v3.2 の入手先

結論 — 用途に応じて複数の方法で DeepSeek v3.2 を利用できます:

- 公式 Web/アプリ(オンライン利用) — DeepSeek の Web インターフェースまたはモバイルアプリで V3.2 を対話的に試す。

- API アクセス — DeepSeek は API を通じて V3.2 を提供(ドキュメントにモデル名/base_url や価格あり)。API キーを取得し v3.2 エンドポイントを呼び出す。

- ダウンロード可能/オープンウェイト(Hugging Face) — モデル(V3.2 / V3.2-Exp バリアント)は Hugging Face 上で公開(オープンウェイト)。

huggingface-hubやtransformersでファイルを取得。 - CometAPI — AI API アグリゲーションプラットフォーム。ホスト型エンドポイント V3.2-Exp を提供。価格は公式より安価。

実用上の注意点:

- ローカル実行用のウェイトが必要な場合は、Hugging Face のモデルページへ(そこでライセンス/アクセス条件に同意)。

huggingface-cliまたはtransformersでダウンロード。GitHub リポジトリに具体的なコマンドが記載されていることが多い。 - API で本番利用する場合は、CometAPI など選択したプラットフォームの API ドキュメントで、エンドポイント名と該当 V3.2 バリアントの正しい

base_urlを確認。

DeepSeek-V3.2-Speciale:* 研究利用のみ開放。「Thinking Mode」対話をサポートするが、ツール呼び出しは非対応。

- 最大出力は 128K tokens(超長 Thinking Chain)に到達可能。

- 現在、2025 年 12 月 15 日まで無料でテスト可能。

最後に

DeepSeek-V3.2 は、推論中心モデルの成熟における意味のある一歩を示しています。多段推論の改善、特化した高性能版(Speciale)、そしてプロダクションレベルの「thinking + tool」統合の組み合わせは、熟考と外部アクションを往復する高度なエージェント、コーディングアシスタント、研究ワークフローを構築する誰にとっても注目に値します。

開発者は、CometAPI を通じて DeepSeek V3.2 にアクセスできます。開始するには、Playground で CometAPI のモデル機能を確認し、詳細は API guide を参照してください。アクセス前に、CometAPI にログインして API キーを取得していることを確認してください。CometAPI は、統合を支援するために公式価格より大幅に低い価格を提供します。

Ready to Go?→ Sign up for CometAPI today !