キミK2思考は、ムーンショットAIのキミK2ファミリーの新しい「思考」バリアントです。1兆パラメータの疎な専門家混合(MoE)モデルで、 行動しながら考える つまり、深い思考連鎖の推論と、信頼性の高いツール呼び出し、長期的な計画、そして自動セルフチェックをインターリーブするということです。これは、大規模なスパースバックボーン(合計約1Tのパラメータ、トークンあたり約32Bのアクティブ化)、ネイティブINT4量子化パイプライン、そしてスケーラブルな設計を組み合わせています。 推論時間 静的パラメータの数を増やすだけでなく、推論(「思考トークン」の増加とツール呼び出しラウンドの増加)も行います。

簡単に言えば、K2 Thinkingはモデルを問題解決として扱います。 エージェント ワンショットの言語生成器ではなく、言語モデルから思考モデルへの転換こそが、今回のリリースを際立たせ、多くの実践者がオープンソースのエージェントAIにおけるマイルストーンと位置づけている理由です。

「キミK2思考」って一体何?

アーキテクチャと主要仕様

K2 Thinkingは、約384人のエキスパート(トークンごとに8人の専門家を選択)のスパースMoEモデルとして構築されています。 合計1兆個のパラメータ および 約32億のアクティブパラメータ 推論ごとに。ハイブリッドアーキテクチャ(MLAアテンション、SwiGLUアクティベーション)を採用し、MoonshotのMuon/MuonClipオプティマイザーを用いて、同社の技術レポートに記載されている大規模なトークンバジェットで学習しました。思考バリアントは、学習後の量子化(ネイティブINT4サポート)、256kのコンテキストウィンドウ、そして実際の使用時にモデルの内部推論トレースを公開・安定化するためのエンジニアリングによってベースモデルを拡張しています。

「考える」とは実際には何を意味するのか

ここでの「思考」とはエンジニアリングの目標であり、モデルが(1)長く構造化された内部推論の連鎖(思考連鎖トークン)を生成し、(2)その推論の一部として外部ツール(検索、Pythonサンドボックス、ブラウザ、データベース)を呼び出し、(3)中間的な主張を評価・自己検証し、(4)一貫性を損なうことなく、このようなサイクルを多数反復できるようにすることです。Moonshotのドキュメントとモデルカードには、K2 Thinkingが推論と関数呼び出しをインターリーブし、数百ステップにわたって安定したエージェント行動を維持するように明示的にトレーニングおよび調整されていることが示されています。

核となる目的は何ですか

従来の大規模モデルの制限は次のとおりです。

- 生成プロセスは近視眼的であり、ステップ間のロジックが欠けています。

- ツールの使用は制限されています (通常、外部ツールは 1 回または 2 回しか呼び出せません)。

- 複雑な問題では自己修正ができません。

K2 Thinkingの核となる設計目標は、これら3つの問題を解決することです。実際には、K2 Thinkingは人間の介入なしに、200~300回の連続したツール呼び出しを実行し、数百ステップに及ぶ論理的に一貫した推論を維持し、文脈に基づく自己チェックを通じて複雑な問題を解決できます。

再配置:言語モデル → 思考モデル

K2 Thinkingプロジェクトは、この分野におけるより広範な戦略的転換を示しています。条件付きテキスト生成を超えて、 エージェント的な問題解決者主な目的は、パープレキシティや次のトークンの予測を改善することではなく、以下のことを実現するモデルを作成することです。

- 計画 独自の多段階戦略。

- 座標 外部ツールおよびエフェクター(検索、コード実行、知識ベース)

- 確認します 中間結果と間違いの修正。

- 継続 長いコンテキストと長いツール チェーンにわたる一貫性。

この再構成により、評価 (ベンチマークでは、テキストの品質だけでなく、プロセスと結果が重視されます) とエンジニアリング (ツールのルーティング、ステップのカウント、自己批評などの構造) の両方が変更されます。

作業方法:思考モデルの仕組み

実際には、K2 Thinking は「思考モデル」アプローチを代表するいくつかの作業方法を示しています。

- 永続的な内部トレース: モデルは、コンテキスト内に保持され、後で再利用または監査できる構造化された中間ステップ (推論トレース) を生成します。

- 動的ツールルーティング: K2 は各内部ステップに基づいて、どのツール (検索、コード インタープリター、Web ブラウザー) を呼び出すか、いつ呼び出すかを決定します。

- テスト時間のスケーリング: 推論中、システムは「思考の深さ」(より多くの内部推論トークン)を拡張し、ツール呼び出しの数を増やして、より適切な解決策を模索することができます。

- 自己検証と回復: モデルは結果を明示的にチェックし、健全性テストを実行し、チェックが失敗した場合は再計画します。

これらの方法は、モデル アーキテクチャ (MoE + ロング コンテキスト) とシステム エンジニアリング (ツール オーケストレーション、安全性チェック) を組み合わせたものです。

どのような技術革新がKimi K2 Thinkingを可能にしているのでしょうか?

Kimi K2 Thinkingの推論メカニズムは、インターリーブ思考とツールの使用をサポートします。K2 Thinkingの推論ループ:

- 問題を理解する(解析と抽象化)

- 複数ステップの推論計画(プランチェーン)の生成

- 外部ツール(コード、ブラウザ、数学エンジン)の活用

- 結果の検証と修正(検証と修正)

- 結論的な推論(結論的な推論)

以下では、xx の推論ループを可能にする 3 つの重要なテクニックを紹介します。

1) テスト時間のスケーリング

それは何ですか: 従来の「スケーリングの法則」は、訓練中にパラメータやデータの数を増やすことに重点を置いています。K2 Thinkingの革新性は、「推論フェーズ」中にトークンの数(すなわち思考の深さ)を動的に拡大することと、同時にツール呼び出しの数(すなわち行動の幅)を拡大することにあります。この手法はテスト時スケーリングと呼ばれ、その中核となる仮定は「より長い推論チェーン + より多くのインタラクティブツール = 実際の知能の質的飛躍」です。

なぜ重要なのか: K2 Thinking はこれを明確に最適化します。Moonshot は、「思考トークン」とツール呼び出しの数/深さを拡大すると、エージェント ベンチマークで測定可能な改善が得られ、FLOP が一致するシナリオでモデルが同様またはより大きなサイズの他のモデルよりも優れたパフォーマンスを発揮できることを示しています。

2) ツール拡張推論

それは何ですか: K2 Thinkingは、ツールのスキーマをネイティブに解析し、ツールを呼び出すタイミングを自律的に決定し、ツールの結果を継続的な推論ストリームに組み込むように設計されました。Moonshotは、思考の連鎖と関数呼び出しを交互に実行するようにモデルをトレーニングおよび調整し、数百に及ぶ一連のツールステップにわたってこの動作を安定化させました。

なぜ重要なのか: 信頼性の高い解析 + 安定した内部状態 + API ツールの組み合わせにより、モデルは Web ブラウジング、コード実行、および単一セッションの一部としてマルチステージ ワークフローのオーケストレーションを実行できるようになります。

モデルの内部アーキテクチャでは、「視覚化された思考プロセス」の実行軌跡を形成します。プロンプト→推論トークン→ツール呼び出し→観察→次の推論→最終回答

3) 長期的な一貫性と自己検証

それは何ですか: 長期的一貫性とは、多くのステップと非常に長いコンテキストにわたって一貫した計画と内部状態を維持するモデルの能力です。自己検証とは、モデルが中間出力を積極的にチェックし、検証が失敗した場合にステップを再実行または修正することを意味します。長いタスクは、モデルにドリフトや幻覚を引き起こすことがよくあります。K2 Thinkingは、非常に長いコンテキストウィンドウ(256KB)、長いCoTシーケンスにわたって状態を維持するトレーニング戦略、そして裏付けのない主張を検出するための明示的な文レベルの忠実性/判断モデルなど、複数の手法を用いてこの問題に対処します。

なぜ重要なのか: 「再帰推論記憶」メカニズムは推論状態の持続性を維持し、人間のような「思考の安定性」と「文脈的自己監督」特性を与えます。タスクが多くのステップにまたがる場合(例:研究プロジェクト、複数ファイルのコーディングタスク、長時間の編集プロセス)、一貫した単一のスレッドを維持することが不可欠になります。自己検証により、サイレントエラーが減少します。モデルは、もっともらしいが誤った答えを返すのではなく、矛盾を検出し、ツールを再参照したり、計画を再検討したりすることができます。

機能:

- コンテキストの一貫性: 10 以上のトークンにわたって意味の連続性を維持します。

- エラー検出とロールバック: 初期の思考プロセスにおける論理的逸脱を識別して修正します。

- 自己検証ループ: 推論が完了した後、回答の妥当性を自動的に検証します。

- マルチパス推論マージ: 複数の論理チェーンから最適なパスを選択します。

K2 思考の 4 つのコア機能は何ですか?

深く構造化された推論

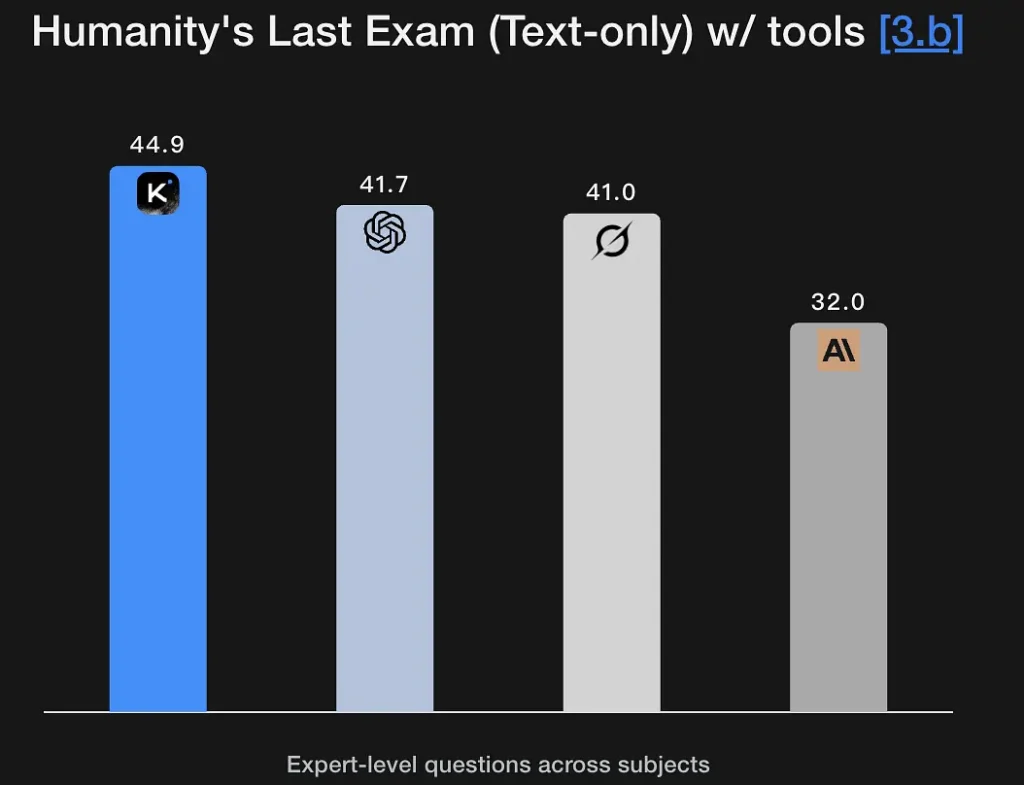

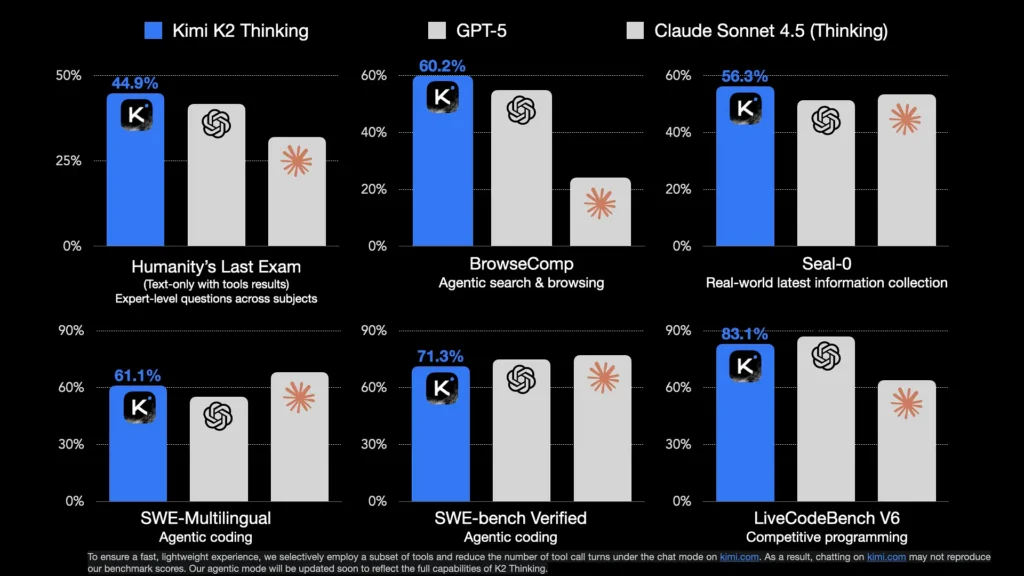

K2 Thinkingは、明示的かつ多段階の推論トレースを生成し、それらを用いて堅牢な結論を導き出すように調整されています。このモデルは、数学および厳密な推論ベンチマーク(GSM8K、AIME、IMOスタイルのベンチマーク)で高いスコアを示し、長いシーケンスにわたって推論を完全な形で維持する能力を実証しています。これは、研究レベルの問題解決の基本要件です。Humanity's Last Examにおける優れたパフォーマンス(44.9%)は、専門家レベルの分析能力を示しています。曖昧な意味記述から論理的枠組みを抽出し、推論グラフを生成することができます。

主な特長:

- 記号的推論をサポート: 数学的、論理的、およびプログラミング的構造を理解し、操作します。

- 仮説検証能力を有する: 自発的に仮説を提案し、検証することができます。

- 多段階の問題分解を実行可能: 複雑な目標を複数のサブタスクに分解します。

エージェント検索

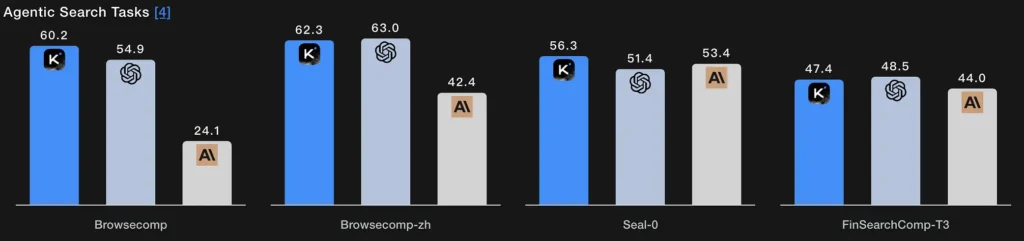

エージェント検索では、単一の検索ステップではなく、モデルが検索戦略(検索対象)を計画し、ウェブ/ツール呼び出しを繰り返し実行することで実行し、受信した結果を統合してクエリを絞り込みます。K2 ThinkingのBrowseCompおよびSeal-0ツール対応スコアは、この機能において優れたパフォーマンスを示しています。このモデルは、ステートフルな計画に基づいて複数ラウンドのウェブ検索を実行できるように明示的に設計されています。

技術的な本質:

- 検索モジュールと言語モデルは、クエリ生成 → Web ページ検索 → セマンティック フィルタリング → 推論融合という閉ループを形成します。

- モデルは、まず定義を検索し、次にデータを検索し、最後に仮説を検証するなど、検索戦略を適応的に調整できます。

- 本質的には、「情報検索+理解+議論」の複合知能です。

エージェンティックコーディング

これは、 書いて、実行して、テストして、繰り返し 推論ループの一部としてコードに作用します。K2 Thinkingは、ライブコーディングとコード検証のベンチマークで競争力のある結果を示し、ツール呼び出しでPythonツールチェーンをサポートし、サンドボックスの呼び出し、エラーの読み取り、そして繰り返しパスにわたるコードの修復によって、複数ステップのデバッグループを実行できます。EvalPlus/LiveCodeBenchのスコアはこれらの強みを反映しています。SWE-Bench Verifiedテストで71.3%のスコアを達成したことは、実際のソフトウェア修復タスクの70%以上を正しく完了できることを意味します。

また、LiveCodeBench V6 競争環境において安定したパフォーマンスを示し、アルゴリズムの実装と最適化の能力を実証しました。

技術的な本質:

- 「セマンティック解析 + AST レベルのリファクタリング + 自動検証」というプロセスを採用しています。

- コードの実行とテストは、実行層でのツール呼び出しによって実現されます。

- コードの理解→エラーの診断→パッチの生成→成功の検証までのクローズドループの自動開発を実現します。

エージェントライティング

創造的な散文表現を超えた、エージェンシーライティングとは、構造化された目標指向の文書作成であり、外部調査、引用、表作成、そして反復的な改善(例:草稿作成 → ファクトチェック → 修正)が必要となる場合があります。K2 Thinkingのロングコンテキストとツールオーケストレーションは、多段階のライティングワークフロー(調査概要、規制概要、複数章にわたるコンテンツなど)に最適です。Arena形式のテストと長文ライティング指標におけるこのモデルの自由回答形式の勝率が、この主張を裏付けています。

技術的な本質:

- エージェント思考プランニングを使用してテキストセグメントを自動的に生成します。

- 推論トークンを通じてテキスト ロジックを内部的に制御します。

- 検索、計算、グラフ生成などのツールを同時に呼び出して、「マルチモーダルライティング」を実現できます。

K2 Thinkingを今日どのように活用できますか?

アクセスモード

K2 Thinkingは、オープンソースリリース(モデルの重みとチェックポイント)として、またプラットフォームエンドポイントとコミュニティハブ(Hugging Face、Moonshotプラットフォーム)を通じて利用可能です。十分なコンピューティングリソースがあればセルフホスティングも可能ですし、 コメットAPIのAPI/ホストUIでより迅速なオンボーディングを実現します。また、 reasoning_content 有効にすると、内部の思考トークンを呼び出し元に表示するフィールド。

使用上のヒント

- エージェントの構成要素から始める: まず、少数の決定論的ツール(検索、Pythonサンドボックス、信頼できるファクトDB)を公開します。モデルが呼び出しを解析・検証できるように、明確なツールスキーマを提供します。

- テスト時の計算を調整する困難な問題解決には、より長い思考予算とツール呼び出し回数の確保を可能とし、レイテンシ/コストに対する品質向上率を測定します。Moonshotは、テスト時間のスケーリングを主要な手段として推進しています。

- コスト効率を高めるためにINT4モードを使用するK2 Thinking は、大幅な高速化を実現する INT4 量子化をサポートしていますが、タスクのエッジケースの動作を検証します。

- 表面的な推論内容を注意深く内部チェーンを公開することはデバッグに役立ちますが、生のモデルエラーのリスクも高まります。内部推論を 診断 権威のあるものではありません。自動検証と組み合わせてください。

結論

キミK2シンキングは、AIの次の時代に向けて意図的に設計された答えです。単に大きなモデルだけではなく、 考え、行動し、検証するエージェントMoEスケーリング、テスト時のコンピューティング戦略、ネイティブの低精度推論、そして明示的なツールオーケストレーションを統合することで、持続的な多段階的な問題解決を可能にします。多段階的な問題解決を必要とし、エージェントシステムの統合、サンドボックス化、監視を行うエンジニアリングの専門性を持つチームにとって、K2 Thinkingは大きな前進であり、実用的な一歩となります。そして、ますます能力を高め、行動指向的なAIを産業界や社会がどのように統制していくのかを示す重要なストレステストとなります。

開発者はアクセスできる キミK2思考API CometAPIを通じて、 最新モデルバージョン 公式ウェブサイトで常に更新されています。まずは、モデルの機能について調べてみましょう。 プレイグラウンド そして相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

準備はいいですか?→ 今すぐCometAPIに登録しましょう !