Llama 4とは何ですか?

Meta プラットフォームは、Llama 4 シリーズの大規模言語モデル (LLM) の最新スイートを発表し、人工知能技術の大きな進歩を示しました。Llama 4 コレクションでは、2025 年 4 月に Llama 4 Scout と Llama 4 Maverick という XNUMX つの主要モデルが導入されます。これらのモデルは、テキスト、ビデオ、画像、オーディオなど、さまざまなデータ形式を処理および翻訳するように設計されており、マルチモーダル機能を発揮します。さらに、Meta は、将来のモデルのトレーニングを支援することを目的とした、これまでで最も強力な LLM の XNUMX つとして宣伝されている次期モデルである Llama XNUMX Behemoth をプレビューしました。

Llama 4 は以前のモデルとどう違うのでしょうか?

強化されたマルチモーダル機能

Llama 4 は、以前のバージョンとは異なり、複数のデータ モダリティをシームレスに処理できるように設計されています。つまり、テキスト、画像、ビデオ、オーディオ入力に基づいて分析し、応答を生成できるため、さまざまなアプリケーションに非常に適応できます。

特殊モデルの導入

Meta は Llama 4 シリーズに XNUMX つの特殊バージョンを導入しました。

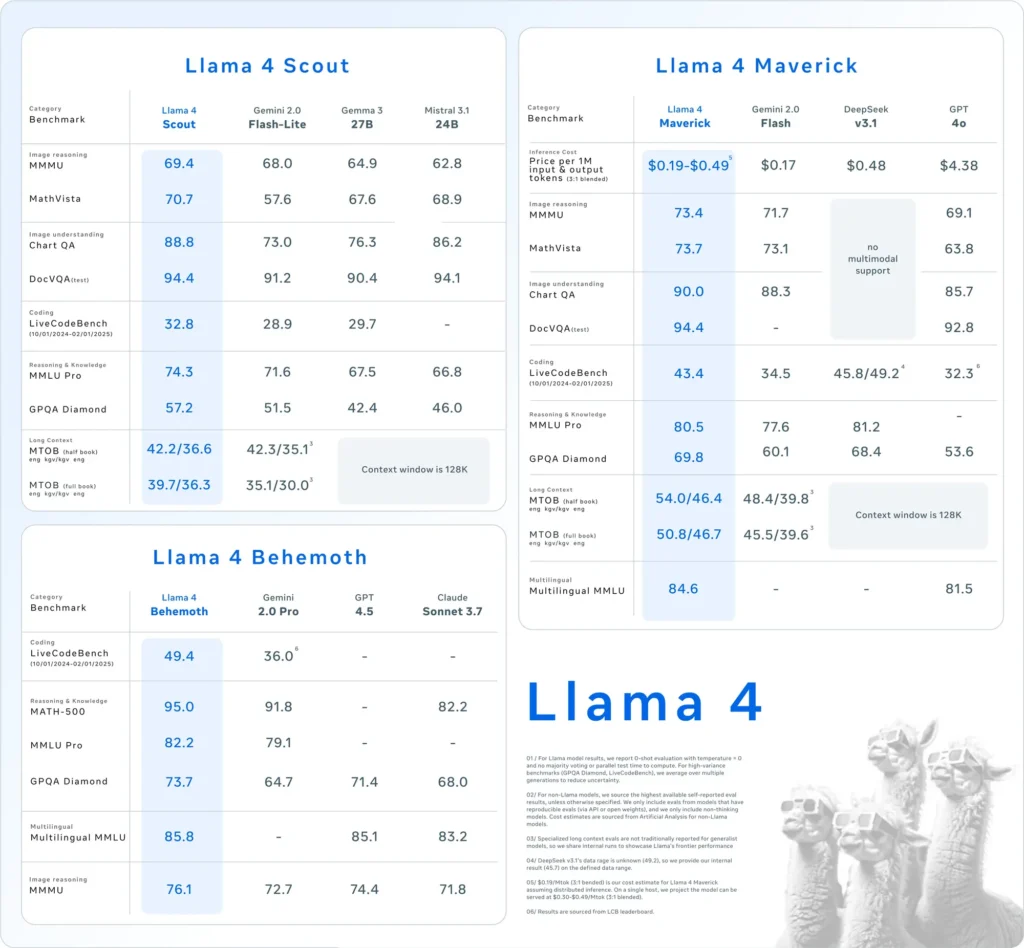

- ラマ4スカウト: 単一の Nvidia H100 GPU で効率的に実行するように最適化されたコンパクトなモデルです。10 万トークンのコンテキスト ウィンドウを誇り、さまざまなベンチマークで Google の Gemma 3 や Mistral 3.1 などの競合製品よりも優れたパフォーマンスを実証しています。

- ラマ4マーベリック: OpenAI の GPT-4o や DeepSeek-V3 に匹敵するパフォーマンスを持つ大規模なモデルで、特に、より少ないアクティブ パラメータを使用しながらコーディングと推論のタスクに優れています。

さらに、Metaは開発中 ラマ 4 ベヒーモスは、288億個のアクティブパラメータと合計2兆個のパラメータを持つモデルであり、STEMベンチマークでGPT-4.5やClaude Sonnet 3.7などのモデルを上回ることを目指しています。

専門家混合(MoE)アーキテクチャの採用

Llama 4 は「Mixture of Experts (MoE)」アーキテクチャを採用しており、モデルを専門のユニットに分割してリソースの使用率を最適化し、パフォーマンスを向上させます。このアプローチにより、特定のタスクに対してモデルの関連するサブセットのみをアクティブ化することで、より効率的な処理が可能になります。

Llama 4 は他の AI モデルと比べてどうですか?

Llama 4 は、主要な AI モデルの中で競争力のある位置を占めています。

- パフォーマンスベンチマークLlama 4 Maverick のパフォーマンスは、コーディングおよび推論タスクにおいて OpenAI の GPT-4o および DeepSeek-V3 と同等ですが、Llama 4 Scout はさまざまなベンチマークで Google の Gemma 3 や Mistral 3.1 などのモデルを上回っています。

- オープンソースのアプローチMeta は引き続き Llama モデルをオープンソースとして提供し、プラットフォーム間のより広範なコラボレーションと統合を促進します。ただし、Llama 4 ライセンスは 700 億人を超えるユーザーを抱える商業団体に制限を課しており、モデルの真のオープン性に関する議論を呼んでいます。

| カテゴリー | ベンチマーク | ラマ4マーベリック | GPT-4o | ジェミニ 2.0 フラッシュ | ディープシーク v3.1 |

|---|---|---|---|---|---|

| 画像推論 | MMMU | 73.4 | 69.1 | 71.7 | マルチモーダルサポートなし |

| MathVista | 73.7 | 63.8 | 73.1 | マルチモーダルサポートなし | |

| 画像の理解 | チャートQA | 90.0 | 85.7 | 88.3 | マルチモーダルサポートなし |

| DocVQA (テスト) | 94.4 | 92.8 | – | マルチモーダルサポートなし | |

| コーディング | ライブコードベンチ | 43.4 | 32.3 | 34.5 | 45.8/49.2 |

| 推論と知識 | MMLUプロ | 80.5 | – | 77.6 | 81.2 |

| GPQA ダイヤモンド | 69.8 | 53.6 | 60.1 | 68.4 | |

| 多言語 | 多言語MMLU | 84.6 | 81.5 | – | – |

| 長いコンテキスト | MTOB(半冊)eng→kgv/kgv→eng | 54.0/46.4 | コンテキストは128Kに制限されています | 48.4/39.8 | コンテキストは128Kに制限されています |

| MTOB(全巻)eng→kgv/kgv→eng | 50.8/46.7 | コンテキストは128Kに制限されています | 45.5/39.6 | コンテキストは128Kに制限されています |

Llama 4 はベンチマークテストでどのように機能しますか?

ベンチマーク評価により、Llama 4 モデルのパフォーマンスに関する洞察が得られます。

- ラマ4スカウト: このモデルは、さまざまなベンチマークで Google の Gemma 3 や Mistral 3.1 などの競合製品よりも優れた性能を発揮します。単一の GPU で 10 万トークンのコンテキスト ウィンドウで動作できるため、複雑なタスクを処理する際の効率性と有効性が際立っています。

- ラマ4マーベリック: OpenAI の GPT-4o や DeepSeek-V3 と同等のパフォーマンスを誇る Llama 4 Maverick は、アクティブなパラメータを少なくしながらも、コーディングと推論のタスクに優れています。この効率性は機能を犠牲にすることなく実現されており、LLM 分野で強力な候補となっています。

- ラマ 4 ベヒーモス: 288億のアクティブパラメータと合計2兆のパラメータを持つLlama 4 Behemothは、STEMベンチマークでGPT-4.5やClaude Sonnet 3.7などのモデルを上回っています。その膨大なパラメータ数とパフォーマンスは、将来のAI開発の基盤モデルとしての可能性を示しています。

これらのベンチマーク結果は、Meta が AI 機能の向上に注力し、Llama 4 シリーズをこの分野で強力なプレーヤーとして位置付けていることを強調しています。

ユーザーはどのようにしてLlama 4にアクセスできますか?

Meta は Llama 4 モデルを AI アシスタントに統合し、WhatsApp、Messenger、Instagram、Web などのプラットフォームでアクセスできるようにしました。この統合により、ユーザーは使い慣れたアプリケーション内で Llama 4 の強化された機能を体験できます。

Llama 4 をカスタム アプリケーションに活用することに関心のある開発者や研究者向けに、Meta は Hugging Face などのプラットフォームや独自の配布チャネルを通じてモデルの重みへのアクセスを提供しています。このオープン ソース アプローチにより、AI コミュニティは Llama 4 の機能を活用して革新を進めることができます。

Llama 4 はオープンソースとして販売されていますが、ライセンスは 700 億人を超えるユーザーを抱える商業団体に制限を課している点に注意してください。組織はライセンス条件を確認して、Meta のガイドラインに準拠していることを確認する必要があります。

CometAPI で Llama 4 を使って高速にビルドする

CometAPI は、チャット、画像、コードなどのオープンソースおよび特殊なマルチモーダル モデルを含む 500 を超える AI モデルへのアクセスを提供します。主な強みは、従来複雑だった AI 統合プロセスを簡素化することです。API の集約を XNUMX つのプラットフォームに一元化することで、個別のプラットフォームやプロバイダーの管理に費やされる貴重な時間とリソースを節約できます。これにより、Claude、OpenAI、Deepseek、Gemini などの主要な AI ツールへのアクセスが、単一の統合サブスクリプションを通じて可能になります。CometAPI の API を使用して、音楽やアートワークを作成したり、ビデオを生成したり、独自のワークフローを構築したりできます。

コメットAPI 統合を支援するために、公式価格よりもはるかに安い価格を提供します ラマ 4 API登録してログインすると、アカウントに1ドルが入ります。登録してCometAPIを体験してください。CometAPIは使った分だけ支払います。ラマ 4 API CometAPI では、価格設定は次のように構成されています。

| カテゴリー | ラマ4マーベリック | ラマ4スカウト |

| API 料金 | 入力トークン: $0.48 / XNUMX万トークン | 入力トークン: $0.216 / XNUMX万トークン |

| 出力トークン: 1.44ドル/百万トークン | 出力トークン: 1.152ドル/百万トークン |

- を参照してください ラマ 4 API 統合の詳細については、こちらをご覧ください。

- Comet APIのモデルリリース情報については、以下を参照してください。 https://api.cometapi.com/new-model.

- Comet APIのモデル価格情報については、以下を参照してください。 https://api.cometapi.com/pricing

構築を開始する 今すぐ CometAPI にサインアップ 無料でアクセスするにはここをクリックするか、レート制限なしでスケールするには CometAPI有料プラン.

Llama 4 のリリースがもたらす影響は何ですか?

メタプラットフォーム間の統合

Llama 4 は、WhatsApp、Messenger、Instagram、Web などのプラットフォーム全体で Meta の AI アシスタントに統合されており、高度な AI 機能によってユーザー エクスペリエンスを強化します。

AI業界への影響

Llama 4のリリースは、AIインフラの拡張に最大65億ドルを投資する計画など、MetaのAIへの積極的な取り組みを強調するものだ。この動きは、AIイノベーションをリードするテクノロジー大手間の競争が激化していることを反映している。

エネルギー消費に関する考慮事項

Llama 4 に必要な膨大な計算リソースは、エネルギー消費と持続可能性に関する懸念を引き起こします。100,000 を超える GPU のクラスターを運用するには多大なエネルギーが必要であり、大規模な AI モデルの環境への影響についての議論が巻き起こっています。

Llama 4 の将来はどうなるのでしょうか?

Meta は、4 年 29 月 2025 日に開催される LlamaCon カンファレンスで、Llama 4 のさらなる開発とアプリケーションについて議論する予定です。AI コミュニティは、現在の課題に対処し、さまざまな分野で Llama XNUMX の機能を活用するための Meta の戦略についての洞察を期待しています。

要約すると、Llama 4 は AI 言語モデルの大きな進歩を表しており、強化されたマルチモーダル機能と特殊なアーキテクチャを提供しています。開発上の課題に直面しているにもかかわらず、Meta の多大な投資と戦略的取り組みにより、Llama 4 は進化する AI 環境において強力な競争相手としての地位を確立しています。