画像編集AIは、数年ではなく数か月で、単なるおもちゃから実際のワークフローツールへと進化しました。背景を削除したり、顔を入れ替えたり、複数のショットでキャラクターを維持したり、自然言語プロンプトを使って複数段階の合成を行ったりする必要がある場合、いくつかの新しいモデルが、より速く、より少ない手作業でそれらを実行できることを約束しています。この記事では、今話題になっている3つのツールを比較します。 OpenAIのGPTイメージ1、Qwen-画像編集、ウイルス ナノバナナ モデル(Gemini-2.5-Flash-Image)、および フラックスコンテキストそれぞれの優れた点、欠点を説明し、達成したい目標に応じて実用的な推奨事項を紹介します。

画像 AI における卓越性を定義するコア機能とは何ですか?

「最高」は、何を必要としているかによって異なります。私は7つの実用的な基準を用いて評価しました。個々のモデルを分析する前に、画像生成・編集AIの優秀さを定義する基本的な機能を理解することが重要です。これらは、大きく分けて以下の3つに分類できます。

- 生成品質と忠実度: これは、テキストプロンプトから非常にリアルで、美しく、一貫性のある画像を生成するAIの能力を指します。要素としては、ディテール、照明、構図、アーティファクトや歪みのなさなどが挙げられます。

- 編集の多様性と精度: 優れたAIは、初期生成に加えて、堅牢な編集機能を提供する必要があります。これには、インペインティング(欠落部分の補完)、アウトペインティング(画像の拡張)、オブジェクトの削除/追加、スタイルの転送、特定の要素の正確な制御などが含まれます。

- 速度と効率: プロフェッショナルなワークフローでは、画像の生成や編集にかかる時間は非常に重要です。品質を犠牲にすることなく処理を高速化できることは、大きなメリットとなります。

- ユーザーエクスペリエンスとアクセシビリティ: 直感的なインターフェース、明確なコントロール、既存のワークフローへの容易な統合は、広範な導入とユーザー満足度にとって不可欠です。

- 倫理的配慮と安全機能: AIの能力が強化されるにつれ、責任ある開発と展開が不可欠になります。これには、有害または偏ったコンテンツの生成を防ぐための安全対策も含まれます。

- 費用対効果と価格モデル: 一部のツールでは無料プランが提供されていますが、予算を重視するユーザーにとっては、高度な機能や商用利用に関する料金体系を理解することが不可欠です。

- 一貫した複数ステップの編集 — 複数の編集や画像にわたってアイデンティティ/オブジェクトを保持します。

私は実用性を重視します。つまり、驚くほどのインパクトはないものの、再現性があり、高速で信頼性の高い編集を可能にするモデルの方が、多くのクリーンアップを必要とする派手なモデルよりも優れています。

検討中のモデルは何ですか、そしてそれらは何が違うのですか?

クイックモデルスナップショット

- gpt-image-1 (OpenAI) — 2025 年 XNUMX 月に API にリリースされたネイティブ マルチモーダル モデルで、同じマルチモーダル レスポンス/イメージ API 内での反復的な画像生成と編集を直接サポートします。

- ジェミニ 2.5 フラッシュイメージ (Google) — 26 年 2025 月 XNUMX 日発表(「ナノバナナ」); 高速で低遅延の生成と豊富な編集(複数画像の融合、文字の一貫性)向けに設計; 来歴用の SynthID 透かしが含まれます。

- Qwen-Image-Edit(QwenLM / Alibabaグループ) — バイリンガルで正確なテキスト編集と、意味と外観を組み合わせた編集を重視した Qwen-Image (20B 基盤) の画像編集バージョン。

- FLUX.1 Kontext (Flux / Black Forest Labs / Flux プラットフォームバリアント) — 文字の一貫性と反復的なワークフローを備えた、高速でローカルなコンテキスト認識編集に重点を置いたモデル ファミリ (Dev / Pro / Max)。

なぜこの4つなのでしょう?

これらは、2025年に実務家が問うべき最も重要な設計ポイントを網羅しています。マルチモーダル統合(OpenAI)、スケール+プロダクション+世界知識(Google)、精密編集とオープンリサーチ(Qwen)、UXファースト反復編集(Flux)。それぞれコスト、レイテンシ、そして強みを発揮する領域(テキストレンダリング、複数画像の融合、反復編集、変更されていない領域の保持)において、それぞれ異なるトレードオフがあります。

GPT-Image-1 (OpenAI) — 開発者の重労働

それは何ですか: OpenAIのGPT-Image-1は、テキストと画像の両方の入力を受け付け、Images APIを介して画像生成と編集(インペインティング、画像から画像への変換)をサポートするネイティブマルチモーダルモデルです。アプリやサービスへの統合に適したプロダクショングレードのモデルとして位置付けられています。画像入力とテキストプロンプトを受け付け、きめ細かな制御で編集を実行できるネイティブテキスト+画像モデルとして設計されています。

GPT-image-1 の強みは何ですか?

- 優れた意味理解: GPT-image-1 の最大の強みの一つは、ニュアンスに富んだ精緻なテキストプロンプトを解釈する能力にあります。ユーザーは複雑な情景、具体的な雰囲気、抽象的な概念を驚くほど正確に描写することができ、AI はこれらの描写を忠実に反映した画像を生成することがよくあります。

- 高品質のフォトリアリズム: GPT-image-1は、リアルな画像を求めると、テクスチャ、ライティング、自然な構図に細心の注意を払い、驚くほどリアルな出力を頻繁に生成します。そのため、フォトリアリスティックなレンダリングやコンセプトアートに最適なツールとなっています。

- 創造的な解釈: GPT-image-1は単なる直訳にとどまらず、ある程度の創造的な解釈を示し、微妙なディテールやスタイリッシュな装飾を加えることで、生成された画像全体の芸術的な魅力を高めます。これは、アイデア創出や多様な視覚的コンセプトの探求に特に役立ちます。

- 反復のための強力な基盤: 高品質の初期コンセプトを生成する機能は、AI の編集機能 (利用可能な場合) または従来のグラフィック デザイン ソフトウェアを使用してさらに改良するための優れた出発点となります。

GPT-image-1 の制限事項は何ですか?

- 細部までコントロール: 幅広い概念を扱う上では優れているものの、ピクセルレベルの絶対的な制御や非常に小さな要素の精密な操作を実現することは、時に困難を伴います。これは、出力がプロンプトに基づいてある程度決定論的に決定される多くの生成AIに共通する課題です。

- 可用性と統合: GPT-image-1 の直接編集機能は、実装によっては、専用の画像編集プラットフォームに比べて堅牢性や統合性が低い場合があります。ユーザーは、生成後の高度な編集を行うために、エクスポートして他のツールを使用する必要がある場合があります。

- 計算上の要求: 複雑なプロンプトを使用して非常に詳細な画像を生成すると、計算負荷が高くなり、迅速な編集のためのより特化した軽量のモデルに比べて処理時間が長くなる可能性があります。

ナノバナナ(Google / Gemini 2.5 フラッシュイメージ)

それは何ですか: 「ナノバナナ」は、Googleの最近のGeminiイメージアップグレード(Gemini 2.5 Flash Image)に付けられた遊び心のある名前です。GoogleのGeminiエコシステムにおける次世代の画像生成/編集ツールとして位置付けられ、より強力で繊細な多段階編集と、写真編集における優れた一貫性を売りにしています。

ビジュアル AI 環境において、Gemini-2.5-Flash-Image が輝くのはどのような点でしょうか?

Gemini-2.5-Flash-Imageは、速度と効率性を重視して設計された比較的新しいバージョンで、高品質な出力と高速処理のバランスを目指すGoogleのライバルです。「Flash」という名称は、より高速なレスポンスのために最適化されたアーキテクチャを指し、リアルタイムまたはほぼリアルタイムでの生成と編集が不可欠なアプリケーションに非常に適しています。

Gemini-2.5-Flash-Image が有力候補となる理由は何ですか?

- 驚異的な高速世代: その名の通り、スピードこそが最大の強みです。Gemini-2.5-Flash-Imageは、画像の高速生成に優れており、締め切りが厳しいクリエイティブプロフェッショナルやインタラクティブアプリケーションにとって非常に役立ちます。

- 優れた画質: このモデルは高速であるにもかかわらず、画質に大きな妥協はありません。一貫性があり、視覚的に魅力的な画像を生成し、大きなアーティファクトはほとんど発生しません。そのため、多くのユースケースにおいて、より低速でリソースを大量に消費するモデルと競合可能です。

- マルチモーダル理解: より広範な Gemini フレームワークを活用することで、高度なマルチモーダル理解の恩恵を受けることが多く、テキストだけでなく他の形式の入力も解釈して画像の生成と編集をガイドできる可能性がありますが、これは特定の API によって異なります。

- 統合編集機能: Gemini-2.5-Flash-Image には通常、インペインティング (画像の欠落部分を埋める)、アウトペインティング (画像を元の境界を超えて拡張する)、オブジェクト操作などの統合編集機能が付属しており、エンドツーエンドの画像ワークフローのためのより完全なソリューションになります。

Gemini-2.5-Flash-Image の改善すべき点は何ですか?

- 最高のフォトリアリズム: 優れた性能ではありますが、非常に複雑で繊細なシーンを描写する、低速で大型のモデルに見られるようなフォトリアリズムの頂点に必ずしも達するとは限りません。速度と究極の忠実度の間には、若干のトレードオフが生じる可能性があります。

- 複雑なスタイルの芸術的なニュアンス: 非常に特殊な芸術的スタイルや極めて抽象的なリクエストの場合、膨大な芸術史データセットでトレーニングされたモデルと比較すると、最も微妙な芸術的ニュアンスを捉える能力がやや劣ると感じるユーザーもいるかもしれません。

- 生成されたテキストの制御(画像内): 多くの生成モデルと同様に、画像内に完全に一貫性があり、正しく綴られたテキストを生成することは、依然として困難な場合があります。

Qwen-Image-Editとは何ですか?

それは何ですか: Qwen-Image-Edit(Alibaba / Qwen チーム) — Qwen-Image ファミリーに基づいて構築された画像編集モデル。強力なバイリンガル テキスト編集 (中国語と英語)、意味と外観の制御、直接的な画像編集の忠実性を備えています。

Qwen-Image Edit の独自の強みは何ですか?

- 優れた編集精度: Qwen-Image Editは、高度なインペインティング、アウトペインティング、オブジェクト操作アルゴリズムを搭載しており、非常に正確でシームレスな編集を実現します。大幅な変更を加えても、視覚的な一貫性を維持することに優れています。

- コンテキスト認識編集: 重要な強みはコンテキスト認識です。例えば、オブジェクトを削除すると、周囲の環境に論理的に溶け込むコンテンツでその空白部分をインテリジェントに埋めるため、編集がほとんど気づかれません。

- スタイルの転送と調和: Qwen-Image Editは、ある画像から別の画像にスタイルを転送したり、画像内のさまざまな要素を調和させて統一感のある外観を作り出すのに非常に効果的です。これは、多様なビジュアルアセットを扱うデザイナーにとって非常に役立ちます。

- 堅牢なオブジェクトの削除/追加: 照明、影、遠近感を維持しながらオブジェクトを追加または削除する機能は非常に優れており、複雑なシーンの再構築や整理整頓が可能になります。

- 画像のアップスケールと強化: 多くの場合、品質を損なうことなく画像を拡大し、詳細、色、全体的な視覚的魅力を高める高度な機能が含まれています。

Qwen-Image Edit の潜在的な弱点は何ですか?

- 初期世代の焦点: 画像生成機能も備えていますが、その強みと最適化は主に編集機能に重点が置かれています。初期のテキストから画像への生成機能は優れているかもしれませんが、バージョンによっては、純粋に画像生成に特化したモデルほど創造性に富み、写実的ではない可能性があります。

- 高度な機能の学習曲線: 編集ツールの精度と奥深さは、高度な画像操作の概念に馴染みのないユーザーにとっては、少し急な学習を必要とするかもしれません。

- 複雑な編集にかかるリソースの強度: 非常に複雑な多層編集は依然として計算負荷が高く、非常に大規模または複雑なタスクでは処理時間が長くなる可能性があります。

Flux Kontext はイメージ AI にどのような革新をもたらしますか?

それは何ですか: FluxのKontext(FLUX.1 Kontextとして販売されることもある)は、デザイナーやブランドチーム向けの画像編集/生成ツールです。 コンテキスト認識編集正確なタイポグラフィ、スタイルの転送、反復的なデザイン作業のための緊密な UI/UX を実現します。

Flux Kontext の強みは何ですか?

- 文脈的結束: Flux Kontext の最大の強みは、複数の画像生成や編集をまたいでコンテキストを理解し、維持する能力です。これは、視覚的な調和が不可欠な、一貫性のあるビジュアルナラティブ、キャラクターデザイン、製品ラインの作成に非常に役立ちます。

- シリーズの一貫性の向上: 共通のスタイル、キャラクター、または環境を共有する一連の画像を生成する必要がある場合、Flux Kontext は他のモデルに影響を及ぼす可能性のある不一致を減らすことを目的としています。

- アダプティブスタイリング: 以前に生成された画像や定義されたスタイル ガイドに基づいて出力を調整できるため、クリエイティブ プロセスがより合理化され、反復が少なくなります。

- ブランドとナラティブに特化: 統一されたビジュアルアイデンティティが重要なマーケティング、ブランディング、ストーリーテリングに特に役立ちます。

- 文脈における迅速な理解: 即座に理解できるのは、現在のイメージだけではなく、それがより大きなコンテキストや命令セットにどのように適合するかということです。

Flux Kontext の制限は何ですか?

- ニッチに焦点を当てる可能性: コンテキストと一貫性を重視しているため、それが唯一の要件である場合、生のスタンドアロンのフォトリアリズムまたは極端な芸術的多様性の絶対的なリーダーであるとは限りません。

- あまり公開されていないベンチマーク: より新しい、またはより専門化されたプレーヤーの場合、より確立されたモデルと比較して、広範な公開ベンチマーク データが利用しにくい可能性があります。

- 明確なコンテキスト入力に依存: その強みを活かすには、ユーザーは明確なコンテキスト情報を提供するか、物語の枠組みを効果的に定義する必要があり、そのためには異なるプロンプトのアプローチが必要になる場合があります。

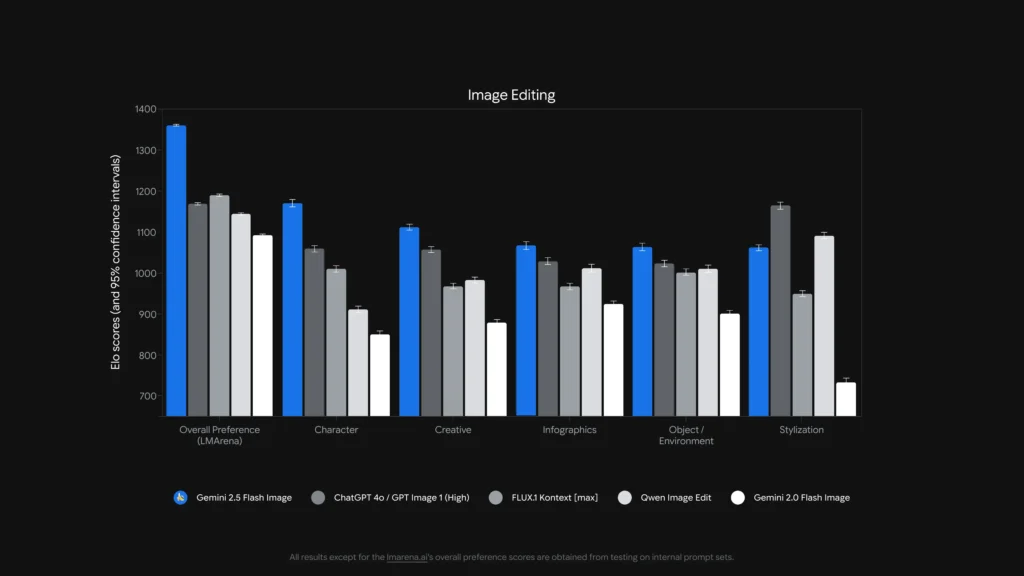

画像編集に最適なモデルはどれですか?

シングルの場合、 正確なマスクレス編集 および 画像内のテキスト編集, Qwen-画像編集 および ジェミニ2.5のフラッシュイメージ (FLUX.1 Kontextのような特殊モデルも)は最も強力なものの一つです。 複雑な複数ステップの連鎖編集命令を強力に実行する LLM フロントエンド (Gemini または GPT バリアント) と画像モデルを組み合わせると、多くの場合、最良の結果が得られます。いくつかのベンチマーク作業では、Chain-of-Thought スタイルのプロンプト (Gemini-CoT) によって、複数ステップの編集の成功率が向上することが示されています。

ローカル編集、文字の一貫性、テキスト処理

- Qwen-画像編集 明確に両方をターゲットにしている セマンティック および 外観 編集(例:オブジェクトの置き換え、回転、正確なテキストの置き換え)は、明示的に 画像編集 二重経路(Qwen2.5-VLによる意味制御とVAEエンコーダによる外観制御)を備えたモデル。堅牢なバイリンガル(中国語/英語)を謳っています。 画像内のテキスト編集 (例: 看板のテキストや製品ラベルの変更) スタイルを維持しながら、ローカリゼーションやパッケージング作業では珍しく価値のある機能を実現します。

- ジェミニ2.5のフラッシュイメージ マスク編集、プロンプトに基づくローカル編集(背景のぼかし、人物の削除、ポーズの変更)、複数画像の融合をサポートしています。Googleは、プロンプトに基づく領域認識編集に加え、世界知識の利点(例:現実世界の物体のセマンティクスの向上)を宣伝しています。このモデルはまた、 目に見えないSynthID透かし 生成/編集された画像に、出所と検出の助けとなるようにする。

- FLUX.1 コンテキスト: 画像間のコンテキストソルバーとして位置づけられており、コンテキストを考慮した正確なローカル編集と反復的な実験に最適化されています。レビュー担当者は、ローカルな変更を加えながらコンテキストとシーンのセマンティクスを維持する機能を高く評価しています。FLUX.1 Kontext と Flux Kontext UI は、反復編集ワークフローとテキストの読みやすさに関する実用テストで高い評価を得ており、多数の迅速な反復処理を必要とするワークフロー(マーケティングアセット、サムネイルなど)にとって実用的な選択肢となっています。

- GPTイメージ1: 編集操作 (編集用のテキスト+画像プロンプト) をサポートし、OpenAI のツールは連鎖とプロンプト エンジニアリング パターンを統合します。パフォーマンスは強力ですが、プロンプト エンジニアリングに依存しており、一部のテストではきめ細かな編集 (正確なバイリンガル テキスト置換など) において特殊な編集優先モデルに遅れをとる場合があります。

ベンチマークなど ComplexBench-Edit および コンプベンチ 編集が連鎖的または相互依存的である場合、多くのモデルが依然として失敗することを示していますが、命令解析用のLLMと堅牢な画像モデル(LLM→画像モデルオーケストレーション)を組み合わせたり、CoTプロンプトを使用したりすることで、失敗を減らすことができます。そのため、一部の実稼働ワークフローでは、ハード編集のためにモデルを統合(例えば、推論用LLMと画像ジェネレーターを組み合わせ)しています。

画像内のテキスト編集が最も得意なのは誰でしょうか?

- Qwen-画像編集 中国語と英語のバイリンガルテキスト編集に特化した設計で、テキスト編集ベンチマーク(Qwenの公開技術ノートと報告スコア)において優れた結果を報告しています。オープンソースのQwen成果物とデモでは、編集中にフォント、サイズ、スタイルが正確に保持されることが示されています。

- gpt-image-1 および ジェミニ2.5のフラッシュイメージ どちらもテキストレンダリングにおいては進歩していますが、学術的なベンチマークやベンダーのメモによると、小さい/詳細なテキストや長いテキストの部分については課題が残っています。改善は漸進的であり、プロンプトや解像度によって異なります。

比較分析:特集、編集

より明確なイメージを提供するために、これらの主要な AI モデルの主な側面を比較表にまとめてみましょう。

| 機能 | GPT-image-1 (OpenAI) | Gemini-2.5-Flash-Image(Google) | Qwen-Image-Edit(アリババ) | FLUX.1 コンテキスト |

|---|---|---|---|---|

| ネイティブ生成 + 編集 | はい。1つのAPIでマルチモーダルテキスト+画像を提供します。 | はい - ネイティブ生成とターゲット編集、複数画像の融合と文字の一貫性を重視します。 | に焦点を当てた 編集 (Qwen-Image-Edit) セマンティック+外観コントロール付き。 | 画像間の高忠実度編集に重点を置いています。 |

| 編集の深さ(ローカル調整) | 高い(ただしジェネラリスト) | 非常に高い(対象を絞ったプロンプト + マスクなし編集) | セマンティック/テキスト編集(バイリンガルテキストのサポート)の場合、非常に高い。 | 非常に高い - コンテキスト認識編集パイプライン。 |

| 画像内のテキスト処理 | 良い、プロンプト次第 | 改善されました(ベンダーがテンプレートとサイン編集のデモを表示) | おすすめ! これらの中から、バイリンガルで読み取り可能なテキストの変更を行います。 | スタイルの保持には優れていますが、読みやすさはプロンプトに依存します。 |

| 文字とオブジェクトの一貫性 | 注意深く促すと良い | 強い (明示的な機能) | 中(マルチイメージのアイデンティティよりも編集に重点が置かれています) | 反復編集ワークフローにより強力になります。 |

| レイテンシ/スループット | 穏健派 | 低レイテンシ/高スループット (フラッシュモデル) | ホスティングによって異なります(ローカル/HF vs クラウド) | ホスト型 SaaS での高速な反復編集向けに設計されています。 |

| 来歴/透かし | 強制的な透かしなし(ポリシーメカニズム) | SynthIDの目に見えない透かし 画像用です。 | ホストによって異なります | ホストによって異なります |

注意: 「編集の深さ」は、実際にどの程度きめ細やかで信頼性の高いローカル編集が行われているのかを測定します。「テキスト処理」は、画像内に読みやすいテキストを配置/変更する能力を評価します。

レイテンシー、開発者の人間工学、エンタープライズ統合についてはどうでしょうか?

レイテンシと展開オプション

- ジェミニ2.5のフラッシュイメージ 強調 低レイテンシ Gemini API、Google AI Studio、Vertex AIから利用可能で、予測可能なスループットとクラウド統合を必要とするエンタープライズアプリに最適です。Googleはイメージごとのトークンのおおよその価格も発表しています(開発者ブログにはイメージごとの価格例が掲載されています)。

- gpt-image-1 OpenAI Images API経由で利用可能で、幅広いエコシステム(Playground、Adobe/Canvaなどのパートナー)と連携しています。価格はトークン化されており、画像品質の階層によって異なります(OpenAIはトークンからドルへの換算を公開しています)。

- フラックスコンテキスト 高速でインタラクティブな UX に重点を置いており、製品デモではクレジットと編集時間の短縮が提供されるため、デザイナーや素早い反復作業に便利です。 クウェン オープンな成果物と研究アクセスを提供します (自己ホストまたは内部を検査する場合に最適です)。

これらのサービスの料金はいくらですか?どちらがお得でしょうか?

価格は頻繁に変更されます。以下は、発行者が発表した数値(2025 年 XNUMX 月)と、ベンダーが公開した代表的な画像あたりのコスト計算です。

公表価格(ベンダーの明細書)

| モデル/ベンダー | 公開価格スナップショット(公開済み) | 画像ごとの概算 |

|---|---|---|

| gpt-image-1 (OpenAI) | トークン化された価格設定(テキスト入力5万ドルあたり1ドル、画像入力10万ドルあたり1ドル、画像出力40万ドルあたり1ドル)。OpenAIは、これはおおよそ以下のようになると述べている。 $ 0.02- $ 0.19 生成された画像ごとに品質/サイズに応じて異なります。 | 約$0.02(低品質/サムネイル)→ 約$0.19(高品質スクエア) |

| ジェミニ 2.5 フラッシュイメージ (Google) | 30万出力トークンあたり1ドル 例えば、各画像≈1290出力トークン(〜$0.039 開発者ブログによると、1画像あたり100ドル(約1500円)です。料金はGemini API / Vertex経由で適用されます。 | ~$0.039 画像あたり(Googleの例) |

| Flux Kontext(フラックス) | クレジット付きの無料プラン。Flux製品ページには 10の無料クレジット 通常の編集料金は 5クレジット; ヘビーユーザー向けにサブスクリプション層が用意されています。(ベンダー製品ページ)。 | 時々編集する場合は非常に低コスト、頻繁に使用する場合はサブスクリプションが必要です。 |

| Qwen-イメージ編集 (QwenLM) | オープンリリースとGitHubアーティファクト:無料のサンプルを含む研究のためのオープンアクセス。商用展開はインテグレーターによって異なります(セルフホスト型とクラウド型)。イメージあたりの価格は一律ではなく、セルフホスト型が最も安くなる傾向があります。 |

値の解釈: 大量の画像が必要な場合 世代 本番環境で使用していて、イメージごとの価格を予測したい場合、Googleのイメージごとのサンプルは非常に競争力があります。コストの大部分が人間による編集やデザイナーの反復作業に費やされている場合は、Flux または Qwen をローカルで実行する方が経済的かもしれません。OpenAI は幅広い SDK エコシステムと多くのパートナーを提供しており、統合の利便性を考えると上位プランを選択する価値があります。

CometAPIの価格

| モデル | GPTイメージ1 | ジェミニ 2.5 フラッシュイメージ | FLUX.1 コンテキスト |

| 価格 | 入力トークン $8.00; 出力トークン $32.00 | $0.03120 | フラックスコンテキストプロ: $0.09600 フラックスコンテキスト最大値: $0.19200 |

最高の結果を得るための実用的なクイックヒント

プロンプトとワークフローのヒント(すべてのモデルに適用)

- 構成を明確にするカメラアングル、照明、雰囲気、焦点距離、レンズ、物体間の空間関係など。例: 「35mmのクローズアップ、浅い被写界深度、被写体を中央に配置、左上からのソフトなリムライト。」

- 編集には反復的な改良を使用する: まず大まかな構造編集を行い、その後テクスチャとライティングの微調整を行います。FLUXやGeminiのようなモデルは、複数段階の微調整をサポートするように構築されています。

- 画像内のテキストの場合: 必要なテキストを正確に入力し、「リアルなエンボス加工を施した高コントラストの読みやすい看板としてレンダリングする」を追加します。中国語/英語の忠実度が必要な場合は、バイリンガル編集で Qwen-Image-Edit を使用します。

- 参照画像を使用するキャラクターの一貫性や製品のバリエーションを確認するには、高品質の参考画像と「reference_01のキャラクターの顔の特徴、衣装の色、照明を一致させる」といったアンカープロンプトを提供します。GeminiとFluxは、複数の画像の融合と一貫性を重視しています。

- マスク編集とマスクレス編集: 可能であれば、編集を厳密に制限するためにマスクを使用してください。マスクレス編集を使用する場合は、時折スピルオーバーが発生する可能性があります。モデルによって処理方法が異なります。Flux/Geminiはマスクレス編集を適切に処理しますが、マスクは依然として役立ちます。

- GPTイメージ / GPT-4o 複数のオブジェクト、数、空間的制約を伴う複雑な構成プロンプトの場合。可能であれば、世代ごとに単一の正確な指示を使用してください。

コストとレイテンシーに関するヒント

バッチ処理: バッチAPIまたはクラウド関数を使用して、多数のバリアントを効率的に生成します。Gemini-2.5-Flashは、大量のデータが必要な場合にスループットを最適化するために設計されています。

チューニングの品質と価格: OpenAI は低/中/高品質の画像層を公開します。低品質で下書きを生成し、高品質で完成させます。

最終的な評決

- 生産と統合に最適: GPT-画像-1 — API ニーズ、合成、プロフェッショナル ツールへの統合に最適です。

- 消費者にとってフォトリアルな一貫性に最適: ナノバナナ — Google の Gemini 画像アップグレードは、自然で連続的なポートレート編集と使いやすい UX が優れています。

- 最高のモバイル/エディターエクスペリエンス: フラックスコンテキスト — 電話での会話をスムーズに編集できます。

- 精密なテキスト編集とバイリンガル/多言語編集を基準とする場合 → Qwen-Image-Edit** がトップの専門家であり、画像内のテキストの正確さが重要な場合に最適な選択肢です。

スタートガイド

CometAPIは、OpenAIのGPTシリーズ、GoogleのGemini、AnthropicのClaude、Midjourney、Sunoなど、主要プロバイダーの500以上のAIモデルを、開発者にとって使いやすい単一のインターフェースに統合する統合APIプラットフォームです。一貫した認証、リクエストフォーマット、レスポンス処理を提供することで、CometAPIはAI機能をアプリケーションに統合することを劇的に簡素化します。チャットボット、画像ジェネレーター、音楽作曲ツール、データドリブン分析パイプラインなど、どのようなアプリケーションを構築する場合でも、CometAPIを利用することで、反復処理を高速化し、コストを抑え、ベンダーに依存しない環境を実現できます。同時に、AIエコシステム全体の最新のブレークスルーを活用できます。

開発者はアクセスできる GPTイメージ1, FLUX.1 コンテキスト および ジェミニ2.5のフラッシュイメージ CometAPIを通じて、記事の公開日時点での最新モデルのバージョンが掲載されています。まずは、モデルの機能について調べてみましょう。 プレイグラウンド そして相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

最新の統合 Qwen-画像編集 CometAPIに近日公開予定ですので、お楽しみに!画像編集を始める準備はできましたか?→ 今すぐCometAPIに登録しましょう !

CometAPIの価格

| モデル | GPTイメージ1 | ジェミニ 2.5 フラッシュイメージ | FLUX.1 コンテキスト |

| 価格 | 入力トークン $8.00; 出力トークン $32.00 | $0.03120 | フラックスコンテキストプロ: $0.09600 フラックスコンテキスト最大値: $0.19200 |