2025年7月28日、北京拠点のスタートアップ Zhipu AI は、オープンソースの大規模言語モデルである GLM‑4.5 シリーズを正式に発表し、同社史上最も強力なリリースとなった。今回のシリーズは高度なインテリジェントエージェントアプリケーションをターゲットとしている。この発表は World Artificial Intelligence Conference (WAIC) に続くライブのオンラインイベントで行われ、2つのバリアントが披露された。フルスケールの GLM‑4.5 は総パラメータ 355 billion(アクティブ 32 billion)を備え、よりコンパクトな GLM‑4.5‑Air は総パラメータ 106 billion(アクティブ 12 billion)を特徴とする。両モデルは、深い推論と迅速な応答のバランスを図るために「思考型」と「非思考型」を組み合わせたハイブリッドの推論アーキテクチャを採用し、幅広い会話およびタスク指向のユースケースに向けて 128,000‑token のコンテキストウィンドウを提供する。

GLM‑4.5 のローンチは、激化する国内 AI 競争の最中に到来した。中国の国営 Xinhua News Agency によれば、2025年7月時点で中国の開発者は 1,509 の大規模言語モデルをリリースしており、世界全体の 3,755 モデルの中で先頭に立っている—これは中国の AI エコシステム拡大の規模とスピードを如実に示している。

Open‑Source Licensing of GLM-4.5

クローズドかつプロプライエタリなパラダイムからの明確な転換として、Z.ai は GLM‑4.5 をMIT‑style, fully auditable open‑source license(MIT スタイルの、完全監査可能なオープンソースライセンス)の下でリリースし、企業にモデルのウェイトや学習コードへの完全な透明性を提供する。組織は GLM‑4.5 をon‑premise(オンプレミス)でデプロイし、独自データセットでファインチューニングしたり、自前の推論サービス経由で統合することができ、これによりベンダーロックインや不透明な API 料金体系を回避できる。

汎用のエージェントタスク向けのGLM‑4.5と、低リソース環境向けに最適化された軽量バリアントであるGLM‑4.5‑Airの両方を提供することで、大規模データセンターでの導入からエッジデバイスでの推論シナリオに至るまで、幅広いユースケースに対応できる。

戦略的には、Zhipu のオープンソースアプローチは、OpenAI のようなクローズドソースの欧米系既存大手に対抗する位置づけとなる。MIT ライセンスの下で GPT‑4 に匹敵するモデルへのアクセスを民主化することで、Zhipu はダウンストリームの開発者コミュニティを育成し、エージェント AI 能力の技術的ベンチマークを打ち立てることを目指している。業界の観測筋は、Moonshot AI や Step AI を含む中国の “AI Tigers” の間で見られる、イノベーションサイクルを加速させるために大規模モデルをオープンソース化するというより広範な潮流に、この動きが続いていると指摘している。

Performance Benchmarks and Comparative Analysis

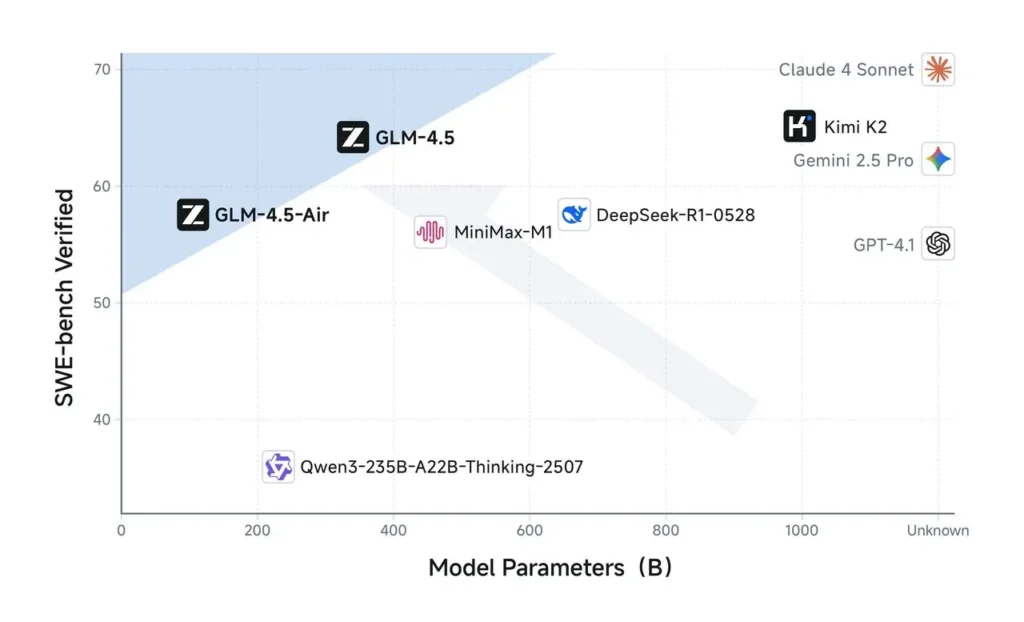

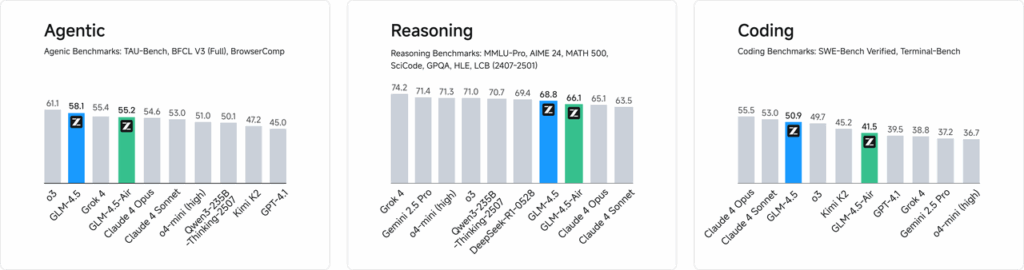

Zhipu AI が提示した予備ベンチマークによると、GLM‑4.5 は 12 の業界標準評価スイート全体で総合スコア 63.2 を達成し、オープンソースとプロプライエタリの両モデルを含めたランキングで第3位につけた。一方、スリム化された GLM‑4.5‑Air は 59.8 を記録し、効率性と高精度のバランスを実現している。社内のコーディング評価でも、GLM‑4.5 は主要競合を上回り、52 の多様なプログラミングタスク全体で Kimi K2 に対して 53.9% の勝率、Qwen3‑Coder に対して 80.8% の成功率を収めた。

ライブイベント中のデモンストレーションは、GLM‑4.5 のエージェント能力を強調した。モデルは自律的にウェブリサーチを実行し、複数のソースから情報を取得・統合したほか、シミュレートされたソーシャルメディア環境や開発環境と連携して投稿の生成、コードスニペットの実行、ユーザーインターフェース要素のリアルタイム操作を行った。関心のあるユーザーは、Zhipu の Qingyan ポータルおよび CometAPI プラットフォーム経由で、フルスケールモデルを無料で即時に試用できる。開発者は、CometAPI の BigModel サービス上の API エンドポイントにアクセスするか、MIT ライセンスの下で Hugging Face と ModelScope から完全なモデルウェイトをダウンロードできる。

コスト効率は Z.ai の戦略の中核である。15 trillion‑token のコーパスで学習された GLM‑4.5 は、最適化された推論パスを活用して毎秒 100–200 tokens のスループットを実現し、国内の同等競合と比べ最大で 8 倍の速度を達成している。価格は 100万トークンあたりわずか $0.11 とされ、DeepSeek‑R1 や Alibaba の最新リリースといったモデルを下回る価格設定だ。パーミッシブな MIT ライセンスの下、すべてのモデルウェイト、コード、ドキュメントは Hugging Face を通じて無償で入手可能であり、世界中の開発者と研究コミュニティの活性化を目指している。

「GLM‑4.5 は、最高水準の AI 技術へのアクセスを民主化するという当社のコミットメントを体現しています」と Z.ai の CEO である Zhang Peng は CNBC のインタビューで述べた。「推論、コーディング、そしてエージェント機能に優れたモデルをオープンソース化することで、あらゆる規模の組織が、プロプライエタリな API や高額なコストの制約を受けることなくイノベーションを進められるようにします。」

Getting Started

CometAPI は、OpenAI の GPT series、Google の Gemini、Anthropic の Claude、Midjourney、Suno など、主要プロバイダーの 500 以上の AI モデルを単一の開発者フレンドリーなインターフェースに集約した統合 API プラットフォームである。認証、リクエスト整形、レスポンス処理を一貫化することで、CometAPI はアプリケーションへの AI 機能統合を大幅に簡素化する。チャットボット、画像生成、音楽生成ツール、データドリブンな分析パイプラインのいずれを構築する場合でも、CometAPI によって反復を加速し、コストを抑制し、最新の AI エコシステムのブレークスルーを活用しながらベンダーアグノスティックであり続けることができる。

開発者は CometAPI を通じて GLM‑4.5 API にアクセスでき、掲載されている最新の claude モデルのバージョンは記事の掲載日時点のものです。開始するには、Playground でモデルの機能を試し、詳細な手順については API guide を参照してください。アクセス前に、CometAPI にログインし API キーを取得していることを確認してください。CometAPI は、統合を支援するために公式価格よりはるかに低い価格を提供しています。