Google DeepMind 2026 жылғы 2 сәуірде Gemma 4 моделін ресми түрде шығарды — бұл ашық бастапқы кодты ЖИ саласындағы маңызды белес. Бұл модельдер отбасы параметрге шаққандағы алдыңғы қатарлы интеллектті ұсынады, Gemini 3-ті қуаттандыратын сол зерттеу мен технологиялар негізінде құрастырылған. Бұрынғы Gemma нұсқалары арнайы лицензиялармен келсе, Gemma 4 толық рұқсатты Apache 2.0 лицензиясымен таратылады, бұл коммерциялық пайдалануға, түрлендіруге және қайта таратуға шектеусіз мүмкіндік береді.

Gemma 4 мультимодаль мүмкіндіктерімен (барлық өлшемдерде мәтін + сурет кірістері, ал шеткі модельдерде аудио), кеңейтілген пайымдау мен агенттік жұмыс ағымдарына жергілікті қолдаумен, 256K токенге дейінгі ұзын контекстімен және смартфондар мен Raspberry Pi-дан бастап жоғарғы деңгейлі GPU-ларға дейін бәріне оңтайландырылуымен ерекшеленеді. Ол 140-тан астам тілді қолдайды және тиімділікке басымдық береді, бұл қуатты ЖИ-ды бұлтқа тәуелділіксіз тұтынушы және шеткі құрылғыларда қолжетімді етеді.

CometAPI ашық және жабық бастапқы кодты модельдерге тамаша API ұсынады.

Gemma 4 деген не?

Gemma 4 — Google DeepMind-тың ашық мультимодальды ірі тілдік модельдер (LLM) отбасының ең жаңа мүшесі, күрделі пайымдау, агенттік ЖИ жұмыс ағымдары және құрылғыда тиімді орналастыру үшін арнайы жасалған. Ол меншікті Gemini 3 зерттеуінен алынған тұжырымдарды пайдалана отырып “әр параметрге шаққандағы интеллектті” барынша арттырады, сонымен бірге толықтай ашық салмақтармен және ашық бастапқы кодпен таратылады.

Алдыңғы Gemma моделдерімен салыстырғандағы негізгі жетістіктер:

- Түпнұсқа мультимодалдылық: Барлық модельдерде мәтін + суретті түсіну, шағын шеткі нұсқаларда аудио қолдау.

- Бапталатын ойлау режимі: Қадам-қадамымен пайымдау және құрылымданған <|think|> шығарысы.

- Түпнұсқа функция шақыру және құралдарды пайдалану: Автономды агенттер үшін таптырмас.

- Ұзартылған контекст: Ірі модельдерде 256K токенге дейін.

- Гибридті назар архитектурасы: Тиімділік пен ұзын контекст өнімділігі үшін локалды сырғымалы терезе мен жаһандық назарды біріктіреді.

- Кіші модельдерде Per-Layer Embeddings (PLE) және ортақ KV-кэш — жадты үнемдеу үшін.

- Кең көптілді қолдау: 140+ тілді қамтитын мәліметтерде алдын ала үйретілген, мәдени реңктерді ескереді.

Apache 2.0 бойынша шығарылуы Gemma 4-тен кәсіпорындар үшін кедергі болған алдыңғы лицензиялық шектеулерді алып тастайды. Енді әзірлеушілер қиындықсыз fine-tune жасап, орналастырып, коммерцияландыра алады — бұл оны Llama және Qwen сияқты толық ашық экожүйелердің тікелей бәсекелесіне айналдырады.

Gemma 4 әркелкі аппараттық құралдарды нысанаға алады: шеткі құрылғылар (телефондар, IoT, Raspberry Pi, Jetson Nano) — төмен кідірісті офлайн ЖИ үшін, ал жұмыс станциялары/GPU-лар — жоғары өнімді жергілікті серверлер үшін. Бұл жергіліктіге басымдық беретін дизайн құпиялықты, шығындарды азайтуды және нөлдік кідіріс инференсін бірінші орынға қояды.

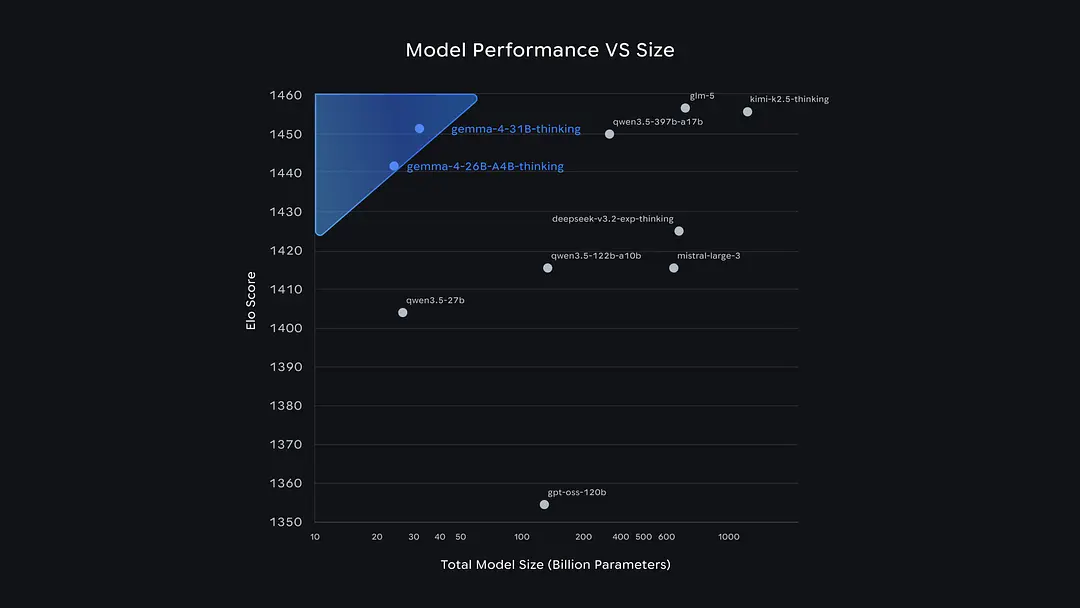

Одан жоғары орында тұрған ашық бастапқы кодты модельдердің көбі Arena көшбасшылартізімінде Қытай командаларынан. Gemma 4 Qwen 3.5 және GLM-5-тен онша алшақ емес, бірақ OpenAI-дың GPT-OSS-120B моделінен едәуір өзгеше.

Әзірлеушілер енді CometAPI-де GLM-5, Qwen 3.5 және т.б. таба алады.

Gemma 4-тің төрт нұсқасы

Google Gemma 4-ті өнімділік, тиімділік және орналастыру сценарийлерін теңестіретін төрт мұқият оңтайландырылған өлшемде шығарды. Екеуі шеткі тиімділік үшін жаңашыл Per-Layer Embeddings (PLE) бар тығыз архитектураны қолданады; бірі — төмен белсенді параметрлік құнымен жоғары өнімділікке арналған Mixture-of-Experts (MoE); және бірі — тығыз флагман.

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Text, Image, Audio | Smartphones, Raspberry Pi, edge IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Text, Image, Audio | Mobile devices, lightweight GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Image | Workstations, consumer GPUs, local servers |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Image | High-end GPUs (fits on single H100/A100 in FP16) |

Gemma 4 E2B және E4B (шеткі құрылғыларға оңтайландырылған): PLE-ді қабаттық мамандану үшін аз параметрлік артық жүктемемен қолданады. Батареямен жұмыс істейтін немесе жад шектеулі құрылғыларға өте қолайлы. Аудио энкодер (USM-style Conformer, ~300M параметр) сөйлеуді мәтінге айналдыруды және аударманы мүмкін етеді.

Gemma 4 26B A4B (MoE): Инференс кезінде 25B+ жалпы өлшемге қарамастан шамамен 4B параметрді ғана белсендіреді. Едәуір төмен есептеу құнымен 31B-ға жуық өнімділік береді — тиімді масштабтау үшін мінсіз.

Gemma 4 31B (тығыз): Ең жоғары қабілетке арналған флагман. Толық дәлдікте 80GB жалғыз GPU-ға сыйып, көшбасшылартізімдердегі ең үздік ашық модельдердің қатарында.

Барлық модельдерде чат, пайымдау және құрал қолдануға оңтайландырылған нұсқаулыққа бейімделген (“-it”) варианттар бар, сондай-ақ fine-tune үшін алдын ала үйретілген базалық нұсқалар ұсынылады. Екі үлкен модель әртүрлі тәсіл қолданады: 31B тығыз модель — ең жоғары сапаны көздейді және fine-tune үшін ең жақсы база; 26B MoE модель — жылдамдыққа басымдық береді, инференс кезінде небәрі 3.8 миллиард параметрді іске қосып, сөз генерациясын әлдеқайда жеделдетеді, бірақ жалпы сапасы сәл төмен.

Екі кіші модель — E2B және E4B — әсіресе мобильді телефондар мен IoT құрылғылары үшін жасалған: олар толық офлайн жұмыс істеп, жад пен қуатты үнемдейді. Бұдан бөлек, бұл кіші модельдерде үлкендерде жоқ мүмкіндік бар: түпнұсқа аудио енгізу, яғни тікелей сөйлеуді тану.

Gemma 4-тің негізгі мүмкіндіктері

Gemma 4 нақты қолданбалар үшін маңызды бағыттарда үздік көрсеткіш көрсетеді:

1. Кеңейтілген пайымдау және ойлау режимі

Жүйелік нұсқаулар арқылы немесе enable_thinking=True көмегімен бапталатын қадамдық пайымдау. Құрылымданған <|think|> тегтері және соңғы жауаптар шығарады. Қосымша fine-tune қажет етпей күрделі тапсырмалардағы өнімділікті едәуір арттырады.

2. Мультимодальды түсіну

- Көру: Объектілерді анықтау (JSON шекара қораптары), OCR (көптілді), құжат/PDF талдау, диаграммаларды түсіну, UI түсіну, қолжазбаны тану және айнымалы рұқсаттағы кескіндерді өңдеу (токен бюджеттері: 70–1120 токен).

- Бейне: 60 секундқа дейін (1 кадр/с өңдеу).

- Аудио (тек E2B/E4B): Автоматты сөйлеуді тану (ASR) және сөйлеуден мәтінге аудару (макс 30с).

- Аралас енгізулер: Мәтін, сурет және аудионы кез келген ретпен араластыру.

3. Агенттік жұмыс ағымдары және функция шақыру

Түпнұсқа құрал қолдану көпқадамды жоспарлау, API шақыру, қолданбаларда шарлау және тапсырмаларды орындау үшін автономды агенттерді мүмкін етеді. τ2-bench-те (agentic tool use) жоғары нәтиже көрсетеді.

4. Кодтау және әзірлеуші құралдары

Код генерациясы, толықтыру, жөндеу және репозиторий деңгейінде түсінуде үздік. Ыңғайлы интеграция үшін JSON-құрылымды шығыстарды қолдайды. LiveCodeBench v6 бойынша 80.0% (31B) нәтижеге ие, бұл оны офлайн әзірлеу сценарийлеріне лайық жергіліктіге бағытталған бағдарламалау көмекшісі ретінде орнықтырады.

5. Ұзын контекст және көптілділік

128K–256K токендерді сенімді өңдейді (MRCR needle-in-haystack бойынша сыналған). 2025 жылғы қаңтарға дейінгі алуан түрлі деректерде алдын ала үйретілген, күшті кросс-лингвистикалық өнімділікке ие. Бұл жай аударма ғана емес; 140+ тілді нативті қамтиды.

Өлшеу деректері: Gemma 4 өнімділік талдауы

Gemma 4 ашық модельдер үшін жаңа стандарттар орнатады. 31B және 26B варианттары бұрын тек әлдеқайда ірі меншікті жүйелерге тән ұпайларды көрсетсе, шеткі модельдер Gemma 3-тің ірі алдыңғы нұсқасын басып озды.

Толық эталон нәтижелері (нұсқаулыққа бейімделген модельдер)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (ойлау режимі жоқ) |

|---|---|---|---|---|---|---|

| MMLU Pro | Reasoning & Knowledge | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Math | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Graduate-level Science | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentic Tool Use | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Coding | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Competitive Coding | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal Reasoning | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Math + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Long Context | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Негізгі тұжырымдар:

- Gemma 3-тен үлкен секіріс: 31B моделі AIME математикасын 20.8%-дан 89.2%-ға, ал LiveCodeBench-ті 29.1%-дан 80.0%-ға көтерді.

- MoE тиімділігі: 26B A4B инференс кезінде әлдеқайда аз есептеу қолдана отырып, 31B-ға жақын көрсеткіш береді.

- Шеткі үстемдік: E4B және E2B Gemma 3 27B-дан көптеген метрикада басым, өлшем бойынша 6–10 есе кіші болса да.

- Көшбасшылартізімдер: 31B шамамен 1452 ұпай (Arena AI, мәтін); 26B A4B шамамен 1441. 26B варианты пайдаланушы талғамы мен кодтау бойынша Qwen 3.5 397B сияқты әлдеқайда ірі модельдерді басып озғаны хабарланады.

Көру және аудио эталондары арнайы fine-tune жасамай-ақ, қораптан шыққаннан кейінгі күшті мультимодаль өнімділікті растайды.

Экожүйе және құрал қолдауы

Gemma 4 бірден және кең экожүйелік интеграцияға ие:

- Hugging Face: Бірінші күннен қолдау —

transformers,pipeline("any-to-any"), GGUF, ONNX және мультимодальды процессорлар. - Жергілікті рантаймдар: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon with TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU браузер инференсі).

- Fine-Tuning: TRL, Unsloth, PEFT, Vertex AI және толық мультимодаль датасет қолдауы.

- Аппараттық оңтайландыру: NVIDIA RTX/DGX Spark/Jetson (TensorRT-LLM арқылы), Google AI Edge tools және Android/iOS құрылғыда орналастыру.

- Агенттік фреймворктер: OpenClaw, Hermes, Pi және CARLA симуляциялық тестілеуі.

- Бұлт/Студия: Жылдам сынау үшін Google AI Studio; жүктеу үшін Kaggle Models.

Бұл экожүйе Gemma 4-ті ноутбуктерге, серверлерге немесе шеткі құрылғыларға бірнеше минутта орналастыруға мүмкіндік береді.

Шектеулер және қауіпсіздік:

- Оқыту деректерінің шегі: 2025 жылғы қаңтар (құралдарсыз нақты уақыттағы білім жоқ).

- Аудио тек сөйлеумен шектелген (музыка емес); бейне 60 секундпен шектелген.

- Галлюцинация қаупі бар — ойлау режимін және тексеруді пайдаланыңыз.

- Қауіпсіздік: Google AI Principles бойынша қатаң сүзгілеу және бағалау; әзірлеушілер қолданбаға тән қорғаныс шараларын қосуы тиіс.

2026 жылы Gemma 4 неге маңызды

Gemma 4 алдыңғы қатарлы ЖИ-ды демократияландырады. Мультимодаль интеллект, агенттік мүмкіндіктер және Apache 2.0 еркіндігі аппараттық құралға тәуелсіз тиімділікпен ұштаса отырып, әзірлеушілер мен кәсіпорындарға ауқымды, қауіпсіз, жеке және үнемді ЖИ шешімдерін құруға мүмкіндік береді. Әсіресе шеткі модельдер кеше ғана флагман ашық модельдерді басып озған кезде байқалатын параметрге шаққандағы интеллекттегі серпіліс — шын мәнінде әмбебап ЖИ-ға қарай бетбұрысты білдіреді.

Телефонда 2B модельді немесе жергілікті 31B қуатты машинаны іске қоссаңыз да, Gemma 4 практикалық жағынан жабық баламаларға жетіп, көп жағдайда олардан асып түскенін дәлелдейді.