알리바바의 Qwen 팀이 출시되었습니다. Qwen3-Max-Preview(지시) — 현재까지 회사의 가장 큰 모델입니다. 1조 개 이상의 매개변수 — Qwen Chat, Alibaba Cloud Model Studio(API), 그리고 CometAPI와 같은 서드파티 마켓플레이스를 통해 즉시 사용할 수 있도록 제공되었습니다. 이 프리뷰는 극한의 규모와 매우 큰 컨텍스트 윈도우, 그리고 컨텍스트 캐싱을 결합하여 장시간 세션의 지연 시간을 낮게 유지함으로써 추론, 코딩 및 장문 문서 워크플로우를 목표로 합니다.

주요 기술적 하이라이트

- 엄청난 매개변수 수(조 개 이상): 1조 개 이상의 매개변수 모델로의 전환은 복잡한 패턴 학습(다단계 추론, 코드 합성, 심층 문서 이해) 용량을 늘리도록 설계되었습니다. Qwen이 발표한 초기 벤치마크는 Qwen의 이전 상위 모델 대비 추론, 코딩 및 벤치마크 스위트에서 향상된 결과를 보여줍니다.

- 매우 긴 컨텍스트 및 캐싱: The 262k 토큰 이 창을 통해 팀은 긴 보고서, 여러 파일로 구성된 코드베이스 또는 긴 채팅 기록 전체를 한 번에 처리할 수 있습니다. 컨텍스트 캐싱 지원은 반복되는 컨텍스트에 대한 반복적인 컴퓨팅을 줄이고, 장시간 세션의 지연 시간과 비용을 절감할 수 있습니다.

- 다국어 + 코딩 능력: Qwen3 제품군은 이중 언어(중국어/영어) 및 광범위한 다국어 지원을 강조하며, 더욱 강력한 코딩과 체계적인 출력 처리를 제공합니다. 이는 코드 지원, 자동 보고서 생성, 대규모 텍스트 분석에 유용합니다.

- 속도와 품질을 위해 설계되었습니다. 프리뷰 사용자들은 이전 Qwen3 모델에 비해 "눈부신" 응답 속도와 향상된 지시 수행 및 추론 능력을 칭찬합니다. 알리바바는 이 모델을 프로덕션급, 에이전트식 및 개발자 시나리오를 위한 고처리량 플래그십 모델로 포지셔닝합니다.

가용성 및 액세스

알리바바 클라우드 요금 계층형, 토큰 기반 Qwen3-Max-Preview 가격(입력 및 출력 요금은 별도). 과금은 토큰 백만 개 기준으로 부과되며, 무료 할당량 이후 실제 사용된 토큰에 적용됩니다.

Alibaba의 공개 미리보기 가격(USD)은 요청에 따라 구분됩니다. 입력 토큰 볼륨(동일한 계층에 따라 적용되는 단위 요금이 결정됨):

- 0–32K 입력 토큰: $0.861 / 1M 입력 토큰 및 $3.441 / 1M 출력 토큰.

- 32K–128K 입력 토큰: $1.434 / 1M 입력 토큰 및 $5.735 / 1M 출력 토큰.

- 128K–252K 입력 토큰: $2.151 / 1M 입력 토큰 및 $8.602 / 1M 출력 토큰.

CometAPI는 사용자가 API를 호출하는 데 도움이 되도록 공식적으로 20% 할인을 제공합니다. 자세한 내용은 다음을 참조하세요. Qwen3-Max-미리보기:

| 입력 토큰 | $0.24 |

| 출력 토큰 | $2.42 |

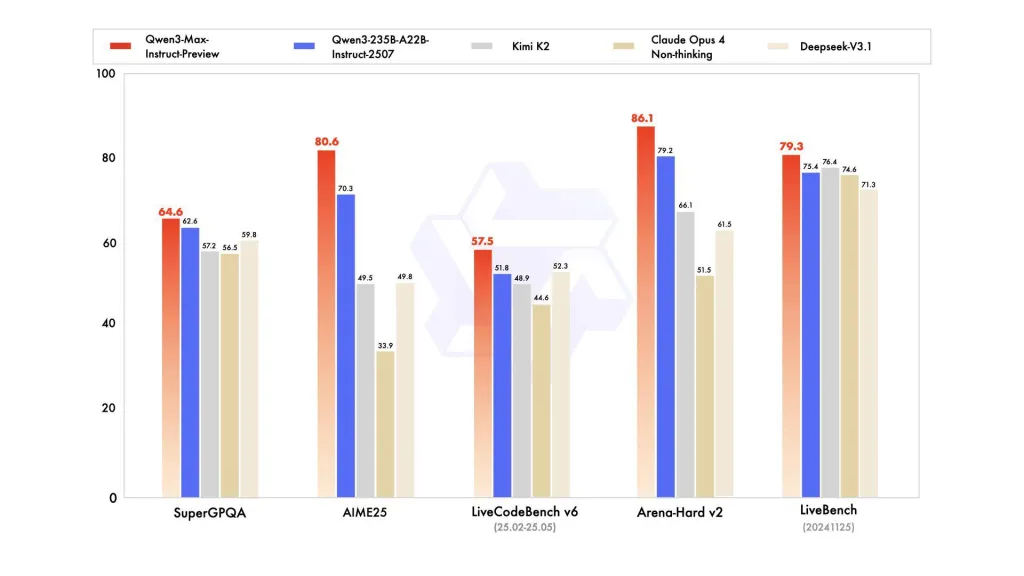

Qwen3-Max는 Qwen3 제품군(이전 빌드에서는 Mixture-of-Experts 변형 및 여러 활성 매개변수 계층과 같은 하이브리드 설계를 사용)을 확장합니다. Alibaba의 이전 Qwen3 출시는 "사고"(단계적 추론) 모드와 "지시" 모드 모두에 중점을 두었습니다. Qwen3-Max는 해당 제품군의 새로운 최고급 지시 변형으로 자리매김하여, Alibaba의 이전 최고 성능 제품인 Qwen3-235B-A22B-2507을 능가함을 보여주며, 1T 매개변수 모델이 다양한 테스트에서 우위를 점함을 보여줍니다.

SuperGPQA, AIME25, LiveCodeBench v6, Arena-Hard v2 및 LiveBench(20241125)에서 Qwen3-Max-Preview는 Claude Opus 4, Kimi K2 및 Deepseek-V3.1보다 꾸준히 높은 순위를 기록했습니다.

Qwen3-Max 접속 및 사용 방법(실용 가이드)

1) 브라우저에서 시도해 보세요(Qwen Chat)

방문 웬 채팅 (공식 Qwen 웹/채팅 인터페이스)를 선택하고 Qwen3-Max-미리보기 (지시) 모델은 모델 선택기에 표시됩니다. 대화 및 지시 작업을 시각적으로 평가하는 가장 빠른 방법입니다.

2) 접근 방법 알리바바 클라우드 (모델 스튜디오/클라우드 API)

- Alibaba Cloud에 로그인 → 모델 스튜디오 / 모델 서빙추론 인스턴스를 생성하거나 호스팅된 모델 엔드포인트를 선택하세요. qwen3-max-미리보기 (또는 표시된 미리보기 버전).

- Alibaba Cloud 액세스 키/RAM 역할을 사용하여 인증하고 프롬프트와 생성 매개변수(온도, 최대 토큰 등)가 포함된 POST 요청으로 추론 엔드포인트를 호출합니다.

3) 사용 타사 호스트/애그리게이터

보도에 따르면, 이 미리보기는 CometAPI 및 기타 API 애그리게이터를 통해 이용할 수 있으며, 개발자는 이를 통해 단일 API 키로 여러 호스팅 모델을 호출할 수 있습니다. 이를 통해 여러 제공업체 간의 테스트를 간소화하는 동시에 각 호스트의 지연 시간, 지역별 가용성 및 데이터 처리 정책을 검증할 수 있습니다.

시작 가이드

CometAPI는 OpenAI의 GPT 시리즈, Google의 Gemini, Anthropic의 Claude, Midjourney, Suno 등 주요 공급업체의 500개 이상의 AI 모델을 단일 개발자 친화적인 인터페이스로 통합하는 통합 API 플랫폼입니다. CometAPI는 일관된 인증, 요청 형식 지정 및 응답 처리를 제공하여 애플리케이션에 AI 기능을 통합하는 과정을 획기적으로 간소화합니다. 챗봇, 이미지 생성기, 음악 작곡가 또는 데이터 기반 분석 파이프라인 등 어떤 제품을 구축하든 CometAPI를 사용하면 AI 생태계 전반의 최신 혁신 기술을 활용하면서 반복 작업을 더 빠르게 수행하고 비용을 관리하며 공급업체에 구애받지 않을 수 있습니다.

결론

Qwen3-Max-Preview는 알리바바를 고객에게 수조 달러 규모의 모델을 제공하는 기업 중 하나로 자리매김했습니다. 긴 컨텍스트 길이와 OpenAI 호환 API의 조합은 장문 문서 추론, 코드 자동화 또는 에이전트 오케스트레이션이 필요한 기업의 통합 장벽을 낮춰줍니다. 비용과 미리보기 안정성은 도입 시 주요 고려 사항입니다. 기업은 지연 시간과 가격 책정을 모두 관리하기 위해 캐싱, 스트리밍 및 일괄 호출을 활용한 파일럿을 원할 것입니다.