GPT-4o 실시간 API: 개발자가 WebRTC 또는 WebSocket을 통해 동기화된 텍스트, 오디오 및 비전 데이터를 보내고 받을 수 있도록 하는 저지연 다중 모드 스트리밍 엔드포인트(모델=gpt-4o-realtime-preview-<date>, stream=true) 대화형 실시간 애플리케이션을 위한 것입니다.

기본 정보 및 기능

OpenAI GPT-4o 실시간 (모델 ID: gpt-4o-실시간-미리보기-2025-06-03)는 공개적으로 사용 가능한 최초의 기초 모델입니다. 종단간 음성 대 음성(S2S) 상호 작용 1초 미만의 지연 시간. "omni" GPT-4o 제품군에서 파생된 Realtime 변형은 다음과 같습니다. 음성 인식, 자연어 추론 및 신경망 텍스트 음성 변환 단일 네트워크로 통합하여 개발자가 사람처럼 유연하게 대화하는 음성 에이전트를 구축할 수 있도록 합니다. 이 모델은 특수 목적으로 구축된 실시간 API 그리고 새로운 것과 긴밀하게 통합되어 있습니다 실시간 에이전트 내부의 추상화 에이전트 SDK (타입스크립트 및 파이썬).

핵심 기능 세트 — 종단간 S2S • 중단 처리 • 도구 호출

• 원어민 음성 대 음성: 오디오 입력은 연속 스트림으로 수집되어 내부적으로 토큰화되고, 추론 과정을 거쳐 합성된 음성으로 반환됩니다. 외부 STT/TTS 버퍼가 필요하지 않으므로 수 초의 파이프라인 지연이 발생하지 않습니다.

• 밀리초 단위 지연 시간: 아키텍처 정리, 모델 증류 및 GPU 최적화 서비스 스택을 통해 가능 ~300–500ms 첫 번째 토큰 대기 시간 일반적인 클라우드 배포에서는 인간 대화의 차례응답 규범에 접근합니다.

• 강력한 지시 준수: 대화 스크립트와 함수 호출 추적에 대한 미세 조정을 통해 GPT-4o Realtime은 다음을 보여줍니다. 작업 실행 오류 25% 이상 감소 2024년 4월 GPT-XNUMXo 기준과 비교.

• 결정론적 도구 호출: 이 모델은 OpenAI의 요구사항에 맞춰 구조화된 JSON을 생성합니다. 함수 호출 스키마백엔드 API(예약 시스템, 데이터베이스, IoT)의 결정론적 호출을 허용합니다. 오류 인식 재시도 및 인수 검증 기능이 내장되어 있습니다.

• 우아한 방해: 증분 디코딩과 결합된 실시간 음성 활동 감지기를 사용하면 에이전트가 다음을 수행할 수 있습니다. 문장 중간에 말을 멈추다사용자 중단을 수집하고, 원활하게 응답을 재개하거나 다시 계획합니다.

• 구성 가능한 음성 속도: 새로운 속도 매개변수(0.25~4× 실시간)를 사용하면 개발자가 접근성이나 신속한 애플리케이션에 맞게 출력 속도를 조정할 수 있습니다.

기술 아키텍처 — 통합 멀티모달 변압기

통합 인코더-디코더: GPT-4o Realtime은 Omni 아키텍처를 공유합니다. 단일 스택 변압기 오디오, 텍스트, 그리고 (미래의) 비전 토큰이 하나의 잠재 공간에 공존하는 방식입니다. 계층별 적응형 연산은 오디오 프레임을 이후의 어텐션 블록으로 바로 이동시켜 패스당 20~40ms를 단축합니다.

계층적 오디오 토큰화: 원시 16kHz PCM은 로그멜 패치로 분할 → 거친 입자 음향 토큰으로 양자화 → 의미 토큰으로 압축되어 최적화됩니다. 초당 토큰 운율을 희생하지 않고도 예산을 확보할 수 있습니다.

저비트 추론 커널: 배치된 가중치는 다음과 같이 실행됩니다. 4비트 NF4 양자화 Triton/TensorRT-LLM 커널을 통해 <16 dB MOS 품질 손실을 유지하면서 fp1보다 처리량을 두 배로 늘렸습니다.

스트리밍 주의: 슬라이딩 윈도우 회전 임베딩과 키-값 캐싱을 사용하면 모델은 전화 통화 길이의 대화에 중요한 O(L) 메모리로 마지막 15초의 오디오를 처리할 수 있습니다.

기술적인 세부 사항

- API 버전:

2025-06-03-preview - 전송 프로토콜:

- WebRTC가: 클라이언트 측 오디오/비디오 스트림에 대한 초저 지연 시간(< 80ms)

- 웹 소켓: 100ms 미만의 지연 시간을 갖는 서버 간 스트리밍

- 데이터 인코딩:

- 작 내부 코덱 RTP 오디오용 패킷

- H.264 / H.265 비디오용 프레임 래퍼

- 스트리밍: 지원

stream: true제공하는 증분 토큰이 생성됨에 따라 부분적인 응답이 발생합니다. - 새로운 음성 팔레트: 8명의 새로운 목소리를 소개합니다.합금, 애시, 민요, 산호, 에코, 샐비어, 반짝임및 절—더 많은 것을 위해 나타내는, 인간 같은 상호작용 ..

GPT-4o Realtime의 진화

- 2024년 5월: GPT-4o 옴니 텍스트, 오디오, 비전에 대한 다중 모드 지원으로 데뷔했습니다.

- 2024년 10월: 실시간 API 비공개 베타에 진입합니다(

2024-10-01-preview), 저지연 오디오에 최적화되었습니다. - 2024년 12월: 글로벌 가용성 확대

gpt-4o-realtime-preview-2024-12-17추가, 신속한 캐싱 그리고 더 많은 목소리. - 2025년 6월 3일: 최근 업데이트 (

2025-06-03-preview) 세련된 롤아웃 음성 팔레트 및 성능 최적화.

벤치마크 성능

- MMLU: 88.7GPT-4의 86.5를 앞지르고 있습니다. 대규모 멀티태스킹 언어 이해 .

- 음성 인식: 달성하다 업계 최고의 소음이 많은 환경에서 단어 오류율이 속삭임 기준선.

- 지연 테스트:

- 끝으로 종료 (말하기 → 텍스트로): 50~80밀리초 WebRTC를 통해

- 왕복 오디오 (말하기 → 말하기): <100ms .

기술 지표

- 맞춤형 설비: 지속 15개 토큰/초 텍스트 스트림의 경우 24의 kbps 오디오용 Opus.

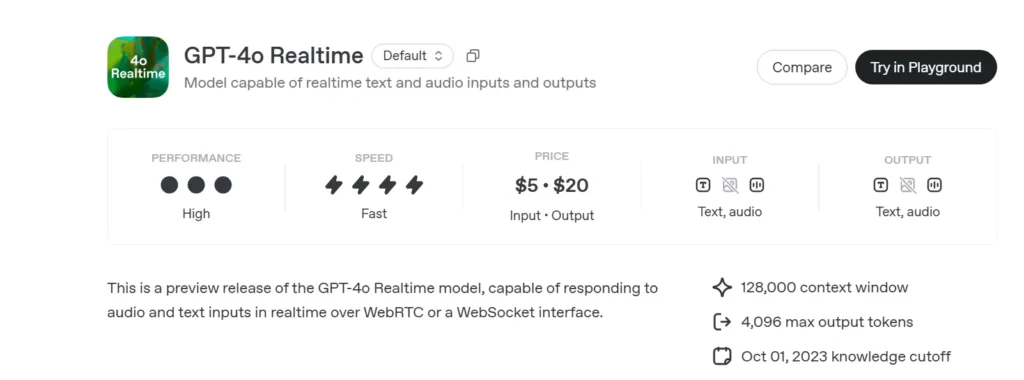

- 가격::

- 본문: 5M 입력 토큰당 1달러, 20M 출력 토큰당 1달러

- 오디오: 입력 토큰 100M개당 1달러, 출력 토큰 200M개당 1달러.

- 유효성: Realtime API를 지원하는 모든 지역에 글로벌하게 배포되었습니다.

CometAPI에서 GPT-4o 실시간 API를 호출하는 방법

GPT-4o Realtime CometAPI의 API 가격:

- 입력 토큰: $2 / M 토큰

- 출력 토큰: $8 / M 토큰

필수 단계

- 에 로그인 코메타피닷컴. 아직 당사 사용자가 아니신 경우 먼저 등록해 주시기 바랍니다.

- 인터페이스의 액세스 자격 증명 API 키를 받으세요. 개인 센터의 API 토큰에서 "토큰 추가"를 클릭하고 토큰 키(sk-xxxxx)를 받아 제출하세요.

- 이 사이트의 url을 받으세요: https://api.cometapi.com/

사용 방법

- "**

gpt-4o-realtime-preview-2025-06-03**요청을 전송하고 요청 본문을 설정하는 엔드포인트입니다. 요청 메서드와 요청 본문은 웹사이트 API 문서에서 확인할 수 있습니다. 웹사이트에서는 사용자의 편의를 위해 Apifox 테스트도 제공합니다. - 바꾸다 귀하 계정의 실제 CometAPI 키를 사용합니다.

- 질문이나 요청을 콘텐츠 필드에 입력하세요. 모델이 이에 응답합니다.

- . API 응답을 처리하여 생성된 답변을 얻습니다.

Comet API의 모델 액세스 정보는 다음을 참조하세요. API doc.

Comet API의 모델 가격 정보는 다음을 참조하세요. https://api.cometapi.com/pricing.

샘플 코드 및 API 통합

import openai

openai.api_key = "YOUR_API_KEY"

# Establish a Realtime WebRTC connection

connection = openai.Realtime.connect(

model="gpt-4o-realtime-preview-2025-06-03",

version="2025-06-03-preview",

transport="webrtc"

)

# Stream audio frames and receive incremental text

with open("user_audio.raw", "rb") as audio_stream:

for chunk in iter(lambda: audio_stream.read(2048), b""):

result = connection.send_audio(chunk)

print("Assistant:", result)

- 주요 매개 변수:

model: “gpt-4o-실시간-미리보기-2025-06-03”version: “2025-06-03-미리보기”transport: "웹RTC" 을 통한 최소 지연stream:true을 통한 증분 업데이트

결합하여 최첨단 다중 모드 추론, 강력한 새로운 음성 팔레트 및 초저 지연 스트리밍, GPT-4o 실시간 (2025-06-03) 개발자가 진정으로 구축할 수 있도록 지원합니다. 대화형, 이야기 잘하는 AI 응용 프로그램.

도 참조 o3-Pro API

안전 및 규정 준수

OpenAI는 GPT-4o Realtime을 다음과 함께 제공합니다.

• 시스템 수준 가드레일: 허용되지 않는 요청(극단주의, 불법 행위)을 거부하도록 정책이 조정되었습니다.

• 실시간 콘텐츠 필터링: 100ms 미만 분류기는 방출 전에 사용자 입력과 모델 출력을 모두 검토합니다.

• 인간의 승인 경로: 고위험 도구 호출(결제, 법률 자문)에서 트리거되며, Agents SDK의 새로운 승인 기본 요소를 활용합니다.