OpenAI는 최근 GPT-5-Codex-Mini 모델 출시, 다중 사용자 계층 구조의 속도 제한 개선, 모델 처리 효율성 최적화 등 여러 가지 업데이트를 발표했습니다.

OpenAI GPT-5-코덱스-미니 새롭게 발표된 GPT-5-Codex의 개발자 중심 버전입니다. 더 작고 비용 및 처리량에 최적화된 모델로, GPT-5-Codex의 코딩 지원 기능 대부분을 제공하면서도 훨씬 낮은 비용과 더 높은 가용 용량을 제공합니다. "미니" 버전은 장시간 코딩 세션, 백그라운드 자동화, 그리고 동일한 플랜에 대해 더 많은 토큰/요청을 확보하는 것보다 원시 최대 성능이 덜 중요한 고빈도 개발자 워크플로에 실용적인 선택으로 자리매김했습니다.

GPT-5-Codex-Mini란 무엇이며, 그 기능은 무엇입니까?

GPT-5-Codex-Mini는 OpenAI의 GPT-5-Codex 제품군의 작고 비용 효율적인 변형으로, Codex 제품 표면(CLI 및 IDE 통합)에 맞춰 특별히 패키징되었습니다. "더 작고 비용 효율적인" 모델로 포지셔닝되어, 최대 성능은 약간 희생하고 리소스 소비는 대폭 낮추고 대화형 개발자 워크플로우를 위한 가용 할당량은 더 높였습니다. 이 미니 모델은 개발자가 훨씬 더 많은 코딩 턴을 실행할 수 있도록 설계되었습니다(OpenAI는 대략 다음과 같이 설명합니다). 4배 더 많은 사용량 공통적이고 명확하게 정의된 엔지니어링 작업의 대기 시간과 비용을 낮추는 동시에 동일한 ChatGPT 구독 계층에 대해.

기능 측면에서 GPT-5-Codex-Mini는 Codex 제품군의 핵심 기능인 코드베이스에 대한 심층적인 이해와 "에이전트" 방식으로 다단계 작업을 실행하는 기능을 그대로 계승합니다. Codex CLI 기능을 기반으로 개발자는 대화형 터미널에서 자연어 명령, 코드 조각, 스크린샷 또는 인터페이스 디자인 다이어그램을 Codex에 제출할 수 있습니다. 모델은 먼저 계획을 제공하고, 사용자 승인을 받은 후 자동으로 파일을 탐색하고, 코드를 편집하고, 명령을 실행하고, 테스트합니다.

모달 관점에서 Codex 제품은 터미널이나 IDE의 세션에 이미지(UI 스크린샷, 디자인 초안, 오류 메시지 스크린샷 등)를 첨부할 수 있도록 합니다. 이 모델은 텍스트와 이미지 콘텐츠를 모두 이해할 수 있지만, 출력은 여전히 텍스트 코드와 설명으로 구성됩니다. 따라서 GPT-5-Codex-Mini는 주로 "텍스트 + 이미지 입력, 텍스트 출력"을 특징으로 하는 코드 프록시 모델로 볼 수 있으며, 이미지 생성, 오디오 생성, 비디오 생성과 같은 작업은 수행하지 않습니다.

GPT-5-Codex-Mini는 GPT-5-Codex와 어떻게 비교되나요?

Codex의 새로운 소식은 무엇인가요?

GPT-5-Codex-Mini 출시 외에도 OpenAI는 ChatGPT Plus, Business, Edu 사용자 레벨에 대해 Codex 속도 제한을 50% 일괄적으로 상향 조정하여 사용 가능한 요청 한도를 크게 늘렸습니다. 한편, ChatGPT Pro 사용자는 응답 속도와 작업 실행 환경을 개선하기 위해 우선 처리 권한을 부여받게 됩니다.

또한, OpenAI는 GPT-5-Codex 모델을 소폭 업그레이드하여 협업 시나리오에서의 성능을 최적화했습니다. 업데이트된 모델은 주요 평가 지표에서 수 퍼센트 포인트의 개선, 토큰 사용 효율성 약 3% 증가, 그리고 예외 상황 처리의 견고성 향상을 보여주며, 이를 통해 사용자 지침의 필요성을 줄였습니다.

| 사용자 수준 | GPT-5-코덱스 | GPT-5-코덱스-미니 |

|---|---|---|

| 플러스/비즈/에듀 | 메시지 양이 각각 1.5배 증가합니다. | 각각 메시지 양이 6배 증가합니다. |

GPT-5-Codex-Mini 대 GPT-5-Codex:벤치마크 차이점

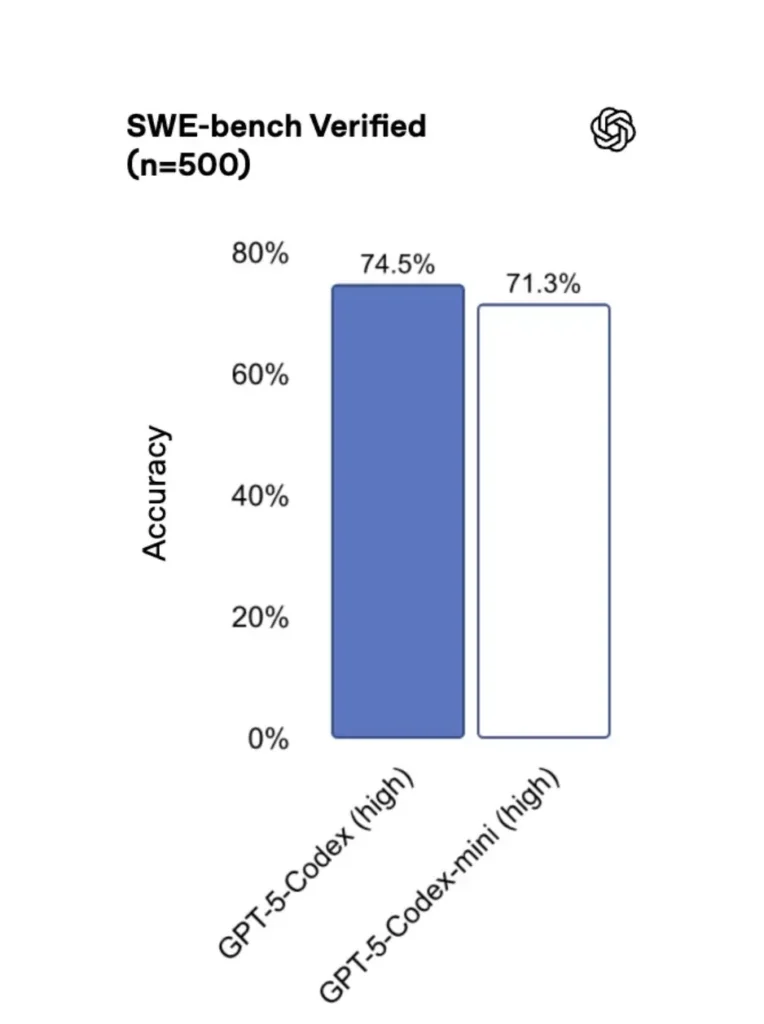

GPT-5-Codex-Mini는 기존 버전에 비해 성능이 약간 저하되었지만, 개발자는 약 4배의 사용 크레딧을 받습니다. SWE-bench Verified 테스트에서 GPT-5 High는 72.8%, GPT-5-Codex는 74.5%, GPT-5-Codex-Mini는 71.3%를 기록했습니다.

Codex(및 그 미니 변형)는 가벼운 상호 작용에 대해 훨씬 적은 토큰을 사용합니다. OpenAI의 자료는 간단한 프롬프트(예: 인용된 수치)에 대해 수십 퍼센트 포인트의 감소를 주장합니다. 토큰이 약 93.7% 감소 (어떤 시나리오에서는 Codex 패밀리와 GPT-5의 가벼운 상호작용에 관한 것입니다.)

GPT-5-Codex-Mini vs GPT-5-Codex:기능 차이점

- 크기 및 비용: Mini는 훨씬 더 작고 비용 효율적입니다. OpenAI는 동일한 구독 제약 조건 하에서 약 4배 더 많은 사용량을 제공한다고 설명합니다. 이는 일상적인 개발자 작업에 대한 할당량/효율성 최적화입니다.

- 기능 범위: GPT-5-Codex는 길고 복잡한 에이전트 작업(대규모 리팩터링, 심층적인 코드 검토, 긴 테스트 주기)에 적합한 고기능 옵션입니다. Mini는 빈번하고 짧은 상호작용에 대해 더욱 빠르고 리소스 사용량이 적도록 조정되었습니다.

- 지연 시간 및 속도 제한: Mini는 일반적으로 대기 시간이 짧고 플랜당 더 높은 요금 한도를 허용하므로 밀도가 높고 대화형 워크플로에 적합합니다.

- 기본 표면: Mini는 Codex CLI와 IDE Extension에서 선택 가능한 모델로 제공되며, GPT-5-Codex는 Codex의 클라우드 작업과 심층 코드 검토 흐름에 대한 기본값입니다.

Mini Codex와 Full Codex를 사용할 때

- 미니 용도: 스캐폴딩, 반복적인 코드 생성, 소규모 리팩토링, 편집 중의 대화형 완성, 할당량이나 비용 제약 하에서 작업할 때.

- GPT-5-코덱스 대상: 포괄적인 코드 검토, 수 시간에 걸친 자율 작업, 복잡한 리팩터링, 모델의 가장 강력한 추론과 테스트 기반 실행이 필요한 작업.

GPT-5-Codex-Mini(CLI, IDE, API)에 어떻게 접속할 수 있나요?

Codex CLI(터미널 우선)

OpenAI 도입 gpt-5-codex-mini Codex CLI 내부에서 모델 옵션으로 사용할 수 있습니다. 일반적인 사용 패턴은 Codex CLI 워크플로를 따릅니다. 대화형 세션 시작, 모델 지정, 파일 또는 스크린샷 첨부, "Codex Cloud 작업" 실행 등이 있습니다. CLI는 빠른 /model 전체 사이를 전환 gpt-5-codex 및 gpt-5-codex-mini처음 실행 시 ChatGPT/Pro/Enterprise 계정을 사용하여 인증하거나 API 키를 제공해야 합니다. CLI는 Codex가 코드베이스를 스캔하고, 테스트를 실행하고, REPL을 열고, 패치 권장 사항을 적용할 수 있도록 다양한 명령을 제공합니다.

예(Codex CLI 대화형 세션):

# Install Codex CLI (npm)

npm i -g @openai/codex

# or Homebrew on macOS

brew install --cask codex

# Launch in a repo

cd myproject

# Open a codex interactive session

codex

# In the session you can switch the model:

# (this is typed in the Codex TUI)

> /model gpt-5-codex-mini

# Ask Codex to generate a unit test

> Write pytest tests for function `calculate_discount` in discounts.py

이 흐름은 도구가 Mini가 사용 한도에 가까워졌다고 제안하는 새로운 Codex CLI 기본값을 반영합니다.

VS 코드 / IDE 확장

예 - Codex IDE 확장(VS Code)에는 이미 다음이 포함되어 있습니다. gpt-5-codex-mini 옵션으로 제공됩니다. Visual Studio Code에 Codex 확장 프로그램을 설치하면 인라인 코드 완성, 리팩토링 제안, AI 기반 빠른 수정 기능을 사용할 수 있습니다. 이 확장 프로그램은 빠른 작업(코드 생성, 선택한 코드 설명, 리팩토링)을 제공하고 편집기에서 Codex Cloud 작업을 실행할 수 있습니다. VS Code 단계는 다음과 같습니다.

- VS Code에 OpenAI Codex / ChatGPT 확장 프로그램을 설치합니다.

- ChatGPT 계정(Plus/Pro/Business)으로 로그인하세요.

- 명령 팔레트를 엽니다.

Cmd/Ctrl+Shift+P → Codex: Set Model→ 선택하다gpt-5-codex-mini. - 인라인 명령을 사용합니다(코드 선택 → 마우스 오른쪽 버튼 클릭 → "Codex로 설명" 또는 구성된 단축키 누름).

예: VS Code 인라인 명령(가상 단계)

- 기능을 선택하세요

user_service.py. - PR 기사

Cmd/Ctrl+Shift+P → Codex: Explain Selection또는 마우스 오른쪽 버튼을 클릭하여 "Codex로 설명"을 선택하세요. - 이 확장 프로그램은 Mini에 대한 설명, 제안된 테스트, Codex Cloud 작업을 사용하여 검토를 위해 브랜치를 푸시하는 원클릭 "PR 생성" 버튼이 있는 측면 패널을 엽니다.

API는 어떤가요? 앱에서 호출할 수 있나요?

OpenAI의 발표 내용은 다음과 같습니다. API 지원이 곧 제공됩니다. GPT-5-Codex-Mini의 경우, 이 글 작성 시점에는 Codex 툴체인(CLI/IDE)에서 먼저 모델을 사용할 수 있습니다. 즉, 프로덕션 API 클라이언트는 모델 이름을 준비해야 합니다. gpt-5-codex-mini 게시되면 요청/응답 API에서 확인할 수 있습니다. 그동안 Codex CLI 및 IDE 플로우를 사용하여 프로토타입을 제작할 수 있습니다.

API 액세스가 활성화된 경우 일반적인 호출(Responses 스타일)은 다음과 같습니다.

# illustrative — check OpenAI docs for final param names

from openai import OpenAI

client = OpenAI(api_key="sk-...")

resp = client.responses.create(

model="gpt-5-codex-mini",

input="Write a Python function that validates an email address and includes unit tests.",

max_tokens=512,

temperature=0.2

)

print(resp.output_text)

Codex Mini를 이용한 신속한 엔지니어링의 모범 사례는 무엇입니까?

아래는 생산 엔지니어링 워크플로에서 Codex Mini를 최대한 활용하기 위한 구체적이고 현장 테스트를 거친 모범 사례와 패턴입니다.

1) 모델 선택 전략 - 믹스 앤 매치

빈도가 높고 복잡도가 낮은 작업(포맷, 소규모 리팩토링, 자동 테스트)에는 Mini를 사용하고, 복잡한 디자인, 심층 디버깅 또는 대규모 저장소 전체 변환에는 전체 Codex를 사용하세요. 전환을 자동화하세요. Codex CLI는 이미 90% 사용률에서 Mini 사용을 권장하며, 스크립트를 작성할 수도 있습니다. /model 작업의 복잡성에 따라 모델을 선택하기 위해 툴링을 전환합니다.

2) 신속한 엔지니어링 템플릿

테스트 생성, 변경 로그 초안, 커밋 메시지 생성, PR 설명 등 반복 가능한 작업을 위한 작고 결정론적인 프롬프트 템플릿을 작성하세요. 이러한 템플릿을 저장소에 재사용 가능한 스니펫으로 저장하거나 Codex 프롬프트 사전 설정으로 저장하세요.

단위 테스트를 위한 프롬프트 템플릿 예시:

# Template: generate_pytests

System: You are a precise Python developer. Produce pytest tests.

User: Given the function below, produce parametrized pytest functions that cover typical edge cases.

--- file: discounts.py

<insert function>

---

Return only valid Python test code with imports and fixtures.

3) 안전망 자동화 - 승인 및 CI 게이팅

사람의 승인 없이 모델이 직접 코드를 푸시하도록 허용하지 마세요. Codex의 승인 모드와 Codex Cloud 작업을 사용하여 차이점을 생성하고 CI에서 사람의 승인을 요구하세요. Codex CLI는 "승인 모드"를 지원하므로 편집 내용은 적용 전에 승인을 받아야 합니다.

4) 모델 호출 캐시 및 중복 제거

반복적인 프롬프트(예: 함수 설명)의 경우, 프롬프트 + 파일 해시 키로 응답을 캐시합니다. 이렇게 하면 중복 호출을 줄이고 비용 프로파일을 예측 가능하게 유지할 수 있습니다.

5) 스트리밍 + 증분 diff 사용

가능하면 전체 파일을 다시 작성하는 대신 스트리밍 출력과 증분적 차이점을 요청하세요. 이렇게 하면 토큰 사용량이 줄어들고 검토자가 원하는 변경 사항을 파악하는 데 도움이 됩니다.

6) 단위 테스트-먼저 생성기 흐름

테스트를 생성하고 임시 환경에서 로컬로 실행합니다. 테스트가 실패하면, 실패한 테스트에 대한 수정 사항을 제공하는 모델을 사용하여 반복합니다. 각 반복을 테스트 출력이 포함된 개별 프롬프트로 구성합니다.

Codex CLI 자동화 스니펫 예시(bash):

# Generate tests

codex --model gpt-5-codex-mini request "Generate pytest tests for discounts.py" > generated_tests.py

# Run tests locally

pytest generated_tests.py -q || {

echo "Tests failed. Opening Codex for debugging..."

codex --model gpt-5-codex-mini request "Tests failed. Here's pytest output: $(tail -n 50 pytest_output.txt). Propose a fix for discounts.py."

}

결론

GPT-5-Codex-Mini는 실용적인 제품 전환입니다. 개발자 워크플로는 지연 시간, 비용, 그리고 중단 없는 흐름이 중요한 여러 개의 짧은 상호작용으로 구성되는 경우가 많다는 점을 인지하고 있습니다. OpenAI는 IDE 및 CLI 사용을 위한 미니 티어를 제공함으로써 팀이 모든 상호작용에 대해 가장 비용이 많이 드는 모델을 즉시 적용하지 않고도 일상적인 코딩 지원을 확장할 수 있도록 지원합니다.

개발자는 액세스할 수 있습니다 GPT-5-코덱스 API ,GPT-5 프로 API CometAPI를 통해 나열된 cometAPI의 최신 모델은 기사 게재일을 기준으로 합니다. 접속하기 전에 CometAPI에 로그인하고 API 키를 받았는지 확인하세요.코멧API 공식 가격보다 훨씬 낮은 가격을 제공하여 통합을 돕습니다.

출발 준비 되셨나요?→ 지금 CometAPI에 가입하세요 !