MiniMax-M2.5는 MiniMax가 선보인 생산성 중심의 신규 대형 언어 모델로, 코딩, 에이전트형 도구 사용, 오피스 워크플로에 최적화되어 있습니다. MiniMax의 네이티브 플랫폼을 통해 호출할 수도 있고, CometAPI와 같은 API 집계기를 통해 호출할 수도 있습니다. MiniMax-M2.5는 채팅 형식을 지원하므로 API를 사용하려면 CometAPI의 API 키만 확보하면 됩니다.

MiniMax-M2.5란?

MiniMax-M2.5는 MiniMax의 최신 메이저 모델 릴리스로, M2 패밀리의 진화형입니다. 회사는 이를 범용의 에이전트 대응 모델로 포지셔닝하며, 특히 코드 생성, 도구 사용, 다단계 추론에서 강점을 보인다고 설명합니다. M2.5 패밀리는 2026년 2월 릴리스로 발표되었으며, 표준형 M2.5와 동일한 핵심 역량을 유지하면서 지연 시간을 낮춘 “highspeed” 변형 모두를 포함합니다. M2.5 패밀리는 소프트웨어 공학 벤치마크에서 점수를 끌어올렸고, 외부 도구(검색, 에이전트 등)와 상호작용 시 더 나은 동작을 보입니다.

벤더는 M2.5를 기존 M2.x 릴리스 대비 한 단계 업그레이드된 모델로 소개하며, 더 강한 추론력, 더 나은 코드 생성, 향상된 툴 호출 신뢰성을 강조합니다. MiniMax가 2026년 2월 초 공개한 릴리스 노트는 M2.5를 이정표로 규정하며, 정교해진 인스트럭션 튜닝, 강화된 코드 이해, 여러 코드 중심 벤치마크에서의 유의미한 향상을 언급합니다. 릴리스에는 다음이 포함됩니다:

- 표준 M2.5 모델(정확성과 추론 강조).

- 상호작용형 개발 워크플로를 위해 지연 시간을 낮춘 M2.5-highspeed 변형.

- 대규모 코드 생성 사용을 겨냥한 “Coding Plan”에 대한 명시적 가이드와 과금 옵션.

주요 기술 하이라이트

- 아키텍처: MoE(총 파라미터 수는 크지만 추론 시 활성 집합은 훨씬 작음)로, 무거운 작업에서 비용/성능의 균형점을 달성.

- 강점: 최첨단 수준의 코딩 성능, 멀티턴 추론, 긴 문맥 처리, 에이전트/툴 통합.

- 버전: MiniMax는 처리량 대비 지연 시간에 맞춰 튜닝된 변형(예:

MiniMax-M2.5,M2.5-highspeed)을 제공합니다.

오늘날 이것이 중요한 이유: 개발자 도구, 프로그래밍 보조, 에이전트형 자동화를 구축하는 팀은 여러 턴에 걸친 추론, 안전한 툴 호출, 고품질 코드 출력을 중시합니다. M2.5는 아키텍처와 학습 선택을 통해 바로 그런 시나리오를 겨냥해 마케팅되고 있습니다.

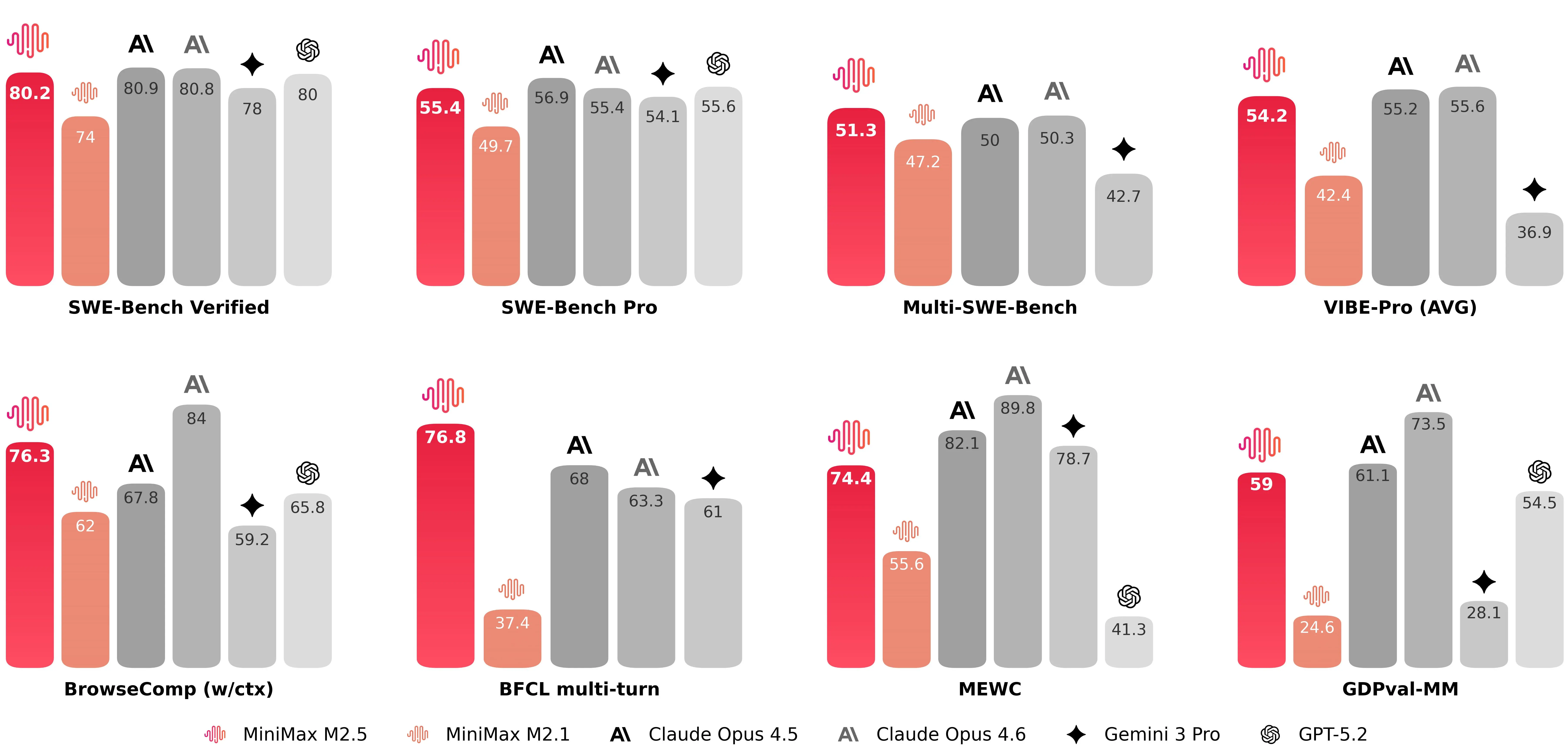

MiniMax-M2.5 벤치마킹

코딩 특화 벤치마크에서의 위치

MiniMax-M2.5는 SWE-Bench Verified에서 80.2%를 기록했으며, 멀티태스크 코딩 및 브라우징 기반 벤치마크에서도 강한 성적을 보였습니다(회사 공개 수치: 컨텍스트 관리 활성 시 Multi-SWE-Bench 51.3%, BrowseComp 76.3%). 이러한 수치는 출시 시점 기준 코드 생성과 문제 해결에서 공개 이용 가능한 최고 성능 모델군에 M2.5가 속한다는 것을 보여줍니다. MiniMax-M2.5의 출시는 M2.5가 최상위 코딩 모델들과 경쟁하고 있음을 뒷받침합니다.

개발자들에게 주는 이점은 두 가지입니다:

- 첫 시도 성공률 향상: 수정 라운드 감소, 인간 디버깅 축소, 자율 코딩 에이전트의 “돌봄” 부담 감소.

- 더 넓은 풀스택 커버리지: M2.5는 데스크톱, 모바일, 크로스 플랫폼 툴체인 전반의 풀스택 워크플로를 지원한다고 설명되며, 단편 코드가 아닌 일관된 다중 파일 솔루션과 빌드 스크립트까지 생성하는 것을 목표로 합니다.

에이전트형 워크플로를 위해 설계

M2.5는 “에이전트 시나리오에 본질적으로 설계되었다”고 설명됩니다. 실질적으로 이는 아키텍처와 학습 과정이 다음을 우선한다는 뜻입니다:

- 툴 호출 정확도: 올바른 문법과 파라미터로 API 호출을 발행하거나 셸/SQL 명령을 실행.

- 컨텍스트 전환과 메모리: 중단된 다단계 작업을 이전 상태를 잃지 않고 이어서 진행.

- 파일 조작: 일반 오피스 포맷을 프로그램적으로 생성/편집(예: PowerPoint 생성 후 후속 요청에 따라 수정).

검색 및 브라우징 보강

M2.5를 브라우징이나 검색/검색어 기반 레이어와 결합하면, 외부 정보를 통합하고 인용을 출력에 반영하는 능력이 강화되어 브라우징 벤치마크 성적이 뚜렷이 개선된다고 MiniMax는 보고합니다. 이는 최신 콘텐츠를 가져오고, API 결과를 교차 확인하며, 실제 데이터를 코드 생성에 보강해야 하는 도구(예: 최신 SDK 문서를 가져와 코드 생성 중 정확히 사용) 구축에 적합함을 의미합니다. 이러한 역량은 자동 QA, CI 툴체인, 문서 기반 어시스턴트 같은 “에이전트형” 기능을 만드는 팀에 중요합니다.

MiniMax-M2.5 API는 어떻게 사용할 수 있나요? (CometAPI 경유)

CometAPI는 수백 개의 모델을 단일 OpenAI 호환 REST 인터페이스로 제공하는 API 집계 플랫폼입니다. CometAPI의 인터페이스는 OpenAI의 chat/completions 엔드포인트를 반영하므로, api_base와 API 키만 교체하면 기존 OpenAI 스타일 클라이언트를 재사용할 수 있는 경우가 많습니다. 통합 청구, 멀티 모델 A/B 테스트, 벤더 추상화 등의 이유로 MiniMax 플랫폼과 직접 연동하지 않으려면, CometAPI의 “chat” 인터페이스를 통해 MiniMax-M2.5를 호출할 수 있습니다. CometAPI 플랫폼은 일관된 요청 포맷, SDK, 웹 플레이그라운드를 제공하며, 모델별 이름과 파라미터를 노출합니다(호출 시 제공자/모델 문자열을 정확히 선택).

아래는 CometAPI를 통해 MiniMax-M2.5를 호출하는 간결한 실전 가이드로, curl과 Python 예제를 포함합니다.

시작을 위한 기본 단계는?

- CometAPI 계정을 만들고 API 키를 발급받습니다. (CometAPI는 모델을 시험할 수 있는 플레이그라운드와 SDK를 제공합니다.)

- CometAPI의 모델 목록 혹은 CometAPI 플레이그라운드에서 MiniMax-M2.5의 정확한 모델 이름을 확인합니다.

- 선택한 MiniMax 모델을

model파라미터에 지정하고, CometAPI의 chat/completion 스키마를 따르는 페이로드로 인증된 POST 요청을 보냅니다. - 워크플로에 맞게 파라미터(temperature, max_tokens, system 메시지, 스트리밍)를 조정합니다.

인증 및 엔드포인트 기본

- 기본 URL:

https://api.cometapi.com/v1(예:/chat/completions와 같은 OpenAI 스타일 경로 지원) - 헤더:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - 모델 필드: CometAPI의 모델 카탈로그에 표시된 정확한 모델 문자열을 사용(예:

"minimax-m2.5")

예제 1 — 빠른 curl (REST, OpenAI 스타일)

// Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

메모:

- CometAPI 카탈로그에 표시된 모델 문자열을 정확히 사용하세요.

stream: true는 스트리밍 출력을 지원합니다(부분 토큰을 원한다면 서버 전송 이벤트나 청크 응답을 처리하세요).

예제 2 — Python (requests)를 사용한 chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

예제 3 — litellm / CometAPI 통합 사용(Python 편의 레이어)

CometAPI는 여러 커뮤니티 SDK와 어댑터에서 지원됩니다. liteLLM 문서는 COMETAPI_KEY를 설정하고 모델 이름으로 호출하는 간결한 흐름을 보여줍니다. 프로토타이핑에 적합합니다:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

litellm / Comet 통합은 많은 기존 OpenAI SDK 패턴을 반영하는 유틸리티(스트리밍, async, 명시적 api_key 파라미터 등)를 제공합니다.

M2.5를 위한 프롬프트와 시스템 메시지는 어떻게 설계해야 하나요

역할과 제약을 명시적으로 제시

코드를 요청할 때 M2.5에 명확한 시스템 역할을 부여하세요. 예:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

복잡한 문제에는 단계 분해 사용

M2.5에 복잡한 기능 구현을 요청할 때는 짧은 분해 과정을 사용하세요:

- 설계 개요를 요청

- 인터페이스 시그니처 요청

- 구현과 테스트를 요청

이렇게 하면 환각 위험을 줄이고 모듈화된, 리뷰하기 좋은 출력을 얻을 수 있습니다.

Temperature, max_tokens와 안전성

- 결정적 코드에는

temperature를 0.0에 가깝게 설정하세요. - 탐색적 설계에는 0.2–0.5 범위가 창의적 접근을 도울 수 있습니다.

- 대규모 리팩터링이나 긴 테스트 스위트에는 충분한

max_tokens를 확보하세요.

유닛 테스트와 근거 제시 요청

코드를 요청할 때 유닛 테스트와 알고리즘에 대한 짧은 설명도 함께 요청하세요. 미묘한 버그를 발견하고, 첫 시도부터 실행 가능한 산출물을 얻는 데 도움이 됩니다.

장기 작업 추론과 상태 추적

M2.5는 우수한 상태 추적 메커니즘을 갖추고 있어, 매번 제한된 수의 목표에 집중함으로써 긴 시간 순서 전반에 걸친 사고의 연속성과 방향성을 효과적으로 보장합니다. 또한 문맥 인지 기능을 갖추어 효율적인 작업 실행과 최적화된 컨텍스트 관리를 지원합니다.

프로덕션을 위한 M2.5 실전 활용 팁

MiniMax-M2.5는 다단계 툴링과 코드에 맞춰 튜닝되었습니다. 아래는 프로덕션에서 최상의 결과를 얻기 위한 실전형 팁입니다.

프롬프트 엔지니어링 & 시스템 메시지

- 역할과 제약을 명시하는 시스템 메시지를 사용하세요. 코드 작업에는 필요한 런타임/테스트 프레임워크를 포함하세요(예: “Python 3.11과 호환되는 pytest로 반환”).

- 컨텍스트 제공: 에이전트형이나 다단계 작업에는 단계 메타데이터와 도구 설명을 구조화된 JSON 또는 불릿 리스트로 포함하세요. M2.5는 툴 사용에 최적화되어 있어 구조화된 입력에 잘 반응합니다.

함수/툴 호출

- CometAPI를 툴 호출 게이트웨이로 사용할 경우, 추가 필드(예: OpenAI 스타일의

function_call)가 CometAPI/모델 기대치와 일치하는지 확인하세요. 제공자마다 툴 의미가 다를 수 있으므로 Comet 모델 페이지에서 모델 지원 여부를 확인하세요. - 견고한 오케스트레이션을 위해 큰 작업은 더 작은 호출로 나누고 결정적 체크포인트를 유지하세요. M2.5는 다단계 지시를 잘 따르지만, 각 단계 후 검증하면 가장 신뢰성 있는 동작을 얻을 수 있습니다.

Temperature, max_tokens, 비용 관리

- 코드 생성이나 리팩터링에는 낮은

temperature(0.0–0.2)를 사용하고, 예상 출력 크기에 맞게max_tokens를 설정하세요. - 탐색형 프롬프트에는

temperature를 높일 수 있지만 토큰 사용량 증가에 유의하세요. CometAPI를 통해 라우팅할 때는 제공자별 요금과 폴백 규칙을 비교하세요 — CometAPI는 카탈로그에 모델 인스턴스별 토큰 가격을 표기합니다.

컨텍스트 윈도와 장문서

- M2.5 변형은 긴 컨텍스트를 지원하는 경우가 많습니다(컨텍스트 길이는 모델 사양을 확인). 매우 긴 문서는 청크로 나누고 요약한 뒤, 요약과 관련 청크만 제공하는 방식이 좋습니다. 전체 파일을 한 번에 보내지 마세요.

안전성, 유해 콘텐츠, 환각 완화

- 가드레일을 사용하세요: 시스템 메시지, 외부 검증기, 테스트 스위트(예: 생성 코드의 유닛 테스트)가 위험을 줄여줍니다.

- 외부 참조 검증: 모델이 웹의 사실이나 코드를 인용하면, 신뢰하거나 배포하기 전에 프로그램적으로 검증하세요.

흔한 함정과 회피 방법

함정: 단일 모델 출력을 과신

대응: 테스트, 정적 검사, 중요 로직에 대해서는 독립적인 다중 컴플리션을 요청해 비교하세요. CometAPI는 여러 모델 간 전환을 지원하며, OpenAI의 chat 포맷을 사용해 언제든 교체할 수 있습니다.

함정: 프로덕션 코드에 높은 temperature 사용

대응: temperature를 낮게 유지하세요. 창의적 대안을 원한다면 낮은 temperature의 다중 변형을 요청하거나 모델에 차이점을 설명하도록 하세요.

함정: 모델 버전 관리 무시

대응: 배포 매니페스트에 모델 이름과 제공자 문자열을 추적하세요. MiniMax-M2.5에서 MiniMax-M2.5-highspeed로 바꾸거나 다른 제공자로 전환할 때는 릴리스 변경으로 간주하고 회귀 테스트를 수행하세요.

최종 권고와 현실적 기대치

MiniMax-M2.5는 코드 중심의 에이전트형 LLM에서 주목할 만한 도약입니다 — 강력한 코드 생성, 멀티턴 추론, 툴 안전 동작을 약속합니다. 팀의 우선순위가 견고한 개발자 도구, 에이전트 프레임워크, 코드 어시스턴트 구축이라면, 비교 후보군에 M2.5를 포함할 가치가 있습니다. CometAPI를 통합 게이트웨이로 사용하면 실험 속도를 높이고, 전체 통합을 다시 작업하지 않고도 제공자 전환이나 A/B 테스트를 수행할 수 있습니다.

몇 가지 실용적 요약:

- CometAPI의 플레이그라운드로 빠르게 프로토타이핑한 뒤, 코드에서 모델 식별자를 고정하세요.

- 낮은 temperature를 사용하고, 테스트와 설명을 요청하며, 항상 자동 검증을 실행하세요.

- 모델을 강력한 공동 개발자로 대하되, 무오류 존재로 보지 마세요: 사람 리뷰, CI 파이프라인, 텔레메트리를 적용하세요.

개발자는 지금 MiniMax-M2.5를 CometAPI를 통해 액세스할 수 있습니다. 시작하려면 Playground에서 모델의 역량을 탐색하고, 자세한 안내는 API guide를 참고하세요. 액세스 전에 CometAPI에 로그인하고 API 키를 발급받았는지 확인하세요. CometAPI는 통합을 돕기 위해 공식 가격보다 훨씬 낮은 가격을 제공합니다.

Ready to Go?→ Sign up for M2.5 today